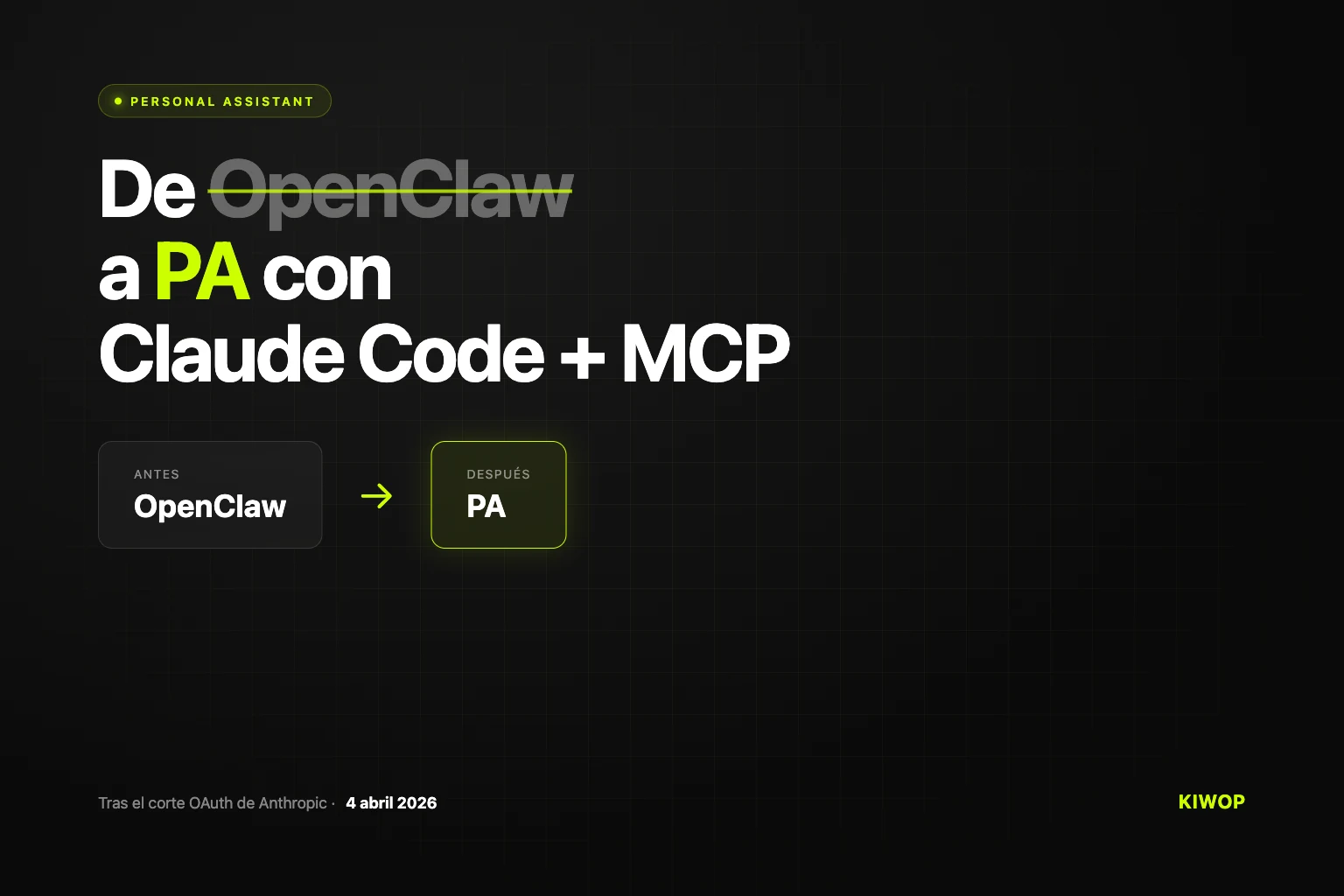

Alternativa a OpenClaw: assistent personal amb Claude Code i MCP després del tall d'Anthropic (abril 2026)

Per l'equip de Kiwop · Agència Digital especialitzada en Desenvolupament de Programari i Intel·ligència Artificial aplicada · Publicat el 19 d'abril de 2026 · Última actualització: 19 d'abril de 2026

TL;DR — El 4 d'abril de 2026 Anthropic va desactivar els tokens OAuth que permetien a OpenClaw utilitzar les subscripcions Claude Max i Claude Pro. Els usuaris afectats tenen tres opcions: pagar "Extra Usage" a preu d'API (entre 5 i 50 vegades més car), migrar a OpenAI Codex, o reconstruir l'assistent personal sobre Claude Code + MCP. A Kiwop vam escollir la tercera via i documentem aquí l'arquitectura resultant — un PA amb quatre canals (IMAP, Gmail, Slack, Telegram), unes 500 línies de Python pròpies, i cost marginal zero en continuar dins de la subscripció Max.

A Kiwop vam trigar 48 hores a decidir què fer després de l'anunci d'Anthropic. Aquest article explica aquesta decisió — per què no vam passar a OpenAI Codex, per què no vam pagar l'"Extra Usage" d'Anthropic, i com vam reconstruir el nostre assistent personal (PA) sobre Claude Code i Model Context Protocol (MCP). Un assistent que segueix corrent sobre la mateixa subscripció Claude Max x20, amb els mateixos canals que fèiem servir abans, però amb una diferència fonamental: l'stack és nostre, el codi és nostre i el proveïdor no pot estirar la catifa.

No és un manifest anti-Anthropic — seguim fent servir els seus models a diari i creiem que són els millors del mercat per a agència el 2026. És una lectura analítica del que passa quan el model econòmic d'un agent depenia d'una política d'un proveïdor, aquesta política canvia, i cal decidir si adaptar-se o reconstruir.

Índex

- Què és un PA i per què la paraula "Personal" importa

- Per què vam triar OpenClaw com a assistent personal IA al gener de 2026

- El 4 d'abril de 2026: què va canviar exactament

- Claude Code vs OpenAI Codex com a motor per al teu assistent personal

- Arquitectura de l'assistent personal amb Claude Code i MCP servers

- OpenClaw vs PA: la comparativa honesta

- Alternativa a OpenClaw el 2026: quan té sentit construir el teu propi PA

- Preguntes freqüents

- Conclusió

Què és un PA i per què la paraula "Personal" importa

Un Personal Assistant (PA) és un assistent IA que atén a una sola persona centralitzant els seus correus, calendari, missatges i documents en una interfície conversacional. A diferència d'un SaaS multi-tenant, un PA corre dedicat a un únic humà amb accés exclusiu als seus comptes. Aquesta definició, aparentment evident, és la que separa un PA ben dissenyat d'una eina comercial disfressada.

La distinció no és pedant. Un humà el 2026 pot tenir tres o quatre adreces de correu (la de la feina, la d'un projecte paral·lel, la personal), dos o tres números de WhatsApp, comptes de Slack en diferents workspaces, i mitja dotzena de calendaris sincronitzats. Un PA centralitza tota aquesta superfície i la converteix en una única interfície conversacional que entén qui ets i què t'importa. No perquè estigui entrenat per a tu, sinó perquè corre per a tu i només per a tu, amb accés als teus comptes, els teus fils, les teves preferències.

Aquesta és la promesa d'un PA, i és la que ens va fer adoptar OpenClaw al gener. I és també la que ens va fer decidir, a l'abril, reconstruir-lo nosaltres mateixos quan l'economia del proveïdor va canviar.

Per què vam triar OpenClaw com a assistent personal IA al gener de 2026

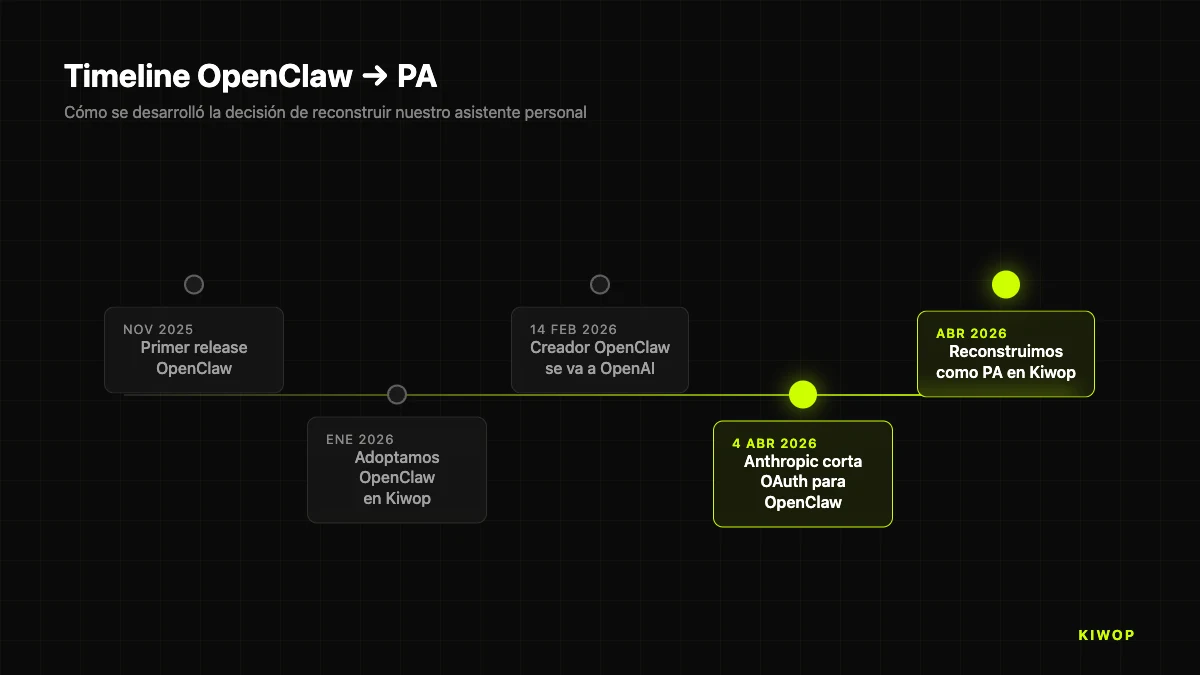

OpenClaw és un assistent personal IA open source llançat a finals de 2025 que es connecta a canals com WhatsApp, Telegram, Slack i més de vint plataformes de missatgeria utilitzant un Gateway central i un sistema de skills extensibles. El projecte corre a la teva pròpia màquina (local, VPS, o fly.io) i, fins a l'abril de 2026, suportava OAuth contra la subscripció Claude Max — això significava que totes les interaccions es comptabilitzaven contra el pla Max x20 que ja pagàvem. La llista de canals suportats inclou Discord, Google Chat, Signal, iMessage, Teams, Matrix, Feishu, LINE, Mattermost, Nextcloud Talk, Nostr, Synology Chat, Tlon, Twitch, Zalo, WeChat i WebChat, entre d'altres.

El càlcul econòmic a finals de gener era simple. Teníem una subscripció Claude Max x20 (uns 200 dòlars al mes) que ja fèiem servir intensament per a Claude Code en desenvolupament. Afegir-li un assistent personal que processés correus, llegís Slack, respongués missatges de Telegram, i fes briefings matinals no generaria cost addicional rellevant, perquè els límits de la subscripció donaven de sobres. Per 200 dòlars al mes teníem un desenvolupador IA sènior durant el dia i un assistent personal durant el matí i la tarda.

OpenClaw va complir durant gener, febrer i març. Cada matí a les vuit, un briefing amb la meva agenda i correus prioritaris aterrava a Telegram. Podia respondre al bot des del mòbil i el meu missatge anava contra Claude amb tot el context de correu i calendari. Podia preguntar-li des de WhatsApp "tinc alguna cosa a les cinc?" i responia correctament. Era, per ser honestos, el producte més útil de la temporada per a la productivitat diària.

Però el 4 d'abril tot va canviar.

El 4 d'abril de 2026: què va canviar exactament

Aquell dia, Anthropic va anunciar que els tokens OAuth de Claude Max i Claude Pro deixarien de funcionar amb "tercers harnesses" — un terme que a la indústria inclou OpenClaw, Crush, Aider, i altres clients que fins llavors es connectaven a Claude utilitzant les credencials de subscripció de l'usuari. La cobertura mediàtica va ser immediata: TechCrunch, VentureBeat, The Register i Hacker News van cobrir la notícia, amb fils molt actius d'usuaris reportant pujades de cost significatives després del canvi.

L'explicació oficial d'Anthropic va citar "la pressió sobre els nostres recursos de còmput i enginyeria, i el desig de servir fiablement un nombre ampli d'usuaris". La lectura tècnica i econòmica és més interessant.

Una subscripció Claude Max x20, tècnicament, és un contracte amb límits elàstics: Anthropic et cobra una tarifa plana i et dona un límit generós d'ús que la majoria de clients no consumeix completament. Aquest model funciona quan les sessions les llança un humà davant del teclat: els usos són intermitents, les pauses són freqüents, i el consum real queda molt per sota del sostre. Quan poses un agent autònom multi-canal entre l'humà i el model — com fa OpenClaw — el consum es dispara de forma molt predictible: cada missatge entrant dispara una crida, cada resposta en dispara una altra, i 24 hores al dia hi ha trànsit fins i tot quan l'humà dorm.

Multiplicat per la base instal·lada estimada d'OpenClaw a escala mundial, el cost compute per a Anthropic era insostenible dins del preu de subscripció. La solució del proveïdor va ser separar ambdós mons: Claude.ai, Claude Code i Claude Cowork segueixen coberts per Max/Pro, però tot el que va per tercers harnesses ara es factura a través d'"Extra Usage" al preu d'API.

Per a un usuari com nosaltres, que processava entre 300 i 500 interaccions diàries amb el PA (briefings, correus, triatges, respostes des del mòbil), la nova factura projectada amb Extra Usage passava de "inclòs als 200 dòlars del Max" a uns 800-1.200 dòlars mensuals addicionals. No era assumible. Tampoc era justificable, atès que la mateixa feina continuava cabent sobrada dins del pla Max si l'executàvem des de Claude Code directament.

La pregunta llavors va ser: com fer que un assistent personal multi-canal corri dins de Claude Code?

Claude Code vs OpenAI Codex com a motor per al teu assistent personal

La primera temptació va ser passar OpenClaw a un altre proveïdor. El mateix OpenClaw suporta OAuth contra ChatGPT i Codex, i Peter Steinberger — creador del projecte — havia anunciat al febrer que s'incorporava a OpenAI. Passar l'assistent a córrer sobre una subscripció ChatGPT Pro o un pla Codex era tècnicament una qüestió de canviar l'authentication profile.

Vam descartar aquesta ruta per tres raons.

La primera, qualitat del model per a les tasques que ens importen. A dia d'avui, en triatge de correu, resum de fils Slack, i extracció d'informació de calendari, els models d'Anthropic (especialment Opus 4.7) ens donaven consistentment millors resultats que GPT-5 amb el mateix prompt. No és una opinió genèrica — ho vam avaluar durant el mes de març fent córrer els mateixos briefings per ambdós proveïdors i comparant les sortides qualitativament, sense metodologia formal publicable però amb criteris consistents aplicats pel mateix revisor. La conclusió per al nostre cas d'ús (gestió de correu en castellà i català, amb vocabulari tècnic d'agència) va ser clara a favor d'Anthropic. El teu quilometratge pot variar — et recomanem fer la teva pròpia avaluació amb els teus propis prompts abans de triar proveïdor.

La segona, lock-in amb un proveïdor que acabava de demostrar canvis unilaterals de política. Si Anthropic podia tancar l'OAuth a tercers amb quinze dies de preavís, qualsevol altre proveïdor podia fer el mateix. La lliçó no era "canvia de proveïdor", la lliçó era "no lliguis la teva infraestructura crítica diària a decisions alienes sobre models de facturació". Moure OpenClaw a OpenAI era arreglar el símptoma sense tractar la causa.

La tercera, i la més important: Claude Code ja era a l'stack. El fèiem servir cada dia per programar amb IA en agència. Tenia MCP servers connectats. Sabia llegir les nostres bases de dades, executar scripts, desplegar en producció. Si en lloc de tractar l'assistent personal com un projecte separat el tractàvem com un "ús més" de Claude Code — amb el seu propi CLAUDE.md, els seus propis MCPs, les seves pròpies comandes — podíem reutilitzar absolutament tota la infraestructura. I el més important: aquest ús continuava cobert per la subscripció Max x20 perquè Claude Code és producte first-party d'Anthropic, no un tercer.

La decisió es va prendre en una tarda. El nom del projecte: PA, directe i literal.

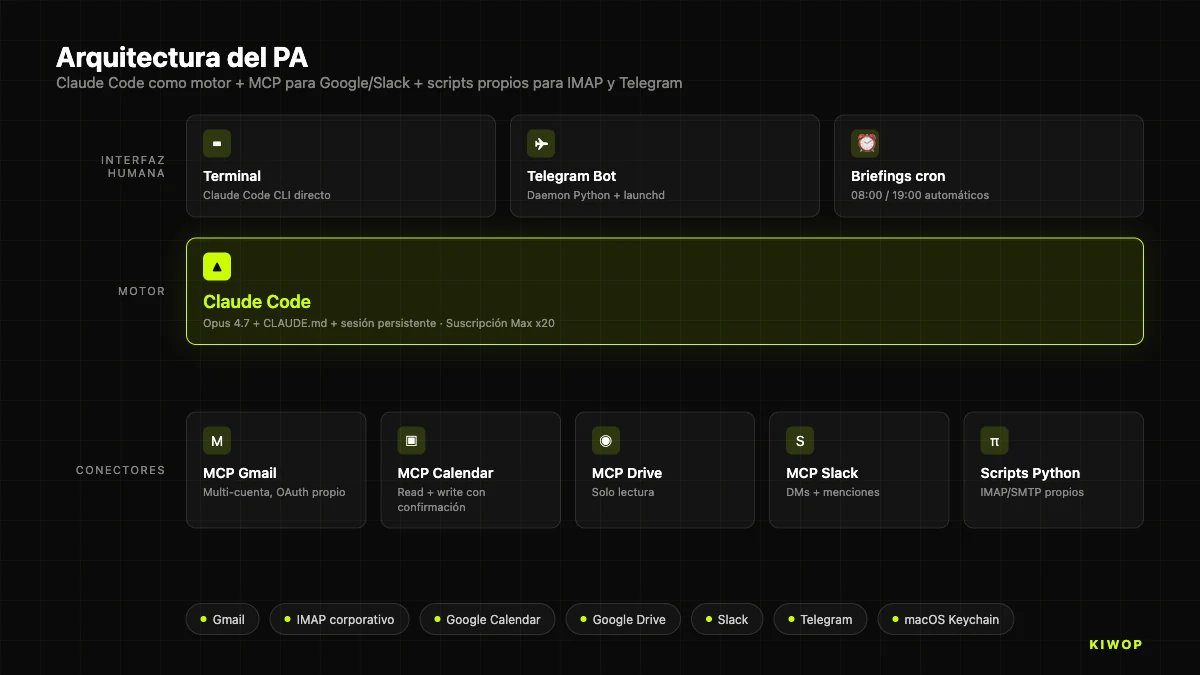

Arquitectura de l'assistent personal amb Claude Code i MCP servers

El PA corre en un directori propi (~/Dev/PA) amb una estructura simple però deliberada. No és una aplicació tancada: és un conjunt d'scripts Python, configuracions de Claude Code i un bot de Telegram que conversen entre si a través del sistema operatiu. La filosofia és l'oposada a OpenClaw, que integra tot dins d'un Gateway monolític. A PA, cada peça fa una cosa i el pegament és Unix.

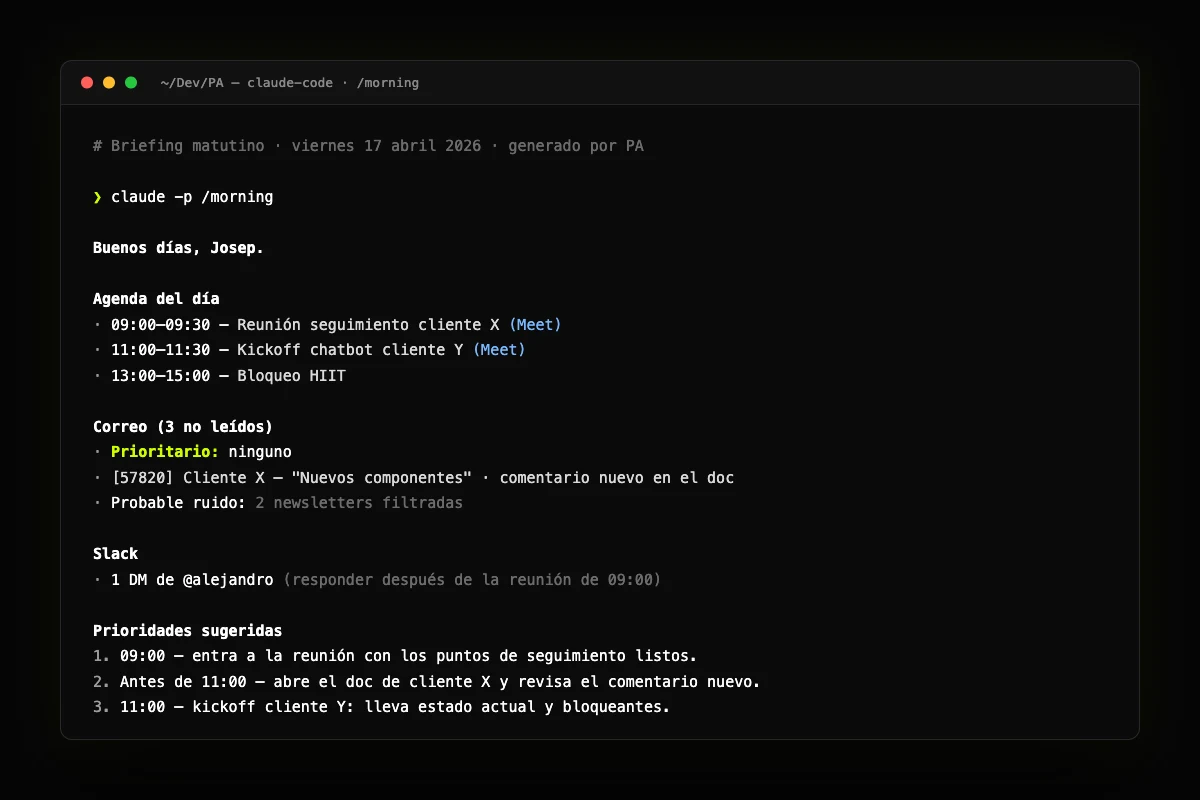

La base: Claude Code com a motor conversacional

Claude Code és el cervell. No un chatbot, no una API, sinó el CLI complet d'Anthropic corrent en mode "projecte" amb un directori dedicat i el seu propi arxiu CLAUDE.md que defineix persona, idioma per defecte (català en el nostre cas), i regla de confirmació obligatòria abans d'enviar correus o crear esdeveniments. Aquesta regla és innegociable: el PA mai toca res sense preguntar primer.

Cada vegada que interactuem amb el PA, sigui per terminal, per comanda programada, o pel bot de Telegram, el que passa per dins és una sessió de claude -p amb context persistent. Això significa que la memòria de l'assistent no viu en un magatzem extern capritxós: viu en el propi flux de sessió de Claude Code, amb les mateixes garanties de caché i reinjecció que fem servir quan desenvolupem.

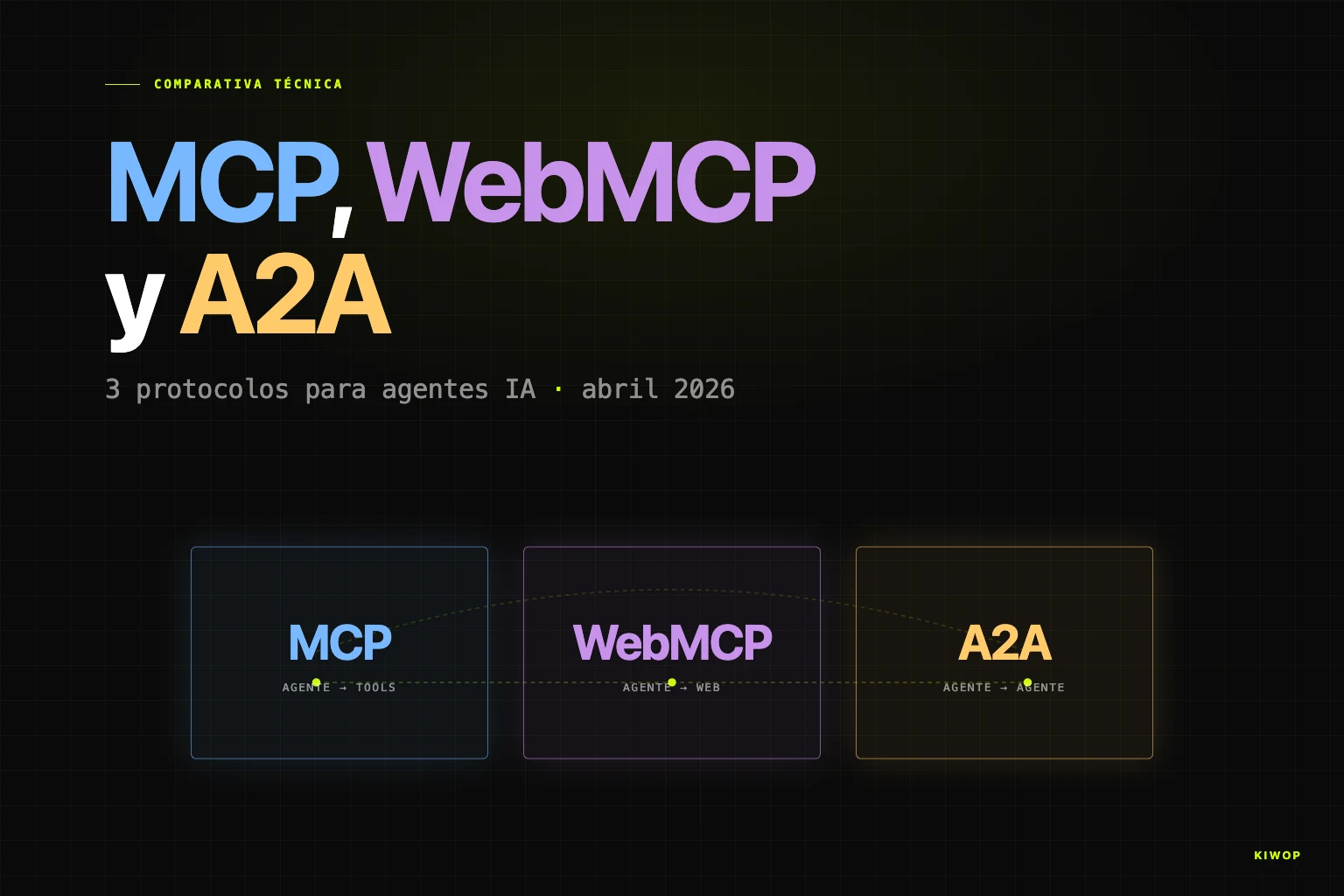

Els connectors: MCP per a tot l'extern

Per accedir al món exterior, el PA utilitza MCP — Model Context Protocol — l'estàndard obert que Anthropic va publicar el 2024 i que s'ha convertit en el llenguatge comú dels agents IA el 2026. Si vols entendre què és MCP i per què importa tant, l'article WebMCP: la teva web preparada per a agents IA entra en el detall tècnic. MCP és la peça que permet que Claude Code es connecti a sistemes empresarials via integració de LLMs sense reescriure connectors a mida per a cada servei.

En el cas del PA, els connectors MCP actius són:

- Gmail MCP: llegir, redactar, enviar correus des de les múltiples adreces d'una mateixa persona (el compte professional d'agència, el compte personal, el compte d'un projecte paral·lel). Lectura sempre; escriptura només amb confirmació.

- Google Calendar MCP: consultar agenda, crear i moure esdeveniments. També amb confirmació.

- Google Drive MCP: cerca i lectura de documents sota demanda. Només lectura.

- Slack MCP: llegir DMs i mencions, respondre amb confirmació.

Tots aquests connectors són de tercers, mantinguts activament, i s'autentiquen per OAuth propi de cada servei. En cap cas passem les credencials al PA directament — són els servidors MCP qui gestionen l'autenticació, i nosaltres només autoritzem l'accés des del navegador una sola vegada al setup.

Els punts cecs de MCP: correu IMAP i Telegram

MCP cobreix la superfície Google + Slack, però deixa dos buits importants per a un assistent que pretén ser "personal": el correu corporatiu sobre IMAP (el servidor de correu propi d'una empresa, no Gmail), i els missatges de Telegram. Per a aquests dos buits hem escrit scripts Python propis que actuen com a pont entre el món exterior i Claude Code.

El client IMAP és un conjunt de petits scripts: mail_fetch.py, mail_read.py, mail_send.py, mail_flag.py. Cadascun fa una cosa. S'autentiquen contra la bústia del domini de l'empresa llegint les credencials des de Keychain de macOS (mai des d'arxius en disc o variables d'entorn persistents). Quan Claude Code necessita llegir el correu corporatiu, invoca aquests scripts com a eines des de la sessió, de la mateixa manera que invocaria un MCP.

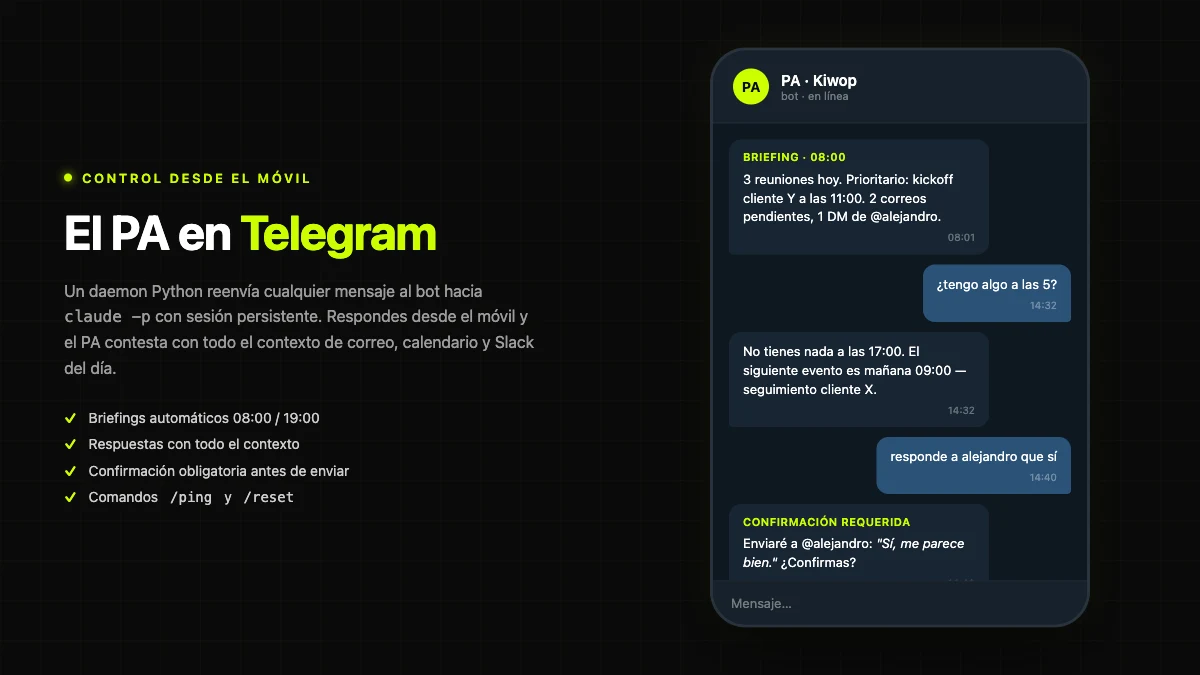

El bot de Telegram és el component més interessant de PA. És un daemon Python gestionat per launchd (l'equivalent macOS de systemd) que s'arrenca a l'iniciar sessió i es reinicia sol si falla. Quan arriba un missatge al bot des del mòbil, el daemon el passa a claude -p amb sessió persistent, espera la resposta, i la formata com a Markdown compatible amb Telegram abans de tornar-la. El resultat és que pots parlar amb el PA des del mòbil com si fos qualsevol chatbot, però per sota la resposta la genera Claude amb tot el context del teu correu i calendari del dia.

Els briefings programats: cron + launchd

Dos briefings programats tanquen el sistema: un a les 08:00 ("morning") i un altre a les 19:00 ("evening"). Els dispara cron, que executa l'script run_briefing.sh passant-li el tipus de briefing. Aquest script llança una sessió de Claude Code amb un prompt específic ("llegeix correus no llegits importants, consulta calendari del dia, resumeix prioritats") i desa la sortida a briefings/YYYY-MM-DD-morning.md. Si el bot Telegram està actiu, el mateix script empeny el briefing al xat perquè aterri al mòbil abans de començar el dia.

Estructura del repo

Tota aquesta màquina viu en uns 20 arxius Python més un grapat de shell scripts. Cap base de dades, cap backend, cap Docker. El codi font complet del PA és més petit que un component React típic. Això és deliberat: com menys codi, menys manteniment; i com menys abstracció, més fàcil és depurar quan alguna cosa es trenca. Aquesta decisió és consistent amb el que recomanem als nostres clients a LLMOps: gestionar models de llenguatge en producció — la complexitat operativa mata agents més que la complexitat del model.

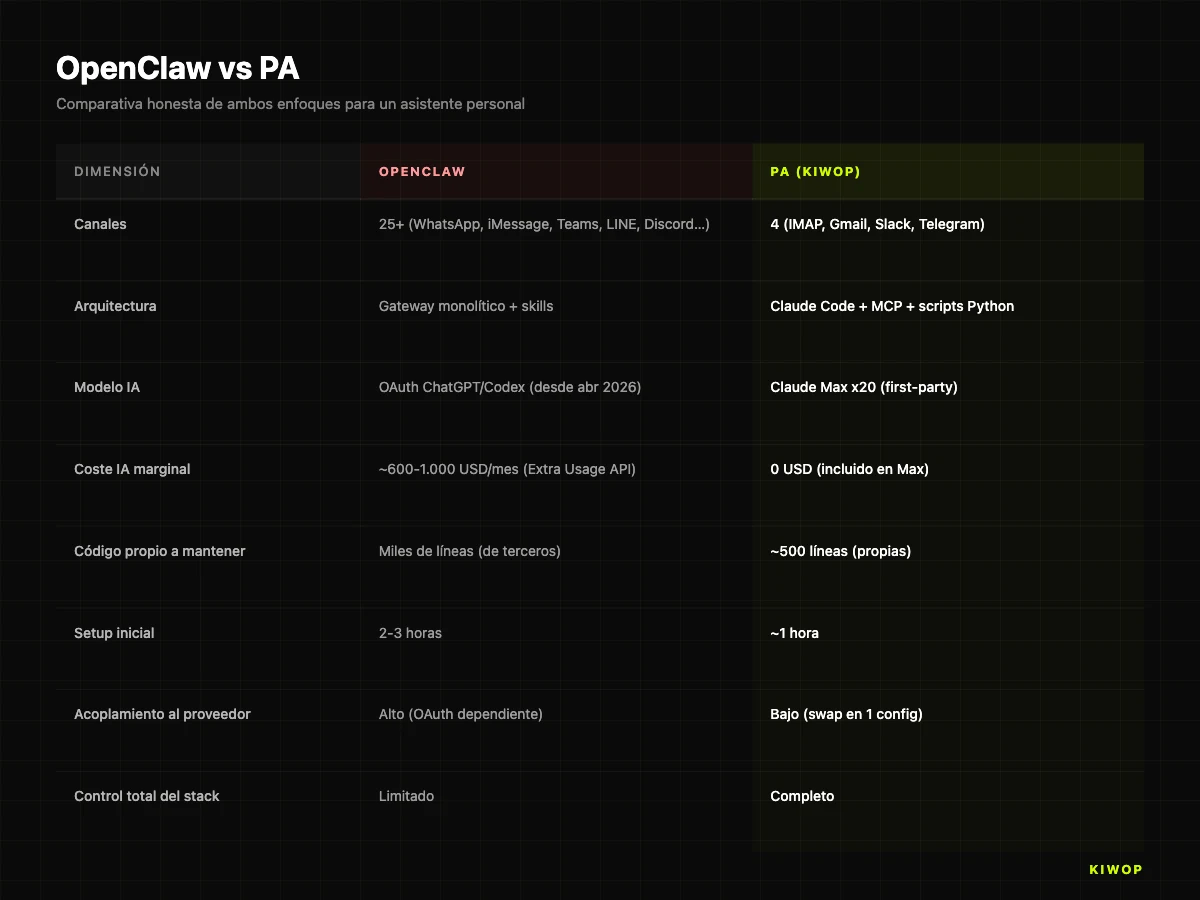

OpenClaw vs PA: la comparativa honesta

No és una competició. OpenClaw continua sent un producte més complet, amb més canals, amb una comunitat activa i amb una ruta de producte clara. Si algú ens pregunta el 2026 "vull un assistent personal amb WeChat, LINE, iMessage i Discord simultanis", la resposta honesta és "mira OpenClaw". Per al cas "vull WhatsApp + Telegram + correu + calendari + Slack, corrent sobre el meu Claude Max, amb codi que pugui auditar i modificar", la resposta és PA.

L'elecció entre un i altre és fonamentalment una elecció sobre quant d'acoblament vols amb un proveïdor extern. OpenClaw et dona més capacitats out-of-the-box a canvi de dependre de les polítiques OAuth d'Anthropic o OpenAI. PA et dona menys capacitats però amb la certesa que mentre puguis pagar Claude Max i el servei Gmail segueixi oferint MCP, res extern et pot deixar sense assistent de la nit al dia.

Construïm el teu? Dissenyem i desenvolupem assistents personals IA a mida per a professionals i directius. → Desenvolupament d'agents IA

Alternativa a OpenClaw el 2026: quan té sentit construir el teu propi PA

Ens pregunten ja amb certa freqüència si construiríem PAs a mida per a clients. La resposta curta és que sí, i ho estem començant a oferir com a part dels serveis de desenvolupament d'agents IA. La resposta llarga requereix matisar per a qui té sentit construir un PA i per a qui és un excés.

Quan construir un PA té sentit:

- Per a un professional que ja processa manualment més de 80 correus al dia distribuïts en diversos comptes, i que dedica 30-45 minuts diaris al triatge.

- Per a algú que ja fa servir Claude Code en desenvolupament i té una subscripció Max, de manera que el cost marginal de l'assistent és efectivament zero.

- Per a rols que exigeixen disponibilitat 24/7 (fundadors, directius, advocats autònoms, consultors sènior) però que no poden justificar contractar un humà PA per cost o discrecionalitat.

- Per a qui vol control total sobre les dades: el PA no envia correus ni calendari a servidors de tercers més enllà dels propis del LLM.

Quan NO té sentit:

- Per a un empleat que ja treballa dins de Gmail/Outlook i l'empresa del qual no autoritzaria connectar un LLM extern al compte corporatiu. La barrera aquí és política i de seguretat, no tècnica — tot i que en aquest escenari un projecte de RAG empresarial sobre infraestructura controlada pot ser la resposta correcta.

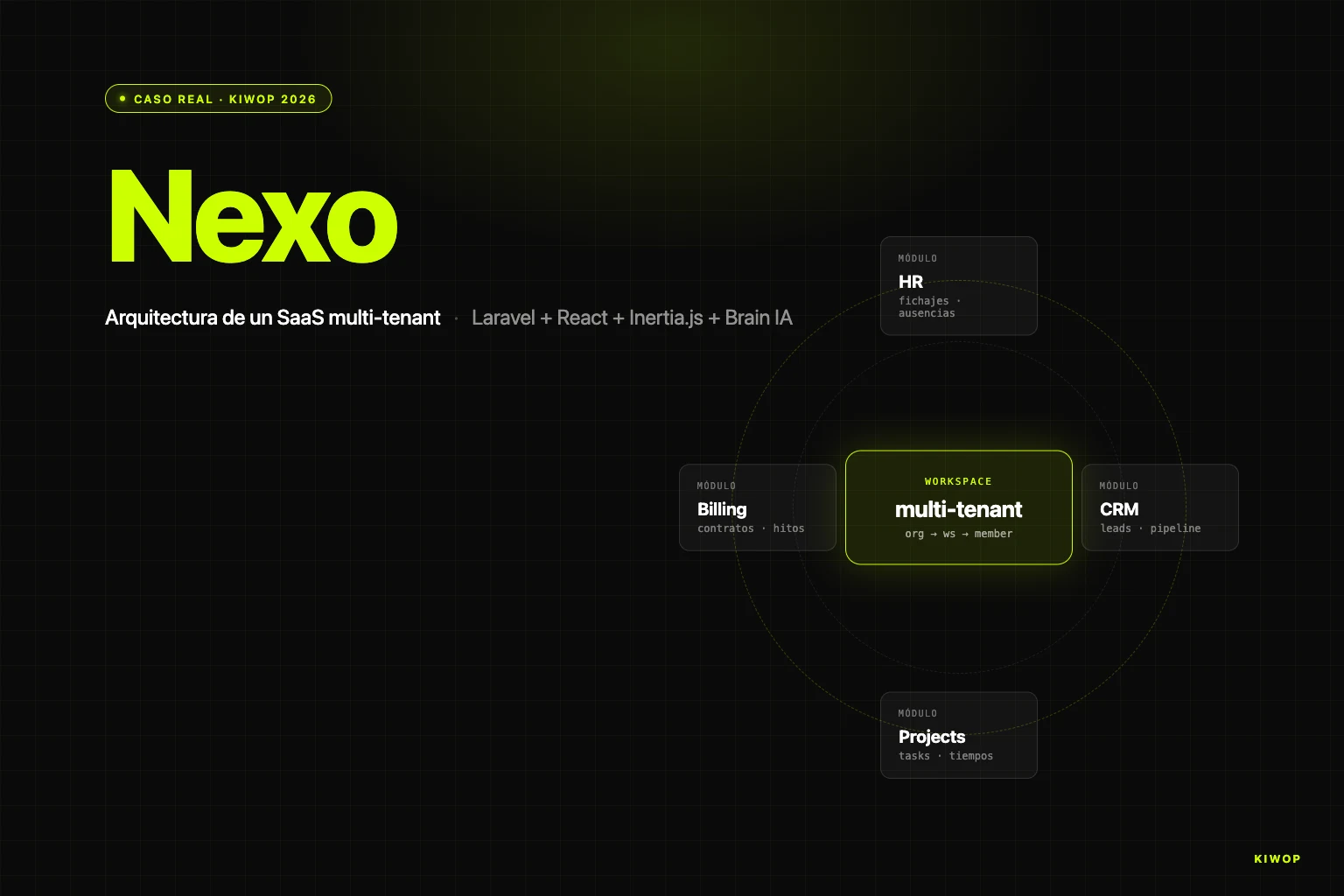

- Per a agències que volen "un PA que gestioni a tots els clients" — això no és un PA, és un SaaS multi-tenant i el plantejament arquitectònic ha de ser radicalment diferent.

- Per a qui no té ja una subscripció Claude Max o equivalent: el càlcul econòmic canvia molt si cal pagar API pay-as-you-go.

- Per a qui espera un assistent infal·lible. El PA en el seu estat actual pot ocasionalment perdre un correu al triatge, o malinterpretar un esdeveniment de calendari. La regla de confirmació abans d'actuar és precisament per cobrir-nos davant aquestes errades.

La lliçó més àmplia, més enllà de si construeixes o no el teu PA, és una altra: els agents IA depenen econòmicament del model de facturació del proveïdor, i aquest model pot canviar. Anthropic el va canviar el 4 d'abril. OpenAI ha canviat el seu en diverses ocasions des del llançament de ChatGPT Pro. Google ajusta el seu regularment. Qualsevol arquitectura d'agent que vulguis fer servir durant anys ha de preveure aquest risc, i la resposta no és tècnica — és estratègica. Construir capes fines i desacoblades entre la teva lògica i el model del proveïdor és el que et permet pivotar en 48 hores quan canvia la política.

A Kiwop ho anomenem "agents a prova de proveïdor". No és una metodologia amb nom comercial: és una forma de dissenyar que es resumeix en tres regles. Primera, el pegament entre peces és codi propi, mai un framework de tercers. Segona, els prompts i els fluxos estan en els teus arxius, no en un SaaS. Tercera, pots canviar el model amb un únic fitxer de configuració, sense tocar la resta del sistema. PA compleix les tres. Si demà Anthropic tanqués una altra porta, el pont a OpenAI o a Google ens costaria uns pocs commits i una hora de testing, perquè tota l'enginyeria al voltant (MCPs, scripts IMAP, bot Telegram, launchd) és agnòstica al model.

Preguntes freqüents

Quina és la millor alternativa a OpenClaw el 2026?

La millor alternativa depèn del cas d'ús. Per a qui ja té subscripció Claude Max, l'opció més econòmica és construir un assistent personal propi sobre Claude Code + MCP (cost marginal zero). Per a qui prefereix un producte llest, OpenClaw continua sent vàlid pagant "Extra Usage" d'Anthropic o canviant l'OAuth a ChatGPT/Codex. Per a entorns corporatius regulats, recomanem avaluar solucions on-premise o un projecte RAG empresarial sobre infraestructura controlada.

Puc continuar utilitzant OpenClaw amb la meva subscripció Claude Pro o Max?

No. Des del 4 d'abril de 2026, els tokens OAuth de Claude Pro i Claude Max van deixar de funcionar amb OpenClaw i amb altres harnesses de tercers. OpenClaw continua funcionant, però has de pagar l'ús a part mitjançant Extra Usage d'Anthropic (tarifes d'API) o mitjançant la subscripció OAuth d'OpenAI (ChatGPT/Codex). Per als clients que processaven un volum alt, el salt de cost reportat per la comunitat ha estat significatiu.

Què és MCP (Model Context Protocol)?

MCP és l'estàndard obert que va publicar Anthropic a finals de 2024 perquè els models de llenguatge es connectin a eines, bases de dades i APIs externes de forma uniforme. El 2026 està suportat pels principals clients d'IA — inclosos Claude Code, Cursor, Windsurf i d'altres — i la llista de servidors MCP disponibles (Gmail, Calendar, Drive, Slack, Linear, GitHub, Notion, etc.) creix setmana a setmana. El PA utilitza MCP com la via principal d'accés a Gmail, Google Calendar, Google Drive i Slack.

Quant costa construir un PA propi?

Si ja tens subscripció Claude Max x20 (uns 200 USD/mes), el cost marginal és zero des del punt de vista del model IA. El temps de construcció, si el fas tu mateix partint de zero, ronda les 20-30 hores distribuïdes en una setmana. Si el subcontractes a una agència, depèn de l'abast (quins canals, quines integracions MCP, si requereix veu o no), però per a l'abast estàndard del PA descrit en aquest article estimem entre 4.000 i 7.000 euros de construcció i un manteniment molt baix posterior.

Per què Claude Code i no OpenAI Codex?

Claude Code encaixa millor amb el model d'assistent personal per dues raons molt concretes. Primera, la qualitat d'Opus 4.7 en tasques de triatge de correu i gestió de calendari era superior a la de GPT-5 en les nostres proves internes a març de 2026 (avaluació qualitativa, no metodologia formal publicable). Segona, Claude Code és producte first-party d'Anthropic i continua cobert per la subscripció Max, mentre que fer servir Codex des de dins del nostre stack ja muntat hauria significat pagar doble subscripció (Max per a desenvolupament, ChatGPT Pro per a PA) sense guany funcional clar.

És el PA segur per a correus confidencials?

El PA és tan segur com el proveïdor del model al qual et connectes. En el cas d'Anthropic, els correus processats no es fan servir per entrenar models (política pública d'Anthropic a 2026) i la comunicació és xifrada. Dit això, qualsevol PA que faci passar contingut sensible per un LLM extern implica un acte de confiança en aquest proveïdor. Per a contingut regulat (sanitari, legal, financer amb secret professional), recomanem revisar els termes específics i considerar alternatives on-premise.

Es pot integrar WhatsApp?

A dia d'avui, WhatsApp no disposa d'un MCP oficial i els bridges no oficials (com els que OpenClaw integra) requereixen mantenir un compte de WhatsApp Business API o tècniques menys estables. El PA en la seva versió actual no integra WhatsApp nativament — fem servir Telegram com a canal mòbil primari per estabilitat. Estem avaluant l'MCP de WhatsApp Cloud API de Meta per a una segona iteració.

El PA pot actuar sense supervisió humana?

Per disseny, no. La regla de confirmació obligatòria abans de qualsevol acció d'escriptura (enviar correu, crear esdeveniment, respondre Slack) és el nucli de seguretat de l'assistent. Veure un correu, llegir calendari, buscar al Drive — tot això són operacions de lectura i les fa sense confirmar. Però enviar, crear, moure, esborrar — sempre requereixen un "sí" explícit de l'humà. És una decisió arquitectònica conscient: preferim un PA una mica menys àgil però que no cometi errors irreversibles.

Aquesta arquitectura funciona a Windows o Linux?

Sí, amb ajustos. Els conceptes (Claude Code + MCP + scripts Python + daemon Telegram) són portables. El que canvia és el gestor de processos a l'arrencada: a macOS fem servir launchd, a Linux seria systemd amb unitats user, i a Windows el Task Scheduler. El Keychain per a credencials d'IMAP també té equivalents en altres plataformes (Secret Service a Linux, Credential Manager a Windows).

Conclusió: els agents IA i el risc de proveïdor

El canvi de política d'Anthropic del 4 d'abril de 2026 ens va fer un favor. Ens va obligar a plantejar-nos si volíem continuar externalitzant una peça crítica de la nostra productivitat diària a un projecte de tercers, per brillant que fos, quan teníem totes les peces per construir-la nosaltres mateixos sobre un stack que ja dominàvem. La resposta, amb dues setmanes de perspectiva, és clara: no volíem. I no volem, per a cap capa crítica de la nostra feina.

La lliçó no és "tots hauríeu de construir el vostre PA". La lliçó és que el 2026, amb models d'IA cada vegada més capaços i amb MCP consolidant-se com l'estàndard d'integració, la distància entre fer servir un agent de tercers i construir el teu propi s'ha reduït dràsticament. El que el 2023 hauria requerit un equip de tres enginyers durant tres mesos avui són unes 500 línies de Python i una tarda de setup. Aquesta barrera enderrocada és la que defineix l'onada actual de la IA aplicada — i la que millor explica per què les agències de programari el 2026 estem en una posició tan diferent a la de fa dos anys.

Si t'estàs plantejant muntar el teu propi assistent personal, o si necessites ajuda construint agents IA robustos per al teu equip o empresa, a Kiwop — Agència Digital especialitzada en Desenvolupament de Programari i Intel·ligència Artificial aplicada per a clients globals a Europa i als EUA — oferim desenvolupament a mida d'agents IA i consultoria d'intel·ligència artificial per a contextos de producció. El PA que descrivim aquí és el millor exemple viu de com ho fem per a nosaltres mateixos.