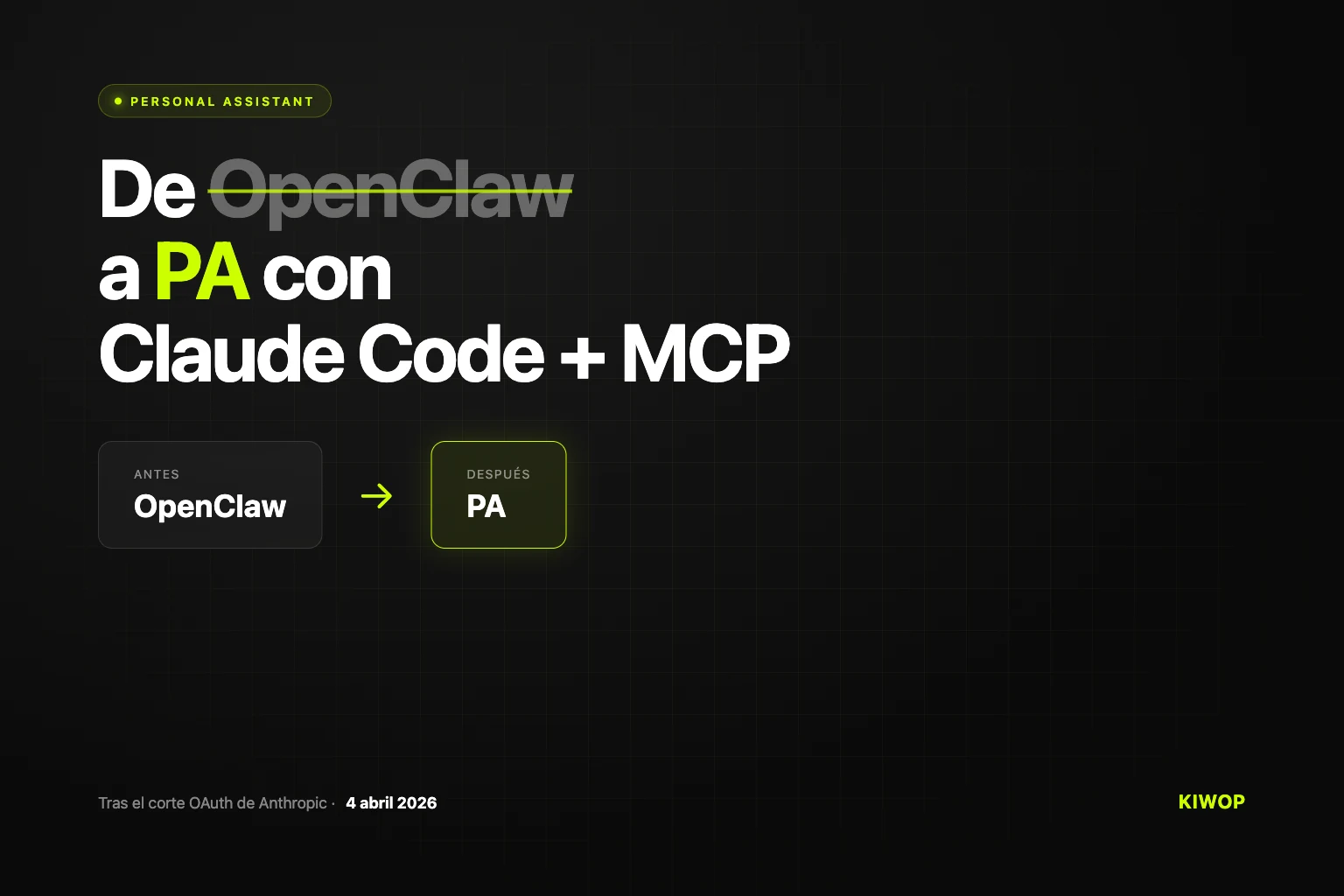

Alternativa ao OpenClaw: assistente pessoal com Claude Code e MCP após o corte da Anthropic (abril 2026)

Pela equipa da Kiwop · Agência Digital especializada em Desenvolvimento de Software e Inteligência Artificial aplicada · Publicado a 19 de abril de 2026 · Última atualização: 19 de abril de 2026

TL;DR — A 4 de abril de 2026 a Anthropic desativou os tokens OAuth que permitiam ao OpenClaw usar as subscrições Claude Max e Claude Pro. Os utilizadores afetados têm três opções: pagar "Extra Usage" ao preço de API (entre 5 e 50 vezes mais caro), migrar para OpenAI Codex, ou reconstruir o assistente pessoal sobre Claude Code + MCP. Na Kiwop escolhemos a terceira via e documentamos aqui a arquitetura resultante — um PA com quatro canais (IMAP, Gmail, Slack, Telegram), cerca de 500 linhas de Python próprias, e custo marginal zero por se manter dentro da subscrição Max.

Na Kiwop demorámos 48 horas a decidir o que fazer após o anúncio da Anthropic. Este artigo conta essa decisão — porque não passámos para OpenAI Codex, porque não pagámos a "Extra Usage" da Anthropic, e como reconstruímos o nosso assistente pessoal (PA) sobre Claude Code e Model Context Protocol (MCP). Um assistente que continua a correr sobre a mesma subscrição Claude Max x20, com os mesmos canais que usávamos antes, mas com uma diferença fundamental: o stack é nosso, o código é nosso e o fornecedor não pode puxar o tapete.

Não é um manifesto anti-Anthropic — continuamos a usar os seus modelos diariamente e achamos que são os melhores do mercado para agência em 2026. É uma leitura analítica do que acontece quando o modelo económico de um agente dependia de uma política de um fornecedor, essa política muda, e há que decidir se nos adaptamos ou reconstruímos.

O que é um PA e porque a palavra "Pessoal" importa

Um Personal Assistant (PA) é um assistente IA que serve uma única pessoa centralizando os seus emails, calendário, mensagens e documentos numa interface conversacional. Ao contrário de um SaaS multi-tenant, um PA corre dedicado a um único humano com acesso exclusivo às suas contas. Essa definição, aparentemente evidente, é a que separa um PA bem desenhado de uma ferramenta comercial disfarçada.

A distinção não é pedante. Um humano em 2026 pode ter três ou quatro endereços de email (o do trabalho, o de um projeto paralelo, o pessoal), dois ou três números de WhatsApp, contas de Slack em diferentes workspaces, e meia dúzia de calendários sincronizados. Um PA centraliza toda essa superfície e transforma-a numa única interface conversacional que percebe quem és e o que te importa. Não porque esteja treinado para ti, mas porque corre para ti e só para ti, com acesso às tuas contas, aos teus threads, às tuas preferências.

Essa é a promessa de um PA, e é a que nos fez adotar o OpenClaw em janeiro. E é também a que nos fez decidir, em abril, reconstruí-lo nós mesmos quando a economia do fornecedor mudou.

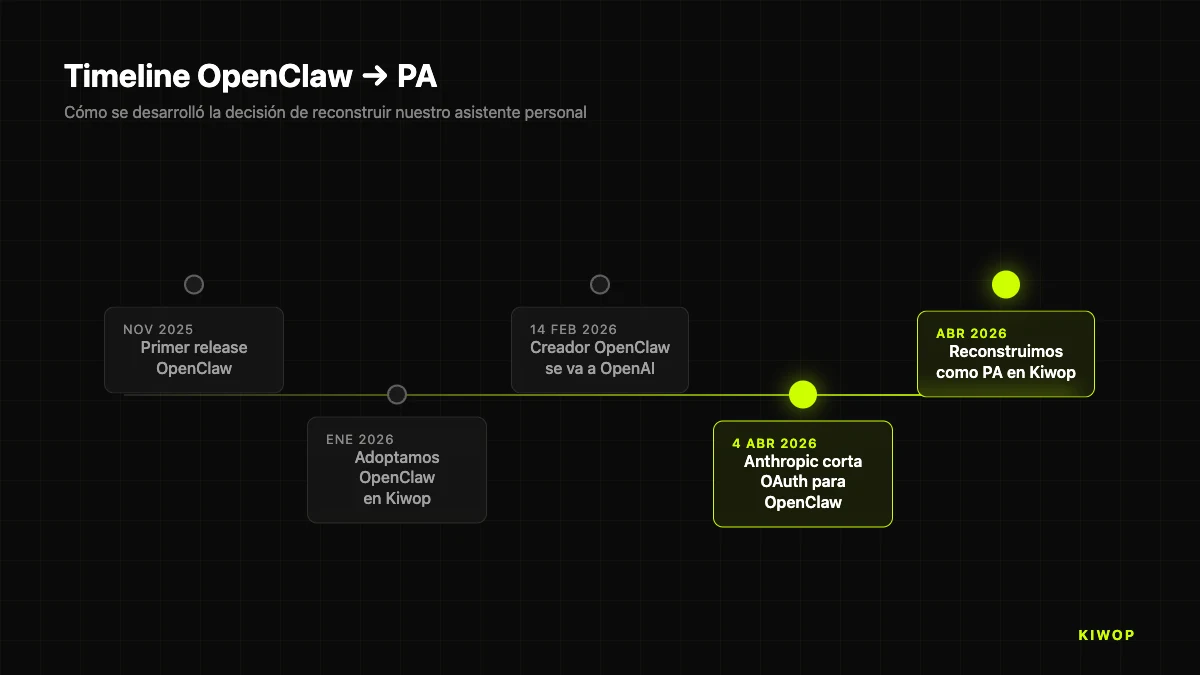

Porque escolhemos o OpenClaw como assistente pessoal IA em janeiro de 2026

O OpenClaw é um assistente pessoal IA open source lançado no final de 2025 que se liga a canais como WhatsApp, Telegram, Slack e mais de vinte plataformas de mensagens usando um Gateway central e um sistema de skills extensíveis. O projeto corre na tua própria máquina (local, VPS, ou fly.io) e, até abril de 2026, suportava OAuth contra a subscrição Claude Max — isso significava que todas as interações eram contabilizadas no plano Max x20 que já pagávamos. A lista de canais suportados inclui Discord, Google Chat, Signal, iMessage, Teams, Matrix, Feishu, LINE, Mattermost, Nextcloud Talk, Nostr, Synology Chat, Tlon, Twitch, Zalo, WeChat e WebChat, entre outros.

O cálculo económico no final de janeiro era simples. Tínhamos uma subscrição Claude Max x20 (cerca de 200 dólares por mês) que já usávamos intensivamente para Claude Code em desenvolvimento. Adicionar-lhe um assistente pessoal que processasse emails, lesse Slack, respondesse a mensagens de Telegram, e fizesse briefings matinais não ia gerar custo adicional relevante, porque os limites da subscrição davam de sobra. Por 200 dólares por mês tínhamos um programador IA sénior durante o dia e um assistente pessoal durante a manhã e a tarde.

O OpenClaw cumpriu durante janeiro, fevereiro e março. Todas as manhãs às oito, um briefing com a minha agenda e emails prioritários aterrava no Telegram. Podia responder ao bot a partir do telemóvel e a minha mensagem seguia para o Claude com todo o contexto de email e calendário. Podia perguntar-lhe desde o WhatsApp "tenho algo às cinco?" e respondia corretamente. Era, para sermos honestos, o produto mais útil da temporada para a produtividade diária.

Mas a 4 de abril tudo mudou.

A 4 de abril de 2026: o que mudou exatamente

Nesse dia, a Anthropic anunciou que os tokens OAuth de Claude Max e Claude Pro deixariam de funcionar com "harnesses de terceiros" — um termo que na indústria inclui OpenClaw, Crush, Aider, e outros clientes que até então se ligavam ao Claude usando as credenciais de subscrição do utilizador. A cobertura mediática foi imediata: TechCrunch, VentureBeat, The Register e Hacker News cobriram a notícia, com threads muito ativas de utilizadores a reportar subidas de custo significativas após a mudança.

A explicação oficial da Anthropic citou "a pressão sobre os nossos recursos de computação e engenharia, e o desejo de servir de forma fiável um número amplo de utilizadores". A leitura técnica e económica é mais interessante.

Uma subscrição Claude Max x20, tecnicamente, é um contrato com limites elásticos: a Anthropic cobra-te uma tarifa fixa e dá-te um limite generoso de uso que a maioria dos clientes não consome por completo. Esse modelo funciona quando as sessões são lançadas por um humano em frente ao teclado: os usos são intermitentes, as pausas são frequentes, e o consumo real fica muito abaixo do teto. Quando metes um agente autónomo multi-canal entre o humano e o modelo — como faz o OpenClaw — o consumo dispara de forma muito previsível: cada mensagem recebida desencadeia uma chamada, cada resposta desencadeia outra, e 24 horas por dia há tráfego mesmo quando o humano dorme.

Multiplicado pela base instalada estimada do OpenClaw à escala mundial, o custo de compute para a Anthropic era insustentável dentro do preço de subscrição. A solução do fornecedor foi separar os dois mundos: Claude.ai, Claude Code e Claude Cowork continuam cobertos por Max/Pro, mas tudo o que vai por harnesses de terceiros agora é faturado através de "Extra Usage" ao preço de API.

Para um utilizador como nós, que processava entre 300 e 500 interações diárias com o PA (briefings, emails, triagens, respostas a partir do telemóvel), a nova fatura projetada com Extra Usage passava de "incluído nos 200 dólares do Max" para cerca de 800-1.200 dólares mensais adicionais. Não era suportável. Também não era justificável, dado que o mesmo trabalho continuava a caber à vontade dentro do plano Max se o executássemos diretamente a partir do Claude Code.

A pergunta então foi: como fazer com que um assistente pessoal multi-canal corra dentro do Claude Code?

Claude Code vs OpenAI Codex como motor para o teu assistente pessoal

A primeira tentação foi passar o OpenClaw para outro fornecedor. O próprio OpenClaw suporta OAuth contra ChatGPT e Codex, e o Peter Steinberger — criador do projeto — tinha anunciado em fevereiro que se incorporava na OpenAI. Passar o assistente a correr sobre uma subscrição ChatGPT Pro ou um plano Codex era tecnicamente uma questão de mudar o authentication profile.

Descartámos essa rota por três razões.

A primeira, qualidade do modelo para as tarefas que nos importam. À data de hoje, em triagem de email, resumo de threads Slack, e extração de informação de calendário, os modelos da Anthropic (especialmente o Opus 4.7) davam-nos consistentemente melhores resultados que o GPT-5 no mesmo prompt. Não é uma opinião genérica — avaliámo-lo durante o mês de março fazendo correr os mesmos briefings por ambos os fornecedores e comparando as saídas qualitativamente, sem metodologia formal publicável mas com critérios consistentes aplicados pelo mesmo revisor. A conclusão para o nosso caso de uso (gestão de email em castelhano e catalão, com vocabulário técnico de agência) foi clara a favor da Anthropic. A tua quilometragem pode variar — recomendamos fazer a tua própria avaliação com os teus próprios prompts antes de escolher fornecedor.

A segunda, lock-in com um fornecedor que acabou de demonstrar mudanças unilaterais de política. Se a Anthropic podia fechar o OAuth a terceiros com quinze dias de pré-aviso, qualquer outro fornecedor podia fazer o mesmo. A lição não era "muda de fornecedor", a lição era "não prendas a tua infraestrutura crítica diária a decisões alheias sobre modelos de faturação". Mudar o OpenClaw para a OpenAI era tratar o sintoma sem tratar a causa.

A terceira, e a mais importante: o Claude Code já estava no stack. Usávamo-lo todos os dias para programar com IA em agência. Tinha MCP servers conectados. Sabia ler as nossas bases de dados, executar scripts, fazer deploy em produção. Se, em vez de tratar o assistente pessoal como um projeto separado, o tratássemos como um "uso mais" do Claude Code — com o seu próprio CLAUDE.md, os seus próprios MCPs, os seus próprios comandos — podíamos reaproveitar absolutamente toda a infraestrutura. E o mais importante: esse uso continuava coberto pela subscrição Max x20 porque o Claude Code é produto first-party da Anthropic, não um terceiro.

A decisão tomou-se numa tarde. O nome do projeto: PA, direto e literal.

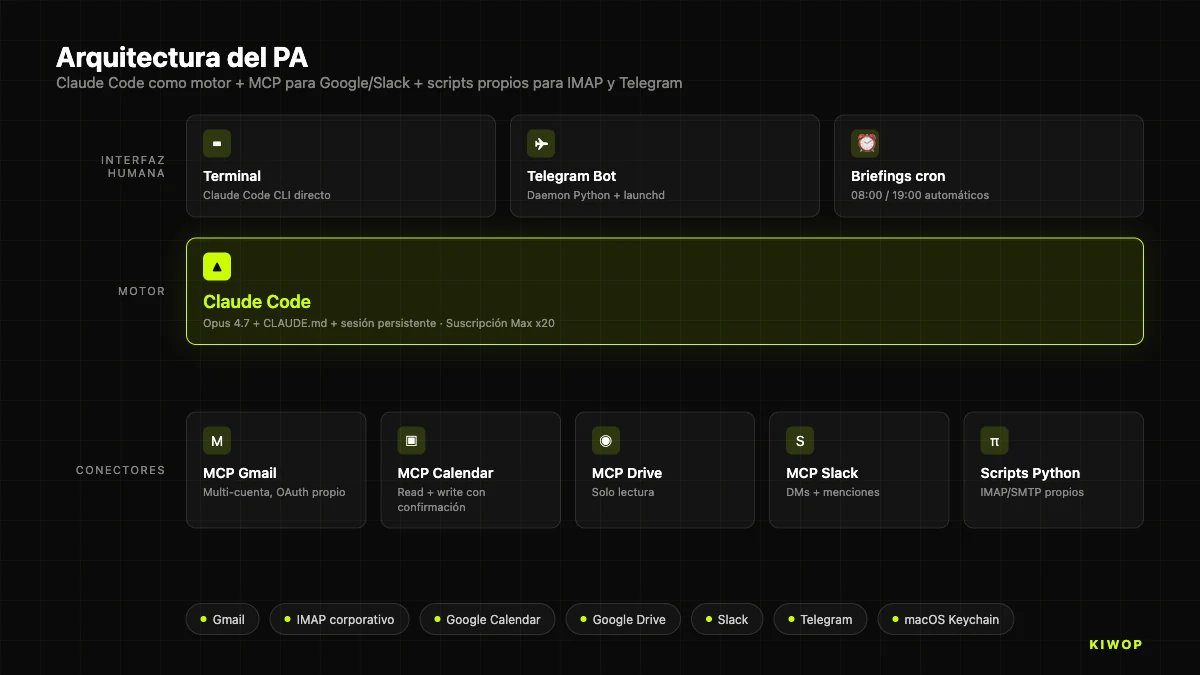

Arquitetura do assistente pessoal com Claude Code e MCP servers

O PA corre num diretório próprio (~/Dev/PA) com uma estrutura simples mas deliberada. Não é uma aplicação fechada: é um conjunto de scripts Python, configurações de Claude Code e um bot de Telegram que conversam entre si através do sistema operativo. A filosofia é a oposta à do OpenClaw, que integra tudo dentro de um Gateway monolítico. Em PA, cada peça faz uma coisa e a cola é Unix.

A base: Claude Code como motor conversacional

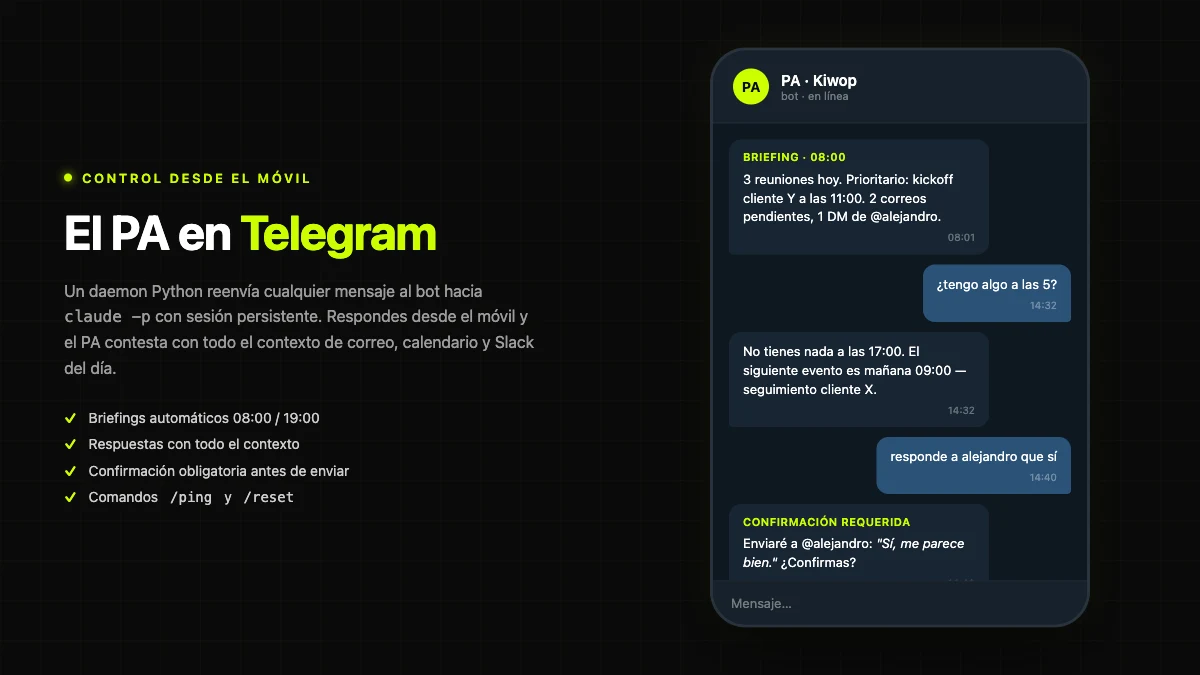

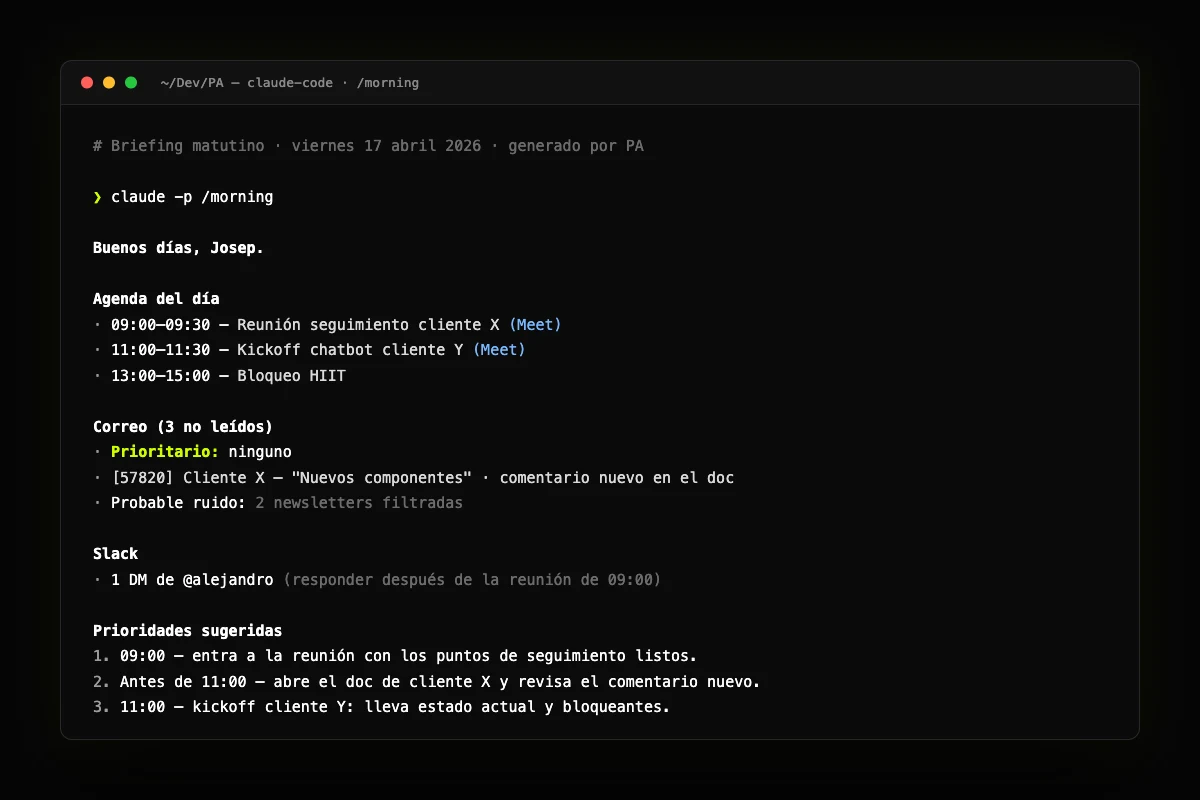

O Claude Code é o cérebro. Não um chatbot, não uma API, mas o CLI completo da Anthropic a correr em modo "projeto" com um diretório dedicado e o seu próprio ficheiro CLAUDE.md que define persona, idioma por defeito (catalão no nosso caso), e regra de confirmação obrigatória antes de enviar emails ou criar eventos. Essa regra é inegociável: o PA nunca toca em nada sem perguntar primeiro.

Sempre que interagimos com o PA, seja por terminal, por comando programado, ou pelo bot de Telegram, o que acontece por dentro é uma sessão de claude -p com contexto persistente. Isso significa que a memória do assistente não vive num armazém externo caprichoso: vive no próprio fluxo de sessão do Claude Code, com as mesmas garantias de cache e reinjeção que usamos quando desenvolvemos.

Os conectores: MCP para tudo o que é externo

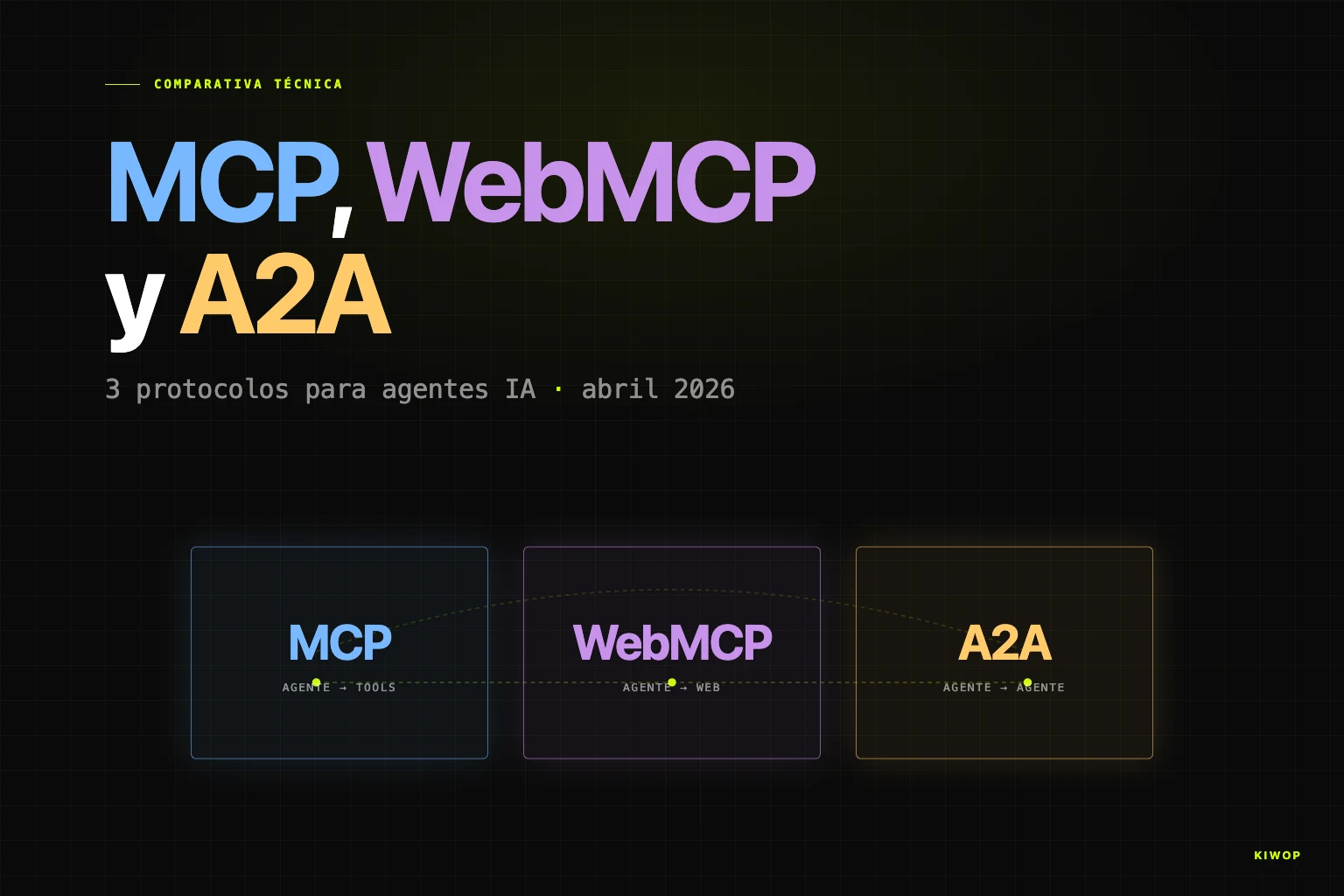

Para aceder ao mundo exterior, o PA usa MCP — Model Context Protocol — o padrão aberto que a Anthropic publicou em 2024 e que se tornou a linguagem comum dos agentes IA em 2026. Se quiseres perceber o que é o MCP e porque importa tanto, o artigo WebMCP: o teu site preparado para agentes IA entra no detalhe técnico. O MCP é a peça que permite que o Claude Code se ligue a sistemas empresariais via integração de LLMs sem reescrever conectores à medida para cada serviço.

No caso do PA, os conectores MCP ativos são:

- Gmail MCP: ler, redigir, enviar emails a partir dos múltiplos endereços de uma mesma pessoa (a conta profissional de agência, a conta pessoal, a conta de um projeto paralelo). Leitura sempre; escrita apenas com confirmação.

- Google Calendar MCP: consultar agenda, criar e mover eventos. Também com confirmação.

- Google Drive MCP: pesquisa e leitura de documentos a pedido. Apenas leitura.

- Slack MCP: ler DMs e menções, responder com confirmação.

Todos estes conectores são de terceiros, mantidos ativamente, e autenticam-se por OAuth próprio de cada serviço. Em nenhum caso passamos as credenciais ao PA diretamente — são os servidores MCP que gerem a autenticação, e nós apenas autorizamos o acesso a partir do browser uma única vez no setup.

Os pontos cegos do MCP: email IMAP e Telegram

O MCP cobre a superfície Google + Slack, mas deixa dois buracos importantes para um assistente que pretende ser "pessoal": o email corporativo sobre IMAP (o servidor de email próprio de uma empresa, não Gmail), e as mensagens de Telegram. Para estes dois buracos escrevemos scripts Python próprios que atuam como ponte entre o mundo exterior e o Claude Code.

O cliente IMAP é um conjunto de pequenos scripts: mail_fetch.py, mail_read.py, mail_send.py, mail_flag.py. Cada um faz uma coisa. Autenticam-se contra a caixa do domínio da empresa lendo as credenciais a partir do Keychain do macOS (nunca a partir de ficheiros em disco ou variáveis de ambiente persistentes). Quando o Claude Code precisa de ler o email corporativo, invoca estes scripts como ferramentas a partir da sessão, do mesmo modo que invocaria um MCP.

O bot de Telegram é o componente mais interessante do PA. É um daemon Python gerido por launchd (o equivalente macOS do systemd) que arranca ao iniciar sessão e reinicia-se sozinho se falhar. Quando chega uma mensagem ao bot a partir do telemóvel, o daemon passa-a ao claude -p com sessão persistente, espera pela resposta, e formata-a como Markdown compatível com Telegram antes de a devolver. O resultado é que podes falar com o PA a partir do telemóvel como se fosse qualquer chatbot, mas por baixo a resposta é gerada pelo Claude com todo o contexto do teu email e calendário do dia.

Os briefings programados: cron + launchd

Dois briefings programados fecham o sistema: um às 08:00 ("morning") e outro às 19:00 ("evening"). Disparam via cron, que executa o script run_briefing.sh passando-lhe o tipo de briefing. Esse script lança uma sessão de Claude Code com um prompt específico ("lê emails não lidos importantes, consulta calendário do dia, resume prioridades") e guarda a saída em briefings/YYYY-MM-DD-morning.md. Se o bot Telegram estiver ativo, o mesmo script empurra o briefing para o chat para que aterre no telemóvel antes de começar o dia.

Estrutura do repo

Toda esta máquina vive em cerca de 20 ficheiros Python mais um punhado de shell scripts. Nenhuma base de dados, nenhum backend, nenhum Docker. O código-fonte completo do PA é mais pequeno do que um componente React típico. Isto é deliberado: quanto menos código, menos manutenção; e quanto menos abstração, mais fácil é depurar quando algo se parte. Esta decisão é consistente com o que recomendamos aos nossos clientes em LLMOps: gerir modelos de linguagem em produção — a complexidade operacional mata agentes mais do que a complexidade do modelo.

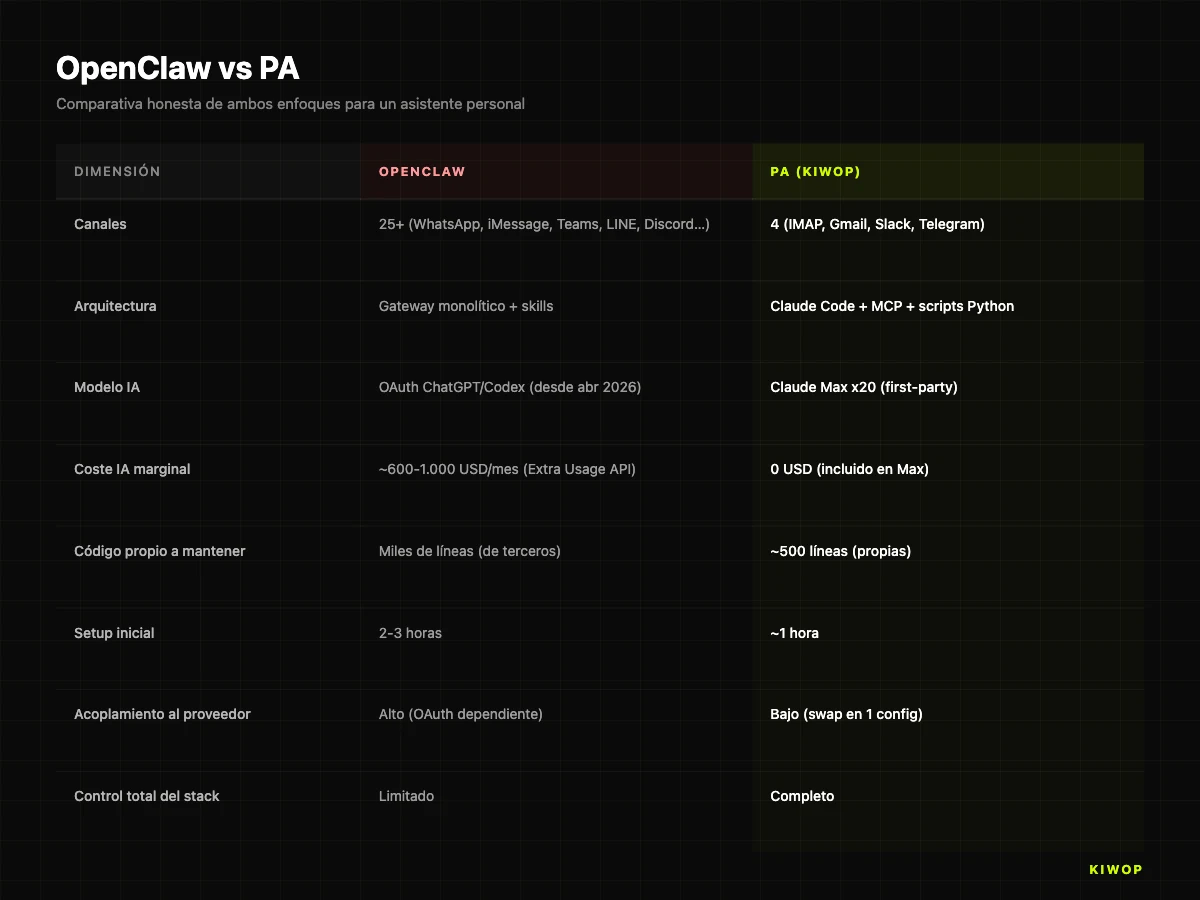

OpenClaw vs PA: a comparação honesta

Não é uma competição. O OpenClaw continua a ser um produto mais completo, com mais canais, com uma comunidade ativa e com uma rota de produto clara. Se alguém nos pergunta em 2026 "quero um assistente pessoal com WeChat, LINE, iMessage e Discord em simultâneo", a resposta honesta é "vê o OpenClaw". Para o caso "quero WhatsApp + Telegram + email + calendário + Slack, a correr sobre o meu Claude Max, com código que possa auditar e modificar", a resposta é PA.

A escolha entre um e outro é fundamentalmente uma escolha sobre quanto acoplamento queres com um fornecedor externo. O OpenClaw dá-te mais capacidades out-of-the-box em troca de depender das políticas OAuth da Anthropic ou da OpenAI. O PA dá-te menos capacidades mas com a certeza de que enquanto puderes pagar Claude Max e o serviço Gmail continuar a oferecer MCP, nada externo te pode deixar sem assistente de um dia para o outro.

Construímos o teu? Desenhamos e desenvolvemos assistentes pessoais IA à medida para profissionais e diretivos. → Desenvolvimento de agentes IA

Alternativa ao OpenClaw em 2026: quando faz sentido construir o teu próprio PA

Perguntam-nos já com alguma frequência se construiríamos PAs à medida para clientes. A resposta curta é que sim, e estamos a começar a oferecê-lo como parte dos serviços de desenvolvimento de agentes IA. A resposta longa requer matizar para quem faz sentido construir um PA e para quem é um exagero.

Quando construir um PA faz sentido:

- Para um profissional que já processa manualmente mais de 80 emails por dia distribuídos em várias contas, e que dedica 30-45 minutos diários a triagem.

- Para alguém que já usa Claude Code em desenvolvimento e tem uma subscrição Max, de modo que o custo marginal do assistente é efetivamente zero.

- Para funções que exigem disponibilidade 24/7 (fundadores, diretivos, advogados autónomos, consultores sénior) mas que não podem justificar contratar um humano PA por custo ou discricionariedade.

- Para quem quer controlo total sobre os dados: o PA não envia emails nem calendário a servidores de terceiros para além dos próprios do LLM.

Quando NÃO faz sentido:

- Para um empregado que já trabalha dentro do Gmail/Outlook e cuja empresa não autorizaria ligar um LLM externo à conta corporativa. A barreira aqui é política e de segurança, não técnica — embora nesse cenário um projeto de RAG empresarial sobre infraestrutura controlada possa ser a resposta correta.

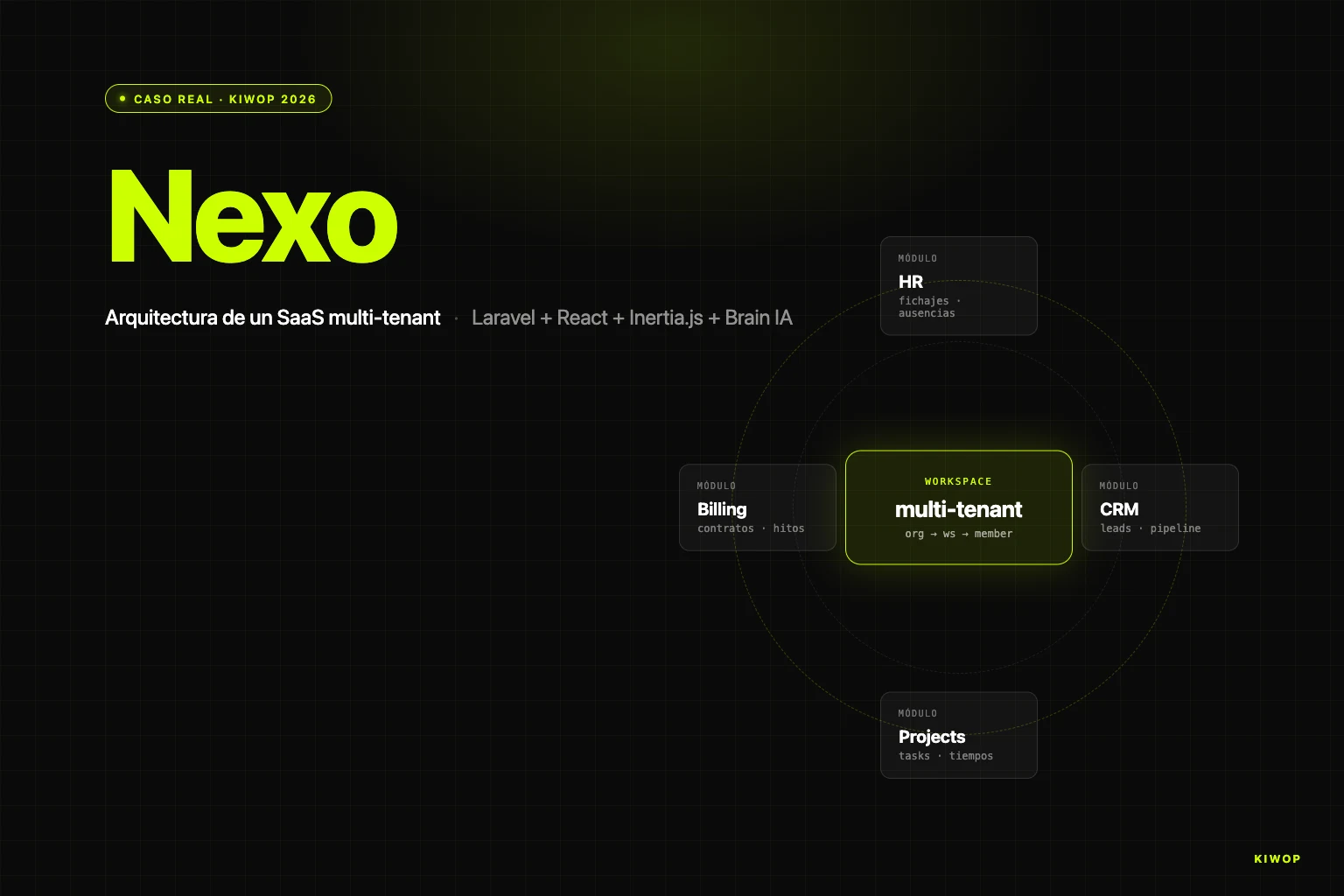

- Para agências que querem "um PA que faça a gestão de todos os clientes" — isso não é um PA, é um SaaS multi-tenant e o planeamento arquitetónico tem de ser radicalmente diferente.

- Para quem ainda não tem uma subscrição Claude Max ou equivalente: o cálculo económico muda muito se for preciso pagar API pay-as-you-go.

- Para quem espera um assistente infalível. O PA no seu estado atual pode ocasionalmente perder um email na triagem, ou interpretar mal um evento de calendário. A regra de confirmação antes de atuar é precisamente para nos cobrir perante essas falhas.

A lição mais ampla, para além de se construíres ou não o teu PA, é outra: os agentes IA dependem economicamente do modelo de faturação do fornecedor, e esse modelo pode mudar. A Anthropic mudou-o a 4 de abril. A OpenAI mudou o seu em várias ocasiões desde o lançamento do ChatGPT Pro. A Google ajusta o seu regularmente. Qualquer arquitetura de agente que queiras usar durante anos deve prever esse risco, e a resposta não é técnica — é estratégica. Construir camadas finas e desacopladas entre a tua lógica e o modelo do fornecedor é o que te permite pivotar em 48 horas quando a política muda.

Na Kiwop chamamos-lhe "agentes à prova de fornecedor". Não é uma metodologia com nome comercial: é uma forma de desenhar que se resume em três regras. Primeiro, a cola entre peças é código próprio, nunca um framework de terceiros. Segundo, os prompts e os fluxos estão nos teus ficheiros, não num SaaS. Terceiro, podes mudar o modelo com um único ficheiro de configuração, sem tocar no resto do sistema. O PA cumpre as três. Se amanhã a Anthropic fechasse outra porta, a ponte para a OpenAI ou para a Google custar-nos-ia uns poucos commits e uma hora de testing, porque toda a engenharia à volta (MCPs, scripts IMAP, bot Telegram, launchd) é agnóstica ao modelo.

Perguntas frequentes

Qual é a melhor alternativa ao OpenClaw em 2026?

A melhor alternativa depende do caso de uso. Para quem já tem subscrição Claude Max, a opção mais económica é construir um assistente pessoal próprio sobre Claude Code + MCP (custo marginal zero). Para quem prefere um produto pronto, o OpenClaw continua a ser válido pagando "Extra Usage" da Anthropic ou mudando o OAuth para ChatGPT/Codex. Para ambientes corporativos regulados, recomendamos avaliar soluções on-premise ou um projeto RAG empresarial sobre infraestrutura controlada.

Posso continuar a usar o OpenClaw com a minha subscrição Claude Pro ou Max?

Não. Desde 4 de abril de 2026, os tokens OAuth de Claude Pro e Claude Max deixaram de funcionar com o OpenClaw e com outros harnesses de terceiros. O OpenClaw continua a funcionar, mas tens de pagar o uso à parte através de Extra Usage da Anthropic (tarifas de API) ou através da subscrição OAuth da OpenAI (ChatGPT/Codex). Para os clientes que processavam um volume alto, o salto de custo reportado pela comunidade tem sido significativo.

O que é MCP (Model Context Protocol)?

MCP é o padrão aberto que a Anthropic publicou no final de 2024 para que os modelos de linguagem se liguem a ferramentas, bases de dados e APIs externas de forma uniforme. Em 2026 está suportado pelos principais clientes de IA — incluindo Claude Code, Cursor, Windsurf e outros — e a lista de servidores MCP disponíveis (Gmail, Calendar, Drive, Slack, Linear, GitHub, Notion, etc.) cresce semana a semana. O PA usa MCP como a via principal de acesso a Gmail, Google Calendar, Google Drive e Slack.

Quanto custa construir um PA próprio?

Se já tens subscrição Claude Max x20 (cerca de 200 USD/mês), o custo marginal é zero do ponto de vista do modelo IA. O tempo de construção, se o fizeres sozinho partindo do zero, ronda as 20-30 horas distribuídas numa semana. Se subcontratares a uma agência, depende do âmbito (que canais, que integrações MCP, se requer voz ou não), mas para o âmbito padrão do PA descrito neste artigo estimamos entre 4.000 e 7.000 euros de construção e uma manutenção posterior muito baixa.

Porquê Claude Code e não OpenAI Codex?

O Claude Code encaixa melhor no modelo de assistente pessoal por duas razões muito concretas. Primeira, a qualidade do Opus 4.7 em tarefas de triagem de email e gestão de calendário era superior à do GPT-5 nos nossos testes internos a março de 2026 (avaliação qualitativa, não metodologia formal publicável). Segunda, o Claude Code é produto first-party da Anthropic e continua coberto pela subscrição Max, enquanto usar Codex de dentro do nosso stack já montado teria significado pagar dupla subscrição (Max para desenvolvimento, ChatGPT Pro para PA) sem ganho funcional claro.

O PA é seguro para emails confidenciais?

O PA é tão seguro quanto o fornecedor do modelo ao qual te ligas. No caso da Anthropic, os emails processados não são usados para treinar modelos (política pública da Anthropic a 2026) e a comunicação é cifrada. Dito isto, qualquer PA que passe conteúdo sensível por um LLM externo implica um ato de confiança nesse fornecedor. Para conteúdo regulado (sanitário, legal, financeiro com segredo profissional), recomendamos rever os termos específicos e considerar alternativas on-premise.

Pode integrar-se WhatsApp?

À data de hoje, o WhatsApp não dispõe de um MCP oficial e os bridges não oficiais (como os que o OpenClaw integra) requerem manter uma conta de WhatsApp Business API ou técnicas menos estáveis. O PA na sua versão atual não integra WhatsApp nativamente — usamos Telegram como canal móvel primário por estabilidade. Estamos a avaliar o MCP de WhatsApp Cloud API da Meta para uma segunda iteração.

O PA pode atuar sem supervisão humana?

Por desenho, não. A regra de confirmação obrigatória antes de qualquer ação de escrita (enviar email, criar evento, responder Slack) é o núcleo de segurança do assistente. Ver um email, ler calendário, pesquisar no Drive — tudo isso são operações de leitura e fá-las sem confirmar. Mas enviar, criar, mover, apagar — requerem sempre um "sim" explícito do humano. É uma decisão arquitetónica consciente: preferimos um PA um pouco menos ágil mas que não comete erros irreversíveis.

Esta arquitetura funciona em Windows ou Linux?

Sim, com ajustes. Os conceitos (Claude Code + MCP + scripts Python + daemon Telegram) são portáveis. O que muda é o gestor de processos no arranque: no macOS usamos launchd, em Linux seria systemd com unidades user, e em Windows o Task Scheduler. O Keychain para credenciais de IMAP também tem equivalentes noutras plataformas (Secret Service em Linux, Credential Manager em Windows).

Conclusão: os agentes IA e o risco de fornecedor

A mudança de política da Anthropic a 4 de abril de 2026 fez-nos um favor. Obrigou-nos a equacionar se queríamos continuar a externalizar uma peça crítica da nossa produtividade diária para um projeto de terceiros, por brilhante que fosse, quando tínhamos todas as peças para a construir nós mesmos sobre um stack que já dominávamos. A resposta, com duas semanas de perspetiva, é clara: não queríamos. E não queremos, para nenhuma camada crítica do nosso trabalho.

A lição não é "todos deveriam construir o seu PA". A lição é que em 2026, com modelos de IA cada vez mais capazes e com MCP a consolidar-se como o padrão de integração, a distância entre usar um agente de terceiros e construir o teu próprio reduziu-se drasticamente. O que em 2023 teria requerido uma equipa de três engenheiros durante três meses são hoje cerca de 500 linhas de Python e uma tarde de setup. Essa barreira derrubada é a que define a onda atual da IA aplicada — e a que melhor explica porque as agências de software em 2026 estão numa posição tão diferente da de há dois anos.

Se estás a pensar em montar o teu próprio assistente pessoal, ou se precisas de ajuda a construir agentes IA robustos para a tua equipa ou empresa, na Kiwop — Agência Digital especializada em Desenvolvimento de Software e Inteligência Artificial aplicada para clientes globais na Europa e EUA — oferecemos desenvolvimento à medida de agentes IA e consultoria de inteligência artificial para contextos de produção. O PA que descrevemos aqui é o melhor exemplo vivo de como o fazemos para nós mesmos.