Por el equipo de Kiwop · Agencia Digital especializada en Desarrollo de Software e Inteligencia Artificial aplicada · Publicado el 19 de abril de 2026 · Última actualización: 19 de abril de 2026

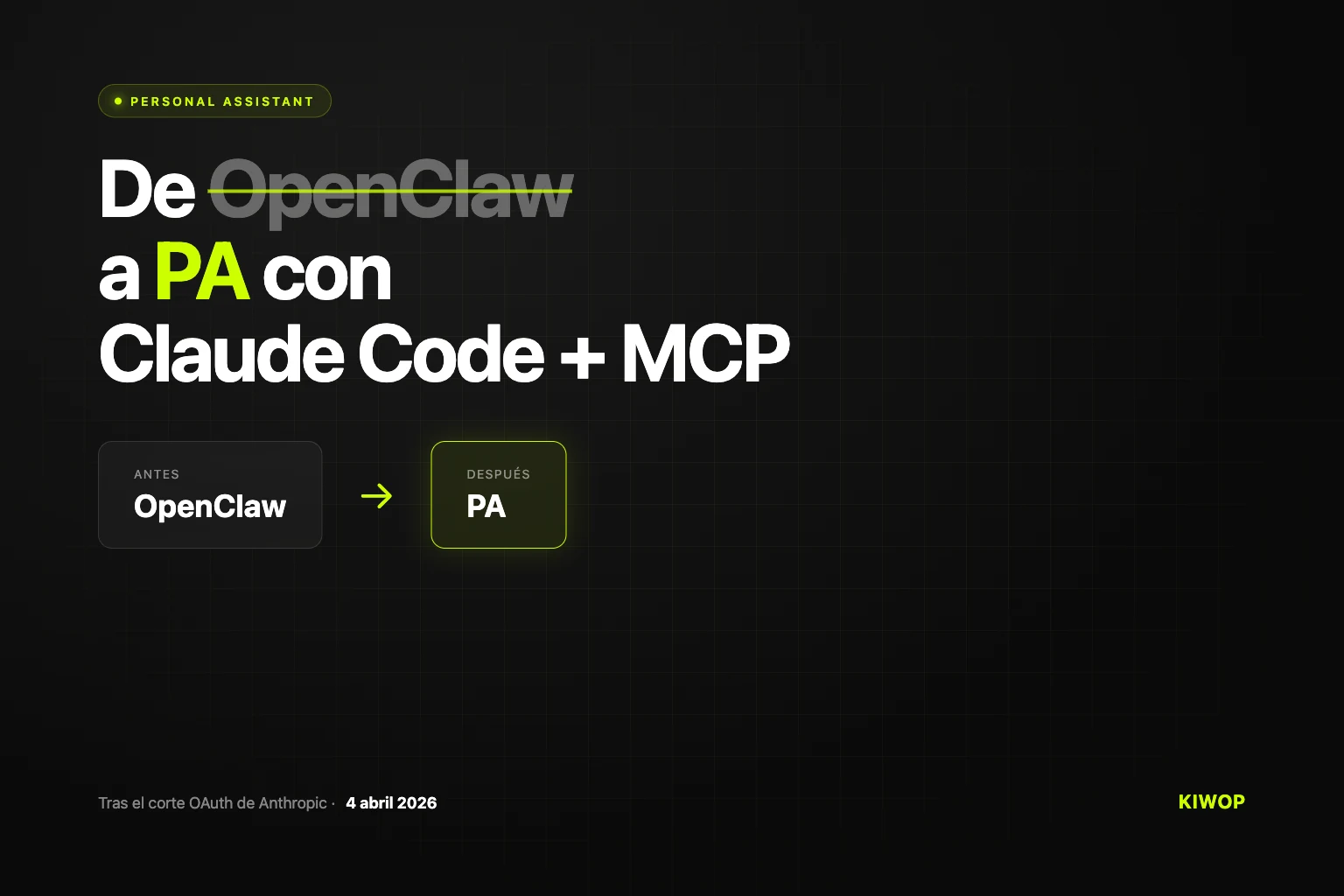

TL;DR — El 4 de abril de 2026 Anthropic desactivó los tokens OAuth que permitían a OpenClaw usar las suscripciones Claude Max y Claude Pro. Los usuarios afectados tienen tres opciones: pagar "Extra Usage" a precio de API (entre 5 y 50 veces más caro), migrar a OpenAI Codex, o reconstruir el asistente personal sobre Claude Code + MCP. En Kiwop elegimos la tercera vía y documentamos aquí la arquitectura resultante — un PA con cuatro canales (IMAP, Gmail, Slack, Telegram), unas 500 líneas de Python propias, y coste marginal cero al seguir dentro de la suscripción Max.

En Kiwop tardamos 48 horas en decidir qué hacer tras el anuncio de Anthropic. Este artículo cuenta esa decisión — por qué no pasamos a OpenAI Codex, por qué no pagamos la "Extra Usage" de Anthropic, y cómo reconstruimos nuestro asistente personal (PA) sobre Claude Code y Model Context Protocol (MCP). Un asistente que sigue corriendo sobre la misma suscripción Claude Max x20, con los mismos canales que usábamos antes, pero con una diferencia fundamental: el stack es nuestro, el código es nuestro y el proveedor no puede tirar de la alfombra.

No es un manifiesto anti-Anthropic — seguimos usando sus modelos a diario y creemos que son los mejores del mercado para agencia en 2026. Es una lectura analítica de qué pasa cuando el modelo económico de un agente dependía de una política de un proveedor, esa política cambia, y hay que decidir si adaptarse o reconstruir.

Qué es un PA y por qué la palabra "Personal" importa

Un Personal Assistant (PA) es un asistente IA que atiende a una sola persona centralizando sus correos, calendario, mensajes y documentos en una interfaz conversacional. A diferencia de un SaaS multi-tenant, un PA corre dedicado a un único humano con acceso exclusivo a sus cuentas. Esa definición, aparentemente evidente, es la que separa un PA bien diseñado de una herramienta comercial disfrazada.

La distinción no es pedante. Un humano en 2026 puede tener tres o cuatro direcciones de correo (la del trabajo, la de un proyecto paralelo, la personal), dos o tres números de WhatsApp, cuentas de Slack en distintos workspaces, y media docena de calendarios sincronizados. Un PA centraliza toda esa superficie y la convierte en una única interfaz conversacional que entiende quién eres y qué te importa. No porque esté entrenado para ti, sino porque corre para ti y solo para ti, con acceso a tus cuentas, tus hilos, tus preferencias.

Esa es la promesa de un PA, y es la que nos hizo adoptar OpenClaw en enero. Y es también la que nos hizo decidir, en abril, reconstruirlo nosotros mismos cuando la economía del proveedor cambió.

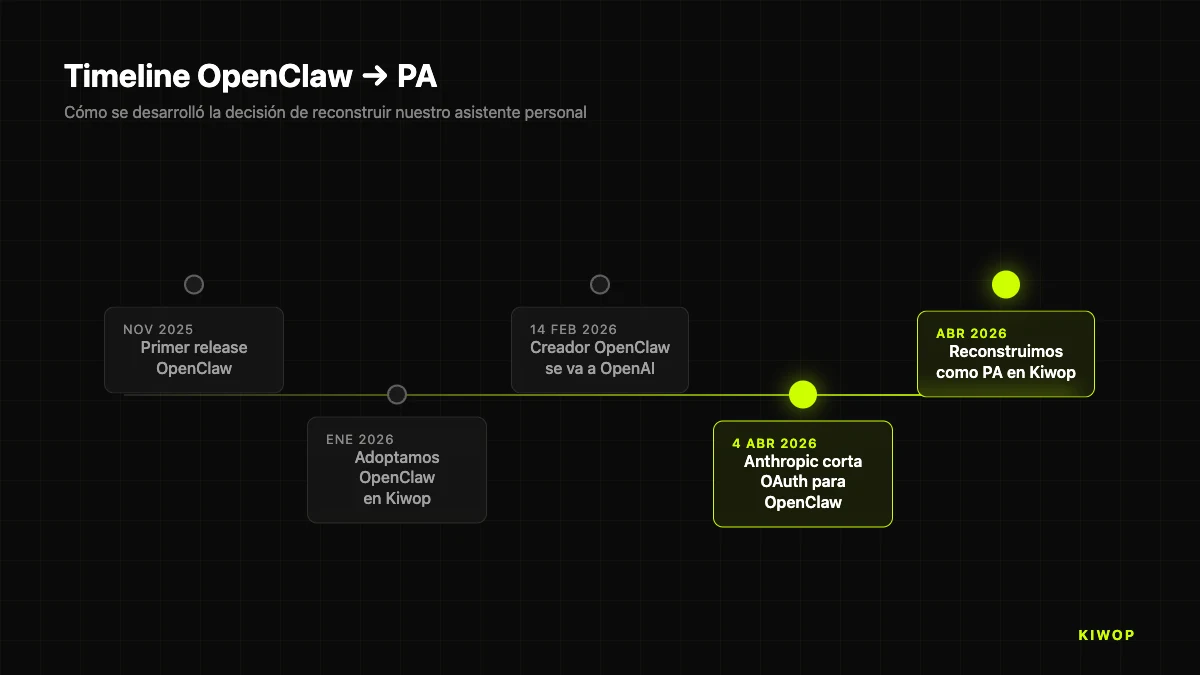

Por qué elegimos OpenClaw como asistente personal IA en enero de 2026

OpenClaw es un asistente personal IA open source lanzado a finales de 2025 que se conecta a canales como WhatsApp, Telegram, Slack y más de veinte plataformas de mensajería usando un Gateway central y un sistema de skills extensibles. El proyecto corre en tu propia máquina (local, VPS, o fly.io) y, hasta abril de 2026, soportaba OAuth contra la suscripción Claude Max — eso significaba que todas las interacciones se contabilizaban contra el plan Max x20 que ya pagábamos. La lista de canales soportados incluye Discord, Google Chat, Signal, iMessage, Teams, Matrix, Feishu, LINE, Mattermost, Nextcloud Talk, Nostr, Synology Chat, Tlon, Twitch, Zalo, WeChat y WebChat, entre otros.

El cálculo económico a finales de enero era simple. Teníamos una suscripción Claude Max x20 (unos 200 dólares al mes) que ya usábamos intensamente para Claude Code en desarrollo. Añadirle un asistente personal que procesara correos, leyera Slack, respondiera mensajes de Telegram, y hiciera briefings matutinos no iba a generar coste adicional relevante, porque los límites de la suscripción daban de sobra. Por 200 dólares al mes teníamos un desarrollador IA senior durante el día y un asistente personal durante la mañana y la tarde.

OpenClaw cumplió durante enero, febrero y marzo. Cada mañana a las ocho, un briefing con mi agenda y correos prioritarios aterrizaba en Telegram. Podía responder al bot desde el móvil y mi mensaje iba contra Claude con todo el contexto de correo y calendario. Podía preguntarle desde WhatsApp "¿tengo algo a las cinco?" y respondía correctamente. Era, para ser honestos, el producto más útil de la temporada para la productividad diaria.

Pero el 4 de abril todo cambió.

El 4 de abril de 2026: qué cambió exactamente

Ese día, Anthropic anunció que los tokens OAuth de Claude Max y Claude Pro dejarían de funcionar con "terceros harnesses" — un término que en la industria incluye OpenClaw, Crush, Aider, y otros clientes que hasta entonces se conectaban a Claude usando las credenciales de suscripción del usuario. La cobertura mediática fue inmediata: TechCrunch, VentureBeat, The Register y Hacker News cubrieron la noticia, con hilos muy activos de usuarios reportando subidas de coste significativas tras el cambio.

La explicación oficial de Anthropic citó "la presión sobre nuestros recursos de cómputo e ingeniería, y el deseo de servir fiablemente a un número amplio de usuarios". La lectura técnica y económica es más interesante.

Una suscripción Claude Max x20, técnicamente, es un contrato con límites elásticos: Anthropic te cobra una tarifa plana y te da un límite generoso de uso que la mayoría de clientes no consume al completo. Ese modelo funciona cuando las sesiones las lanza un humano delante del teclado: los usos son intermitentes, las pausas son frecuentes, y el consumo real queda muy por debajo del techo. Cuando metes un agente autónomo multi-canal entre el humano y el modelo — como hace OpenClaw — el consumo se dispara de forma muy predecible: cada mensaje entrante dispara una llamada, cada respuesta dispara otra, y 24 horas al día hay tráfico incluso cuando el humano duerme.

Multiplicado por la base instalada estimada de OpenClaw a escala mundial, el coste compute para Anthropic era insostenible dentro del precio de suscripción. La solución del proveedor fue separar ambos mundos: Claude.ai, Claude Code y Claude Cowork siguen cubiertos por Max/Pro, pero todo lo que va por terceros harnesses ahora se factura a través de "Extra Usage" al precio de API.

Para un usuario como nosotros, que procesaba entre 300 y 500 interacciones diarias con el PA (briefings, correos, triajes, respuestas desde móvil), la nueva factura proyectada con Extra Usage pasaba de "incluido en los 200 dólares del Max" a unos 800-1.200 dólares mensuales adicionales. No era asumible. Tampoco era justificable, dado que el mismo trabajo seguía cabiendo sobrado dentro del plan Max si lo ejecutábamos desde Claude Code directamente.

La pregunta entonces fue: ¿cómo hacer que un asistente personal multi-canal corra dentro de Claude Code?

Claude Code vs OpenAI Codex como motor para tu asistente personal

La primera tentación fue pasar OpenClaw a otro proveedor. El propio OpenClaw soporta OAuth contra ChatGPT y Codex, y Peter Steinberger — creador del proyecto — había anunciado en febrero que se incorporaba a OpenAI. Pasar el asistente a correr sobre una suscripción ChatGPT Pro o un plan Codex era técnicamente una cuestión de cambiar el authentication profile.

Descartamos esa ruta por tres razones.

La primera, calidad del modelo para las tareas que nos importan. A día de hoy, en triaje de correo, resumen de hilos Slack, y extracción de información de calendario, los modelos de Anthropic (especialmente Opus 4.7) nos daban consistentemente mejores resultados que GPT-5 en el mismo prompt. No es una opinión genérica — lo evaluamos durante el mes de marzo haciendo correr los mismos briefings por ambos proveedores y comparando las salidas cualitativamente, sin metodología formal publicable pero con criterios consistentes aplicados por el mismo revisor. La conclusión para nuestro caso de uso (gestión de correo en castellano y catalán, con vocabulario técnico de agencia) fue clara a favor de Anthropic. Tu kilometraje puede variar — te recomendamos hacer tu propia evaluación con tus propios prompts antes de elegir proveedor.

La segunda, lock-in con un proveedor que acababa de demostrar cambios unilaterales de política. Si Anthropic podía cerrar el OAuth a terceros con quince días de preaviso, cualquier otro proveedor podía hacer lo mismo. La lección no era "cambia de proveedor", la lección era "no ates tu infraestructura crítica diaria a decisiones ajenas sobre modelos de facturación". Mover OpenClaw a OpenAI era arreglar el síntoma sin tratar la causa.

La tercera, y la más importante: Claude Code ya estaba en el stack. Lo usábamos cada día para programar con IA en agencia. Tenía MCP servers conectados. Sabía leer nuestras bases de datos, ejecutar scripts, desplegar en producción. Si en lugar de tratar al asistente personal como un proyecto separado lo tratábamos como un "uso más" de Claude Code — con su propio CLAUDE.md, sus propios MCPs, sus propios comandos — podíamos reusar absolutamente toda la infraestructura. Y lo más importante: ese uso seguía cubierto por la suscripción Max x20 porque Claude Code es producto first-party de Anthropic, no un tercero.

La decisión se tomó en una tarde. El nombre del proyecto: PA, directo y literal.

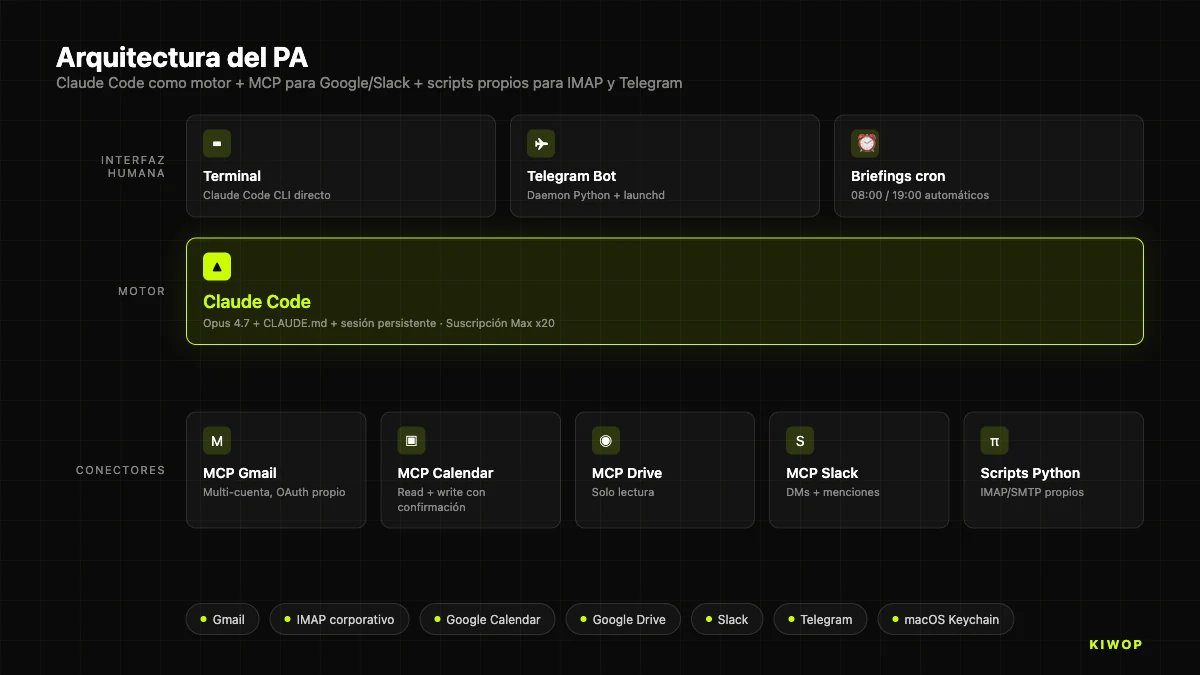

Arquitectura del asistente personal con Claude Code y MCP servers

El PA corre en un directorio propio (~/Dev/PA) con una estructura simple pero deliberada. No es una aplicación cerrada: es un conjunto de scripts Python, configuraciones de Claude Code y un bot de Telegram que conversan entre sí a través del sistema operativo. La filosofía es la opuesta a OpenClaw, que integra todo dentro de un Gateway monolítico. En PA, cada pieza hace una cosa y el pegamento es Unix.

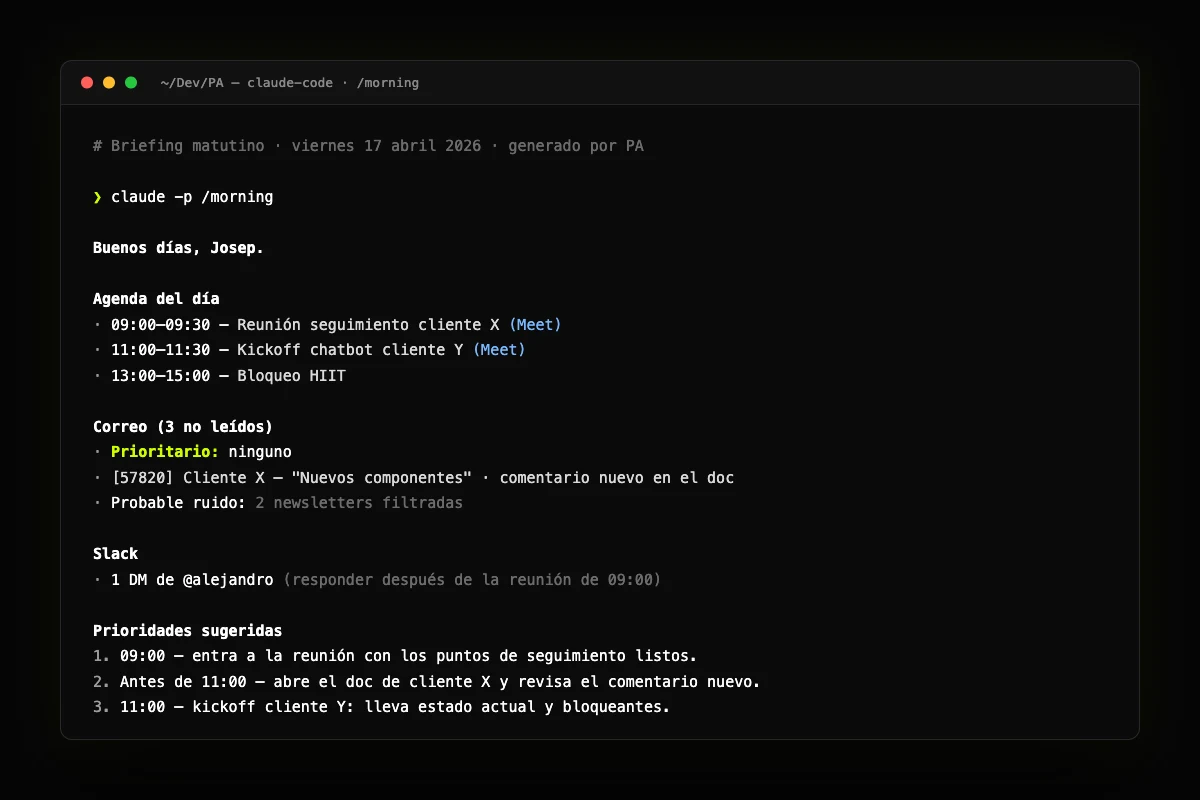

La base: Claude Code como motor conversacional

Claude Code es el cerebro. No un chatbot, no una API, sino el CLI completo de Anthropic corriendo en modo "proyecto" con un directorio dedicado y su propio archivo CLAUDE.md que define persona, idioma por defecto (catalán en nuestro caso), y regla de confirmación obligatoria antes de enviar correos o crear eventos. Esa regla es innegociable: el PA nunca toca nada sin preguntar primero.

Cada vez que interactuamos con el PA, sea por terminal, por comando programado, o por el bot de Telegram, lo que pasa por dentro es una sesión de claude -p con contexto persistente. Eso significa que la memoria del asistente no vive en un almacén externo caprichoso: vive en el propio flujo de sesión de Claude Code, con las mismas garantías de caché y reinyección que usamos cuando desarrollamos.

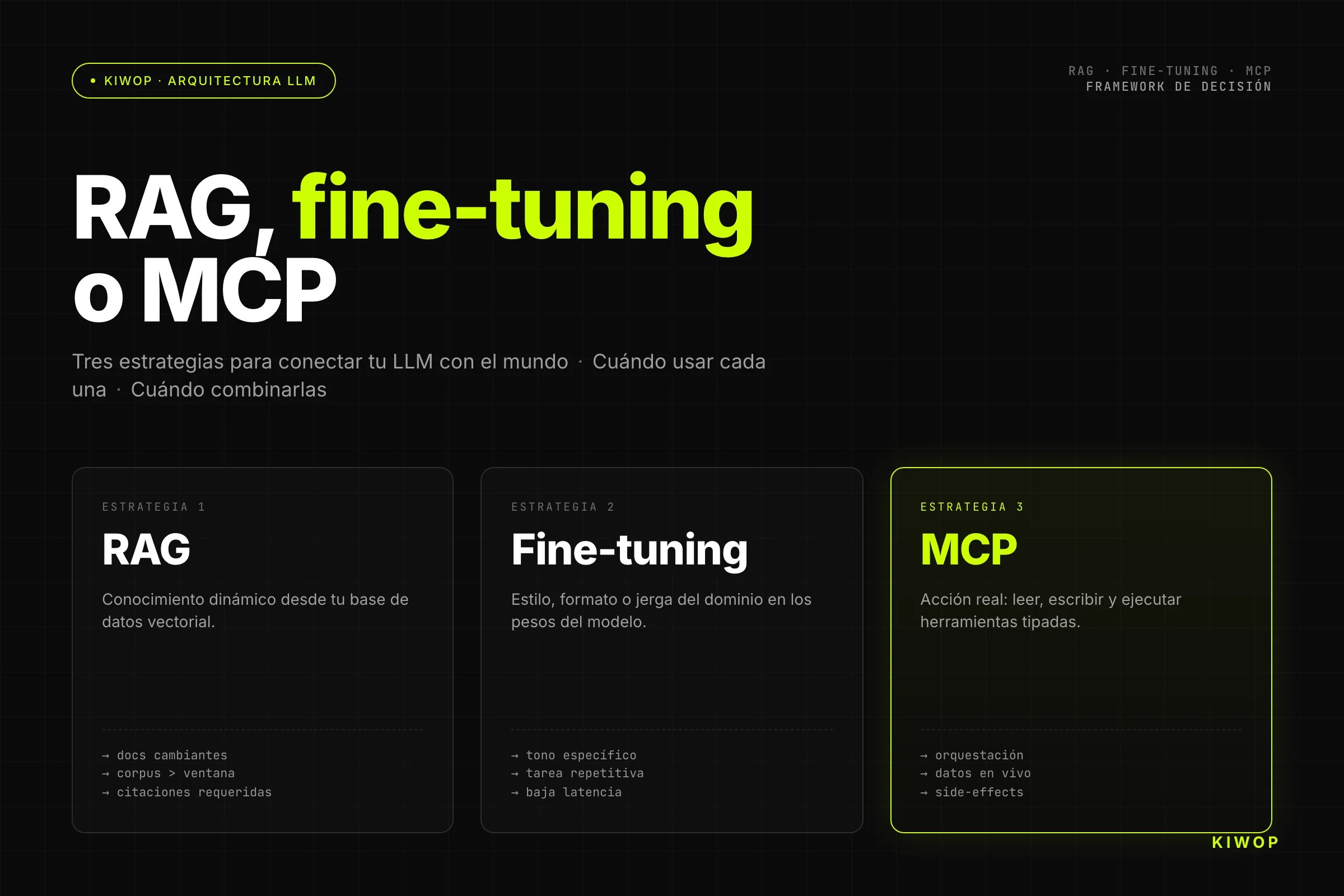

Los conectores: MCP para todo lo externo

Para acceder al mundo exterior, el PA usa MCP — Model Context Protocol — el estándar abierto que Anthropic publicó en 2024 y que se ha convertido en el lenguaje común de los agentes IA en 2026. Si quieres entender qué es MCP y por qué importa tanto, el artículo WebMCP: tu web preparada para agentes IA entra en el detalle técnico. MCP es la pieza que permite que Claude Code se conecte a sistemas empresariales vía integración de LLMs sin reescribir conectores a medida para cada servicio.

En el caso del PA, los conectores MCP activos son:

- Gmail MCP: leer, redactar, enviar correos desde las múltiples direcciones de una misma persona (la cuenta profesional de agencia, la cuenta personal, la cuenta de un proyecto paralelo). Lectura siempre; escritura solo con confirmación.

- Google Calendar MCP: consultar agenda, crear y mover eventos. También con confirmación.

- Google Drive MCP: búsqueda y lectura de documentos bajo demanda. Solo lectura.

- Slack MCP: leer DMs y menciones, responder con confirmación.

Todos estos conectores son de terceros, mantenidos activamente, y se autentican por OAuth propio de cada servicio. En ningún caso pasamos las credenciales al PA directamente — son los servidores MCP quienes gestionan la autenticación, y nosotros solo autorizamos el acceso desde el navegador una sola vez en el setup.

Los puntos ciegos de MCP: correo IMAP y Telegram

MCP cubre la superficie Google + Slack, pero deja dos huecos importantes para un asistente que pretende ser "personal": el correo corporativo sobre IMAP (el servidor de correo propio de una empresa, no Gmail), y los mensajes de Telegram. Para estos dos huecos hemos escrito scripts Python propios que actúan como puente entre el mundo exterior y Claude Code.

El cliente IMAP es un conjunto de pequeños scripts: mail_fetch.py, mail_read.py, mail_send.py, mail_flag.py. Cada uno hace una cosa. Se autentican contra el buzón del dominio de la empresa leyendo las credenciales desde Keychain de macOS (nunca desde archivos en disco o variables de entorno persistentes). Cuando Claude Code necesita leer el correo corporativo, invoca estos scripts como herramientas desde la sesión, del mismo modo que invocaría un MCP.

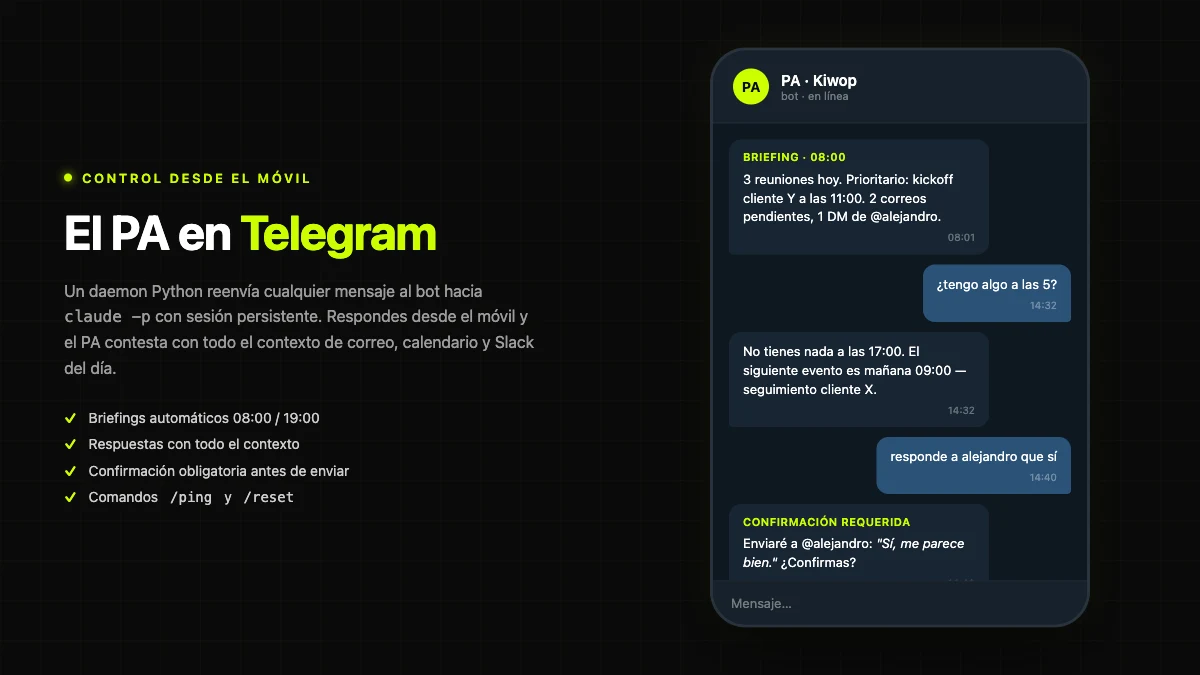

El bot de Telegram es el componente más interesante de PA. Es un daemon Python gestionado por launchd (el equivalente macOS de systemd) que se arranca al iniciar sesión y se reinicia solo si falla. Cuando llega un mensaje al bot desde el móvil, el daemon lo pasa a claude -p con sesión persistente, espera la respuesta, y la formatea como Markdown compatible con Telegram antes de devolverla. El resultado es que puedes hablar con el PA desde el móvil como si fuera cualquier chatbot, pero por debajo la respuesta la genera Claude con todo el contexto de tu correo y calendario del día.

Los briefings programados: cron + launchd

Dos briefings programados cierran el sistema: uno a las 08:00 ("morning") y otro a las 19:00 ("evening"). Los dispara cron, que ejecuta el script run_briefing.sh pasándole el tipo de briefing. Ese script lanza una sesión de Claude Code con un prompt específico ("lee correos no leídos importantes, consulta calendario del día, resume prioridades") y guarda la salida en briefings/YYYY-MM-DD-morning.md. Si el bot Telegram está activo, el mismo script empuja el briefing al chat para que aterrice en el móvil antes de empezar el día.

Estructura del repo

Toda esta máquina vive en unos 20 archivos Python más un puñado de shell scripts. Ninguna base de datos, ningún backend, ningún Docker. El código fuente completo del PA es más pequeño que un componente React típico. Esto es deliberado: cuanto menos código, menos mantenimiento; y cuanto menos abstracción, más fácil es depurar cuando algo se rompe. Esta decisión es consistente con lo que recomendamos a nuestros clientes en LLMOps: gestionar modelos de lenguaje en producción — la complejidad operativa mata agentes más que la complejidad del modelo.

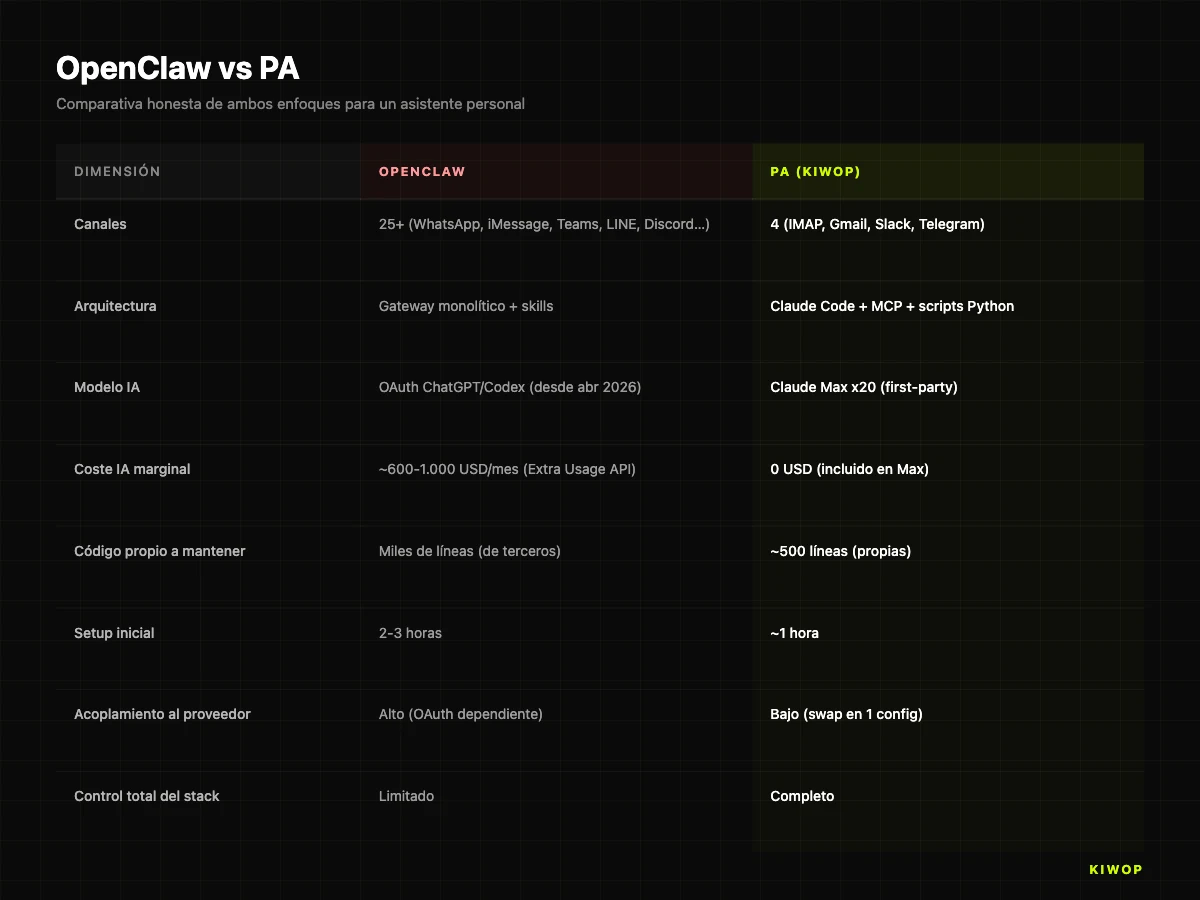

OpenClaw vs PA: la comparativa honesta

No es una competición. OpenClaw sigue siendo un producto más completo, con más canales, con una comunidad activa y con una ruta de producto clara. Si alguien nos pregunta en 2026 "quiero un asistente personal con WeChat, LINE, iMessage y Discord simultáneos", la respuesta honesta es "mira OpenClaw". Para el caso "quiero WhatsApp + Telegram + correo + calendario + Slack, corriendo sobre mi Claude Max, con código que pueda auditar y modificar", la respuesta es PA.

La elección entre uno y otro es fundamentalmente una elección sobre cuánto acoplamiento quieres con un proveedor externo. OpenClaw te da más capacidades out-of-the-box a cambio de depender de las políticas OAuth de Anthropic u OpenAI. PA te da menos capacidades pero con la certeza de que mientras puedas pagar Claude Max y el servicio Gmail siga ofreciendo MCP, nada externo puede dejarte sin asistente de la noche a la mañana.

¿Construimos el tuyo? Diseñamos y desarrollamos asistentes personales IA a medida para profesionales y directivos. → Desarrollo de agentes IA

Alternativa a OpenClaw en 2026: cuándo tiene sentido construir tu propio PA

Nos preguntan ya con cierta frecuencia si construiríamos PAs a medida para clientes. La respuesta corta es que sí, y lo estamos empezando a ofrecer como parte de los servicios de desarrollo de agentes IA. La respuesta larga requiere matizar para quién tiene sentido construir un PA y para quién es un exceso.

Cuándo construir un PA tiene sentido:

- Para un profesional que ya procesa manualmente más de 80 correos al día distribuidos en varias cuentas, y que dedica 30-45 minutos diarios a triaje.

- Para alguien que ya usa Claude Code en desarrollo y tiene una suscripción Max, de modo que el coste marginal del asistente es efectivamente cero.

- Para roles que exigen disponibilidad 24/7 (fundadores, directivos, abogados autónomos, consultores senior) pero que no pueden justificar contratar a un humano PA por coste o discrecionalidad.

- Para quien quiere control total sobre los datos: el PA no envía correos ni calendario a servidores de terceros más allá de los propios del LLM.

Cuándo NO tiene sentido:

- Para un empleado que ya trabaja dentro de Gmail/Outlook y cuya empresa no autorizaría conectar un LLM externo a la cuenta corporativa. La barrera aquí es política y de seguridad, no técnica — aunque en ese escenario un proyecto de RAG empresarial sobre infraestructura controlada puede ser la respuesta correcta.

- Para agencias que quieren "un PA que gestione a todos los clientes" — eso no es un PA, es un SaaS multi-tenant y el planteamiento arquitectónico debe ser radicalmente distinto.

- Para quien no tiene ya una suscripción Claude Max o equivalente: el cálculo económico cambia mucho si hay que pagar API pay-as-you-go.

- Para quien espera un asistente infalible. El PA en su estado actual puede ocasionalmente perder un correo en el triaje, o malinterpretar un evento de calendario. La regla de confirmación antes de actuar es precisamente para cubrirnos ante esos fallos.

La lección más amplia, más allá de si construyes o no tu PA, es otra: los agentes IA dependen económicamente del modelo de facturación del proveedor, y ese modelo puede cambiar. Anthropic lo cambió el 4 de abril. OpenAI ha cambiado el suyo en varias ocasiones desde el lanzamiento de ChatGPT Pro. Google ajusta el suyo regularmente. Cualquier arquitectura de agente que quieras usar durante años debe prever ese riesgo, y la respuesta no es técnica — es estratégica. Construir capas finas y desacopladas entre tu lógica y el modelo del proveedor es lo que te permite pivotar en 48 horas cuando cambia la política.

En Kiwop lo llamamos "agentes a prueba de proveedor". No es una metodología con nombre comercial: es una forma de diseñar que se resume en tres reglas. Primero, el pegamento entre piezas es código propio, nunca un framework de terceros. Segundo, los prompts y los flujos están en tus archivos, no en un SaaS. Tercero, puedes cambiar el modelo con un único fichero de configuración, sin tocar el resto del sistema. PA cumple las tres. Si mañana Anthropic cerrara otra puerta, el puente a OpenAI o a Google nos costaría unos pocos commits y una hora de testing, porque toda la ingeniería alrededor (MCPs, scripts IMAP, bot Telegram, launchd) es agnóstica al modelo.

Preguntas frecuentes

¿Cuál es la mejor alternativa a OpenClaw en 2026?

La mejor alternativa depende del caso de uso. Para quien ya tiene suscripción Claude Max, la opción más económica es construir un asistente personal propio sobre Claude Code + MCP (coste marginal cero). Para quien prefiere un producto listo, OpenClaw sigue siendo válido pagando "Extra Usage" de Anthropic o cambiando el OAuth a ChatGPT/Codex. Para entornos corporativos regulados, recomendamos evaluar soluciones on-premise o un proyecto RAG empresarial sobre infraestructura controlada.

¿Puedo seguir usando OpenClaw con mi suscripción Claude Pro o Max?

No. Desde el 4 de abril de 2026, los tokens OAuth de Claude Pro y Claude Max dejaron de funcionar con OpenClaw y con otros harnesses de terceros. OpenClaw sigue funcionando, pero debes pagar el uso aparte mediante Extra Usage de Anthropic (tarifas de API) o mediante la suscripción OAuth de OpenAI (ChatGPT/Codex). Para los clientes que procesaban un volumen alto, el salto de coste reportado por la comunidad ha sido significativo.

¿Qué es MCP (Model Context Protocol)?

MCP es el estándar abierto que publicó Anthropic a finales de 2024 para que los modelos de lenguaje se conecten a herramientas, bases de datos y APIs externas de forma uniforme. En 2026 está soportado por los principales clientes de IA — incluidos Claude Code, Cursor, Windsurf y otros — y la lista de servidores MCP disponibles (Gmail, Calendar, Drive, Slack, Linear, GitHub, Notion, etc.) crece semana a semana. El PA usa MCP como la vía principal de acceso a Gmail, Google Calendar, Google Drive y Slack.

¿Cuánto cuesta construir un PA propio?

Si ya tienes suscripción Claude Max x20 (unos 200 USD/mes), el coste marginal es cero desde el punto de vista del modelo IA. El tiempo de construcción, si lo haces tú mismo partiendo de cero, ronda las 20-30 horas distribuidas en una semana. Si lo subcontratas a una agencia, depende del alcance (qué canales, qué integraciones MCP, si requiere voz o no), pero para el alcance estándar del PA descrito en este artículo estimamos entre 4.000 y 7.000 euros de construcción y un mantenimiento muy bajo posterior.

¿Por qué Claude Code y no OpenAI Codex?

Claude Code encaja mejor con el modelo de asistente personal por dos razones muy concretas. Primero, la calidad de Opus 4.7 en tareas de triaje de correo y gestión de calendario era superior a la de GPT-5 en nuestras pruebas internas a marzo de 2026 (evaluación cualitativa, no metodología formal publicable). Segundo, Claude Code es producto first-party de Anthropic y sigue cubierto por la suscripción Max, mientras que usar Codex desde dentro de nuestro stack ya montado habría significado pagar doble suscripción (Max para desarrollo, ChatGPT Pro para PA) sin ganancia funcional clara.

¿Es el PA seguro para correos confidenciales?

El PA es tan seguro como el proveedor del modelo al que te conectas. En el caso de Anthropic, los correos procesados no se usan para entrenar modelos (política pública de Anthropic a 2026) y la comunicación es cifrada. Dicho esto, cualquier PA que pase contenido sensible por un LLM externo implica un acto de confianza en ese proveedor. Para contenido regulado (sanitario, legal, financiero con secreto profesional), recomendamos revisar los términos específicos y considerar alternativas on-premise.

¿Se puede integrar WhatsApp?

A día de hoy, WhatsApp no dispone de un MCP oficial y los bridges no oficiales (como los que OpenClaw integra) requieren mantener una cuenta de WhatsApp Business API o técnicas menos estables. El PA en su versión actual no integra WhatsApp nativamente — usamos Telegram como canal móvil primario por estabilidad. Estamos evaluando el MCP de WhatsApp Cloud API de Meta para una segunda iteración.

¿El PA puede actuar sin supervisión humana?

Por diseño, no. La regla de confirmación obligatoria antes de cualquier acción de escritura (enviar correo, crear evento, responder Slack) es el núcleo de seguridad del asistente. Ver un correo, leer calendario, buscar en Drive — todo eso son operaciones de lectura y las hace sin confirmar. Pero enviar, crear, mover, borrar — siempre requieren un "sí" explícito del humano. Es una decisión arquitectónica consciente: preferimos un PA un poco menos ágil pero que no comete errores irreversibles.

¿Esta arquitectura funciona en Windows o Linux?

Sí, con ajustes. Los conceptos (Claude Code + MCP + scripts Python + daemon Telegram) son portables. Lo que cambia es el gestor de procesos en el arranque: en macOS usamos launchd, en Linux sería systemd con unidades user, y en Windows el Task Scheduler. El Keychain para credenciales de IMAP también tiene equivalentes en otras plataformas (Secret Service en Linux, Credential Manager en Windows).

Conclusión: los agentes IA y el riesgo de proveedor

El cambio de política de Anthropic del 4 de abril de 2026 nos hizo un favor. Nos obligó a plantearnos si queríamos seguir externalizando una pieza crítica de nuestra productividad diaria a un proyecto de terceros, por brillante que fuera, cuando teníamos todas las piezas para construirla nosotros mismos sobre un stack que ya dominábamos. La respuesta, con dos semanas de perspectiva, es clara: no queríamos. Y no queremos, para ninguna capa crítica de nuestro trabajo.

La lección no es "todos deberíais construir vuestro PA". La lección es que en 2026, con modelos de IA cada vez más capaces y con MCP consolidándose como el estándar de integración, la distancia entre usar un agente de terceros y construir el tuyo propio se ha reducido drásticamente. Lo que en 2023 habría requerido un equipo de tres ingenieros durante tres meses hoy son unas 500 líneas de Python y una tarde de setup. Esa barrera derrumbada es la que define la ola actual de la IA aplicada — y la que mejor explica por qué las agencias de software en 2026 estamos en una posición tan distinta a la de hace dos años.

Si te estás planteando montar tu propio asistente personal, o si necesitas ayuda construyendo agentes IA robustos para tu equipo o empresa, en Kiwop — Agencia Digital especializada en Desarrollo de Software e Inteligencia Artificial aplicada para clientes globales en Europa y USA — ofrecemos desarrollo a medida de agentes IA y consultoría de inteligencia artificial para contextos de producción. El PA que describimos aquí es el mejor ejemplo vivo de cómo lo hacemos para nosotros mismos.