RAGEmpresarial:IAqueresponamblestevesdadesreals

La teva empresa té milers de documents, manuals, i bases de dades que ningú consulta eficientment. RAG (Retrieval-Augmented Generation) connecta les teves dades amb IA generativa per a respostes precises, citades i verificables. Mercat de $1.960M el 2025, projectat a $40.300M el 2035.

Què inclou el servei

Lliurables del sistema RAG complet.

Com funciona un sistema RAG

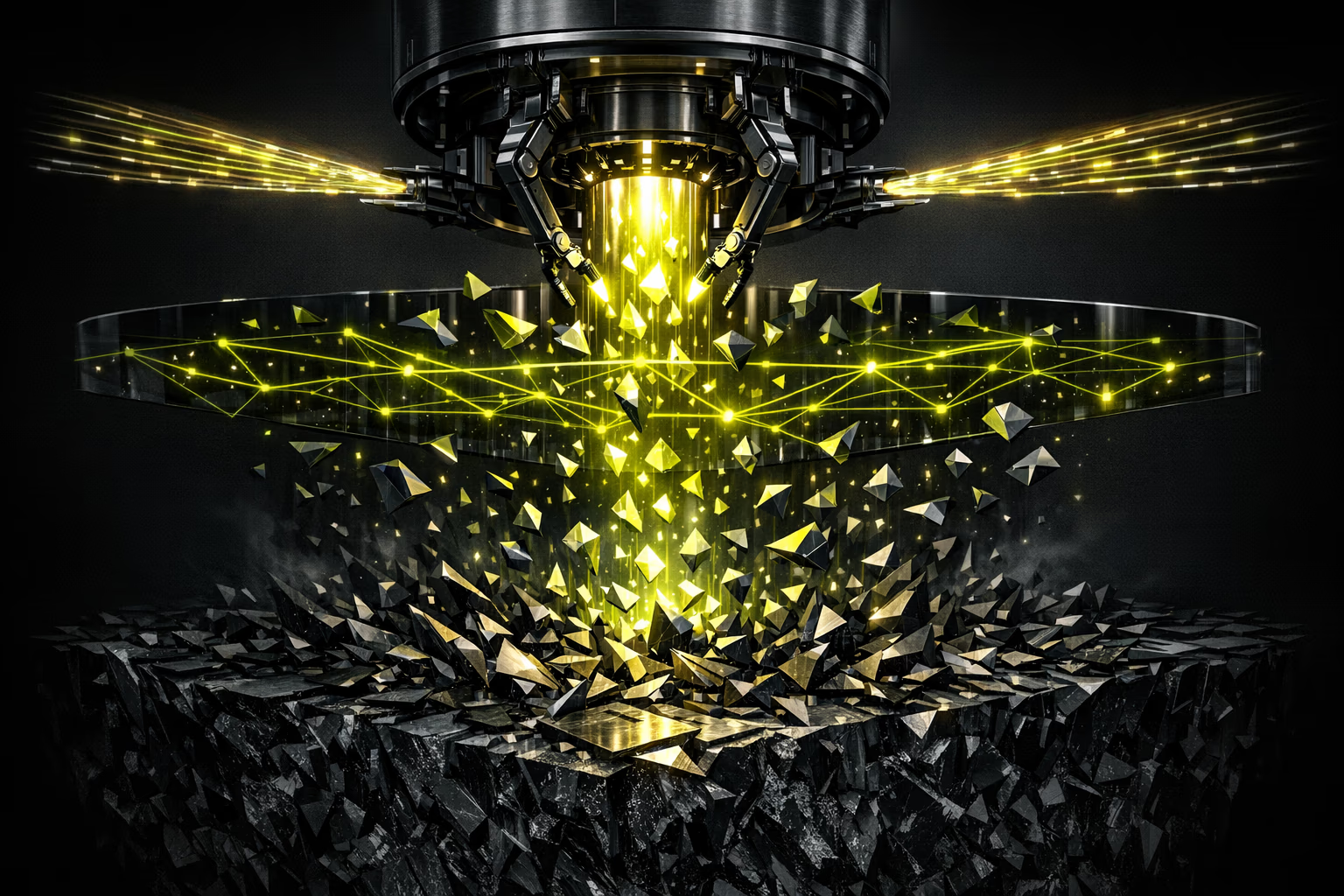

L'arquitectura que elimina al·lucinacions.

RAG combina el millor de dos mons: la capacitat de llenguatge natural dels LLMs amb la precisió de les teves dades reals. Quan un usuari pregunta, el sistema busca informació rellevant a la teva base de coneixement vectorial, la injecta al context del LLM, i genera una resposta fonamentada amb cites verificables. El resultat: respostes que sonen naturals però estan ancorades en dades reals.

Resum executiu

Per a la direcció.

El RAG empresarial converteix la teva base de coneixement dispersa (documents, manuals, FAQs, bases de dades) en un sistema d'IA que respon preguntes amb precisió del 95%+ i cita la font. El cas d'ús més immediat: suport al client amb reducció del 50% en tickets L1.

Inversió típica: 45.000-500.000+ EUR segons complexitat i volum de dades. ROI en 4-8 mesos per a equips de suport de 10+ persones. El risc principal (al·lucinacions) es mitiga amb avaluació contínua i human-in-the-loop per a decisions crítiques.

Resum tècnic

Per al CTO.

Arquitectura modular: ingesta → chunking → embedding → vectorstore → retrieval → reranking → generation. Cada component és intercanviable. Embeddings: OpenAI ada-002, Cohere embed-v3, o models open-source (BGE, E5). Vectorstores: Pinecone (managed), Qdrant (self-hosted), pgvector (PostgreSQL natiu).

Avaluació amb framework RAGAS: faithfulness, answer relevance, context precision, context recall. Pipeline de CI/CD per a testing de regressió en precisió. Monitorització de costos per query, latència P95, i drift d'embeddings. Servidors europeus per a compliment RGPD.

És per a tu?

RAG empresarial té sentit quan tens dades valuoses que ningú aprofita.

Per a qui

- Empreses amb bases de coneixement extenses (manuals, documentació tècnica, FAQs, normativa).

- Equips de suport que responen les mateixes preguntes repetidament amb informació dispersa.

- Organitzacions que necessiten IA amb dades pròpies sense enviar informació sensible a models públics.

- Departaments legals, de compliance o mèdics que necessiten respostes precises i citades.

- Empreses que volen un cercador intern intel·ligent que entengui llenguatge natural.

Per a qui no

- Organitzacions amb poca documentació o dades no estructurades de baixa qualitat.

- Si necessites IA generativa creativa (campanyes, contingut) sense ancorar en dades pròpies.

- Empreses sense pressupost per mantenir i actualitzar la base de coneixement.

- Casos d'ús on una cerca per paraules clau tradicional és suficient.

- Si no tens dades digitalitzades: primer necessites digitalitzar el teu coneixement.

5 casos d'ús de RAG empresarial

On RAG genera més impacte.

Suport al client intel·ligent

Chatbot que respon consultes de clients consultant la teva base de coneixement en temps real. Redueix tickets L1 en un 50%, respon en segons, i escala a humà quan la confiança és baixa. Amb historial de conversa i feedback loop per a millora contínua.

Assistent de coneixement intern

Empleats pregunten en llenguatge natural i obtenen respostes de documentació interna, polítiques, i procediments. Redueix un 40% el temps buscant informació. Especialment valuós per a onboarding de nous empleats i equips distribuïts.

Processament de documents

Extreu informació de contractes, factures, informes, i documents legals de forma automàtica. Classifica, resumeix, i respon preguntes sobre milers de documents en segons. Ideal per a departaments legals, compliance i financer.

Cercador semàntic empresarial

Substitueix la cerca per keywords per cerca semàntica que entén intenció. "Quin és el procés per retornar un producte defectuós?" en lloc de cercar "devolució defecte". Connecta amb Confluence, SharePoint, Notion, i sistemes interns.

Assistent de vendes amb dades de producte

L'equip comercial consulta specs, comparatives, i argumentaris en llenguatge natural. Genera propostes personalitzades basades en la fitxa tècnica real del producte i l'historial del client. Reducció del 30% en temps de preparació d'ofertes.

Procés d'implementació

De les teves dades en brut a un sistema RAG en producció.

Auditoria de dades i disseny

Avaluem les teves fonts de dades (documents, bases de dades, APIs), definim l'estratègia de chunking i embeddings, i dissenyem l'arquitectura RAG. Lliurable: document tècnic amb pipeline complet.

Ingesta i vectorització

Connectem fonts de dades, processem documents, i creem la base vectorial. Optimització de chunking (mida, solapament, metadata). Proves de retrieval amb queries reals del teu negoci.

Orquestració i avaluació

Construïm el pipeline complet: retrieval → reranking → generation amb citació. Avaluació amb RAGAS (faithfulness, relevance, precision). Ajust fins a superar llindars de qualitat definits.

Interfície, desplegament i monitorització

Frontend (chatbot o cercador), desplegament en producció, i monitorització contínua: precisió, latència, costos, i feedback dels usuaris. Suport post-llançament de 30 dies inclòs.

Riscos i mitigació

Transparència total sobre els desafiaments del RAG.

Al·lucinacions i respostes incorrectes

Avaluació contínua amb RAGAS (faithfulness >0.9). Citació obligatòria de fonts. Llindars de confiança: si el sistema no està segur, ho diu explícitament en lloc d'inventar.

Privacitat i dades sensibles

Processament en servidors europeus (RGPD). Opció de desplegament on-premise o cloud privada. Accés granular per rol: cada usuari veu només el que el seu perfil permet.

Escalabilitat amb milions de documents

Vectorstores dissenyats per escalar: Pinecone suporta milers de milions de vectors, Qdrant escala horitzontalment. Indexació incremental per a nous documents sense reprocessar tot.

Costos d'API i embeddings creixents

Pressupostos per consulta amb alertes. Cache semàntic per a queries repetides (-60% costos). Models d'embedding més eficients per a volums alts. Opció de models open-source on-premise per a cost fix.

Experiència en IA i dades empresarials

Portem 15+ anys integrant sistemes i dades per a empreses europees. Des de 2023, implementem solucions RAG en producció per a clients amb bases de coneixement de milers de documents. No som un laboratori d'investigació: construïm sistemes que funcionen al món real amb dades reals i compliment RGPD.

Preguntes freqüents

El que els nostres clients pregunten sobre RAG.

Què és RAG i per què el necessita la meva empresa?

RAG (Retrieval-Augmented Generation) és una arquitectura que connecta les teves dades amb IA generativa. En lloc que el LLM "inventi" respostes, busca informació rellevant als teus documents i genera respostes ancorades en dades reals. La teva empresa el necessita si té coneixement valuós dispers en documents que ningú consulta eficientment.

Com s'eliminen les al·lucinacions?

Tres capes de protecció: 1) Grounding: el LLM només genera respostes basades en documents recuperats. 2) Citació obligatòria: cada resposta inclou la font i el fragment exacte. 3) Llindars de confiança: si la rellevància és baixa, el sistema respon "no tinc informació suficient" en lloc d'inventar.

Quant costa implementar un sistema RAG?

Projecte bàsic (1 font de dades, chatbot simple): 45.000-80.000 EUR. Projecte intermedi (múltiples fonts, cercador semàntic, avaluació): 80.000-200.000 EUR. Projecte enterprise (multi-tenant, on-premise, integracions complexes): 200.000-500.000+ EUR. Sempre amb proposta detallada i ROI estimat.

Quant de temps triga la implementació?

Un sistema RAG funcional en producció: 6-10 setmanes. Inclou auditoria de dades, ingesta, vectorització, pipeline de retrieval, avaluació, interfície, i desplegament. Projectes enterprise amb múltiples integracions: 12-16 setmanes. Prototip funcional disponible a la setmana 4.

És segur? Les meves dades estan protegides?

Sí. Processament en servidors europeus amb compliment RGPD complet. Opcions de desplegament: cloud privada, on-premise, o híbrid. Les dades mai es fan servir per entrenar models de tercers. Accés granular per rol i auditoria completa de consultes.

Quins formats de documents suporta?

Pràcticament tots: PDF, Word, Excel, PowerPoint, HTML, Markdown, Confluence, SharePoint, Notion, Google Docs, bases de dades SQL, APIs REST, i text pla. Fem servir Unstructured.io per a processament avançat de documents complexos amb taules, imatges, i layouts irregulars.

S'actualitza automàticament quan canvien les dades?

Sí. Configurem ingesta incremental: quan s'afegeix o modifica un document, es reprocessa i actualitza a la base vectorial automàticament. Opcions: webhooks (temps real), cron jobs (periòdic), o trigger manual. Sense necessitat de reindexar tota la base de dades.

Puc fer servir RAG amb models open-source en lloc d'OpenAI?

Absolutament. La nostra arquitectura és agnòstica de model. Pots fer servir Llama 3, Mistral, Mixtral, o qualsevol model de HuggingFace desplegat a la teva pròpia infraestructura. Això elimina dependència de proveïdors i redueix costos per consulta a pràcticament zero (només infraestructura). Ideal per a dades altament sensibles que no poden sortir de la teva xarxa.

Quant coneixement perd la teva empresa cada dia?

Auditoria gratuïta de la teva base de coneixement. Avaluem les teves fonts de dades, estimem l'impacte d'un sistema RAG, i dissenyem l'arquitectura. Sense compromís.

Sol·licitar auditoria RAG Consulta

tècnica inicial.

IA, seguretat i rendiment. Diagnòstic i proposta tancada per fases.

La teva primera reunió és amb un Arquitecte de Solucions, no amb un comercial.

Sol·licitar diagnòstic