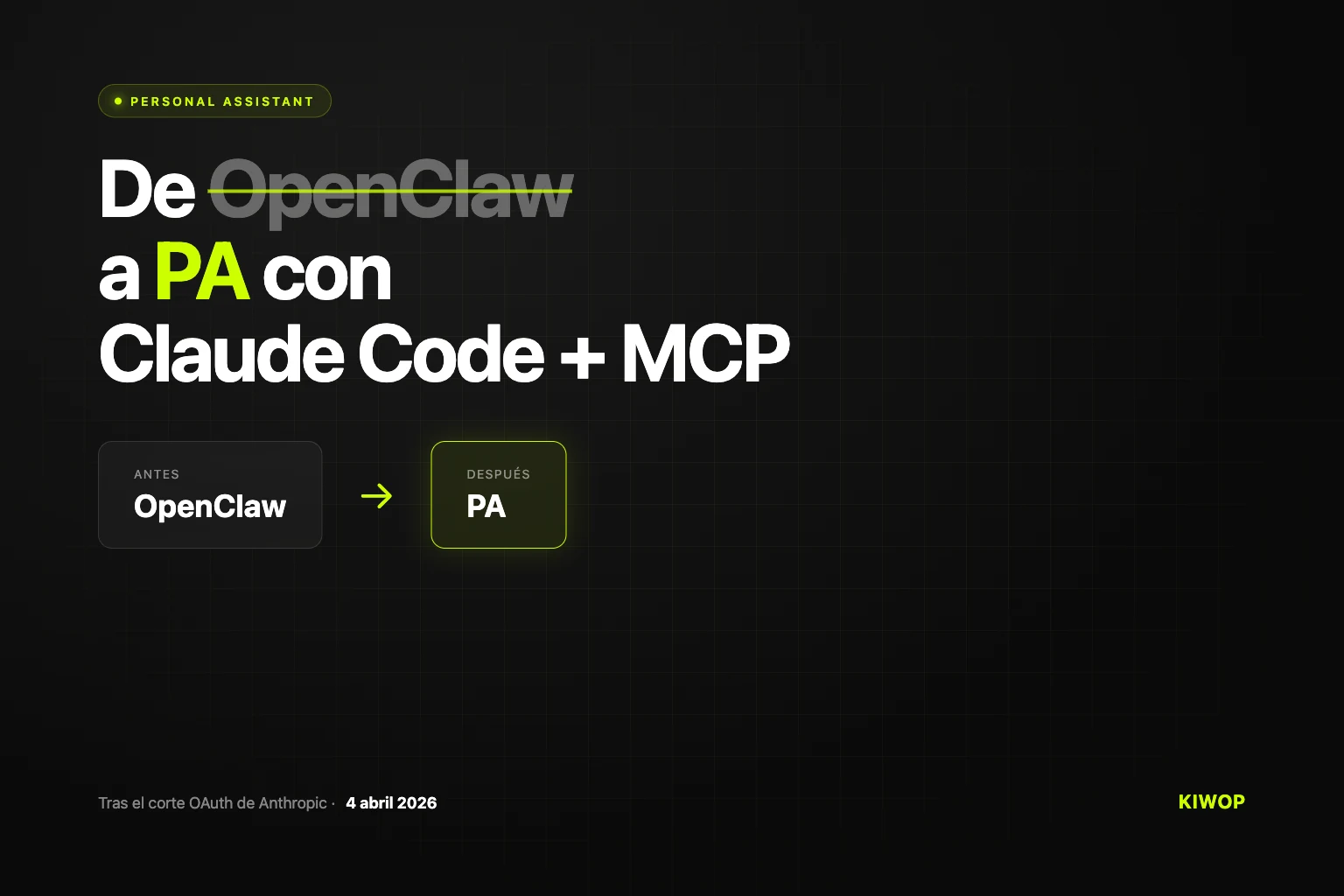

Alternatief voor OpenClaw: persoonlijke assistent met Claude Code en MCP na de stopzetting door Anthropic (april 2026)

Door het team van Kiwop · Digital Agency gespecialiseerd in Softwareontwikkeling en toegepaste Kunstmatige Intelligentie · Gepubliceerd op 19 april 2026 · Laatst bijgewerkt: 19 april 2026

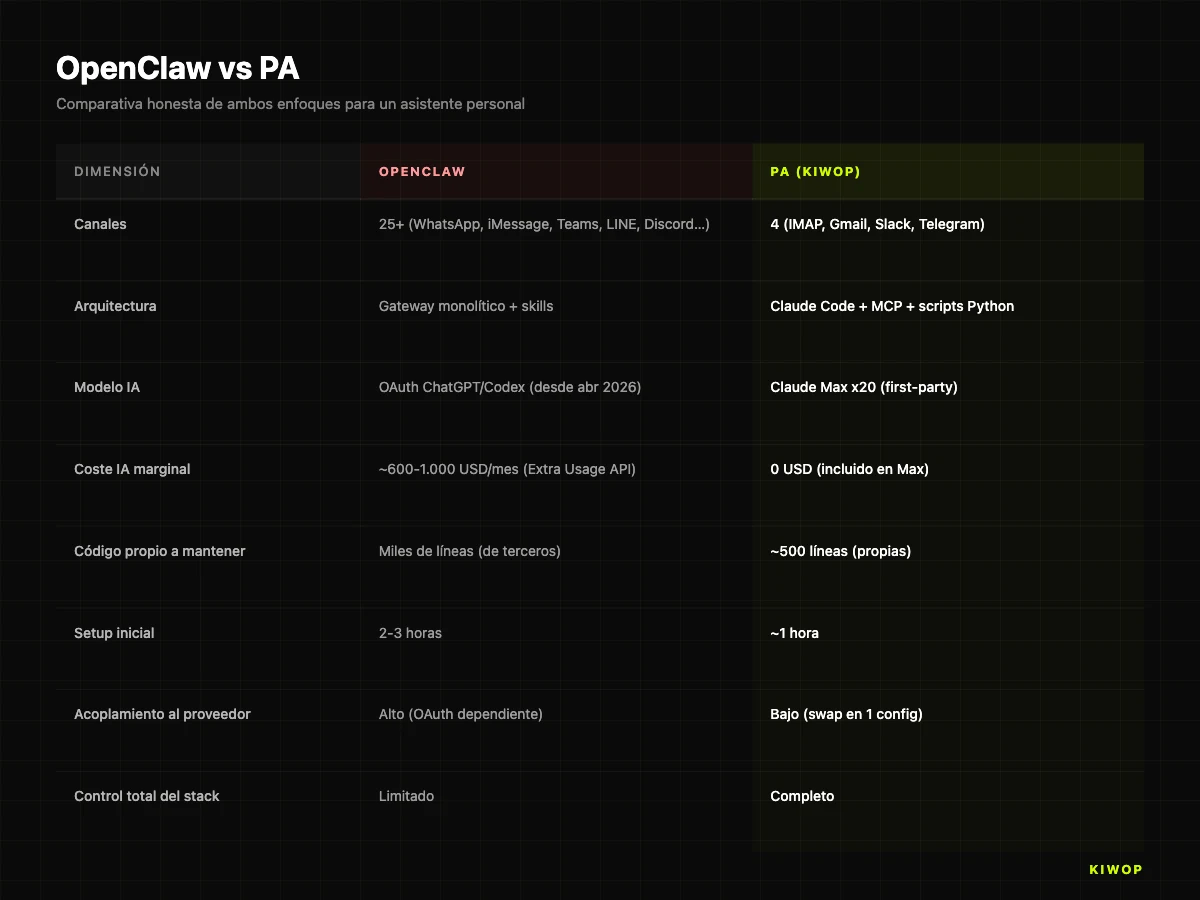

TL;DR — Op 4 april 2026 deactiveerde Anthropic de OAuth-tokens waarmee OpenClaw gebruik kon maken van Claude Max- en Claude Pro-abonnementen. Getroffen gebruikers hebben drie opties: "Extra Usage" betalen tegen API-prijs (tussen 5 en 50 keer duurder), migreren naar OpenAI Codex, of de persoonlijke assistent opnieuw opbouwen met Claude Code + MCP. Bij Kiwop kozen wij voor de derde route en documenteren hier de resulterende architectuur — een PA met vier kanalen (IMAP, Gmail, Slack, Telegram), zo'n 500 regels eigen Python-code, en nul marginale kosten doordat alles binnen het Max-abonnement blijft.

Bij Kiwop hadden we 48 uur nodig om te beslissen wat we zouden doen na de aankondiging van Anthropic. Dit artikel vertelt over die beslissing — waarom we niet overgingen op OpenAI Codex, waarom we de "Extra Usage" van Anthropic niet betaalden, en hoe we onze persoonlijke assistent (PA) hebben herbouwd met Claude Code en Model Context Protocol (MCP). Een assistent die nog steeds draait op hetzelfde Claude Max x20-abonnement, met dezelfde kanalen die we voorheen gebruikten, maar met een fundamenteel verschil: de stack is van ons, de code is van ons en de provider kan het tapijt niet onder onze voeten wegtrekken.

Het is geen anti-Anthropic-manifest — we gebruiken hun modellen nog steeds dagelijks en denken dat het de beste op de markt zijn voor agencies in 2026. Het is een analytische lezing van wat er gebeurt wanneer het economische model van een agent afhankelijk was van het beleid van een provider, dat beleid verandert, en je moet beslissen of je je aanpast of opnieuw bouwt.

Wat is een PA en waarom het woord "Persoonlijk" ertoe doet

Een Personal Assistant (PA) is een AI-assistent die één enkele persoon bedient door zijn e-mails, agenda, berichten en documenten te centraliseren in een conversationele interface. In tegenstelling tot een multi-tenant SaaS draait een PA toegewijd aan één enkele mens met exclusieve toegang tot zijn accounts. Die definitie, schijnbaar vanzelfsprekend, is wat een goed ontworpen PA onderscheidt van een vermomde commerciële tool.

Het onderscheid is niet muggenzifterij. Een mens heeft in 2026 mogelijk drie of vier e-mailadressen (die van het werk, die van een nevenproject, de persoonlijke), twee of drie WhatsApp-nummers, Slack-accounts in verschillende workspaces, en een half dozijn gesynchroniseerde agenda's. Een PA centraliseert dat hele oppervlak en maakt er één enkele conversationele interface van die begrijpt wie je bent en wat voor jou belangrijk is. Niet omdat hij voor jou is getraind, maar omdat hij voor jou draait en alleen voor jou, met toegang tot jouw accounts, jouw threads, jouw voorkeuren.

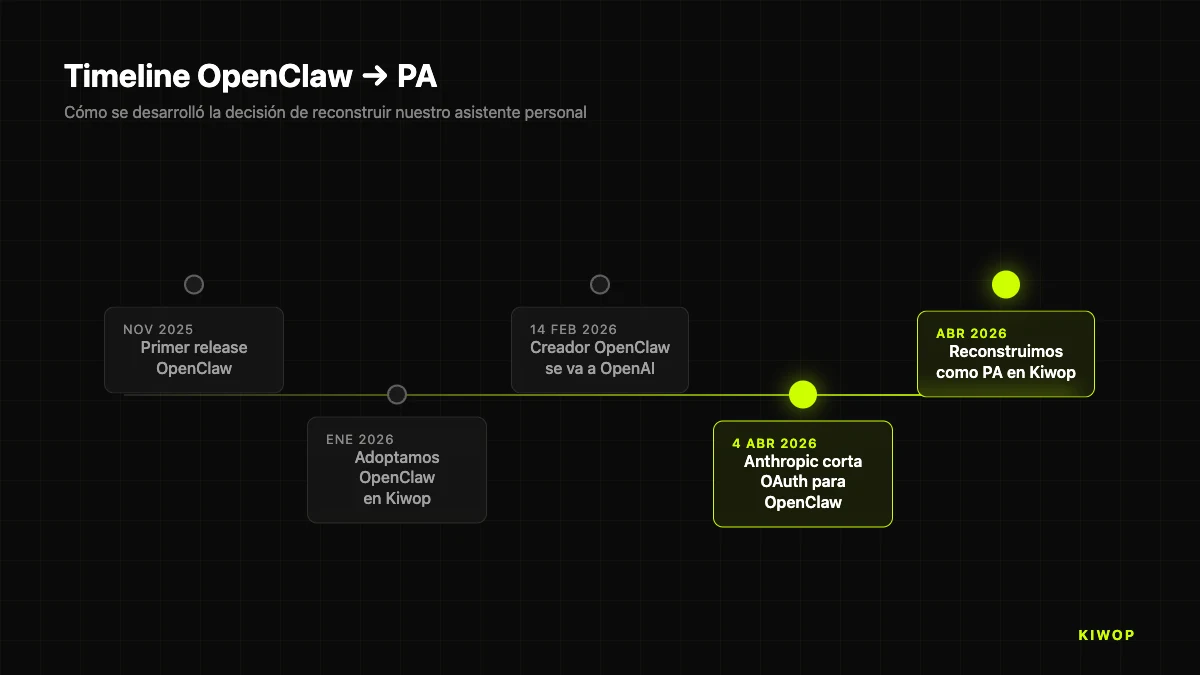

Dat is de belofte van een PA, en dat is wat ons ertoe bracht OpenClaw in januari te adopteren. En dat is ook wat ons ertoe bracht om in april te besluiten hem zelf te herbouwen toen de economie van de provider veranderde.

Waarom wij OpenClaw kozen als persoonlijke AI-assistent in januari 2026

OpenClaw is een open source persoonlijke AI-assistent die eind 2025 werd gelanceerd en verbinding maakt met kanalen zoals WhatsApp, Telegram, Slack en meer dan twintig berichtenplatforms, gebruikmakend van een centrale Gateway en een uitbreidbaar skills-systeem. Het project draait op je eigen machine (lokaal, VPS, of fly.io) en ondersteunde, tot april 2026, OAuth tegen het Claude Max-abonnement — dat betekende dat alle interacties werden geteld tegen het Max x20-plan dat we al betaalden. De lijst van ondersteunde kanalen omvat onder andere Discord, Google Chat, Signal, iMessage, Teams, Matrix, Feishu, LINE, Mattermost, Nextcloud Talk, Nostr, Synology Chat, Tlon, Twitch, Zalo, WeChat en WebChat.

De economische berekening eind januari was eenvoudig. We hadden een Claude Max x20-abonnement (ongeveer 200 dollar per maand) dat we al intensief gebruikten voor Claude Code bij ontwikkeling. Er een persoonlijke assistent aan toevoegen die e-mails verwerkte, Slack las, Telegram-berichten beantwoordde, en ochtendbriefings maakte zou geen relevante extra kosten genereren, omdat de limieten van het abonnement meer dan voldoende waren. Voor 200 dollar per maand hadden we overdag een senior AI-ontwikkelaar en 's ochtends en 's middags een persoonlijke assistent.

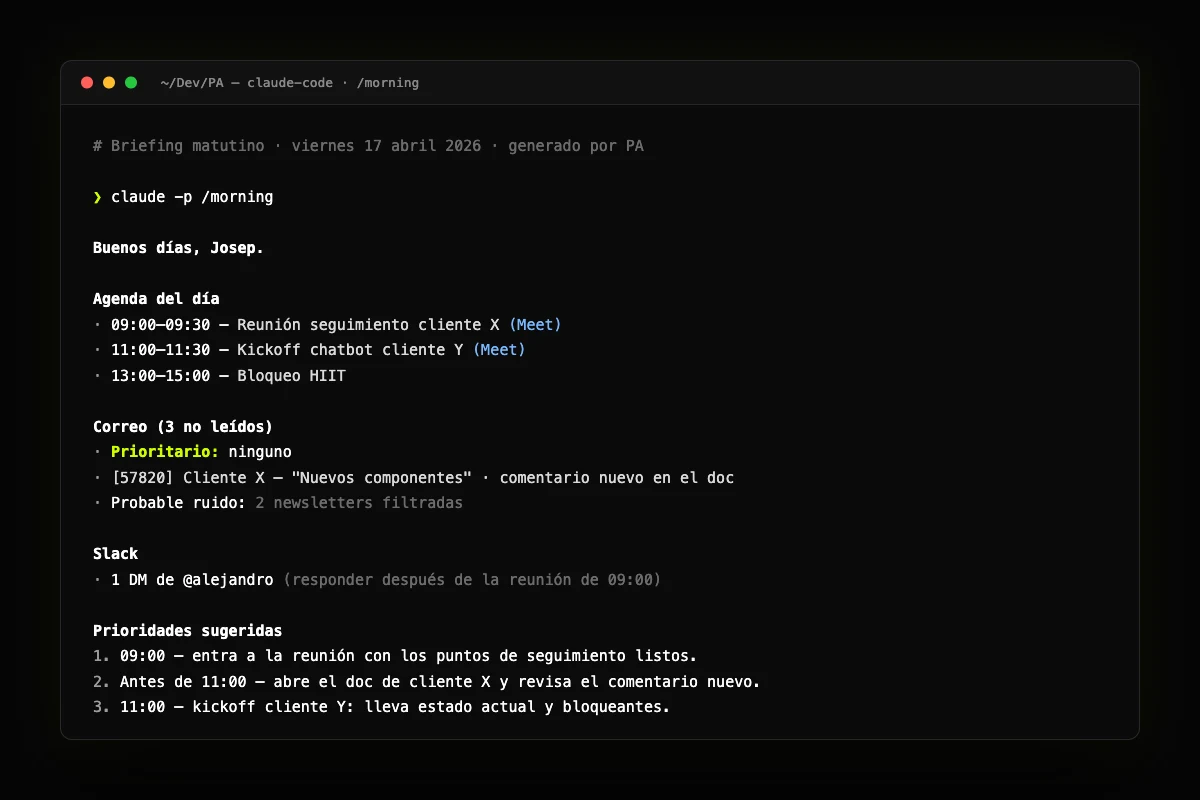

OpenClaw presteerde in januari, februari en maart naar behoren. Elke ochtend om acht uur landde er een briefing met mijn agenda en prioritaire e-mails op Telegram. Ik kon de bot vanaf mijn mobiel beantwoorden en mijn bericht ging tegen Claude met alle context van e-mail en agenda. Ik kon vanuit WhatsApp vragen "heb ik iets om vijf uur?" en het antwoord klopte. Het was, eerlijk gezegd, het meest nuttige product van het seizoen voor de dagelijkse productiviteit.

Maar op 4 april veranderde alles.

4 april 2026: wat er precies veranderde

Die dag kondigde Anthropic aan dat de OAuth-tokens van Claude Max en Claude Pro zouden stoppen met werken met "derde-partij harnesses" — een term die in de industrie OpenClaw, Crush, Aider, en andere clients omvat die zich tot dan toe verbonden met Claude met behulp van de abonnementsgegevens van de gebruiker. De media-aandacht was onmiddellijk: TechCrunch, VentureBeat, The Register en Hacker News brachten het nieuws, met zeer actieve threads van gebruikers die significante kostenstijgingen meldden na de wijziging.

De officiële uitleg van Anthropic verwees naar "de druk op onze compute- en engineering-resources, en de wens om een groot aantal gebruikers betrouwbaar te bedienen". De technische en economische interpretatie is interessanter.

Een Claude Max x20-abonnement is technisch gezien een contract met elastische limieten: Anthropic rekent je een vast tarief en geeft je een genereuze gebruikslimiet die de meeste klanten niet volledig verbruiken. Dat model werkt wanneer de sessies worden gelanceerd door een mens achter het toetsenbord: het gebruik is intermitterend, pauzes zijn frequent, en het werkelijke verbruik blijft ver onder het plafond. Wanneer je een autonome multi-kanaal agent tussen de mens en het model zet — zoals OpenClaw doet — schiet het verbruik op een zeer voorspelbare manier omhoog: elk binnenkomend bericht activeert een oproep, elk antwoord activeert er nog een, en 24 uur per dag is er verkeer, zelfs wanneer de mens slaapt.

Vermenigvuldigd met de geschatte wereldwijde installbase van OpenClaw waren de compute-kosten voor Anthropic onhoudbaar binnen de abonnementsprijs. De oplossing van de provider was om beide werelden te scheiden: Claude.ai, Claude Code en Claude Cowork blijven gedekt door Max/Pro, maar alles wat via derde-partij harnesses gaat wordt nu gefactureerd via "Extra Usage" tegen de API-prijs.

Voor een gebruiker zoals wij, die tussen 300 en 500 dagelijkse interacties met de PA verwerkte (briefings, e-mails, triages, antwoorden vanaf mobiel), ging de nieuwe geprojecteerde factuur met Extra Usage van "inbegrepen in de 200 dollar van de Max" naar ongeveer 800-1.200 dollar extra per maand. Dat was niet te dragen. Het was ook niet te rechtvaardigen, gezien hetzelfde werk nog steeds ruim binnen het Max-plan paste als we het direct vanuit Claude Code uitvoerden.

De vraag was toen: hoe zorg je ervoor dat een multi-kanaal persoonlijke assistent binnen Claude Code draait?

Claude Code versus OpenAI Codex als motor voor je persoonlijke assistent

De eerste verleiding was om OpenClaw over te zetten naar een andere provider. OpenClaw zelf ondersteunt OAuth tegen ChatGPT en Codex, en Peter Steinberger — de maker van het project — had in februari aangekondigd dat hij bij OpenAI in dienst trad. De assistent laten draaien op een ChatGPT Pro-abonnement of een Codex-plan was technisch een kwestie van het authenticatieprofiel wijzigen.

We hebben die route om drie redenen afgewezen.

De eerste, de kwaliteit van het model voor de taken die voor ons belangrijk zijn. Tot op vandaag gaven de modellen van Anthropic (vooral Opus 4.7) ons bij e-mailtriage, het samenvatten van Slack-threads en het extraheren van agenda-informatie, consistent betere resultaten dan GPT-5 bij dezelfde prompt. Het is geen generieke mening — we hebben het in de maand maart geëvalueerd door dezelfde briefings door beide providers te laten lopen en de uitvoer kwalitatief te vergelijken, zonder formele publiceerbare methodologie, maar met consistente criteria toegepast door dezelfde reviewer. De conclusie voor onze gebruikscase (e-mailbeheer in het Spaans en Catalaans, met technische agency-vocabulaire) was duidelijk in het voordeel van Anthropic. Jouw kilometerstand kan variëren — we raden aan je eigen evaluatie te doen met je eigen prompts voordat je een provider kiest.

De tweede, lock-in met een provider die net eenzijdige beleidswijzigingen had gedemonstreerd. Als Anthropic de OAuth voor derden kon sluiten met vijftien dagen vooraankondiging, kon elke andere provider hetzelfde doen. De les was niet "wissel van provider", de les was "bind je kritieke dagelijkse infrastructuur niet aan externe beslissingen over facturatiemodellen". OpenClaw verplaatsen naar OpenAI was het symptoom verhelpen zonder de oorzaak aan te pakken.

De derde, en de belangrijkste: Claude Code was al in de stack. We gebruikten het elke dag om met AI te programmeren in een agency. Het had aangesloten MCP servers. Het wist hoe het onze databases moest lezen, scripts moest uitvoeren, naar productie moest deployen. Als we, in plaats van de persoonlijke assistent als een apart project te behandelen, hem als "één extra gebruik" van Claude Code zouden behandelen — met zijn eigen CLAUDE.md, zijn eigen MCPs, zijn eigen commando's — konden we absoluut alle infrastructuur hergebruiken. En het belangrijkste: dat gebruik bleef gedekt door het Max x20-abonnement omdat Claude Code een first-party product van Anthropic is, geen derde partij.

De beslissing werd in één middag genomen. De naam van het project: PA, direct en letterlijk.

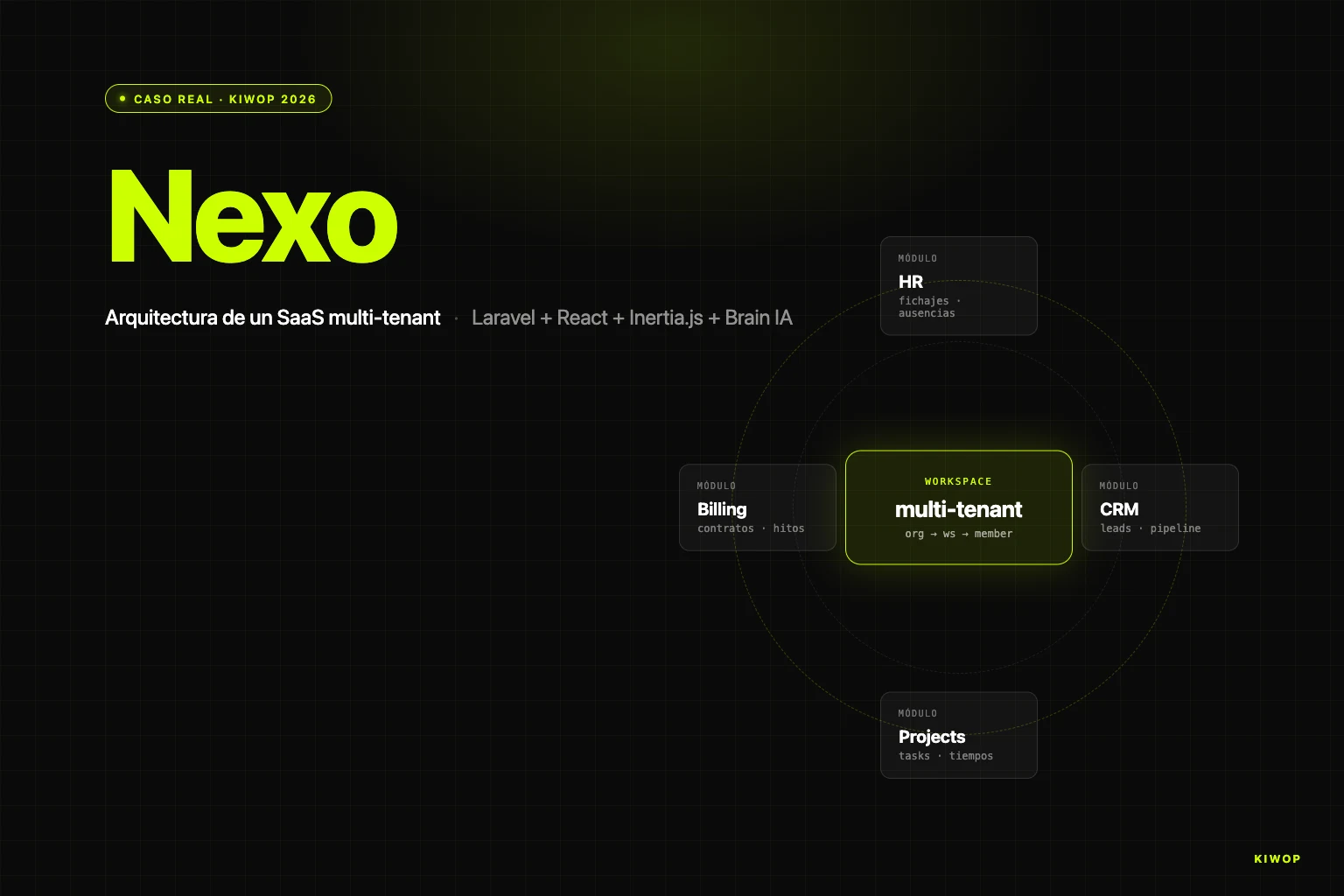

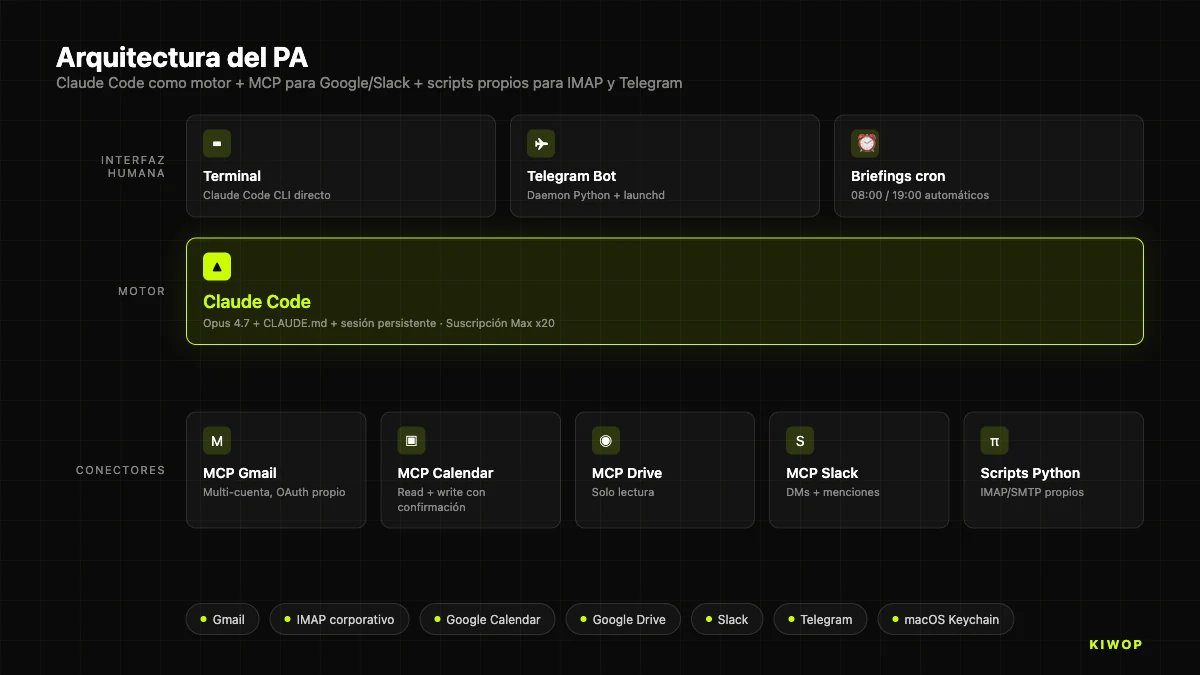

Architectuur van de persoonlijke assistent met Claude Code en MCP servers

De PA draait in een eigen directory (~/Dev/PA) met een eenvoudige maar bewuste structuur. Het is geen gesloten applicatie: het is een reeks Python-scripts, Claude Code-configuraties en een Telegram-bot die met elkaar communiceren via het besturingssysteem. De filosofie is het tegenovergestelde van OpenClaw, dat alles integreert binnen een monolithische Gateway. In PA doet elk onderdeel één ding en de lijm is Unix.

De basis: Claude Code als conversationele motor

Claude Code is het brein. Geen chatbot, geen API, maar de volledige Anthropic CLI die draait in "project"-modus met een toegewijde directory en een eigen CLAUDE.md-bestand dat persona, standaardtaal (Catalaans in ons geval) en de regel van verplichte bevestiging definieert voordat e-mails worden verzonden of evenementen worden aangemaakt. Die regel is niet onderhandelbaar: de PA raakt nooit iets aan zonder eerst te vragen.

Elke keer dat we met de PA interacteren, of het nu via de terminal is, via een gepland commando, of via de Telegram-bot, is wat er intern gebeurt een claude -p-sessie met persistente context. Dat betekent dat het geheugen van de assistent niet in een grillige externe opslag leeft: het leeft in de eigen sessieflow van Claude Code, met dezelfde cache- en herinjectie-garanties die we gebruiken bij het ontwikkelen.

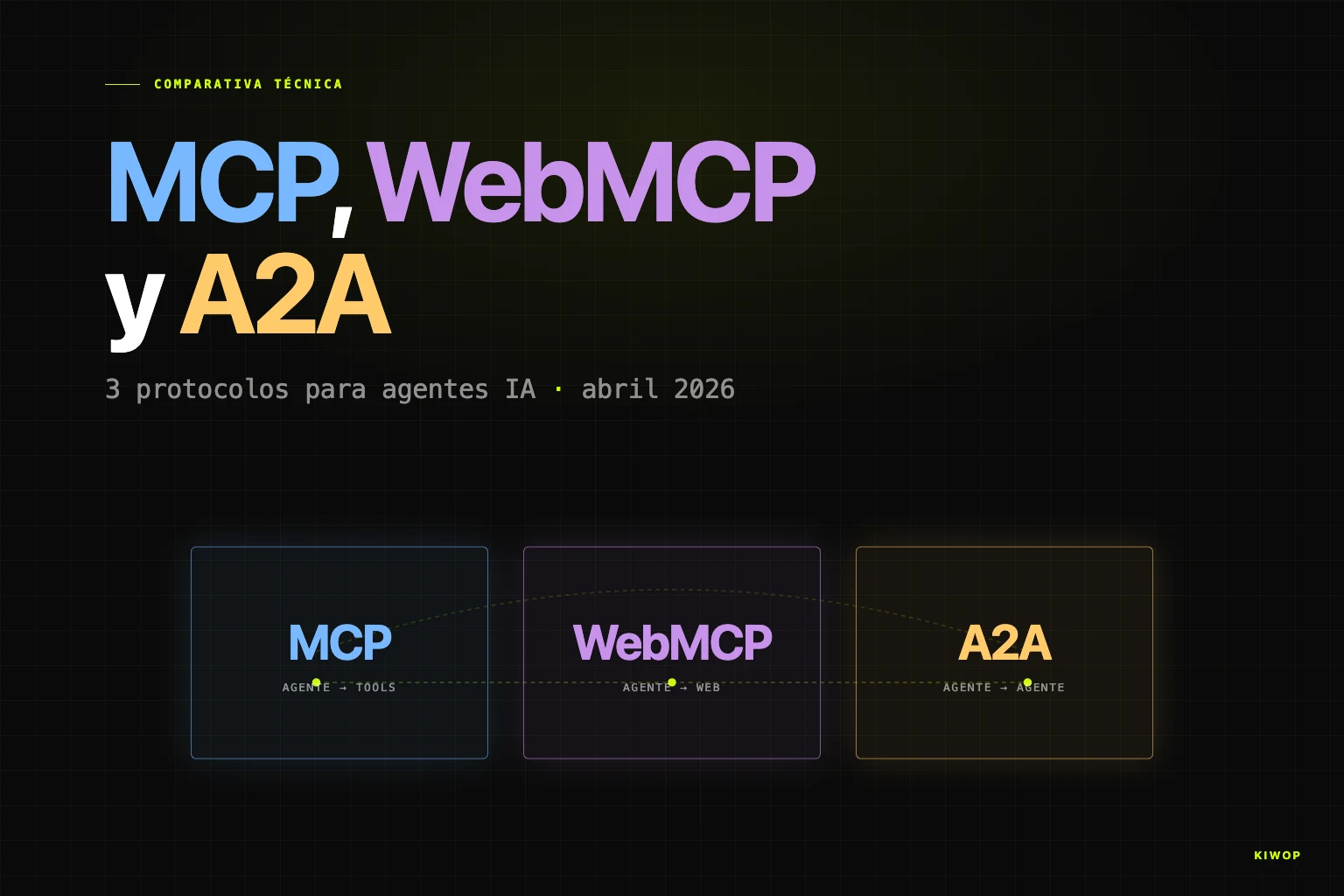

De connectoren: MCP voor alles wat extern is

Om toegang te krijgen tot de buitenwereld gebruikt de PA MCP — Model Context Protocol — de open standaard die Anthropic in 2024 publiceerde en die in 2026 de gemeenschappelijke taal van AI-agenten is geworden. Als je wilt begrijpen wat MCP is en waarom het zo belangrijk is, gaat het artikel WebMCP: jouw website klaar voor AI-agenten in op het technische detail. MCP is het onderdeel waarmee Claude Code verbinding kan maken met bedrijfssystemen via LLM-integratie zonder op maat gemaakte connectoren voor elke service te herschrijven.

In het geval van de PA zijn de actieve MCP-connectoren:

- Gmail MCP: e-mails lezen, opstellen en verzenden vanaf meerdere adressen van dezelfde persoon (het professionele agency-account, het persoonlijke account, het account van een nevenproject). Altijd lezen; schrijven alleen met bevestiging.

- Google Calendar MCP: agenda raadplegen, evenementen aanmaken en verplaatsen. Ook met bevestiging.

- Google Drive MCP: zoeken en lezen van documenten op aanvraag. Alleen lezen.

- Slack MCP: DM's en vermeldingen lezen, antwoorden met bevestiging.

Al deze connectoren zijn van derden, worden actief onderhouden, en authentiseren via de eigen OAuth van elke service. In geen geval geven we de inloggegevens direct aan de PA — het zijn de MCP-servers die de authenticatie beheren, en wij autoriseren alleen de toegang vanuit de browser één keer bij de setup.

De blinde vlekken van MCP: IMAP-mail en Telegram

MCP dekt het oppervlak Google + Slack, maar laat twee belangrijke gaten open voor een assistent die "persoonlijk" wil zijn: de zakelijke e-mail via IMAP (de eigen mailserver van een bedrijf, geen Gmail), en de Telegram-berichten. Voor deze twee gaten hebben we eigen Python-scripts geschreven die fungeren als brug tussen de buitenwereld en Claude Code.

De IMAP-client is een set kleine scripts: mail_fetch.py, mail_read.py, mail_send.py, mail_flag.py. Elk doet één ding. Ze authentiseren tegen de mailbox van het bedrijfsdomein door de inloggegevens te lezen uit de macOS Keychain (nooit uit bestanden op schijf of persistente omgevingsvariabelen). Wanneer Claude Code de zakelijke e-mail moet lezen, roept het deze scripts aan als tools vanuit de sessie, op dezelfde manier waarop het een MCP zou aanroepen.

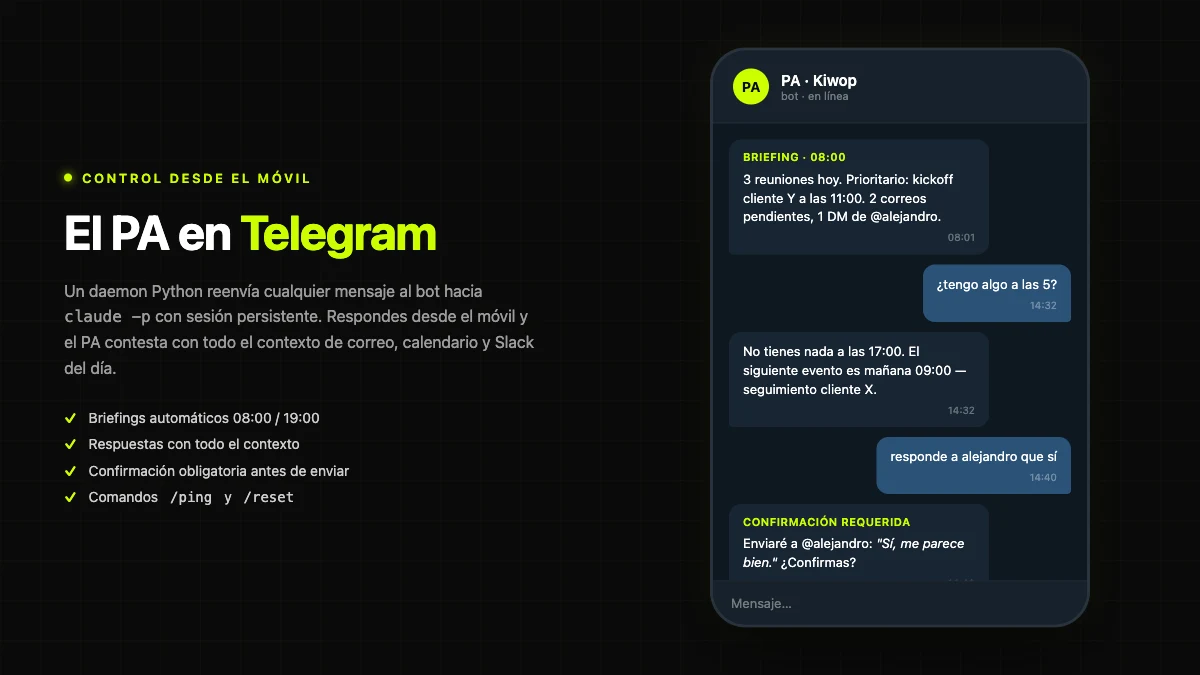

De Telegram-bot is het meest interessante component van PA. Het is een Python-daemon beheerd door launchd (het macOS-equivalent van systemd) dat wordt gestart bij sessiestart en alleen herstart als hij faalt. Wanneer er een bericht binnenkomt bij de bot vanaf de mobiel, geeft de daemon het door aan claude -p met persistente sessie, wacht op het antwoord, en formatteert het als Markdown compatibel met Telegram voordat hij het teruggeeft. Het resultaat is dat je met de PA kunt praten vanaf je mobiel alsof het een willekeurige chatbot is, maar daaronder wordt het antwoord gegenereerd door Claude met alle context van je e-mail en agenda van de dag.

De geplande briefings: cron + launchd

Twee geplande briefings sluiten het systeem: één om 08:00 ("morning") en één om 19:00 ("evening"). Ze worden getriggerd door cron, die het script run_briefing.sh uitvoert met het type briefing als argument. Dat script start een Claude Code-sessie met een specifieke prompt ("lees belangrijke ongelezen e-mails, raadpleeg de agenda van de dag, vat de prioriteiten samen") en slaat de uitvoer op in briefings/YYYY-MM-DD-morning.md. Als de Telegram-bot actief is, pusht hetzelfde script de briefing naar de chat zodat hij op de mobiel terechtkomt voor de dag begint.

Structuur van de repo

Deze hele machine leeft in ongeveer 20 Python-bestanden plus een handvol shell-scripts. Geen database, geen backend, geen Docker. De volledige broncode van de PA is kleiner dan een typisch React-component. Dit is bewust: hoe minder code, hoe minder onderhoud; en hoe minder abstractie, hoe makkelijker te debuggen wanneer er iets kapotgaat. Deze beslissing is consistent met wat we onze klanten aanbevelen in LLMOps: taalmodellen beheren in productie — operationele complexiteit doodt agenten vaker dan de complexiteit van het model.

OpenClaw versus PA: de eerlijke vergelijking

Het is geen competitie. OpenClaw blijft een completer product, met meer kanalen, met een actieve community en met een helder productroadmap. Als iemand ons in 2026 vraagt "ik wil een persoonlijke assistent met WeChat, LINE, iMessage en Discord tegelijk", is het eerlijke antwoord "kijk naar OpenClaw". Voor het geval "ik wil WhatsApp + Telegram + mail + agenda + Slack, draaiend op mijn Claude Max, met code die ik kan auditen en aanpassen", is het antwoord PA.

De keuze tussen de een en de ander is fundamenteel een keuze over hoeveel koppeling je wilt met een externe provider. OpenClaw geeft je meer out-of-the-box mogelijkheden in ruil voor afhankelijkheid van het OAuth-beleid van Anthropic of OpenAI. PA geeft je minder mogelijkheden, maar met de zekerheid dat zolang je Claude Max kunt betalen en de Gmail-service MCP blijft aanbieden, niets externs je van de ene op de andere dag zonder assistent kan laten.

Bouwen wij de jouwe? We ontwerpen en ontwikkelen persoonlijke AI-assistenten op maat voor professionals en directieleden. → Ontwikkeling van AI-agenten

Alternatief voor OpenClaw in 2026: wanneer het zinvol is om je eigen PA te bouwen

Men vraagt ons al met enige regelmaat of we op maat PA's zouden bouwen voor klanten. Het korte antwoord is ja, en we beginnen dat aan te bieden als onderdeel van de diensten van ontwikkeling van AI-agenten. Het lange antwoord vereist nuance over voor wie het zinvol is om een PA te bouwen en voor wie het overkill is.

Wanneer een PA bouwen zinvol is:

- Voor een professional die handmatig al meer dan 80 e-mails per dag verwerkt, verdeeld over meerdere accounts, en die 30-45 minuten per dag aan triage besteedt.

- Voor iemand die al Claude Code gebruikt in ontwikkeling en een Max-abonnement heeft, zodat de marginale kosten van de assistent effectief nul zijn.

- Voor rollen die 24/7 beschikbaarheid vereisen (oprichters, directieleden, zelfstandige advocaten, senior consultants) maar die geen menselijke PA kunnen rechtvaardigen vanwege kosten of discretie.

- Voor wie volledige controle wil over de data: de PA stuurt geen e-mails of agenda naar servers van derden buiten die van de LLM zelf.

Wanneer het NIET zinvol is:

- Voor een werknemer die al binnen Gmail/Outlook werkt en wiens bedrijf niet zou toestaan een externe LLM te koppelen aan het bedrijfsaccount. De barrière hier is politiek en van beveiliging, niet technisch — hoewel in dat scenario een project van enterprise RAG op gecontroleerde infrastructuur het juiste antwoord kan zijn.

- Voor agencies die "een PA willen die alle klanten beheert" — dat is geen PA, dat is een multi-tenant SaaS en de architecturale aanpak moet radicaal anders zijn.

- Voor wie nog geen Claude Max-abonnement of gelijkwaardig heeft: de economische berekening verandert veel als je API pay-as-you-go moet betalen.

- Voor wie een onfeilbare assistent verwacht. De PA in zijn huidige staat kan af en toe een e-mail missen in de triage, of een agenda-evenement verkeerd interpreteren. De regel van bevestiging vóór actie is precies om ons in te dekken tegen die fouten.

De bredere les, los van of je al dan niet je PA bouwt, is een andere: AI-agenten hangen economisch af van het facturatiemodel van de provider, en dat model kan veranderen. Anthropic veranderde het op 4 april. OpenAI heeft het meerdere keren gewijzigd sinds de lancering van ChatGPT Pro. Google past het zijn regelmatig aan. Elke agent-architectuur die je jaren wilt gebruiken moet dat risico voorzien, en het antwoord is niet technisch — het is strategisch. Dunne, ontkoppelde lagen bouwen tussen je logica en het model van de provider is wat je in staat stelt in 48 uur te pivoteren wanneer het beleid verandert.

Bij Kiwop noemen we het "provider-proof agenten". Het is geen methodologie met een commerciële naam: het is een ontwerpwijze die samen te vatten is in drie regels. Ten eerste, de lijm tussen de onderdelen is eigen code, nooit een framework van derden. Ten tweede, de prompts en flows staan in jouw bestanden, niet in een SaaS. Ten derde, je kunt het model wisselen met één enkel configuratiebestand, zonder de rest van het systeem aan te raken. PA voldoet aan alle drie. Als Anthropic morgen een andere deur zou sluiten, zou de brug naar OpenAI of Google ons een paar commits en een uur testen kosten, omdat alle engineering eromheen (MCPs, IMAP-scripts, Telegram-bot, launchd) modelagnostisch is.

Veelgestelde vragen

Wat is het beste alternatief voor OpenClaw in 2026?

Het beste alternatief hangt af van de use case. Voor wie al een Claude Max-abonnement heeft, is de meest economische optie om een eigen persoonlijke assistent te bouwen op Claude Code + MCP (nul marginale kosten). Voor wie een kant-en-klaar product verkiest, blijft OpenClaw geldig door "Extra Usage" van Anthropic te betalen of de OAuth te wijzigen naar ChatGPT/Codex. Voor gereguleerde zakelijke omgevingen raden we aan on-premise oplossingen of een enterprise RAG-project op gecontroleerde infrastructuur te evalueren.

Kan ik OpenClaw blijven gebruiken met mijn Claude Pro- of Max-abonnement?

Nee. Sinds 4 april 2026 werken de OAuth-tokens van Claude Pro en Claude Max niet meer met OpenClaw en met andere derde-partij harnesses. OpenClaw blijft werken, maar je moet het gebruik apart betalen via Extra Usage van Anthropic (API-tarieven) of via het OAuth-abonnement van OpenAI (ChatGPT/Codex). Voor klanten die een hoog volume verwerkten, is de kostensprong die door de community gerapporteerd werd significant geweest.

Wat is MCP (Model Context Protocol)?

MCP is de open standaard die Anthropic eind 2024 publiceerde zodat taalmodellen op een uniforme manier verbinding kunnen maken met tools, databases en externe API's. In 2026 wordt het ondersteund door de belangrijkste AI-clients — waaronder Claude Code, Cursor, Windsurf en anderen — en de lijst van beschikbare MCP-servers (Gmail, Calendar, Drive, Slack, Linear, GitHub, Notion, etc.) groeit week na week. De PA gebruikt MCP als de primaire route voor toegang tot Gmail, Google Calendar, Google Drive en Slack.

Hoeveel kost het om een eigen PA te bouwen?

Als je al een Claude Max x20-abonnement hebt (ongeveer 200 USD/maand), zijn de marginale kosten nul vanuit het oogpunt van het AI-model. De bouwtijd, als je het zelf doet vanaf nul, ligt rond de 20-30 uur verdeeld over een week. Als je het uitbesteedt aan een agency, hangt het af van de scope (welke kanalen, welke MCP-integraties, of voice vereist is of niet), maar voor de standaardscope van de PA beschreven in dit artikel schatten we tussen 4.000 en 7.000 euro aan constructie en een zeer laag onderhoud daarna.

Waarom Claude Code en niet OpenAI Codex?

Claude Code past beter bij het model van de persoonlijke assistent om twee zeer concrete redenen. Ten eerste, de kwaliteit van Opus 4.7 in taken van e-mailtriage en agendabeheer was superieur aan die van GPT-5 in onze interne tests in maart 2026 (kwalitatieve evaluatie, geen formele publiceerbare methodologie). Ten tweede, Claude Code is een first-party product van Anthropic en blijft gedekt door het Max-abonnement, terwijl het gebruik van Codex vanuit onze al opgezette stack dubbel abonnement (Max voor development, ChatGPT Pro voor PA) had betekend zonder duidelijke functionele winst.

Is de PA veilig voor vertrouwelijke e-mails?

De PA is zo veilig als de provider van het model waarmee je verbinding maakt. In het geval van Anthropic worden de verwerkte e-mails niet gebruikt om modellen te trainen (publiek beleid van Anthropic in 2026) en is de communicatie versleuteld. Dat gezegd hebbende, elke PA die gevoelige inhoud door een externe LLM laat gaan impliceert een daad van vertrouwen in die provider. Voor gereguleerde inhoud (gezondheidszorg, juridisch, financieel met beroepsgeheim) raden we aan de specifieke voorwaarden te bekijken en on-premise alternatieven te overwegen.

Kan WhatsApp worden geïntegreerd?

Op dit moment beschikt WhatsApp niet over een officiële MCP en de niet-officiële bridges (zoals degene die OpenClaw integreert) vereisen het onderhouden van een WhatsApp Business API-account of minder stabiele technieken. De PA in zijn huidige versie integreert WhatsApp niet native — we gebruiken Telegram als primair mobiel kanaal vanwege de stabiliteit. We evalueren de WhatsApp Cloud API MCP van Meta voor een tweede iteratie.

Kan de PA handelen zonder menselijk toezicht?

Naar ontwerp, nee. De regel van verplichte bevestiging vóór elke schrijfactie (e-mail verzenden, evenement aanmaken, Slack beantwoorden) is de kern van de veiligheid van de assistent. Een e-mail bekijken, agenda lezen, in Drive zoeken — dat zijn allemaal leesoperaties en hij doet ze zonder te bevestigen. Maar verzenden, aanmaken, verplaatsen, verwijderen — vereisen altijd een expliciete "ja" van de mens. Het is een bewuste architecturale beslissing: we verkiezen een PA die iets minder wendbaar is, maar die geen onomkeerbare fouten maakt.

Werkt deze architectuur op Windows of Linux?

Ja, met aanpassingen. De concepten (Claude Code + MCP + Python-scripts + Telegram-daemon) zijn overdraagbaar. Wat verandert is de procesmanager bij het opstarten: op macOS gebruiken we launchd, op Linux zou het systemd met user units zijn, en op Windows de Task Scheduler. De Keychain voor IMAP-inloggegevens heeft ook equivalenten op andere platforms (Secret Service op Linux, Credential Manager op Windows).

Conclusie: AI-agenten en providerrisico

De beleidswijziging van Anthropic op 4 april 2026 heeft ons een gunst bewezen. Hij dwong ons om ons af te vragen of we een kritiek onderdeel van onze dagelijkse productiviteit wilden blijven uitbesteden aan een project van derden, hoe briljant ook, terwijl we alle onderdelen hadden om het zelf te bouwen op een stack die we al beheersten. Het antwoord, met twee weken perspectief, is duidelijk: dat wilden we niet. En we willen het niet, voor geen enkele kritieke laag van ons werk.

De les is niet "jullie zouden allemaal je PA moeten bouwen". De les is dat in 2026, met steeds meer capabele AI-modellen en met MCP die zich consolideert als de integratiestandaard, de afstand tussen het gebruik van een agent van derden en het bouwen van je eigen agent drastisch is verkleind. Wat in 2023 een team van drie ingenieurs gedurende drie maanden had vereist, is vandaag ongeveer 500 regels Python en een middag setup. Die ingestorte barrière is wat de huidige golf van toegepaste AI definieert — en wat het best verklaart waarom software-agencies in 2026 in een zo andere positie zitten dan twee jaar geleden.

Als je overweegt om je eigen persoonlijke assistent op te zetten, of als je hulp nodig hebt bij het bouwen van robuuste AI-agenten voor je team of bedrijf, bij Kiwop — Digital Agency gespecialiseerd in Softwareontwikkeling en toegepaste Kunstmatige Intelligentie voor wereldwijde klanten in Europa en de VS — bieden we op maat gemaakte ontwikkeling van AI-agenten en AI-consultancy voor productiecontexten. De PA die we hier beschrijven is het beste levende voorbeeld van hoe we het voor onszelf doen.