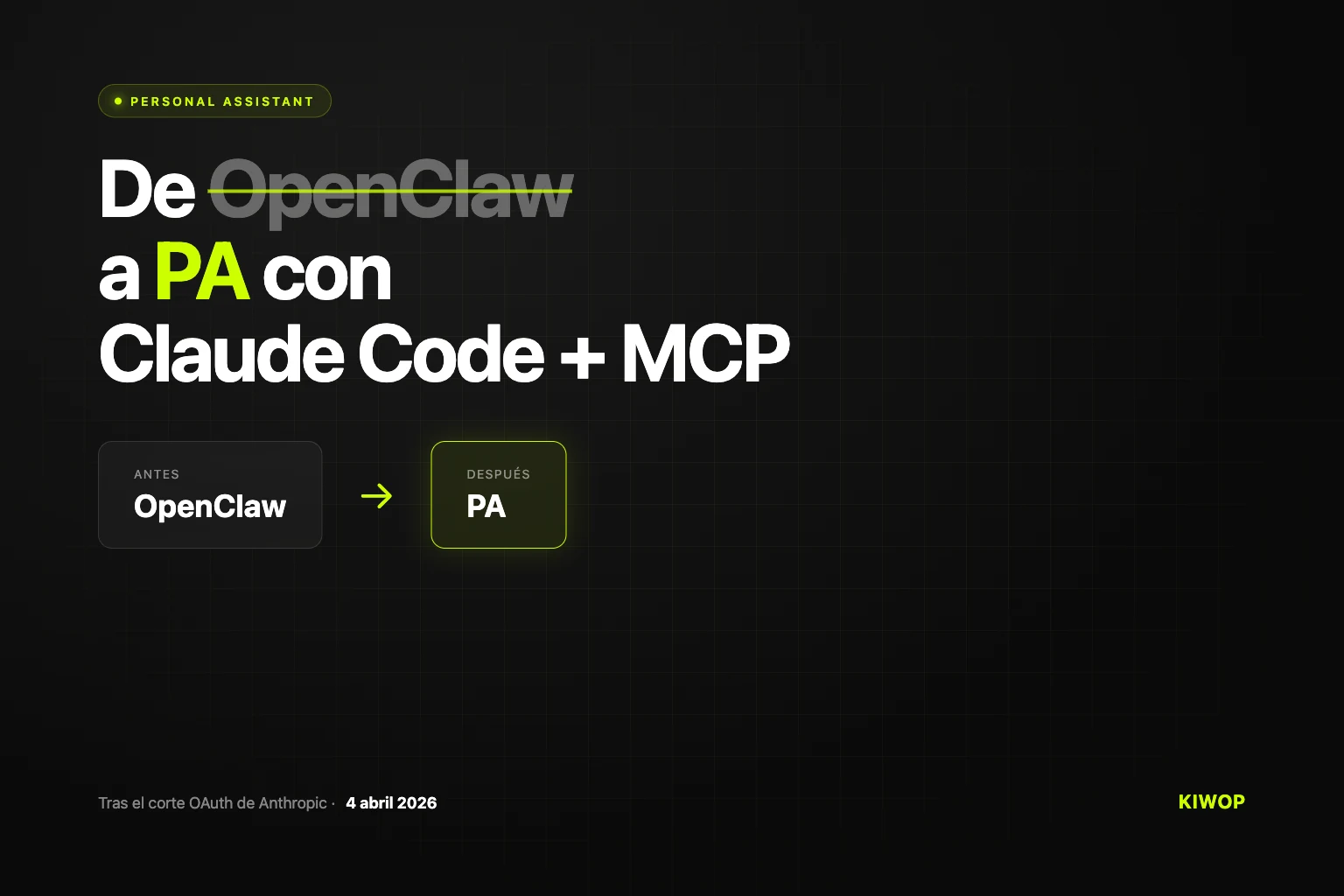

Alternative à OpenClaw : assistant personnel avec Claude Code et MCP après la coupure d'Anthropic (avril 2026)

Par l'équipe de Kiwop · Agence Digitale spécialisée en Développement Logiciel et Intelligence Artificielle appliquée · Publié le 19 avril 2026 · Dernière mise à jour : 19 avril 2026

TL;DR — Le 4 avril 2026, Anthropic a désactivé les tokens OAuth qui permettaient à OpenClaw d'utiliser les abonnements Claude Max et Claude Pro. Les utilisateurs affectés ont trois options : payer l'« Extra Usage » au tarif API (entre 5 et 50 fois plus cher), migrer vers OpenAI Codex, ou reconstruire l'assistant personnel sur Claude Code + MCP. Chez Kiwop, nous avons choisi la troisième voie et nous documentons ici l'architecture qui en résulte — un PA avec quatre canaux (IMAP, Gmail, Slack, Telegram), environ 500 lignes de Python maison, et un coût marginal nul en restant dans l'abonnement Max.

Chez Kiwop, il nous a fallu 48 heures pour décider quoi faire après l'annonce d'Anthropic. Cet article raconte cette décision — pourquoi nous ne sommes pas passés à OpenAI Codex, pourquoi nous n'avons pas payé l'« Extra Usage » d'Anthropic, et comment nous avons reconstruit notre assistant personnel (PA) sur Claude Code et Model Context Protocol (MCP). Un assistant qui continue de tourner sur le même abonnement Claude Max x20, avec les mêmes canaux que nous utilisions auparavant, mais avec une différence fondamentale : le stack est à nous, le code est à nous et le fournisseur ne peut pas nous tirer le tapis sous les pieds.

Ce n'est pas un manifeste anti-Anthropic — nous continuons d'utiliser leurs modèles au quotidien et nous pensons qu'ils sont les meilleurs du marché pour une agence en 2026. C'est une lecture analytique de ce qui se passe lorsque le modèle économique d'un agent dépendait d'une politique d'un fournisseur, que cette politique change, et qu'il faut décider de s'adapter ou de reconstruire.

Qu'est-ce qu'un PA et pourquoi le mot « Personnel » compte

Un Personal Assistant (PA) est un assistant IA qui s'occupe d'une seule personne en centralisant ses e-mails, son calendrier, ses messages et ses documents dans une interface conversationnelle. Contrairement à un SaaS multi-tenant, un PA tourne dédié à un unique humain avec un accès exclusif à ses comptes. Cette définition, apparemment évidente, est celle qui sépare un PA bien conçu d'un outil commercial déguisé.

La distinction n'est pas pédante. Un humain en 2026 peut avoir trois ou quatre adresses e-mail (celle du travail, celle d'un projet parallèle, la personnelle), deux ou trois numéros de WhatsApp, des comptes Slack dans différents workspaces, et une demi-douzaine de calendriers synchronisés. Un PA centralise toute cette surface et la convertit en une unique interface conversationnelle qui comprend qui vous êtes et ce qui vous importe. Non parce qu'il est entraîné pour vous, mais parce qu'il tourne pour vous et seulement pour vous, avec accès à vos comptes, vos fils, vos préférences.

C'est la promesse d'un PA, et c'est celle qui nous a fait adopter OpenClaw en janvier. Et c'est aussi celle qui nous a fait décider, en avril, de le reconstruire nous-mêmes lorsque l'économie du fournisseur a changé.

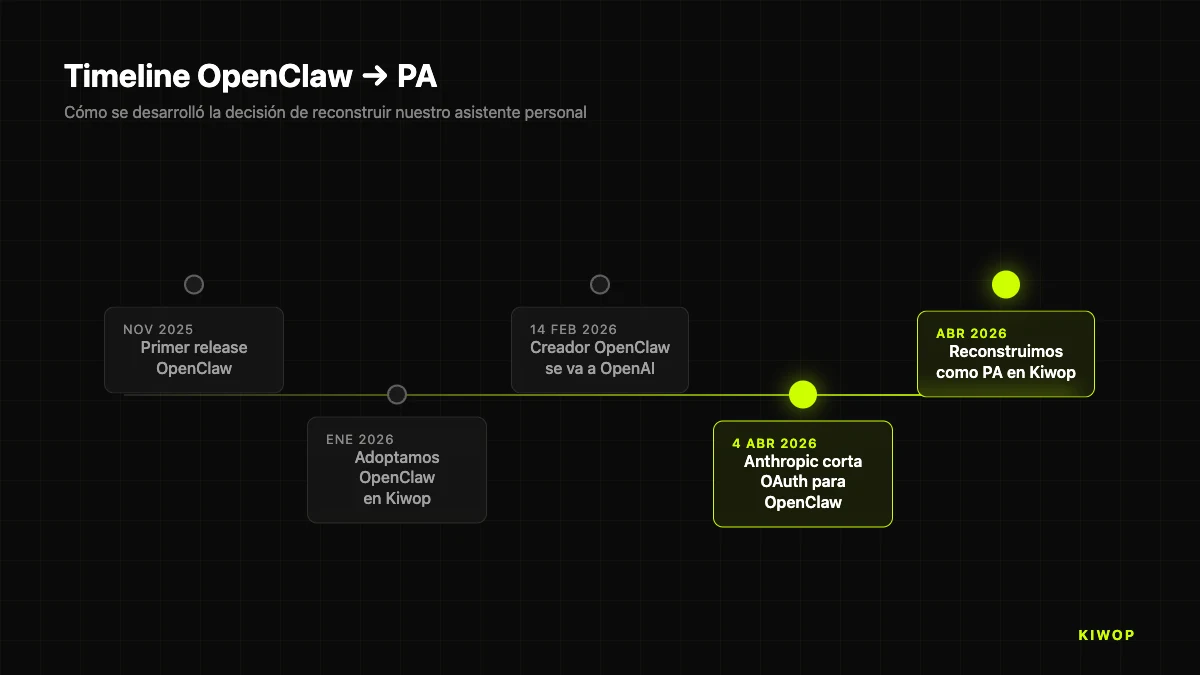

Pourquoi nous avons choisi OpenClaw comme assistant personnel IA en janvier 2026

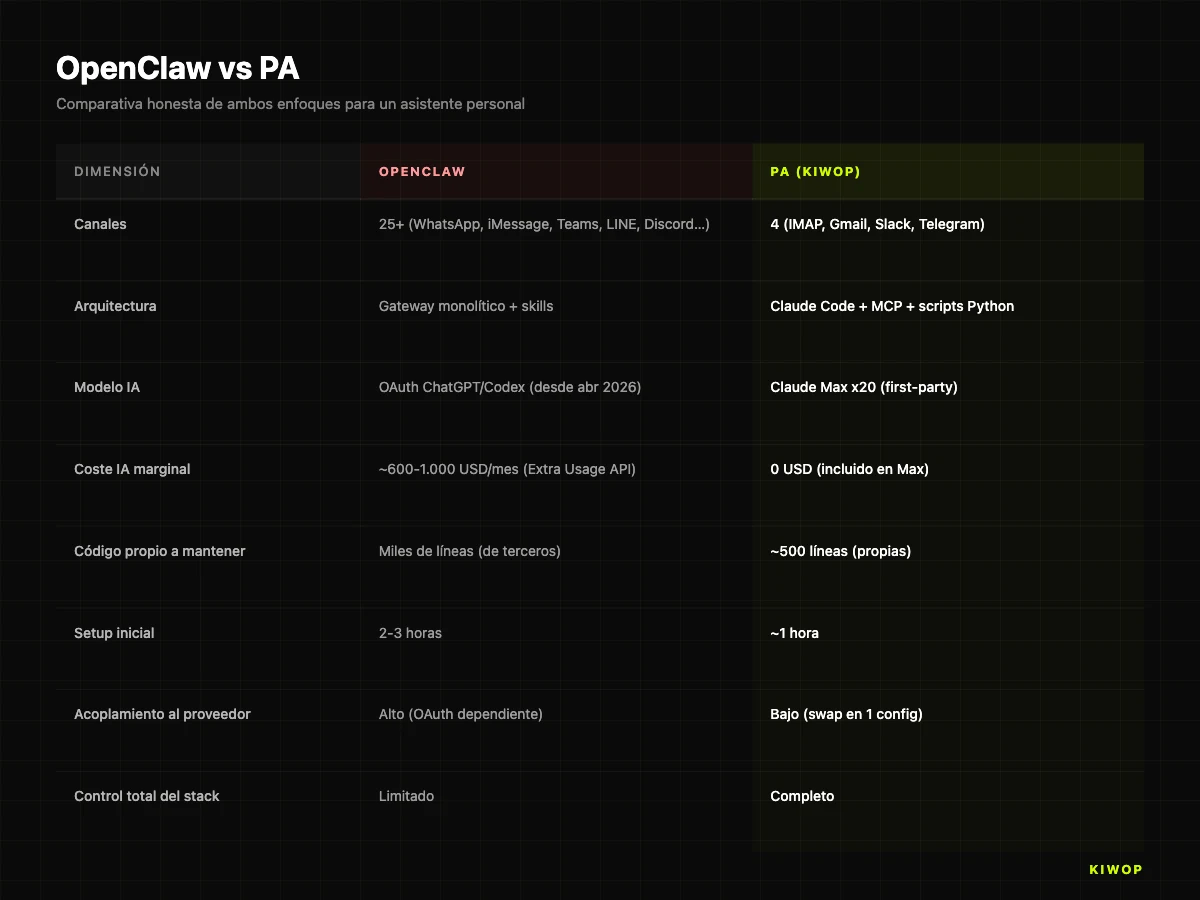

OpenClaw est un assistant personnel IA open source lancé fin 2025 qui se connecte à des canaux comme WhatsApp, Telegram, Slack et plus de vingt plateformes de messagerie en utilisant un Gateway central et un système de skills extensibles. Le projet tourne sur votre propre machine (local, VPS, ou fly.io) et, jusqu'en avril 2026, supportait OAuth contre l'abonnement Claude Max — cela signifiait que toutes les interactions étaient comptabilisées contre le plan Max x20 que nous payions déjà. La liste des canaux supportés inclut Discord, Google Chat, Signal, iMessage, Teams, Matrix, Feishu, LINE, Mattermost, Nextcloud Talk, Nostr, Synology Chat, Tlon, Twitch, Zalo, WeChat et WebChat, entre autres.

Le calcul économique fin janvier était simple. Nous avions un abonnement Claude Max x20 (environ 200 dollars par mois) que nous utilisions déjà intensivement pour Claude Code en développement. Y ajouter un assistant personnel qui traitait les e-mails, lisait Slack, répondait aux messages Telegram, et faisait des briefings matinaux n'allait pas générer de coût additionnel significatif, car les limites de l'abonnement en donnaient largement assez. Pour 200 dollars par mois, nous avions un développeur IA senior pendant la journée et un assistant personnel pendant la matinée et l'après-midi.

OpenClaw a tenu pendant janvier, février et mars. Chaque matin à huit heures, un briefing avec mon agenda et mes e-mails prioritaires atterrissait sur Telegram. Je pouvais répondre au bot depuis le mobile et mon message partait vers Claude avec tout le contexte des e-mails et du calendrier. Je pouvais lui demander depuis WhatsApp « est-ce que j'ai quelque chose à cinq heures ? » et il répondait correctement. C'était, pour être honnêtes, le produit le plus utile de la saison pour la productivité quotidienne.

Mais le 4 avril, tout a changé.

Le 4 avril 2026 : ce qui a changé exactement

Ce jour-là, Anthropic a annoncé que les tokens OAuth de Claude Max et Claude Pro cesseraient de fonctionner avec les « harnesses tiers » — un terme qui dans l'industrie inclut OpenClaw, Crush, Aider, et d'autres clients qui jusque-là se connectaient à Claude en utilisant les identifiants d'abonnement de l'utilisateur. La couverture médiatique a été immédiate : TechCrunch, VentureBeat, The Register et Hacker News ont couvert la nouvelle, avec des fils très actifs d'utilisateurs signalant des hausses de coût significatives après le changement.

L'explication officielle d'Anthropic a cité « la pression sur nos ressources de calcul et d'ingénierie, et le désir de servir de manière fiable un grand nombre d'utilisateurs ». La lecture technique et économique est plus intéressante.

Un abonnement Claude Max x20, techniquement, est un contrat avec des limites élastiques : Anthropic vous facture un tarif forfaitaire et vous donne une limite d'usage généreuse que la plupart des clients ne consomment pas entièrement. Ce modèle fonctionne quand les sessions sont lancées par un humain devant le clavier : les usages sont intermittents, les pauses sont fréquentes, et la consommation réelle reste bien en dessous du plafond. Quand vous mettez un agent autonome multi-canal entre l'humain et le modèle — comme le fait OpenClaw — la consommation s'envole de manière très prévisible : chaque message entrant déclenche un appel, chaque réponse en déclenche un autre, et 24 heures par jour il y a du trafic même quand l'humain dort.

Multiplié par la base installée estimée d'OpenClaw à l'échelle mondiale, le coût compute pour Anthropic était insoutenable dans le prix de l'abonnement. La solution du fournisseur a été de séparer les deux mondes : Claude.ai, Claude Code et Claude Cowork restent couverts par Max/Pro, mais tout ce qui passe par des harnesses tiers est désormais facturé via l'« Extra Usage » au tarif API.

Pour un utilisateur comme nous, qui traitait entre 300 et 500 interactions quotidiennes avec le PA (briefings, e-mails, triages, réponses depuis le mobile), la nouvelle facture projetée avec Extra Usage passait de « inclus dans les 200 dollars du Max » à environ 800-1 200 dollars mensuels supplémentaires. Ce n'était pas assumable. Ce n'était pas non plus justifiable, étant donné que le même travail continuait de tenir largement dans le plan Max si nous l'exécutions depuis Claude Code directement.

La question était alors : comment faire tourner un assistant personnel multi-canal dans Claude Code ?

Claude Code vs OpenAI Codex comme moteur pour votre assistant personnel

La première tentation a été de passer OpenClaw à un autre fournisseur. OpenClaw supporte OAuth contre ChatGPT et Codex, et Peter Steinberger — créateur du projet — avait annoncé en février qu'il rejoignait OpenAI. Passer l'assistant pour tourner sur un abonnement ChatGPT Pro ou un plan Codex était techniquement une question de changer l'authentication profile.

Nous avons écarté cette voie pour trois raisons.

La première, la qualité du modèle pour les tâches qui nous importent. À ce jour, en triage d'e-mails, résumé de fils Slack, et extraction d'information de calendrier, les modèles d'Anthropic (en particulier Opus 4.7) nous donnaient systématiquement de meilleurs résultats que GPT-5 sur le même prompt. Ce n'est pas une opinion générique — nous l'avons évalué pendant le mois de mars en faisant tourner les mêmes briefings par les deux fournisseurs et en comparant les sorties qualitativement, sans méthodologie formelle publiable mais avec des critères cohérents appliqués par le même relecteur. La conclusion pour notre cas d'usage (gestion d'e-mails en espagnol et en catalan, avec du vocabulaire technique d'agence) a été claire en faveur d'Anthropic. Votre kilométrage peut varier — nous vous recommandons de faire votre propre évaluation avec vos propres prompts avant de choisir un fournisseur.

La deuxième, le lock-in avec un fournisseur qui venait de démontrer des changements unilatéraux de politique. Si Anthropic pouvait fermer l'OAuth aux tiers avec quinze jours de préavis, n'importe quel autre fournisseur pouvait faire de même. La leçon n'était pas « changez de fournisseur », la leçon était « n'attachez pas votre infrastructure critique quotidienne à des décisions extérieures sur les modèles de facturation ». Déplacer OpenClaw vers OpenAI, c'était soigner le symptôme sans traiter la cause.

La troisième, et la plus importante : Claude Code était déjà dans le stack. Nous l'utilisions chaque jour pour programmer avec l'IA en agence. Il avait des serveurs MCP connectés. Il savait lire nos bases de données, exécuter des scripts, déployer en production. Si au lieu de traiter l'assistant personnel comme un projet séparé nous le traitions comme un « usage de plus » de Claude Code — avec son propre CLAUDE.md, ses propres MCP, ses propres commandes — nous pouvions réutiliser absolument toute l'infrastructure. Et le plus important : cet usage restait couvert par l'abonnement Max x20 car Claude Code est un produit first-party d'Anthropic, pas un tiers.

La décision a été prise en un après-midi. Le nom du projet : PA, direct et littéral.

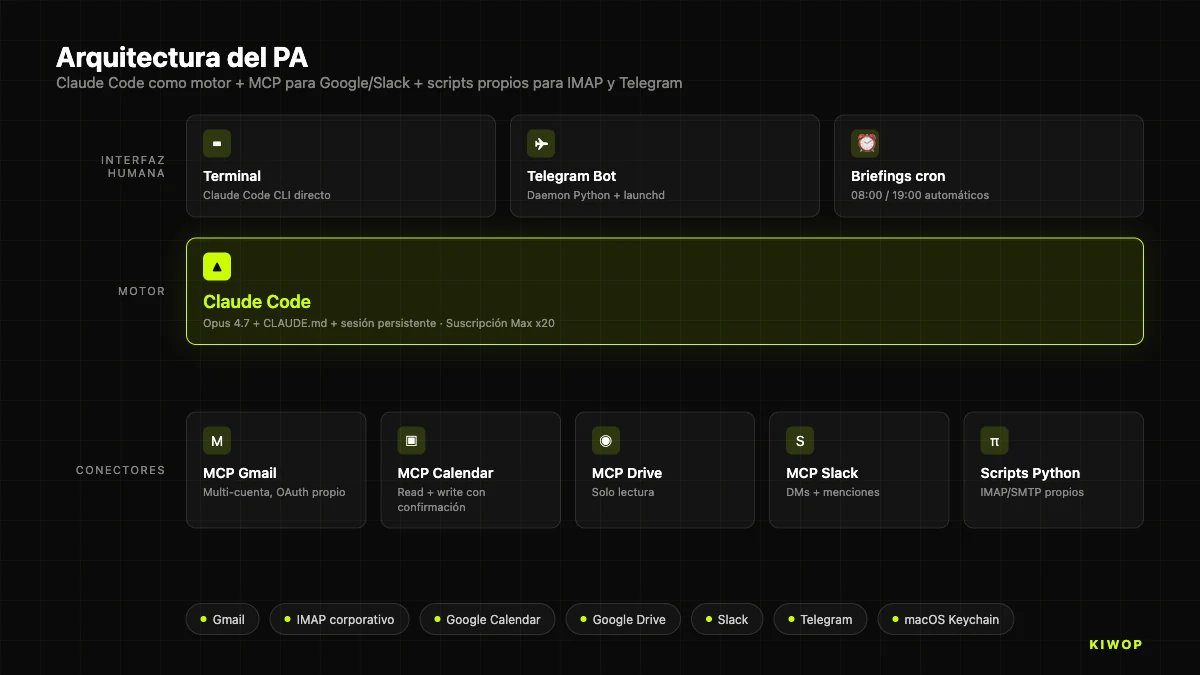

Architecture de l'assistant personnel avec Claude Code et serveurs MCP

Le PA tourne dans un répertoire propre (~/Dev/PA) avec une structure simple mais délibérée. Ce n'est pas une application fermée : c'est un ensemble de scripts Python, de configurations Claude Code et un bot Telegram qui conversent entre eux à travers le système d'exploitation. La philosophie est l'opposée d'OpenClaw, qui intègre tout dans un Gateway monolithique. Dans PA, chaque pièce fait une seule chose et la colle, c'est Unix.

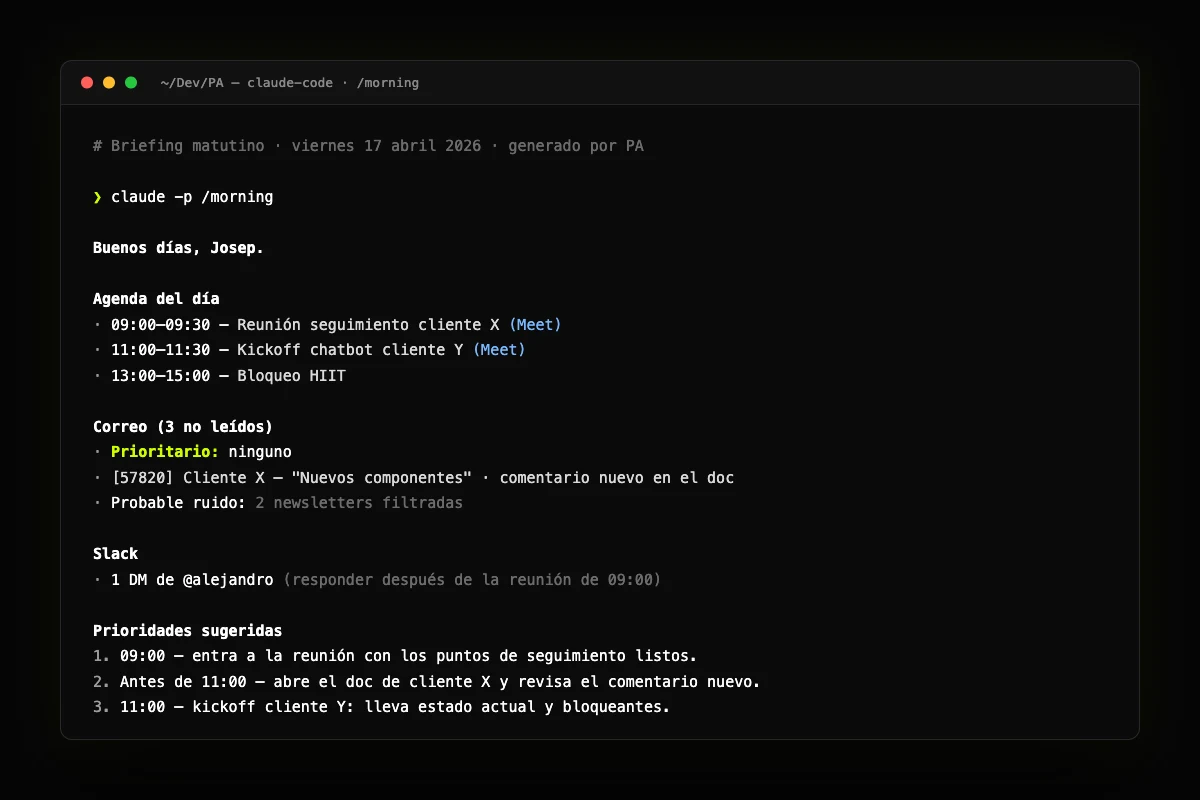

La base : Claude Code comme moteur conversationnel

Claude Code est le cerveau. Pas un chatbot, pas une API, mais le CLI complet d'Anthropic tournant en mode « projet » avec un répertoire dédié et son propre fichier CLAUDE.md qui définit la persona, la langue par défaut (catalan dans notre cas), et la règle de confirmation obligatoire avant d'envoyer des e-mails ou de créer des événements. Cette règle est non négociable : le PA ne touche jamais à rien sans demander d'abord.

Chaque fois que nous interagissons avec le PA, que ce soit par terminal, par commande programmée, ou par le bot Telegram, ce qui se passe à l'intérieur est une session de claude -p avec contexte persistant. Cela signifie que la mémoire de l'assistant ne vit pas dans un stockage externe capricieux : elle vit dans le propre flux de session de Claude Code, avec les mêmes garanties de cache et de réinjection que nous utilisons quand nous développons.

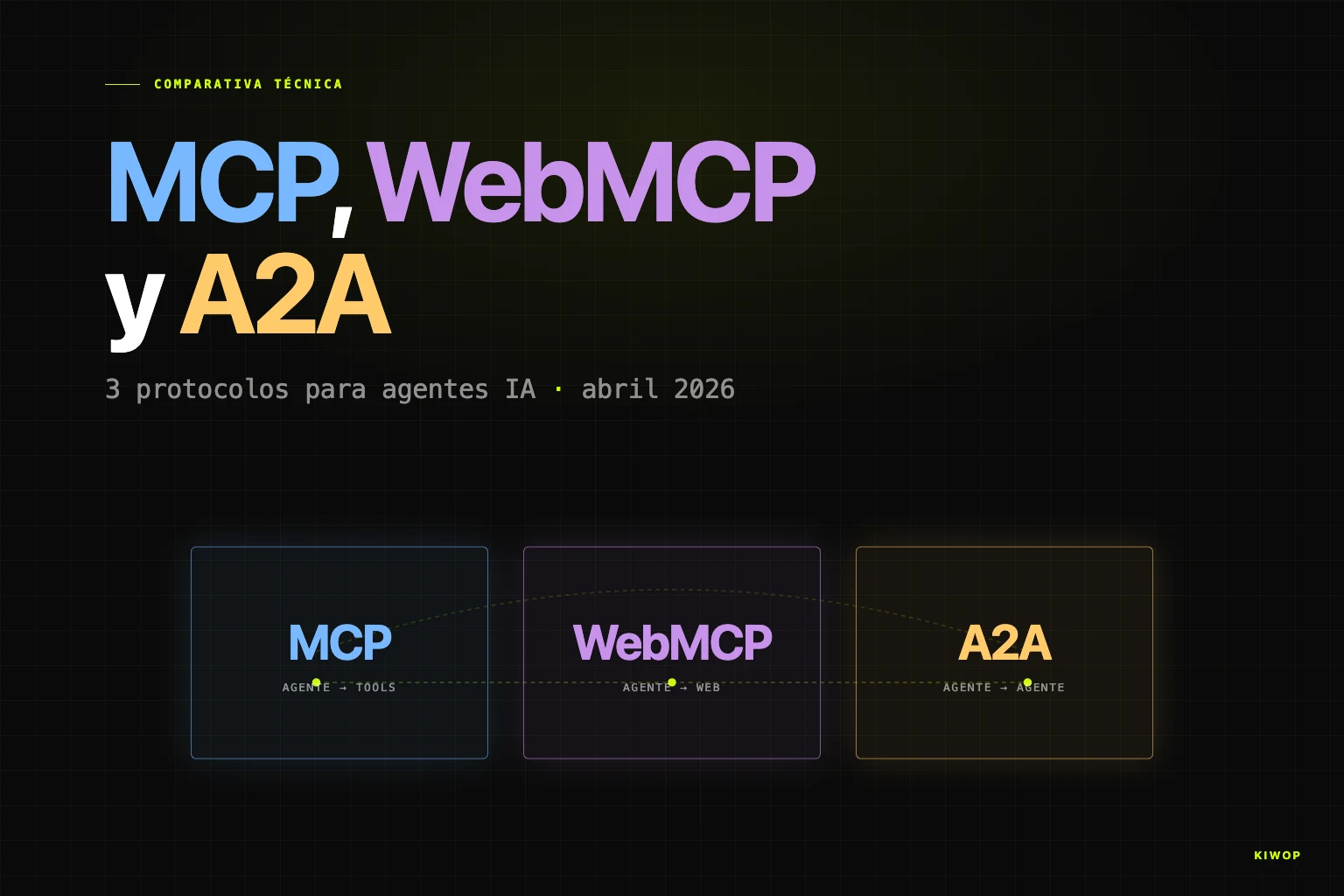

Les connecteurs : MCP pour tout ce qui est externe

Pour accéder au monde extérieur, le PA utilise MCP — Model Context Protocol — le standard ouvert qu'Anthropic a publié en 2024 et qui est devenu le langage commun des agents IA en 2026. Si vous voulez comprendre ce qu'est MCP et pourquoi cela compte tant, l'article WebMCP : votre site web préparé pour les agents IA entre dans le détail technique. MCP est la pièce qui permet à Claude Code de se connecter à des systèmes d'entreprise via intégration de LLM sans réécrire des connecteurs sur mesure pour chaque service.

Dans le cas du PA, les connecteurs MCP actifs sont :

- Gmail MCP : lire, rédiger, envoyer des e-mails depuis les multiples adresses d'une même personne (le compte professionnel d'agence, le compte personnel, le compte d'un projet parallèle). Lecture toujours ; écriture uniquement avec confirmation.

- Google Calendar MCP : consulter l'agenda, créer et déplacer des événements. Aussi avec confirmation.

- Google Drive MCP : recherche et lecture de documents à la demande. Lecture seule.

- Slack MCP : lire les DM et les mentions, répondre avec confirmation.

Tous ces connecteurs sont tiers, maintenus activement, et s'authentifient par OAuth propre à chaque service. En aucun cas nous ne passons les identifiants au PA directement — ce sont les serveurs MCP qui gèrent l'authentification, et nous autorisons seulement l'accès depuis le navigateur une seule fois au setup.

Les angles morts de MCP : e-mail IMAP et Telegram

MCP couvre la surface Google + Slack, mais laisse deux trous importants pour un assistant qui prétend être « personnel » : l'e-mail corporate sur IMAP (le serveur de mail propre à une entreprise, pas Gmail), et les messages Telegram. Pour ces deux trous, nous avons écrit des scripts Python maison qui agissent comme pont entre le monde extérieur et Claude Code.

Le client IMAP est un ensemble de petits scripts : mail_fetch.py, mail_read.py, mail_send.py, mail_flag.py. Chacun fait une chose. Ils s'authentifient contre la boîte aux lettres du domaine de l'entreprise en lisant les identifiants depuis le Keychain de macOS (jamais depuis des fichiers sur disque ou des variables d'environnement persistantes). Quand Claude Code a besoin de lire l'e-mail corporate, il invoque ces scripts comme des outils depuis la session, de la même manière qu'il invoquerait un MCP.

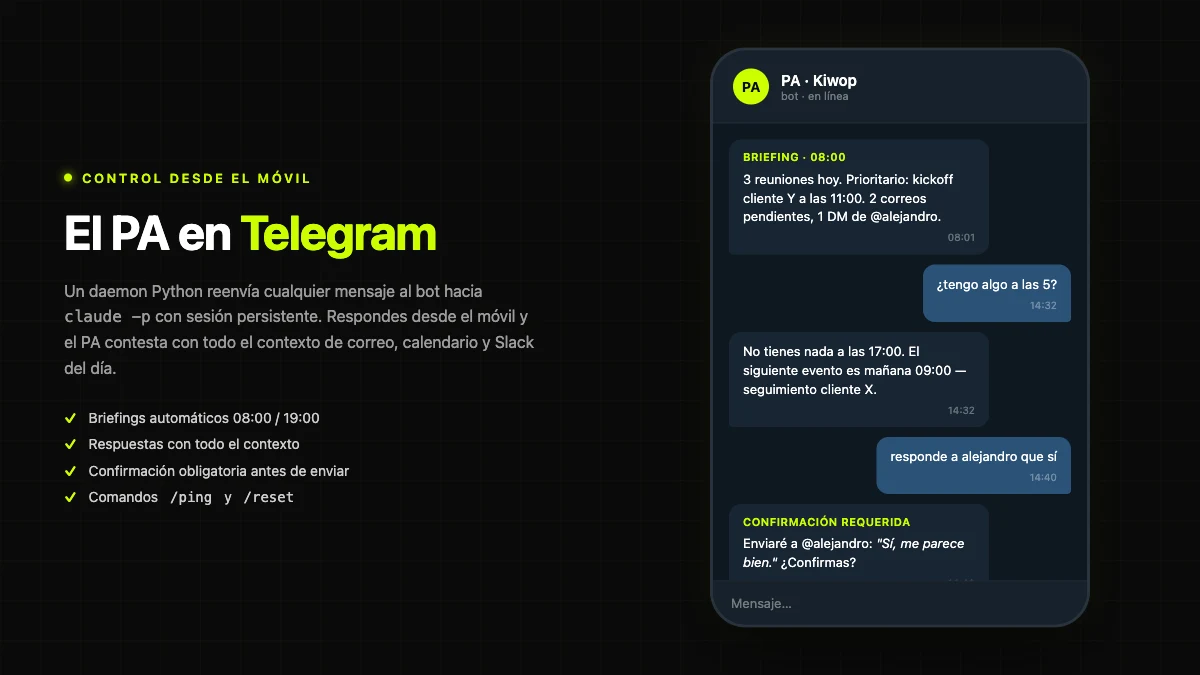

Le bot Telegram est le composant le plus intéressant de PA. C'est un daemon Python géré par launchd (l'équivalent macOS de systemd) qui démarre à l'ouverture de session et se redémarre tout seul s'il plante. Quand un message arrive au bot depuis le mobile, le daemon le passe à claude -p avec session persistante, attend la réponse, et la formate en Markdown compatible avec Telegram avant de la renvoyer. Le résultat est que vous pouvez parler au PA depuis le mobile comme s'il s'agissait de n'importe quel chatbot, mais en dessous la réponse est générée par Claude avec tout le contexte de votre e-mail et de votre calendrier du jour.

Les briefings programmés : cron + launchd

Deux briefings programmés ferment le système : un à 08h00 (« morning ») et un autre à 19h00 (« evening »). Ils sont déclenchés par cron, qui exécute le script run_briefing.sh en lui passant le type de briefing. Ce script lance une session de Claude Code avec un prompt spécifique (« lis les e-mails non lus importants, consulte le calendrier du jour, résume les priorités ») et enregistre la sortie dans briefings/YYYY-MM-DD-morning.md. Si le bot Telegram est actif, le même script pousse le briefing dans le chat pour qu'il atterrisse sur le mobile avant de commencer la journée.

Structure du repo

Toute cette machine vit dans une vingtaine de fichiers Python plus une poignée de scripts shell. Aucune base de données, aucun backend, aucun Docker. Le code source complet du PA est plus petit qu'un composant React typique. C'est délibéré : moins de code, moins de maintenance ; et moins d'abstraction, plus facile à déboguer quand quelque chose casse. Cette décision est cohérente avec ce que nous recommandons à nos clients dans LLMOps : gérer les modèles de langage en production — la complexité opérationnelle tue les agents plus que la complexité du modèle.

OpenClaw vs PA : la comparaison honnête

Ce n'est pas une compétition. OpenClaw reste un produit plus complet, avec plus de canaux, une communauté active et une feuille de route produit claire. Si quelqu'un nous demande en 2026 « je veux un assistant personnel avec WeChat, LINE, iMessage et Discord simultanés », la réponse honnête est « regardez OpenClaw ». Pour le cas « je veux WhatsApp + Telegram + e-mail + calendrier + Slack, tournant sur mon Claude Max, avec du code que je peux auditer et modifier », la réponse est PA.

Le choix entre l'un et l'autre est fondamentalement un choix sur combien de couplage vous voulez avec un fournisseur externe. OpenClaw vous donne plus de capacités out-of-the-box en échange d'une dépendance aux politiques OAuth d'Anthropic ou d'OpenAI. PA vous donne moins de capacités mais avec la certitude que tant que vous pouvez payer Claude Max et que le service Gmail continue d'offrir MCP, rien d'extérieur ne peut vous laisser sans assistant du jour au lendemain.

Nous construisons le vôtre ? Nous concevons et développons des assistants personnels IA sur mesure pour professionnels et dirigeants. → Développement d'agents IA

Alternative à OpenClaw en 2026 : quand cela a du sens de construire votre propre PA

On nous demande déjà assez fréquemment si nous construirions des PA sur mesure pour des clients. La réponse courte est oui, et nous commençons à l'offrir dans le cadre des services de développement d'agents IA. La réponse longue nécessite de nuancer pour qui il a du sens de construire un PA et pour qui c'est un excès.

Quand construire un PA a du sens :

- Pour un professionnel qui traite déjà manuellement plus de 80 e-mails par jour répartis sur plusieurs comptes, et qui consacre 30 à 45 minutes quotidiennes au triage.

- Pour quelqu'un qui utilise déjà Claude Code en développement et a un abonnement Max, de sorte que le coût marginal de l'assistant est effectivement nul.

- Pour des rôles qui exigent une disponibilité 24/7 (fondateurs, dirigeants, avocats indépendants, consultants senior) mais qui ne peuvent pas justifier de recruter un humain PA pour des raisons de coût ou de discrétion.

- Pour qui veut un contrôle total sur les données : le PA n'envoie ni e-mails ni calendrier à des serveurs tiers au-delà de ceux du LLM lui-même.

Quand cela N'a PAS de sens :

- Pour un employé qui travaille déjà dans Gmail/Outlook et dont l'entreprise n'autoriserait pas la connexion d'un LLM externe au compte corporate. La barrière ici est politique et de sécurité, non technique — bien que dans ce scénario un projet de RAG d'entreprise sur infrastructure contrôlée puisse être la bonne réponse.

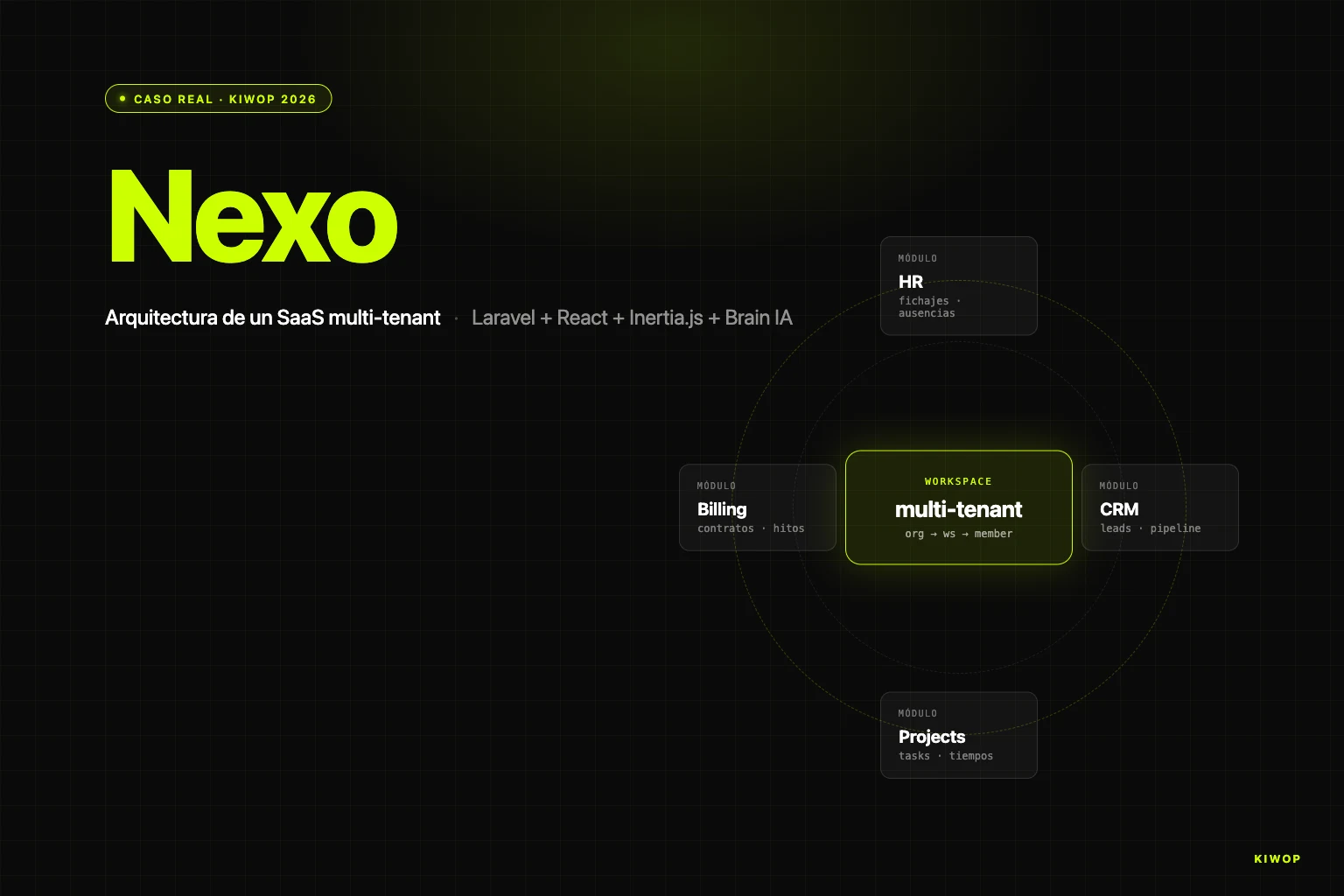

- Pour des agences qui veulent « un PA qui gère tous les clients » — ce n'est pas un PA, c'est un SaaS multi-tenant et l'approche architecturale doit être radicalement différente.

- Pour qui n'a pas déjà un abonnement Claude Max ou équivalent : le calcul économique change beaucoup s'il faut payer une API pay-as-you-go.

- Pour qui attend un assistant infaillible. Le PA dans son état actuel peut occasionnellement perdre un e-mail dans le triage, ou mal interpréter un événement de calendrier. La règle de confirmation avant d'agir est précisément pour nous couvrir face à ces défaillances.

La leçon plus large, au-delà de si vous construisez ou non votre PA, est autre : les agents IA dépendent économiquement du modèle de facturation du fournisseur, et ce modèle peut changer. Anthropic l'a changé le 4 avril. OpenAI a changé le sien à plusieurs reprises depuis le lancement de ChatGPT Pro. Google ajuste le sien régulièrement. Toute architecture d'agent que vous voulez utiliser pendant des années doit prévoir ce risque, et la réponse n'est pas technique — elle est stratégique. Construire des couches fines et découplées entre votre logique et le modèle du fournisseur est ce qui vous permet de pivoter en 48 heures quand la politique change.

Chez Kiwop, nous appelons cela « agents à l'épreuve du fournisseur ». Ce n'est pas une méthodologie au nom commercial : c'est une façon de concevoir qui se résume en trois règles. Premièrement, la colle entre les pièces est du code propre, jamais un framework tiers. Deuxièmement, les prompts et les flux sont dans vos fichiers, pas dans un SaaS. Troisièmement, vous pouvez changer le modèle avec un unique fichier de configuration, sans toucher au reste du système. PA respecte les trois. Si demain Anthropic fermait une autre porte, le pont vers OpenAI ou Google nous coûterait quelques commits et une heure de testing, car toute l'ingénierie autour (MCP, scripts IMAP, bot Telegram, launchd) est agnostique au modèle.

Questions fréquentes

Quelle est la meilleure alternative à OpenClaw en 2026 ?

La meilleure alternative dépend du cas d'usage. Pour qui a déjà un abonnement Claude Max, l'option la plus économique est de construire un assistant personnel propre sur Claude Code + MCP (coût marginal nul). Pour qui préfère un produit prêt à l'emploi, OpenClaw reste valide en payant l'« Extra Usage » d'Anthropic ou en changeant l'OAuth vers ChatGPT/Codex. Pour des environnements corporate régulés, nous recommandons d'évaluer des solutions on-premise ou un projet RAG d'entreprise sur infrastructure contrôlée.

Puis-je continuer à utiliser OpenClaw avec mon abonnement Claude Pro ou Max ?

Non. Depuis le 4 avril 2026, les tokens OAuth de Claude Pro et Claude Max ont cessé de fonctionner avec OpenClaw et avec d'autres harnesses tiers. OpenClaw continue de fonctionner, mais vous devez payer l'usage séparément via l'Extra Usage d'Anthropic (tarifs API) ou via l'abonnement OAuth d'OpenAI (ChatGPT/Codex). Pour les clients qui traitaient un volume élevé, le saut de coût rapporté par la communauté a été significatif.

Qu'est-ce que MCP (Model Context Protocol) ?

MCP est le standard ouvert publié par Anthropic fin 2024 pour que les modèles de langage se connectent à des outils, bases de données et API externes de manière uniforme. En 2026, il est supporté par les principaux clients IA — y compris Claude Code, Cursor, Windsurf et d'autres — et la liste de serveurs MCP disponibles (Gmail, Calendar, Drive, Slack, Linear, GitHub, Notion, etc.) s'allonge de semaine en semaine. Le PA utilise MCP comme voie principale d'accès à Gmail, Google Calendar, Google Drive et Slack.

Combien coûte la construction d'un PA propre ?

Si vous avez déjà un abonnement Claude Max x20 (environ 200 USD/mois), le coût marginal est nul du point de vue du modèle IA. Le temps de construction, si vous le faites vous-même en partant de zéro, tourne autour de 20-30 heures réparties sur une semaine. Si vous le sous-traitez à une agence, cela dépend du périmètre (quels canaux, quelles intégrations MCP, s'il requiert la voix ou non), mais pour le périmètre standard du PA décrit dans cet article nous estimons entre 4 000 et 7 000 euros de construction et une maintenance ultérieure très faible.

Pourquoi Claude Code et pas OpenAI Codex ?

Claude Code s'intègre mieux avec le modèle d'assistant personnel pour deux raisons très concrètes. Premièrement, la qualité d'Opus 4.7 sur les tâches de triage d'e-mails et de gestion de calendrier était supérieure à celle de GPT-5 dans nos tests internes à mars 2026 (évaluation qualitative, pas de méthodologie formelle publiable). Deuxièmement, Claude Code est un produit first-party d'Anthropic et reste couvert par l'abonnement Max, tandis qu'utiliser Codex depuis notre stack déjà monté aurait signifié payer un double abonnement (Max pour le développement, ChatGPT Pro pour le PA) sans gain fonctionnel clair.

Le PA est-il sûr pour des e-mails confidentiels ?

Le PA est aussi sûr que le fournisseur du modèle auquel vous vous connectez. Dans le cas d'Anthropic, les e-mails traités ne sont pas utilisés pour entraîner les modèles (politique publique d'Anthropic à 2026) et la communication est chiffrée. Cela étant dit, tout PA qui fait passer du contenu sensible par un LLM externe implique un acte de confiance dans ce fournisseur. Pour du contenu régulé (santé, juridique, financier avec secret professionnel), nous recommandons de revoir les conditions spécifiques et d'envisager des alternatives on-premise.

Peut-on intégrer WhatsApp ?

À ce jour, WhatsApp ne dispose pas d'un MCP officiel et les bridges non officiels (comme ceux qu'OpenClaw intègre) nécessitent de maintenir un compte WhatsApp Business API ou des techniques moins stables. Le PA dans sa version actuelle n'intègre pas WhatsApp nativement — nous utilisons Telegram comme canal mobile primaire pour des raisons de stabilité. Nous évaluons le MCP de WhatsApp Cloud API de Meta pour une seconde itération.

Le PA peut-il agir sans supervision humaine ?

Par conception, non. La règle de confirmation obligatoire avant toute action d'écriture (envoyer un e-mail, créer un événement, répondre sur Slack) est le noyau de sécurité de l'assistant. Voir un e-mail, lire le calendrier, chercher dans Drive — tout cela sont des opérations de lecture et il les fait sans confirmer. Mais envoyer, créer, déplacer, supprimer — exigent toujours un « oui » explicite de l'humain. C'est une décision architecturale consciente : nous préférons un PA un peu moins agile mais qui ne commet pas d'erreurs irréversibles.

Cette architecture fonctionne-t-elle sous Windows ou Linux ?

Oui, avec des ajustements. Les concepts (Claude Code + MCP + scripts Python + daemon Telegram) sont portables. Ce qui change, c'est le gestionnaire de processus au démarrage : sur macOS nous utilisons launchd, sur Linux ce serait systemd avec des unités user, et sur Windows le Task Scheduler. Le Keychain pour les identifiants IMAP a aussi des équivalents sur d'autres plateformes (Secret Service sous Linux, Credential Manager sous Windows).

Conclusion : les agents IA et le risque fournisseur

Le changement de politique d'Anthropic du 4 avril 2026 nous a rendu service. Il nous a obligés à nous demander si nous voulions continuer à externaliser une pièce critique de notre productivité quotidienne à un projet tiers, aussi brillant soit-il, alors que nous avions toutes les pièces pour la construire nous-mêmes sur un stack que nous maîtrisions déjà. La réponse, avec deux semaines de recul, est claire : nous ne le voulions pas. Et nous ne le voulons pour aucune couche critique de notre travail.

La leçon n'est pas « vous devriez tous construire votre PA ». La leçon est qu'en 2026, avec des modèles d'IA de plus en plus capables et MCP se consolidant comme standard d'intégration, la distance entre utiliser un agent tiers et construire le vôtre s'est drastiquement réduite. Ce qui en 2023 aurait requis une équipe de trois ingénieurs pendant trois mois représente aujourd'hui environ 500 lignes de Python et un après-midi de setup. Cette barrière effondrée est celle qui définit la vague actuelle de l'IA appliquée — et celle qui explique le mieux pourquoi les agences de logiciel en 2026 sont dans une position si différente de celle d'il y a deux ans.

Si vous envisagez de monter votre propre assistant personnel, ou si vous avez besoin d'aide pour construire des agents IA robustes pour votre équipe ou votre entreprise, chez Kiwop — Agence Digitale spécialisée en Développement Logiciel et Intelligence Artificielle appliquée pour clients mondiaux en Europe et aux États-Unis — nous proposons du développement sur mesure d'agents IA et de la conseil en intelligence artificielle pour des contextes de production. Le PA que nous décrivons ici est le meilleur exemple vivant de comment nous le faisons pour nous-mêmes.