EnginyeriadedadesiCDP:sensedadesnetesnohihaIA

Snowflake · BigQuery · dbt · Segment · Airflow

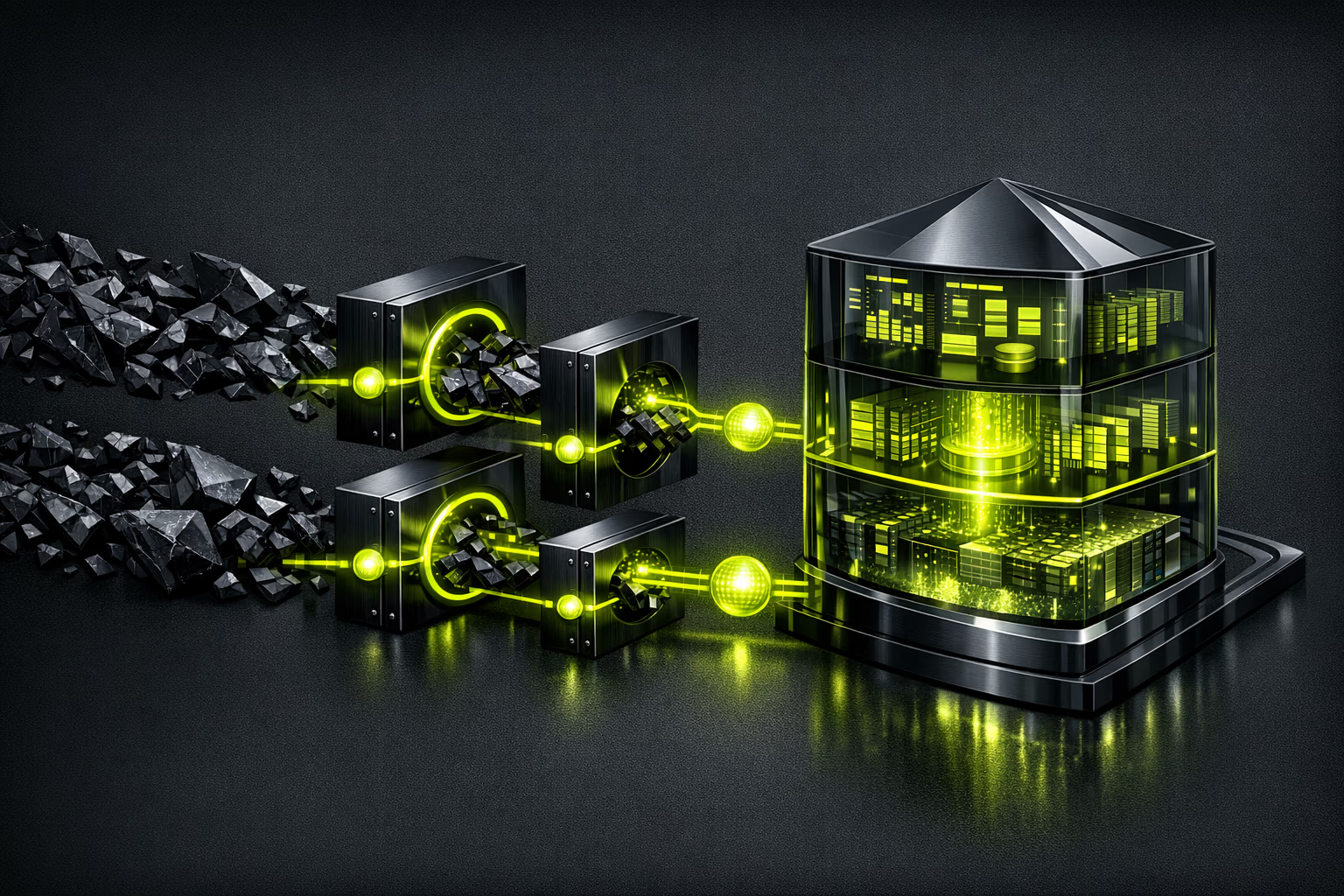

Sense dades netes no hi ha IA, no hi ha personalització, no hi ha decisions informades. Enginyeria de dades és la capa invisible que fa que tot el resta funcioni: pipelines, warehouses, CDPs i qualitat de dades.

Què inclou el servei

Infraestructura de dades de punta a punta.

El modern data stack en acció

De dades brutes a insights accionables.

El patró modern és ELT (Extract, Load, Transform): extreus dades de totes les teves fonts (CRM, web, app, ads), les carregues en un warehouse central, i les transformes amb dbt (data build tool). Les transformacions són SQL versionat a Git, testejable, documentat. Ja no més scripts Python fràgils que ningú entén. El resultat: un warehouse on qualsevol equip pot fer queries fiables.

Resum executiu

Per a CEOs i directors de dades.

El mercat de CDPs (Customer Data Platforms) passarà de $8.26 mil milions el 2025 (Grand View Research) a $37.1 mil milions el 2030 (CAGR 30.7%, MarketsandMarkets, 2025). La integració de dades representa la major inversió en projectes CDP, no la plataforma. Sense enginyeria de dades sòlida, un CDP és una despesa sense retorn.

Gartner prediu que els workflows potenciats per IA reduiran la gestió manual de dades un 60% per al 2027 (Gartner, 2025). Però la IA necessita dades netes per funcionar. Invertir en enginyeria de dades és invertir en la infraestructura que habilita totes les iniciatives d'IA, analytics i personalització.

Kiwop té expertise en Python, analytics (GA4, BigQuery) i backend. L'enginyeria de dades és la capa d'infraestructura que connecta els nostres serveis de desenvolupament, analytics i IA en una proposta coherent.

Resum per a CTO / equip tècnic

Stack, eines i arquitectura.

Warehouses: Snowflake (multi-cloud, separació compute/storage, scaling independent), BigQuery (serverless, ideal per a ecosistema Google), Databricks (lakehouse, unifica analytics i ML). Elecció segons ecosistema, volum i pressupost.

ETL/ELT: dbt per a transformacions (SQL a Git, tests, docs auto-generats). Fivetran o Airbyte per a ingesta (300+ connectors). Airflow o Dagster per a orquestració. Tot versionat, reproduïble, monitoritzat.

CDPs: Segment (estàndard de mercat, 400+ integracions), RudderStack (open-source, customer data pipeline), mParticle (enterprise, real-time audiences). Implementació inclou identity resolution, consent management, i activació en canals (ads, email, CRM).

És per a tu?

Enginyeria de dades requereix volum de dades i un cas d'ús clar. Si la teva empresa gestiona dades manualment, és el moment.

Per a qui

- Empreses que prenen decisions basades en exports manuals de CSVs i fulls de càlcul.

- Equips d'analytics que necessiten dades fiables i actualitzades automàticament.

- Organitzacions que implementaran IA/ML i necessiten dades netes com a base.

- E-commerce i SaaS que volen personalitzar experiències amb dades de client unificades.

- Directors de dades que necessiten un warehouse centralitzat amb governança.

Per a qui no

- Startups molt early-stage amb poques dades i sense volum (un CRM n'hi ha prou).

- Empreses sense pressupost per a infraestructura cloud (Snowflake, BigQuery tenen costos).

- Si només necessites un dashboard, eines no-code com Looker Studio poden ser suficients.

- Organitzacions sense ningú que consumeixi les dades (warehouse buit = despesa sense ROI).

- Si la teva font de dades és una sola app i no necessites creuar amb altres fonts.

Serveis d'enginyeria de dades

Verticals per construir la teva infraestructura de dades.

Disseny de data warehouse

Modelat dimensional, esquemes de staging/marts, particionament i clustering. Snowflake, BigQuery o Databricks segons el teu ecosistema. Optimització de costos des del disseny.

Pipelines ETL/ELT

Ingesta amb Fivetran o Airbyte (300+ connectors). Transformacions amb dbt (SQL a Git). Orquestració amb Airflow o Dagster. Pipelines reproduïbles i testejables.

Implementació de CDP

Setup de Segment, RudderStack o mParticle. Identity resolution, consent management RGPD, i activació d'audiències en canals (ads, email, CRM, web).

Data quality i observabilitat

Tests automatitzats amb dbt tests i Great Expectations. Monitorització de freshness, completeness, schema drift. Alertes proactives abans que els usuaris reportin errors.

Real-time data streaming

Pipelines de dades en temps real amb Kafka, AWS Kinesis o Google Pub/Sub. Per a casos que requereixen latència <1 segon: personalització en viu, detecció de frau, dashboards real-time.

Infraestructura ML-ready

Feature stores, datasets d'entrenament versionats, pipelines de dades preparats per a machine learning. La base perquè el teu equip d'IA treballi amb dades netes i actualitzades.

Procés d'implementació

De dades disperses a infraestructura centralitzada.

Assessment de dades

Mapeig de fonts de dades existents, qualitat actual, requisits de negoci i casos d'ús. Disseny d'arquitectura objectiu amb selecció d'eines.

Fundació de warehouse

Setup de Snowflake/BigQuery/Databricks. Disseny d'esquemes (staging, intermediate, marts). Polítiques d'accés i governança.

Pipelines d'ingesta

Configuració de connectors amb Fivetran/Airbyte. Primers pipelines de dades actius. Validació d'integritat amb la font.

Transformacions i qualitat

Models dbt per a staging i marts de negoci. Tests de qualitat automatitzats. Documentació auto-generada. Orquestració amb Airflow.

CDP i integracions

Implementació de CDP (si s'escau). Identity resolution i consent management. Activació d'audiències. Connexió amb eines d'analytics i BI.

Operació i millora contínua

Monitorització de pipelines, alertes de freshness, optimització de costos de warehouse. Cicles d'iteració amb noves fonts i models.

Riscos i mitigació

Els riscos reals d'implementar infraestructura de dades.

Costos de warehouse descontrolats

Disseny amb FinOps des del dia 1: clustering, particionament, auto-suspend, alertes de despesa. Snowflake i BigQuery cobren per query — optimitzem cada model dbt.

Dades de mala qualitat

Tests automatitzats a cada pipeline: not_null, unique, referential integrity, freshness. Great Expectations per a validacions complexes. Sense dades bones, no despleguem a marts.

Incompliment RGPD

PII identificat i pseudonimitzat al pipeline. Consent management integrat al CDP. Polítiques de retenció i dret a l'oblit automatitzats.

Pipelines fràgils que trenquen

Orquestració amb Airflow/Dagster: retries automàtics, alertes Slack, circuit breakers. Tests abans de cada deploy. Rollback de transformacions possible.

Warehouse buit sense usuaris

Comencem amb un cas d'ús concret (dashboard, audiència CDP, feed ML) — no amb un warehouse genèric. Valor demostrable a la setmana 4.

De CSVs manuals a warehouse automatitzat

E-commerce mid-market amb dades disperses en 15 fonts: Shopify, GA4, Klaviyo, Meta Ads, Google Ads, ERP, CRM, i més. L'equip d'analytics passava 2 dies/setmana preparant dades manualment. Implementem BigQuery + dbt + Fivetran + Segment: ingesta automatitzada, transformacions testejades, CDP amb audiències activades.

CDP sense enginyeria de dades = diners perduts

Per què la infraestructura va primer.

La integració de dades representa la major inversió en projectes CDP, no la plataforma. Per què? Perquè sense pipelines de dades nets, identity resolution fiable, i transformacions testejades, un CDP rep dades escombraries i activa audiències errònies. Invertir en enginyeria de dades primer és la decisió més rendible abans de comprar qualsevol eina de màrqueting o IA.

Preguntes freqüents sobre enginyeria de dades

El que els directors de dades i CTOs pregunten.

Què és un data warehouse i per què el necessito?

Un data warehouse és una base de dades centralitzada optimitzada per a analytics. Emmagatzema dades de totes les teves fonts (CRM, web, ads, ERP) transformades i llestes per consultar. El necessites quan els teus equips perden temps preparant dades manualment o prenen decisions amb dades desactualitzades.

Snowflake, BigQuery o Databricks?

Snowflake: multi-cloud, separació compute/storage, ideal per a equips SQL. BigQuery: serverless, sense gestió, perfecte si ja uses Google Cloud i GA4. Databricks: lakehouse que unifica analytics i ML, ideal si tens equip de data science. Recomanem segons ecosistema i cas d'ús.

Què és dbt i per què és important?

dbt (data build tool) permet escriure transformacions de dades en SQL, versionar-les a Git, testejar-les automàticament i documentar-les. Converteix el warehouse en un projecte de software amb les mateixes pràctiques d'enginyeria: CI/CD, code review, tests. És l'estàndard de facto en el modern data stack.

Quant costa implementar un data warehouse?

Setup inicial (warehouse + pipelines + primers models): 30K-60K EUR. Amb CDP inclòs: 60K-120K EUR. Cost mensual d'infraestructura: des de 500 EUR (BigQuery serverless) fins a 5K+ EUR (Snowflake enterprise). L'estalvi en temps d'equip sol cobrir la inversió en 6-12 mesos.

Necessito un CDP o n'hi ha prou amb un warehouse?

Un warehouse és per a analytics (consultar dades històriques). Un CDP és per a activació (enviar audiències a canals en temps real). Si només necessites dashboards, un warehouse n'hi ha prou. Si vols personalització, segmentació dinàmica o audiències per a ads, necessites un CDP.

Quant de temps tarda la implementació?

Warehouse + primers pipelines: 4-6 setmanes. Stack complet amb CDP: 10-14 setmanes. Valor demostrable (primer dashboard amb dades automatitzades) a la setmana 4. Iterem incrementalment, no esperem a tenir-ho "tot" llest.

Com gestioneu el RGPD en pipelines de dades?

PII (dades personals) s'identifica i pseudonimitza al pipeline d'ingesta, abans d'arribar al warehouse. Consent management integrat al CDP. Polítiques de retenció automatitzades. Dret a l'oblit implementat com a pipeline. Documentació llesta per al DPO.

Què passa si les meves dades actuals són de mala qualitat?

Comencem per aquí. La primera fase és un assessment de qualitat: identifiquem gaps, duplicats, inconsistències. Després implementem tests automatitzats a cada pipeline. La qualitat de dades no s'aconsegueix de cop, es construeix amb processos i automatització.

Puc començar petit i anar escalant?

Absolutament. Recomanem començar amb 3-5 fonts de dades i un cas d'ús concret (un dashboard, una audiència CDP, un dataset per a ML). Valor demostrable en setmanes, no mesos. Escalem afegint fonts i models incrementalment.

Les teves dades estan en sitges i els teus equips perden temps preparant-les?

Assessment gratuït de la teva infraestructura de dades. Mapegem les teves fonts, identifiquem gaps de qualitat, i dissenyem l'arquitectura objectiu.

Sol·licitar assessment de dades Consulta

tècnica inicial.

IA, seguretat i rendiment. Diagnòstic i proposta tancada per fases.

La teva primera reunió és amb un Arquitecte de Solucions, no amb un comercial.

Sol·licitar diagnòstic