Data-engineeringenCDP:zonderschonedatageenAI

Snowflake · BigQuery · dbt · Segment · Airflow

Zonder schone data geen AI, geen personalisatie, geen geinformeerde beslissingen. Data engineering is de onzichtbare laag die alles laat werken: pipelines, warehouses, CDP's en datakwaliteit.

Wat de dienst omvat

End-to-end data-infrastructuur.

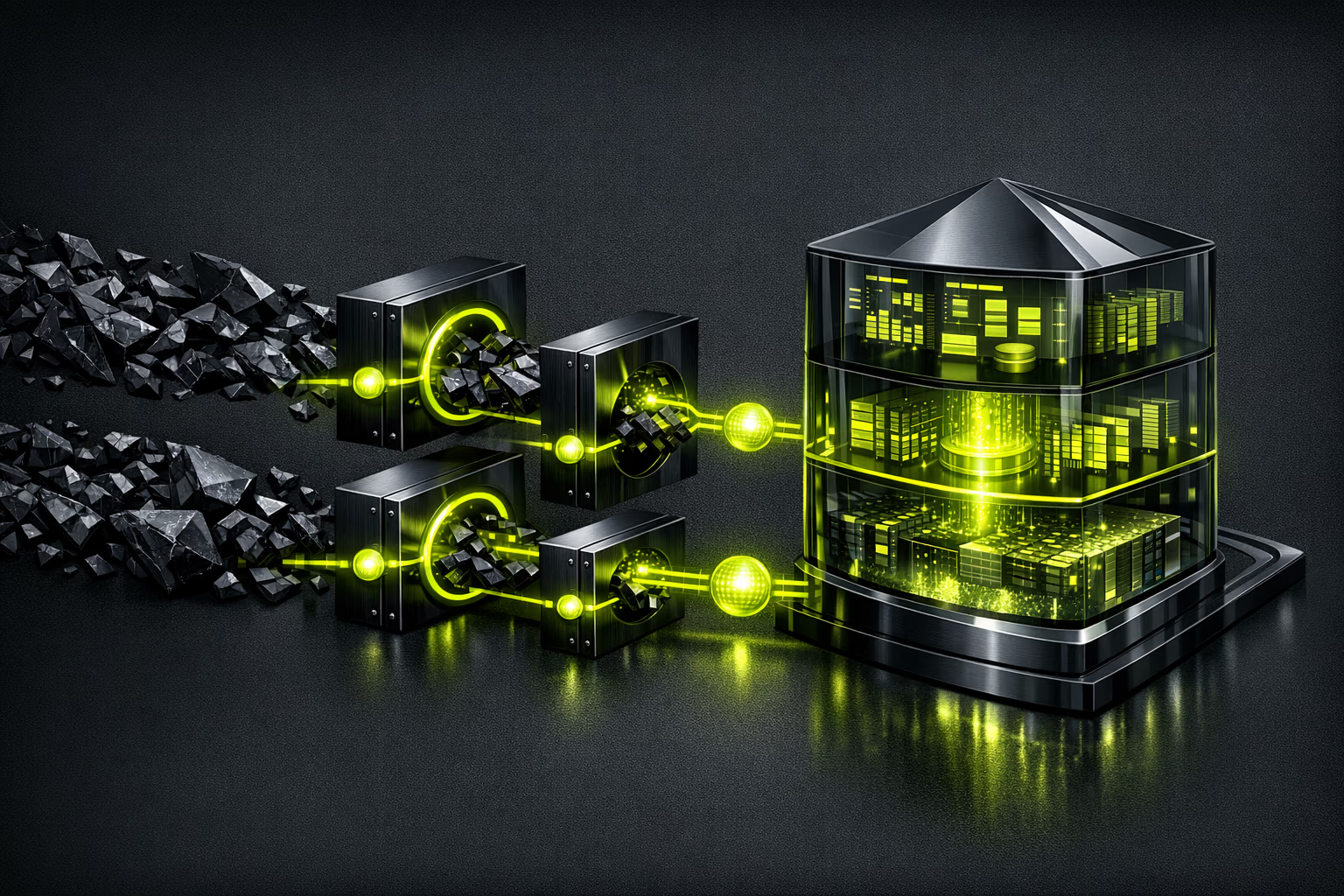

De moderne datastack in actie

Van ruwe data naar actiegerichte inzichten.

Het moderne patroon is ELT (Extract, Load, Transform): u extraheert data uit al uw bronnen (CRM, web, app, ads), laadt deze in een centraal warehouse, en transformeert ze met dbt (data build tool). De transformaties zijn SQL geversioned in Git, testbaar, gedocumenteerd. Geen fragiele Python-scripts meer die niemand begrijpt. Het resultaat: een warehouse waar elk team betrouwbare queries kan uitvoeren.

Executive summary

Voor CEO's en datadirecteuren.

De CDP-markt (Customer Data Platforms) groeit van $8,26 miljard in 2025 (Grand View Research) naar $37,1 miljard in 2030 (CAGR 30,7%, MarketsandMarkets, 2025). Data-integratie vormt de grootste investering in CDP-projecten, niet het platform. Zonder solide data engineering is een CDP een uitgave zonder rendement.

Gartner voorspelt dat AI-aangedreven workflows handmatig databeheer met 60% verminderen tegen 2027 (Gartner, 2025). Maar AI heeft schone data nodig om te functioneren. Investeren in data engineering is investeren in de infrastructuur die alle AI-, analytics- en personalisatie-initiatieven mogelijk maakt.

Kiwop heeft expertise in Python, analytics (GA4, BigQuery) en backend. Data engineering is de infrastructuurlaag die onze ontwikkelings-, analytics- en AI-diensten verbindt in een coherent aanbod.

Samenvatting voor CTO / technisch team

Stack, tools en architectuur.

Warehouses: Snowflake (multi-cloud, scheiding compute/storage, onafhankelijke schaling), BigQuery (serverless, ideaal voor Google-ecosysteem), Databricks (lakehouse, unificeert analytics en ML). Keuze op basis van ecosysteem, volume en budget.

ETL/ELT: dbt voor transformaties (SQL in Git, tests, auto-gegenereerde docs). Fivetran of Airbyte voor ingestie (300+ connectoren). Airflow of Dagster voor orkestratie. Alles geversioned, reproduceerbaar, gemonitord.

CDP's: Segment (marktstandaard, 400+ integraties), RudderStack (open-source, customer data pipeline), mParticle (enterprise, realtime audiences). Implementatie omvat identity resolution, consent management en activatie in kanalen (ads, e-mail, CRM).

Is het voor u?

Data engineering vereist datavolume en een duidelijke use case. Als uw bedrijf data handmatig beheert, is het moment daar.

Voor wie

- Bedrijven die beslissingen nemen op basis van handmatige CSV-exports en spreadsheets.

- Analyticsteams die betrouwbare en automatisch bijgewerkte data nodig hebben.

- Organisaties die AI/ML gaan implementeren en schone data als basis nodig hebben.

- E-commerce en SaaS die ervaringen willen personaliseren met uniforme klantdata.

- Datadirecteuren die een gecentraliseerd warehouse met governance nodig hebben.

Voor wie niet

- Zeer vroege startups met weinig data en geen volume (een CRM volstaat).

- Bedrijven zonder budget voor cloudinfrastructuur (Snowflake, BigQuery hebben kosten).

- Als u alleen een dashboard nodig heeft, zijn no-code tools zoals Looker Studio mogelijk voldoende.

- Organisaties waar niemand de data consumeert (een leeg warehouse = uitgave zonder ROI).

- Als uw databron een enkele app is en u niet hoeft te kruisen met andere bronnen.

Data engineering diensten

Verticals om uw data-infrastructuur te bouwen.

Data warehouse ontwerp

Dimensioneel modelleren, staging/marts-schema's, partitionering en clustering. Snowflake, BigQuery of Databricks op basis van uw ecosysteem. Kostenoptimalisatie vanaf het ontwerp.

ETL/ELT-pipelines

Ingestie met Fivetran of Airbyte (300+ connectoren). Transformaties met dbt (SQL in Git). Orkestratie met Airflow of Dagster. Reproduceerbare en testbare pipelines.

CDP-implementatie

Setup van Segment, RudderStack of mParticle. Identity resolution, AVG-conforme consent management en doelgroepactivatie in kanalen (ads, e-mail, CRM, web).

Datakwaliteit en observability

Geautomatiseerde tests met dbt tests en Great Expectations. Monitoring van freshness, completeness, schema drift. Proactieve alerts voordat gebruikers fouten melden.

Realtime data streaming

Realtime datapipelines met Kafka, AWS Kinesis of Google Pub/Sub. Voor use cases die latentie <1 seconde vereisen: live personalisatie, fraudedetectie, realtime dashboards.

ML-ready infrastructuur

Feature stores, geversioned trainingsdatasets, datapipelines voorbereid voor machine learning. De basis zodat uw AI-team met schone en actuele data werkt.

Implementatieproces

Van verspreide data naar gecentraliseerde infrastructuur.

Data-assessment

Mapping van bestaande databronnen, huidige kwaliteit, bedrijfsvereisten en use cases. Ontwerp van doelarchitectuur met toolselectie.

Warehouse-fundament

Setup van Snowflake/BigQuery/Databricks. Schema-ontwerp (staging, intermediate, marts). Toegangsbeleid en governance.

Ingestiepipelines

Configuratie van connectoren met Fivetran/Airbyte. Eerste actieve datapipelines. Integriteitsvalidatie met de bron.

Transformaties en kwaliteit

dbt-modellen voor staging en bedrijfsmarts. Geautomatiseerde kwaliteitstests. Auto-gegenereerde documentatie. Orkestratie met Airflow.

CDP en integraties

CDP-implementatie (indien van toepassing). Identity resolution en consent management. Doelgroepactivatie. Verbinding met analytics- en BI-tools.

Operatie en continue verbetering

Pipeline-monitoring, freshness-alerts, kostenoptimalisatie van warehouse. Iteratiecycli met nieuwe bronnen en modellen.

Risico's en beperking

De reele risico's van het implementeren van data-infrastructuur.

Ongecontroleerde warehousekosten

FinOps-ontwerp vanaf dag 1: clustering, partitionering, auto-suspend, uitgavenalerts. Snowflake en BigQuery rekenen per query — we optimaliseren elk dbt-model.

Data van slechte kwaliteit

Geautomatiseerde tests in elke pipeline: not_null, unique, referentiele integriteit, freshness. Great Expectations voor complexe validaties. Zonder goede data deployen we niet naar marts.

Niet-naleving AVG

PII geidentificeerd en gepseudonimiseerd in de pipeline. Consent management geintegreerd in CDP. Geautomatiseerd retentiebeleid en recht op vergetelheid.

Fragiele pipelines die breken

Orkestratie met Airflow/Dagster: automatische retries, Slack-alerts, circuit breakers. Tests voor elke deploy. Rollback van transformaties mogelijk.

Leeg warehouse zonder gebruikers

We beginnen met een concrete use case (dashboard, CDP-doelgroep, ML-feed) — niet met een generiek warehouse. Aantoonbare waarde in week 4.

Van handmatige CSV's naar geautomatiseerd warehouse

Mid-market e-commerce met data verspreid over 15 bronnen: Shopify, GA4, Klaviyo, Meta Ads, Google Ads, ERP, CRM en meer. Het analyticsteam besteedde 2 dagen/week aan handmatig data voorbereiden. We implementeerden BigQuery + dbt + Fivetran + Segment: geautomatiseerde ingestie, geteste transformaties, CDP met geactiveerde doelgroepen.

CDP zonder data engineering = weggegooid geld

Waarom infrastructuur eerst komt.

Data-integratie vormt de grootste investering in CDP-projecten, niet het platform. Waarom? Omdat een CDP zonder schone datapipelines, betrouwbare identity resolution en geteste transformaties vuile data ontvangt en foutieve doelgroepen activeert. Eerst investeren in data engineering is de meest rendabele beslissing voordat u een marketing- of AI-tool aanschaft.

Veelgestelde vragen over data engineering

Wat datadirecteuren en CTO's vragen.

Wat is een data warehouse en waarom heb ik het nodig?

Een data warehouse is een gecentraliseerde database geoptimaliseerd voor analytics. Het slaat data op uit al uw bronnen (CRM, web, ads, ERP) getransformeerd en klaar om te bevragen. U heeft het nodig wanneer uw teams tijd verliezen met handmatig data voorbereiden of beslissingen nemen met verouderde gegevens.

Snowflake, BigQuery of Databricks?

Snowflake: multi-cloud, scheiding compute/storage, ideaal voor SQL-teams. BigQuery: serverless, geen beheer, perfect als u al Google Cloud en GA4 gebruikt. Databricks: lakehouse dat analytics en ML unificeert, ideaal als u een data science team heeft. Wij adviseren op basis van ecosysteem en use case.

Wat is dbt en waarom is het belangrijk?

dbt (data build tool) stelt u in staat datatransformaties in SQL te schrijven, te versionen in Git, automatisch te testen en te documenteren. Het maakt van het warehouse een softwareproject met dezelfde engineering-praktijken: CI/CD, code review, tests. Het is de de facto standaard in de moderne datastack.

Hoeveel kost het implementeren van een data warehouse?

Initiele setup (warehouse + pipelines + eerste modellen): €30K-€60K. Met CDP inbegrepen: €60K-€120K. Maandelijkse infrastructuurkosten: vanaf €500 (BigQuery serverless) tot €5K+ (Snowflake enterprise). De besparing in teamtijd dekt doorgaans de investering in 6-12 maanden.

Heb ik een CDP nodig of volstaat een warehouse?

Een warehouse is voor analytics (historische data bevragen). Een CDP is voor activatie (doelgroepen in realtime naar kanalen sturen). Als u alleen dashboards nodig heeft, volstaat een warehouse. Als u personalisatie, dynamische segmentatie of doelgroepen voor ads wilt, heeft u een CDP nodig.

Hoe lang duurt de implementatie?

Warehouse + eerste pipelines: 4-6 weken. Volledige stack met CDP: 10-14 weken. Aantoonbare waarde (eerste dashboard met geautomatiseerde data) in week 4. We itereren incrementeel, we wachten niet tot "alles" klaar is.

Hoe beheren jullie de AVG in datapipelines?

PII (persoonsgegevens) wordt geidentificeerd en gepseudonimiseerd in de ingestiepipeline, voordat het het warehouse bereikt. Consent management geintegreerd in CDP. Geautomatiseerd retentiebeleid. Recht op vergetelheid geimplementeerd als pipeline. Documentatie klaar voor DPO.

Wat als mijn huidige data van slechte kwaliteit is?

Daar beginnen we mee. De eerste fase is een kwaliteitsassessment: we identificeren gaps, duplicaten, inconsistenties. Daarna implementeren we geautomatiseerde tests in elke pipeline. Datakwaliteit bereik je niet in een keer, het wordt opgebouwd met processen en automatisering.

Kan ik klein beginnen en opschalen?

Absoluut. Wij raden aan te beginnen met 3-5 databronnen en een concrete use case (een dashboard, een CDP-doelgroep, een dataset voor ML). Aantoonbare waarde in weken, niet maanden. We schalen op door incrementeel bronnen en modellen toe te voegen.

Staan uw data in silo's en verliest uw team tijd met voorbereiden?

Gratis assessment van uw data-infrastructuur. We mappen uw bronnen, identificeren kwaliteitsgaps en ontwerpen de doelarchitectuur.

Data-assessment aanvragen Technisch

intakegesprek.

AI, beveiliging en prestaties. Diagnose met gefaseerd voorstel.

Je eerste gesprek is met een Solutions Architect, niet met een verkoper.

Diagnose aanvragen