Daten-EngineeringundCDP:OhnesaubereDatenkeineKI

Snowflake · BigQuery · dbt · Segment · Airflow

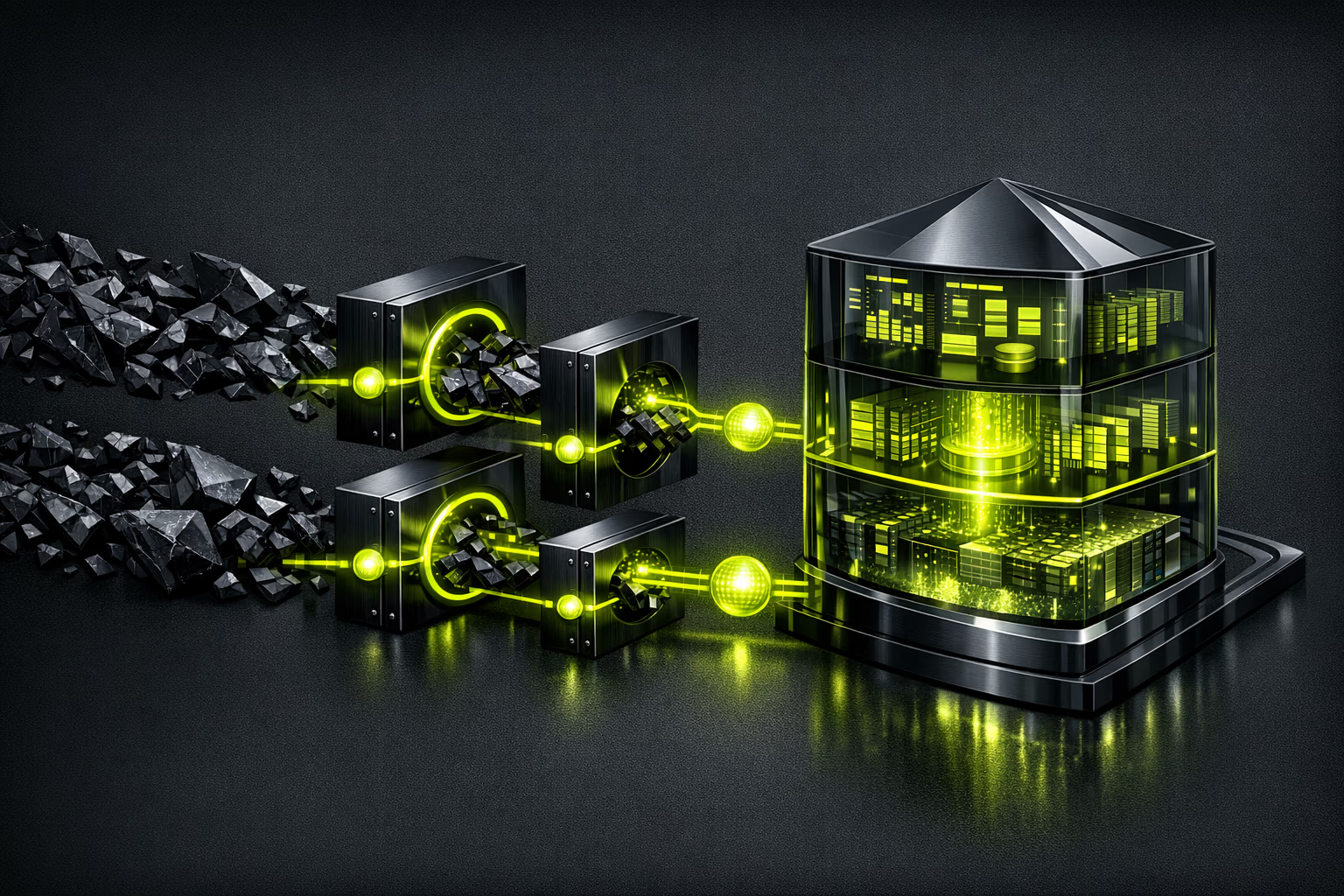

Ohne saubere Daten gibt es keine KI, keine Personalisierung, keine fundierten Entscheidungen. Daten-Engineering ist die unsichtbare Schicht, die alles andere zum Laufen bringt: Pipelines, Warehouses, CDPs und Datenqualität.

Was der Service umfasst

End-to-End-Dateninfrastruktur.

Der Modern Data Stack in Aktion

Von Rohdaten zu umsetzbaren Erkenntnissen.

Das moderne Muster ist ELT (Extract, Load, Transform): Sie extrahieren Daten aus allen Ihren Quellen (CRM, Web, App, Ads), laden sie in ein zentrales Warehouse und transformieren sie mit dbt (Data Build Tool). Die Transformationen sind SQL, versioniert in Git, testbar und dokumentiert. Keine fragilen Python-Skripte mehr, die niemand versteht. Das Ergebnis: ein Warehouse, in dem jedes Team verlässliche Abfragen ausführen kann.

Executive Summary

Für CEOs und Datenverantwortliche.

Der CDP-Markt (Customer Data Platforms) wird von 8,26 Milliarden USD in 2025 (Grand View Research) auf 37,1 Milliarden USD in 2030 wachsen (CAGR 30,7 %, MarketsandMarkets, 2025). Datenintegration stellt die grösste Investition in CDP-Projekten dar, nicht die Plattform. Ohne solides Daten-Engineering ist ein CDP eine Ausgabe ohne Rendite.

Gartner prognostiziert, dass KI-gestützte Workflows die manuelle Datenverwaltung bis 2027 um 60 % reduzieren (Gartner, 2025). Aber KI braucht saubere Daten, um zu funktionieren. In Daten-Engineering zu investieren bedeutet, in die Infrastruktur zu investieren, die alle Initiativen in KI, Analytics und Personalisierung ermöglicht.

Kiwop hat Expertise in Python, Analytics (GA4, BigQuery) und Backend. Daten-Engineering ist die Infrastrukturschicht, die unsere Services in Entwicklung, Analytics und KI zu einem kohärenten Angebot verbindet.

Zusammenfassung für CTO / Tech-Team

Stack, Werkzeuge und Architektur.

Warehouses: Snowflake (Multi-Cloud, Trennung Compute/Storage, unabhängige Skalierung), BigQuery (Serverless, ideal für das Google-Ökosystem), Databricks (Lakehouse, vereint Analytics und ML). Auswahl nach Ökosystem, Volumen und Budget.

ETL/ELT: dbt für Transformationen (SQL in Git, Tests, automatisch generierte Docs). Fivetran oder Airbyte für Ingestion (300+ Konnektoren). Airflow oder Dagster für Orchestrierung. Alles versioniert, reproduzierbar, überwacht.

CDPs: Segment (Marktstandard, 400+ Integrationen), RudderStack (Open-Source, Customer Data Pipeline), mParticle (Enterprise, Echtzeit-Audiences). Implementierung umfasst Identity Resolution, Consent Management und Aktivierung in Kanälen (Ads, E-Mail, CRM).

Ist es für Sie?

Daten-Engineering erfordert Datenvolumen und einen klaren Use Case. Wenn Ihr Unternehmen Daten manuell verwaltet, ist es an der Zeit.

Für wen

- Unternehmen, die Entscheidungen auf Basis manueller CSV-Exporte und Tabellenkalkulationen treffen.

- Analytics-Teams, die verlässliche und automatisch aktualisierte Daten benötigen.

- Organisationen, die KI/ML implementieren und saubere Daten als Grundlage benötigen.

- E-Commerce und SaaS, die Erfahrungen mit vereinheitlichten Kundendaten personalisieren wollen.

- Datenverantwortliche, die ein zentrales Warehouse mit Governance benötigen.

Für wen nicht

- Sehr frühe Startups mit wenigen Daten und ohne Volumen (ein CRM reicht aus).

- Unternehmen ohne Budget für Cloud-Infrastruktur (Snowflake, BigQuery haben Kosten).

- Wenn Sie nur ein Dashboard brauchen, reichen No-Code-Tools wie Looker Studio möglicherweise aus.

- Organisationen ohne jemanden, der die Daten konsumiert (leeres Warehouse = Ausgabe ohne ROI).

- Wenn Ihre Datenquelle eine einzige App ist und kein Abgleich mit anderen Quellen nötig ist.

Daten-Engineering-Leistungen

Vertikalen zum Aufbau Ihrer Dateninfrastruktur.

Data-Warehouse-Design

Dimensionale Modellierung, Staging/Marts-Schemata, Partitionierung und Clustering. Snowflake, BigQuery oder Databricks je nach Ökosystem. Kostenoptimierung ab dem Design.

ETL/ELT-Pipelines

Ingestion mit Fivetran oder Airbyte (300+ Konnektoren). Transformationen mit dbt (SQL in Git). Orchestrierung mit Airflow oder Dagster. Reproduzierbare und testbare Pipelines.

CDP-Implementierung

Setup von Segment, RudderStack oder mParticle. Identity Resolution, DSGVO-konformes Consent Management und Audienceaktivierung in Kanälen (Ads, E-Mail, CRM, Web).

Datenqualität und Observability

Automatisierte Tests mit dbt Tests und Great Expectations. Monitoring von Freshness, Completeness, Schema Drift. Proaktive Alerts, bevor Nutzer Fehler melden.

Echtzeit-Datenstreaming

Echtzeit-Datenpipelines mit Kafka, AWS Kinesis oder Google Pub/Sub. Für Anwendungsfälle mit <1 Sekunde Latenz: Live-Personalisierung, Betrugserkennung, Echtzeit-Dashboards.

ML-Ready-Infrastruktur

Feature Stores, versionierte Trainingsdatensätze, für Machine Learning vorbereitete Datenpipelines. Die Grundlage, damit Ihr KI-Team mit sauberen und aktuellen Daten arbeiten kann.

Implementierungsprozess

Von verstreuten Daten zu zentraler Infrastruktur.

Daten-Assessment

Mapping bestehender Datenquellen, aktuelle Qualität, Geschäftsanforderungen und Use Cases. Design der Zielarchitektur mit Werkzeugauswahl.

Warehouse-Fundament

Setup von Snowflake/BigQuery/Databricks. Schema-Design (Staging, Intermediate, Marts). Zugriffsrichtlinien und Governance.

Ingestion-Pipelines

Konfiguration der Konnektoren mit Fivetran/Airbyte. Erste aktive Datenpipelines. Integritätsvalidierung mit der Quelle.

Transformationen und Qualität

dbt-Modelle für Staging und Business-Marts. Automatisierte Qualitätstests. Auto-generierte Dokumentation. Orchestrierung mit Airflow.

CDP und Integrationen

CDP-Implementierung (falls zutreffend). Identity Resolution und Consent Management. Audienceaktivierung. Anbindung an Analytics- und BI-Tools.

Betrieb und kontinuierliche Verbesserung

Pipeline-Monitoring, Freshness-Alerts, Warehouse-Kostenoptimierung. Iterationszyklen mit neuen Quellen und Modellen.

Risiken und Minderung

Die realen Risiken bei der Implementierung von Dateninfrastruktur.

Unkontrollierte Warehouse-Kosten

Design mit FinOps ab Tag 1: Clustering, Partitionierung, Auto-Suspend, Ausgaben-Alerts. Snowflake und BigQuery berechnen pro Query — wir optimieren jedes dbt-Modell.

Daten schlechter Qualität

Automatisierte Tests in jeder Pipeline: not_null, unique, referentielle Integrität, Freshness. Great Expectations für komplexe Validierungen. Ohne gute Daten deployen wir nicht in Marts.

DSGVO-Nichteinhaltung

PII wird in der Pipeline identifiziert und pseudonymisiert. Consent Management im CDP integriert. Aufbewahrungsrichtlinien und Recht auf Löschung automatisiert.

Fragile Pipelines, die brechen

Orchestrierung mit Airflow/Dagster: automatische Retries, Slack-Alerts, Circuit Breaker. Tests vor jedem Deploy. Rollback von Transformationen möglich.

Leeres Warehouse ohne Nutzer

Wir starten mit einem konkreten Use Case (Dashboard, CDP-Audience, ML-Feed) — nicht mit einem generischen Warehouse. Nachweisbarer Wert in Woche 4.

Von manuellen CSVs zum automatisierten Warehouse

Mid-Market E-Commerce mit Daten verstreut über 15 Quellen: Shopify, GA4, Klaviyo, Meta Ads, Google Ads, ERP, CRM und mehr. Das Analytics-Team verbrachte 2 Tage/Woche mit manueller Datenaufbereitung. Wir implementierten BigQuery + dbt + Fivetran + Segment: automatisierte Ingestion, getestete Transformationen, CDP mit aktivierten Audiences.

CDP ohne Daten-Engineering = verlorenes Geld

Warum die Infrastruktur zuerst kommt.

Datenintegration stellt die grösste Investition in CDP-Projekten dar, nicht die Plattform. Warum? Weil ohne saubere Datenpipelines, zuverlässige Identity Resolution und getestete Transformationen ein CDP Müll empfängt und fehlerhafte Audiences aktiviert. Zuerst in Daten-Engineering zu investieren ist die rentabelste Entscheidung, bevor Sie irgendein Marketing- oder KI-Tool kaufen.

Häufig gestellte Fragen zum Daten-Engineering

Was Datenverantwortliche und CTOs fragen.

Was ist ein Data Warehouse und warum brauche ich es?

Ein Data Warehouse ist eine zentralisierte, für Analytics optimierte Datenbank. Es speichert Daten aus all Ihren Quellen (CRM, Web, Ads, ERP), transformiert und abfragebereit. Sie brauchen es, wenn Ihre Teams Zeit mit manueller Datenaufbereitung verlieren oder Entscheidungen auf Basis veralteter Daten treffen.

Snowflake, BigQuery oder Databricks?

Snowflake: Multi-Cloud, Trennung Compute/Storage, ideal für SQL-Teams. BigQuery: Serverless, ohne Verwaltung, perfekt bei bestehender Google Cloud und GA4. Databricks: Lakehouse, vereint Analytics und ML, ideal bei vorhandenem Data-Science-Team. Wir empfehlen nach Ökosystem und Use Case.

Was ist dbt und warum ist es wichtig?

dbt (Data Build Tool) erlaubt es, Datentransformationen in SQL zu schreiben, in Git zu versionieren, automatisch zu testen und zu dokumentieren. Es verwandelt das Warehouse in ein Softwareprojekt mit denselben Engineering-Praktiken: CI/CD, Code Review, Tests. Es ist der De-facto-Standard im Modern Data Stack.

Was kostet die Implementierung eines Data Warehouse?

Initiales Setup (Warehouse + Pipelines + erste Modelle): 30.000–60.000 EUR. Mit CDP inklusive: 60.000–120.000 EUR. Monatliche Infrastrukturkosten: ab 500 EUR (BigQuery Serverless) bis 5.000+ EUR (Snowflake Enterprise). Die Zeiteinsparung im Team deckt die Investition in der Regel in 6–12 Monaten.

Brauche ich ein CDP oder reicht ein Warehouse?

Ein Warehouse ist für Analytics (historische Daten abfragen). Ein CDP ist für Aktivierung (Audiences in Echtzeit an Kanäle senden). Wenn Sie nur Dashboards brauchen, reicht ein Warehouse. Wenn Sie Personalisierung, dynamische Segmentierung oder Audiences für Ads wollen, brauchen Sie ein CDP.

Wie lange dauert die Implementierung?

Warehouse + erste Pipelines: 4–6 Wochen. Vollständiger Stack mit CDP: 10–14 Wochen. Nachweisbarer Wert (erstes Dashboard mit automatisierten Daten) in Woche 4. Wir iterieren inkrementell und warten nicht, bis „alles" fertig ist.

Wie handhabt ihr die DSGVO in Datenpipelines?

PII (personenbezogene Daten) wird in der Ingestion-Pipeline identifiziert und pseudonymisiert, bevor sie das Warehouse erreichen. Consent Management im CDP integriert. Automatisierte Aufbewahrungsrichtlinien. Recht auf Löschung als Pipeline implementiert. Dokumentation bereit für DPO.

Was passiert, wenn meine aktuellen Daten schlecht sind?

Dort fangen wir an. Die erste Phase ist ein Qualitäts-Assessment: Wir identifizieren Lücken, Duplikate und Inkonsistenzen. Dann implementieren wir automatisierte Tests in jeder Pipeline. Datenqualität wird nicht auf einmal erreicht, sondern mit Prozessen und Automatisierung aufgebaut.

Kann ich klein anfangen und dann skalieren?

Absolut. Wir empfehlen, mit 3–5 Datenquellen und einem konkreten Use Case zu starten (ein Dashboard, eine CDP-Audience, ein ML-Datensatz). Nachweisbarer Wert in Wochen, nicht Monaten. Wir skalieren inkrementell durch Hinzufügen von Quellen und Modellen.

Sind Ihre Daten in Silos und Ihre Teams verlieren Zeit mit der Aufbereitung?

Kostenloses Assessment Ihrer Dateninfrastruktur. Wir mappen Ihre Quellen, identifizieren Qualitätslücken und entwerfen die Zielarchitektur.

Daten-Assessment anfordern Technische

Erstberatung.

KI, Sicherheit und Performance. Diagnose mit phasenweisem Vorschlag.

Ihr erstes Meeting ist mit einem Solutions Architect, nicht mit einem Verkäufer.

Diagnose anfordern