EngenhariadedadoseCDP:semdadoslimposnãoháIA

Snowflake · BigQuery · dbt · Segment · Airflow

Sem dados limpos nao ha IA, nao ha personalizacao, nao ha decisoes informadas. Engenharia de dados e a camada invisivel que faz com que tudo o resto funcione: pipelines, warehouses, CDPs e qualidade de dados.

O que inclui o servico

Infraestrutura de dados de ponta a ponta.

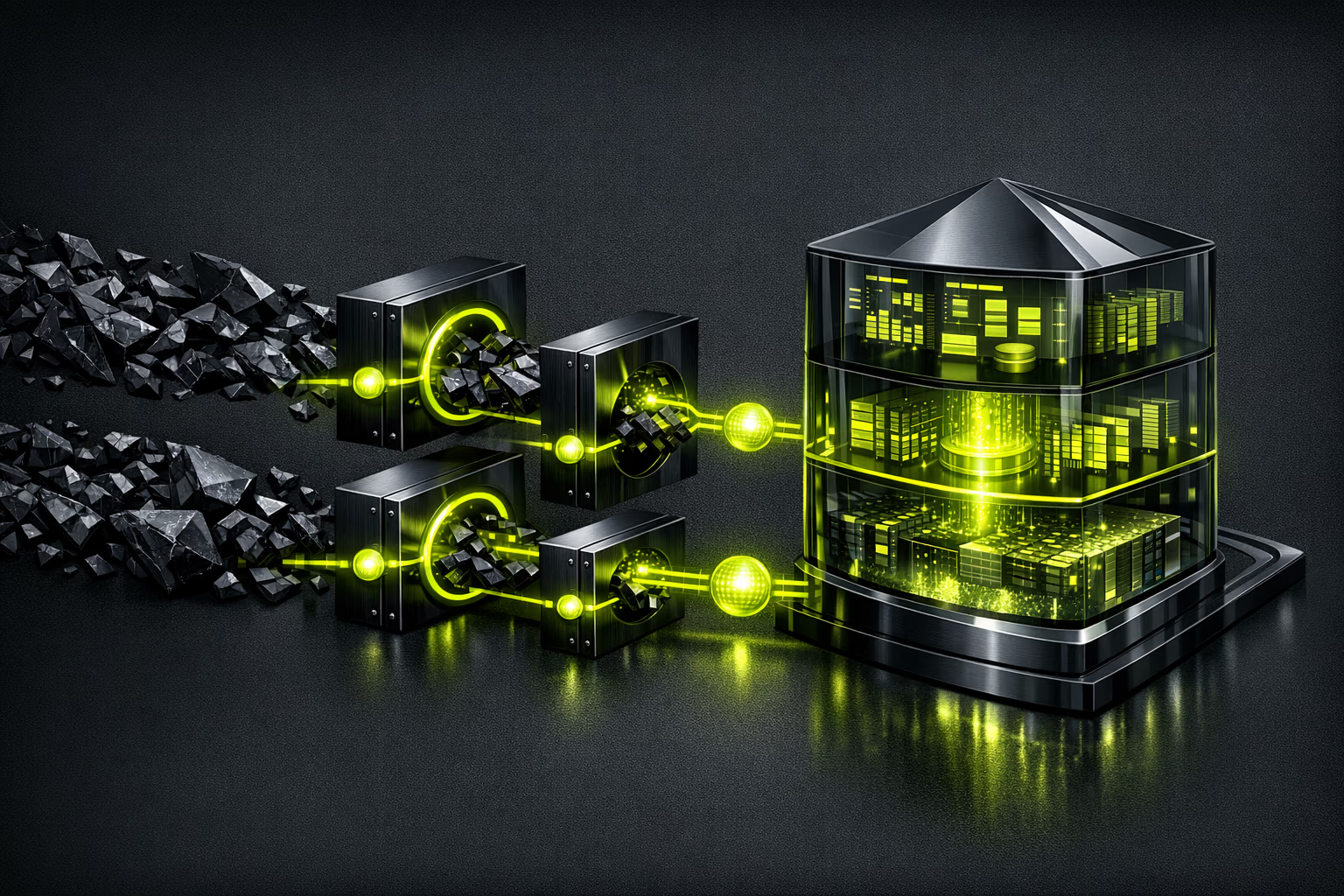

O modern data stack em acao

De dados brutos a insights acionaveis.

O padrao moderno e ELT (Extract, Load, Transform): extrai dados de todas as suas fontes (CRM, web, app, ads), carrega-os num warehouse central, e transforma-os com dbt (data build tool). As transformacoes sao SQL versionado em Git, testavel, documentado. Acabaram-se os scripts Python frageis que ninguem entende. O resultado: um warehouse onde qualquer equipa pode fazer queries fiaveis.

Resumo executivo

Para CEOs e diretores de dados.

O mercado de CDPs (Customer Data Platforms) passara de $8.26 mil milhoes em 2025 (Grand View Research) para $37.1 mil milhoes em 2030 (CAGR 30.7%, MarketsandMarkets, 2025). A integracao de dados representa o maior investimento em projetos CDP, nao a plataforma. Sem engenharia de dados solida, um CDP e um gasto sem retorno.

A Gartner preve que os workflows potenciados por IA reduzirao a gestao manual de dados 60% ate 2027 (Gartner, 2025). Mas a IA precisa de dados limpos para funcionar. Investir em engenharia de dados e investir na infraestrutura que viabiliza todas as iniciativas de IA, analytics e personalizacao.

A Kiwop tem expertise em Python, analytics (GA4, BigQuery) e backend. A engenharia de dados e a camada de infraestrutura que liga os nossos servicos de desenvolvimento, analytics e IA numa proposta coerente.

Resumo para CTO / equipa tecnica

Stack, ferramentas e arquitetura.

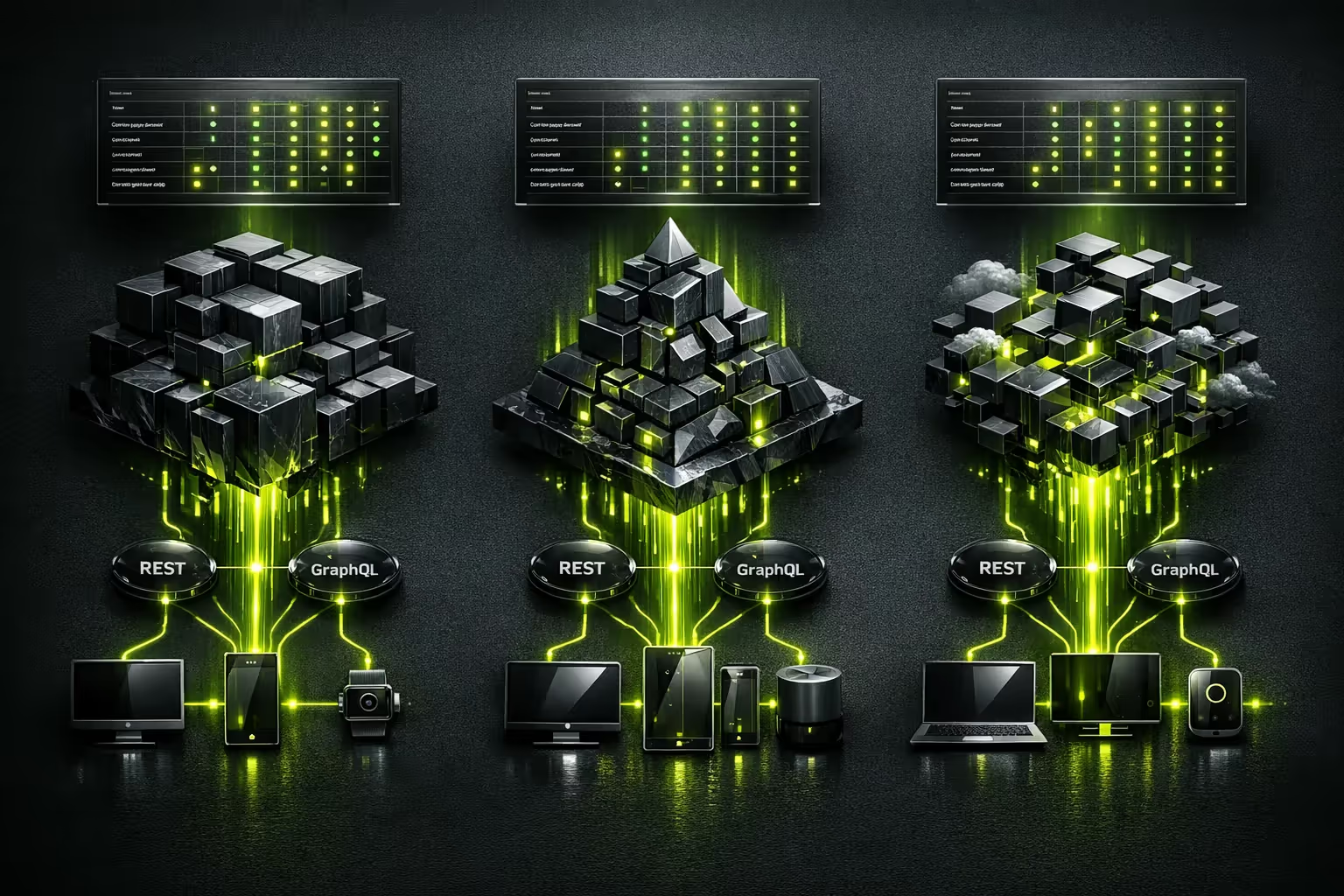

Warehouses: Snowflake (multi-cloud, separacao compute/storage, scaling independente), BigQuery (serverless, ideal para ecossistema Google), Databricks (lakehouse, unifica analytics e ML). Escolha conforme ecossistema, volume e orcamento.

ETL/ELT: dbt para transformacoes (SQL em Git, testes, docs auto-gerados). Fivetran ou Airbyte para ingestao (300+ conectores). Airflow ou Dagster para orquestracao. Tudo versionado, reproduzivel, monitorizado.

CDPs: Segment (padrao de mercado, 400+ integracoes), RudderStack (open-source, customer data pipeline), mParticle (enterprise, real-time audiences). Implementacao inclui identity resolution, consent management, e ativacao em canais (ads, email, CRM).

E para si?

Engenharia de dados requer volume de dados e um caso de uso claro. Se a sua empresa gere dados manualmente, e o momento.

Para quem

- Empresas que tomam decisoes com base em exports manuais de CSVs e folhas de calculo.

- Equipas de analytics que precisam de dados fiaveis e atualizados automaticamente.

- Organizacoes que vao implementar IA/ML e precisam de dados limpos como base.

- E-commerce e SaaS que querem personalizar experiencias com dados de cliente unificados.

- Diretores de dados que precisam de um warehouse centralizado com governanca.

Para quem não

- Startups muito early-stage com poucos dados e sem volume (um CRM basta).

- Empresas sem orcamento para infraestrutura cloud (Snowflake, BigQuery tem custos).

- Se so precisa de um dashboard, ferramentas no-code como Looker Studio podem ser suficientes.

- Organizacoes sem ninguem que consuma os dados (warehouse vazio = gasto sem ROI).

- Se a sua fonte de dados e uma unica app e nao precisa de cruzar com outras fontes.

Servicos de engenharia de dados

Verticais para construir a sua infraestrutura de dados.

Desenho de data warehouse

Modelacao dimensional, esquemas de staging/marts, particionamento e clustering. Snowflake, BigQuery ou Databricks conforme o seu ecossistema. Otimizacao de custos desde o desenho.

Pipelines ETL/ELT

Ingestao com Fivetran ou Airbyte (300+ conectores). Transformacoes com dbt (SQL em Git). Orquestracao com Airflow ou Dagster. Pipelines reproduziveis e testaveis.

Implementacao de CDP

Setup de Segment, RudderStack ou mParticle. Identity resolution, consent management RGPD, e ativacao de audiencias nos canais (ads, email, CRM, web).

Data quality e observabilidade

Testes automatizados com dbt tests e Great Expectations. Monitorizacao de freshness, completeness, schema drift. Alertas proativas antes de os utilizadores reportarem erros.

Real-time data streaming

Pipelines de dados em tempo real com Kafka, AWS Kinesis ou Google Pub/Sub. Para casos que requerem latencia <1 segundo: personalizacao em direto, detecao de fraude, dashboards real-time.

Infraestrutura ML-ready

Feature stores, datasets de treino versionados, pipelines de dados preparados para machine learning. A base para que a sua equipa de IA trabalhe com dados limpos e atualizados.

Processo de implementacao

De dados dispersos a infraestrutura centralizada.

Assessment de dados

Mapeamento de fontes de dados existentes, qualidade atual, requisitos de negocio e casos de uso. Desenho de arquitetura objetivo com selecao de ferramentas.

Fundacao de warehouse

Setup de Snowflake/BigQuery/Databricks. Desenho de esquemas (staging, intermediate, marts). Politicas de acesso e governanca.

Pipelines de ingestao

Configuracao de conectores com Fivetran/Airbyte. Primeiros pipelines de dados ativos. Validacao de integridade com a fonte.

Transformacoes e qualidade

Modelos dbt para staging e marts de negocio. Testes de qualidade automatizados. Documentacao auto-gerada. Orquestracao com Airflow.

CDP e integracoes

Implementacao de CDP (se aplicavel). Identity resolution e consent management. Ativacao de audiencias. Ligacao a ferramentas de analytics e BI.

Operacao e melhoria continua

Monitorizacao de pipelines, alertas de freshness, otimizacao de custos de warehouse. Ciclos de iteracao com novas fontes e modelos.

Riscos e mitigacao

Os riscos reais de implementar infraestrutura de dados.

Custos de warehouse descontrolados

Desenho com FinOps desde o dia 1: clustering, particionamento, auto-suspend, alertas de gasto. Snowflake e BigQuery cobram por query — otimizamos cada modelo dbt.

Dados de ma qualidade

Testes automatizados em cada pipeline: not_null, unique, referential integrity, freshness. Great Expectations para validacoes complexas. Sem dados bons, nao deployamos para marts.

Incumprimento RGPD

PII identificada e pseudonimizada no pipeline. Consent management integrado no CDP. Politicas de retencao e direito ao esquecimento automatizados.

Pipelines frageis que partem

Orquestracao com Airflow/Dagster: retries automaticos, alertas Slack, circuit breakers. Testes antes de cada deploy. Rollback de transformacoes possivel.

Warehouse vazio sem utilizadores

Comecamos com um caso de uso concreto (dashboard, audiencia CDP, feed ML) — nao com um warehouse generico. Valor demonstravel na semana 4.

De CSVs manuais a warehouse automatizado

E-commerce mid-market com dados dispersos em 15 fontes: Shopify, GA4, Klaviyo, Meta Ads, Google Ads, ERP, CRM, e mais. A equipa de analytics passava 2 dias/semana a preparar dados manualmente. Implementamos BigQuery + dbt + Fivetran + Segment: ingestao automatizada, transformacoes testadas, CDP com audiencias ativadas.

CDP sem engenharia de dados = dinheiro perdido

Porque a infraestrutura vem primeiro.

A integracao de dados representa o maior investimento em projetos CDP, nao a plataforma. Porque? Porque sem pipelines de dados limpos, identity resolution fiavel, e transformacoes testadas, um CDP recebe dados lixo e ativa audiencias erradas. Investir em engenharia de dados primeiro e a decisao mais rentavel antes de comprar qualquer ferramenta de marketing ou IA.

Perguntas frequentes sobre engenharia de dados

O que os diretores de dados e CTOs perguntam.

O que e um data warehouse e porque preciso dele?

Um data warehouse e uma base de dados centralizada otimizada para analytics. Armazena dados de todas as suas fontes (CRM, web, ads, ERP) transformados e prontos para consultar. Precisa dele quando as suas equipas perdem tempo a preparar dados manualmente ou tomam decisoes com dados desatualizados.

Snowflake, BigQuery ou Databricks?

Snowflake: multi-cloud, separacao compute/storage, ideal para equipas SQL. BigQuery: serverless, sem gestao, perfeito se ja usa Google Cloud e GA4. Databricks: lakehouse que unifica analytics e ML, ideal se tem equipa de data science. Recomendamos conforme ecossistema e caso de uso.

O que e dbt e porque e importante?

dbt (data build tool) permite escrever transformacoes de dados em SQL, versiona-las em Git, testa-las automaticamente e documenta-las. Converte o warehouse num projeto de software com as mesmas praticas de engenharia: CI/CD, code review, testes. E o padrao de facto no modern data stack.

Quanto custa implementar um data warehouse?

Setup inicial (warehouse + pipelines + primeiros modelos): 30K-60K EUR. Com CDP incluido: 60K-120K EUR. Custo mensal de infraestrutura: desde 500 EUR (BigQuery serverless) ate 5K+ EUR (Snowflake enterprise). A poupanca em tempo de equipa costuma cobrir o investimento em 6-12 meses.

Preciso de um CDP ou basta-me um warehouse?

Um warehouse e para analytics (consultar dados historicos). Um CDP e para ativacao (enviar audiencias para canais em tempo real). Se so precisa de dashboards, um warehouse basta. Se quer personalizacao, segmentacao dinamica ou audiencias para ads, precisa de um CDP.

Quanto tempo demora a implementacao?

Warehouse + primeiros pipelines: 4-6 semanas. Stack completo com CDP: 10-14 semanas. Valor demonstravel (primeiro dashboard com dados automatizados) na semana 4. Iteramos incrementalmente, nao esperamos ter "tudo" pronto.

Como gerem o RGPD em pipelines de dados?

PII (dados pessoais) e identificada e pseudonimizada no pipeline de ingestao, antes de chegar ao warehouse. Consent management integrado no CDP. Politicas de retencao automatizadas. Direito ao esquecimento implementado como pipeline. Documentacao pronta para DPO.

E se os meus dados atuais forem de ma qualidade?

Comecamos por ai. A primeira fase e um assessment de qualidade: identificamos lacunas, duplicados, inconsistencias. Depois implementamos testes automatizados em cada pipeline. A qualidade de dados nao se alcanca de uma vez, constroi-se com processos e automatizacao.

Posso comecar pequeno e ir escalando?

Absolutamente. Recomendamos comecar com 3-5 fontes de dados e um caso de uso concreto (um dashboard, uma audiencia CDP, um dataset para ML). Valor demonstravel em semanas, nao meses. Escalamos acrescentando fontes e modelos incrementalmente.

Os seus dados estao em silos e as suas equipas perdem tempo a prepara-los?

Assessment gratuito da sua infraestrutura de dados. Mapeamos as suas fontes, identificamos lacunas de qualidade, e desenhamos a arquitetura objetivo.

Solicitar assessment de dados Consulta

técnica inicial.

IA, segurança e desempenho. Diagnóstico com proposta faseada.

A sua primeira reunião é com um Arquiteto de Soluções, não com um comercial.

Solicitar diagnóstico