EU AI Act 2026: Lo Que Tu Empresa Debe Saber para Cumplir la Normativa

El Reglamento Europeo de Inteligencia Artificial ya está en vigor. Desde febrero de 2025, las primeras obligaciones son exigibles, y en agosto de 2026 entrará en aplicación plena para los sistemas de alto riesgo. Si tu empresa desarrolla, despliega o utiliza sistemas de IA, este artículo es tu hoja de ruta imprescindible para evitar sanciones de hasta 35 millones de euros o el 7% de tu facturación global.

No estamos hablando de regulación futura: el EU AI Act es ley vigente. Las empresas que no actúen ahora se enfrentan a multas ejemplarizantes y, lo que es peor, a la prohibición de operar sus sistemas de IA en el mercado europeo.

En esta guía exhaustiva, desglosamos todo lo que necesitas saber: desde las fechas críticas hasta las obligaciones específicas según tu rol y sector, pasando por un checklist práctico de compliance que puedes implementar desde hoy.

¿Qué es el EU AI Act y por qué debería importarte en 2026?

El Reglamento (UE) 2024/1689, conocido como EU AI Act o Ley de Inteligencia Artificial, es el primer marco regulatorio integral del mundo para la inteligencia artificial. Aprobado el 13 de junio de 2024 y publicado en el Diario Oficial de la UE el 12 de julio de 2024, entró en vigor el 1 de agosto de 2024.

Pero aquí viene lo crucial: su aplicación es escalonada, y los plazos más importantes están ocurriendo ahora mismo o llegarán en los próximos meses.

Por qué 2026 es el año decisivo

El EU AI Act no es como el GDPR, que dio un período de gracia amplio. La implementación por fases significa que:

- Febrero 2025: Ya están prohibidos ciertos sistemas de IA considerados de "riesgo inaceptable"

- Agosto 2025: Las obligaciones para modelos de IA de propósito general (GPAI) son exigibles

- Agosto 2026: Entra en vigor la regulación completa para sistemas de alto riesgo

- Agosto 2027: Aplicación total, incluidos sistemas integrados en productos regulados

Si tu empresa utiliza ChatGPT, herramientas de análisis predictivo, sistemas de reconocimiento facial, chatbots de atención al cliente, o cualquier otra tecnología basada en IA, estás dentro del ámbito de aplicación.

Ámbito territorial: ¿A quién afecta?

El EU AI Act tiene aplicación extraterritorial, similar al GDPR:

- Proveedores de sistemas de IA que comercialicen o pongan en servicio sistemas en la UE, independientemente de dónde estén establecidos

- Desplegadores (usuarios empresariales) de sistemas de IA ubicados en la UE

- Proveedores y desplegadores fuera de la UE cuyo output de IA se utilice dentro del territorio europeo

- Importadores y distribuidores de sistemas de IA en el mercado europeo

- Representantes autorizados de proveedores no establecidos en la UE

En resumen: si tu IA toca Europa de cualquier forma, necesitas cumplir.

¿Cuáles son las fechas clave del EU AI Act que no puedes ignorar?

El calendario de implementación del EU AI Act es complejo pero crítico. Aquí tienes el timeline completo con lo que cada fecha implica para tu negocio:

Fechas ya vencidas (cumplimiento obligatorio)

1 de agosto de 2024 – Entrada en vigor El reglamento se convirtió en ley. Comienza el período de transición.

2 de febrero de 2025 – Primera oleada de obligaciones

- ✅ Prohibición de sistemas de IA de riesgo inaceptable (scoring social, manipulación subliminal, explotación de vulnerables, vigilancia biométrica masiva en espacios públicos)

- ✅ Obligación de alfabetización en IA (Art. 4): Las empresas deben garantizar que su personal tiene competencias suficientes para operar y supervisar sistemas de IA

- ✅ Notificación a autoridades de sistemas de IA prohibidos que estuvieran en uso

2 de agosto de 2025 – Modelos de propósito general (GPAI)

- Obligaciones de transparencia para proveedores de modelos fundacionales

- Documentación técnica obligatoria

- Cumplimiento de normas de derechos de autor

- Requisitos adicionales para modelos con "riesgo sistémico" (aquellos entrenados con más de 10²⁵ FLOPs)

Fechas inminentes (preparación urgente)

2 de agosto de 2026 – Aplicación general Esta es la fecha más importante para la mayoría de empresas:

- 🔴 Sistemas de IA de alto riesgo: Obligaciones completas de conformidad

- 🔴 Obligaciones de transparencia del Artículo 50: divulgación de interacciones con IA, etiquetado de contenido sintético, identificación de deepfakes

- 🔴 Registro obligatorio en la base de datos de la UE para sistemas de alto riesgo

- 🔴 Activación plena del régimen sancionador

Fecha final

2 de agosto de 2027 – Aplicación total

- Sistemas de IA de alto riesgo integrados en productos ya regulados por legislación sectorial (dispositivos médicos, maquinaria, juguetes, etc.)

- Cierre de todos los períodos transitorios

¿Cómo clasifica el EU AI Act los sistemas de IA según su riesgo?

El enfoque del EU AI Act se basa en una pirámide de riesgo con cuatro niveles. Cada nivel conlleva obligaciones diferentes, desde la prohibición total hasta la ausencia de requisitos específicos.

Nivel 1: Riesgo Inaceptable (PROHIBIDO)

Estos sistemas están completamente prohibidos desde febrero de 2025:

Manipulación cognitiva

- Sistemas que utilizan técnicas subliminales o manipuladoras para distorsionar el comportamiento de las personas

- IA que explota vulnerabilidades de grupos específicos (edad, discapacidad, situación económica)

Scoring social

- Sistemas de puntuación social por parte de autoridades públicas

- Clasificación de ciudadanos basada en comportamiento social o características personales con consecuencias perjudiciales

Vigilancia biométrica masiva

- Identificación biométrica remota en tiempo real en espacios públicos (con excepciones muy limitadas para seguridad)

- Sistemas de categorización biométrica que infieran datos sensibles (raza, orientación sexual, afiliación política, creencias religiosas)

Otras prohibiciones

- Scraping no selectivo de imágenes faciales de internet o CCTV para bases de datos de reconocimiento facial

- Reconocimiento de emociones en lugares de trabajo o instituciones educativas (salvo razones médicas o de seguridad)

- IA predictiva de comportamiento criminal basada únicamente en perfiles o rasgos de personalidad

Nivel 2: Alto Riesgo (REGULACIÓN ESTRICTA)

Los sistemas de alto riesgo están sujetos a obligaciones exhaustivas. Se dividen en dos categorías:

Sistemas de IA como componentes de seguridad en productos regulados:

- Dispositivos médicos

- Vehículos y maquinaria

- Juguetes

- Equipos de protección personal

- Ascensores y equipos a presión

- Aviación y ferrocarril

Sistemas de IA independientes en sectores críticos (Anexo III):

Nivel 3: Riesgo Limitado (TRANSPARENCIA)

Sistemas con obligaciones específicas de transparencia:

- Chatbots y asistentes virtuales: Deben informar claramente que el usuario está interactuando con una IA

- Generación de contenido sintético: Textos, imágenes, audio y vídeo generados por IA deben etiquetarse como tales

- Deepfakes: Obligación de revelar que el contenido ha sido generado o manipulado artificialmente

- Sistemas de reconocimiento de emociones: Informar a las personas cuando están siendo analizadas

Nivel 4: Riesgo Mínimo o Nulo

La mayoría de sistemas de IA entran en esta categoría y no tienen obligaciones específicas bajo el EU AI Act:

- Filtros de spam

- Videojuegos con IA

- Sistemas de recomendación de contenidos

- Herramientas de productividad personal

Sin embargo, se anima a los desarrolladores a adoptar códigos de conducta voluntarios y principios de IA responsable.

¿Qué obligaciones tiene tu empresa según su rol en la cadena de valor?

El EU AI Act define diferentes actores con responsabilidades específicas. Identifica tu rol para conocer tus obligaciones exactas.

Si eres PROVEEDOR de sistemas de IA de alto riesgo

Los proveedores son quienes desarrollan o hacen desarrollar sistemas de IA y los comercializan bajo su nombre o marca. Tus obligaciones incluyen:

Antes de la comercialización:

- Sistema de gestión de riesgos (Art. 9): Proceso iterativo durante todo el ciclo de vida para identificar, analizar, evaluar y mitigar riesgos

- Gobernanza de datos (Art. 10): Garantizar calidad, representatividad y ausencia de sesgos en los conjuntos de datos de entrenamiento

- Documentación técnica (Art. 11): Descripción completa del sistema, su finalidad, funcionamiento, capacidades y limitaciones

- Registro de eventos (Art. 12): Capacidad de trazabilidad automática durante el funcionamiento

- Transparencia (Art. 13): Instrucciones de uso claras para desplegadores

- Supervisión humana (Art. 14): Diseño que permita supervisión efectiva por personas

- Exactitud, robustez y ciberseguridad (Art. 15): Niveles apropiados durante todo el ciclo de vida

Procedimientos de conformidad:

- Evaluación de conformidad (interna o por terceros según el tipo de sistema)

- Marcado CE antes de la comercialización

- Declaración UE de conformidad

- Registro en la base de datos de la UE

Obligaciones post-comercialización:

- Vigilancia continua del mercado

- Notificación de incidentes graves en 15 días

- Retirada o recuperación si se detectan no conformidades

- Cooperación con autoridades de vigilancia

Si eres DESPLEGADOR (usuario empresarial) de sistemas de IA de alto riesgo

Los desplegadores son empresas que utilizan sistemas de IA de alto riesgo bajo su autoridad. Aunque el proveedor cumpla, tú también tienes obligaciones:

Obligaciones principales:

- Uso conforme a instrucciones: Utilizar el sistema según las instrucciones del proveedor

- Supervisión humana: Asignar personas físicas competentes para supervisar el sistema

- Datos de entrada: Garantizar que los datos introducidos son pertinentes y suficientemente representativos

- Monitorización: Vigilar el funcionamiento y notificar al proveedor cualquier riesgo o incidente

- Conservación de registros: Mantener los logs generados durante al menos 6 meses

- Información a trabajadores: Informar a empleados y sus representantes antes de usar sistemas que les afecten

- Evaluación de impacto: Para organismos públicos y entidades privadas en servicios públicos esenciales

Obligaciones específicas de transparencia:

- Informar a personas físicas que están siendo sometidas a sistemas de reconocimiento de emociones o categorización biométrica

- En decisiones que afecten a derechos (crédito, seguros, empleo): informar del uso de IA y dar explicaciones significativas

Si eres IMPORTADOR o DISTRIBUIDOR

Importadores (introducen en el mercado UE productos de terceros países):

- Verificar que el proveedor ha realizado la evaluación de conformidad

- Asegurar marcado CE y documentación

- No introducir productos que no cumplan

Distribuidores (ponen a disposición sistemas de IA ya en el mercado):

- Verificar marcado CE y documentación de acompañamiento

- No poner a disposición productos no conformes

- Almacenamiento y transporte adecuados

Obligaciones transversales: Alfabetización en IA

Todas las empresas, independientemente de su rol, deben cumplir con el Artículo 4 de alfabetización en IA desde febrero de 2025:

"Los proveedores y desplegadores de sistemas de IA adoptarán medidas para garantizar que su personal y otras personas que se ocupen del funcionamiento y uso de sistemas de IA en su nombre tengan un nivel suficiente de alfabetización en materia de IA."

Esto implica:

- Formación adaptada a conocimientos técnicos, experiencia y contexto de uso

- Actualización continua conforme evoluciona la tecnología

- Documentación de las acciones formativas realizadas

¿Cuál es el régimen sancionador y las multas del EU AI Act?

El EU AI Act establece un régimen sancionador severo y disuasorio, con multas que superan incluso las del GDPR en términos proporcionales.

Estructura de sanciones por tipo de infracción

Infracciones muy graves (sistemas prohibidos):

- Hasta 35 millones de euros

- O hasta el 7% de la facturación anual mundial del ejercicio anterior

- Se aplica la cantidad mayor

Infracciones graves (incumplimiento de obligaciones de alto riesgo):

- Hasta 15 millones de euros

- O hasta el 3% de la facturación anual mundial

- Se aplica la cantidad mayor

Infracciones leves (información incorrecta a autoridades):

- Hasta 7,5 millones de euros

- O hasta el 1,5% de la facturación anual mundial

- Se aplica la cantidad mayor

Sanciones reducidas para pymes y startups

El EU AI Act reconoce la necesidad de proteger la innovación y establece límites proporcionales para pequeñas empresas:

- Las multas se calculan aplicando porcentajes más bajos o cantidades fijas menores

- Se tienen en cuenta los recursos y viabilidad económica

- Existe un enfoque más orientado a la corrección que a la sanción para primeras infracciones menores

Calendario de aplicación del régimen sancionador

Factores agravantes y atenuantes

Las autoridades considerarán:

Agravantes:

- Reincidencia

- Incumplimiento intencionado

- Falta de cooperación con autoridades

- Duración de la infracción

- Daños causados a personas afectadas

Atenuantes:

- Primeras infracciones

- Adopción inmediata de medidas correctivas

- Cooperación activa con autoridades

- Implementación de códigos de conducta

- Pequeño tamaño de la empresa

¿Cómo preparar tu empresa para cumplir el EU AI Act? Checklist completo

Este checklist te guiará paso a paso hacia el compliance. Prioriza según tus plazos más inmediatos.

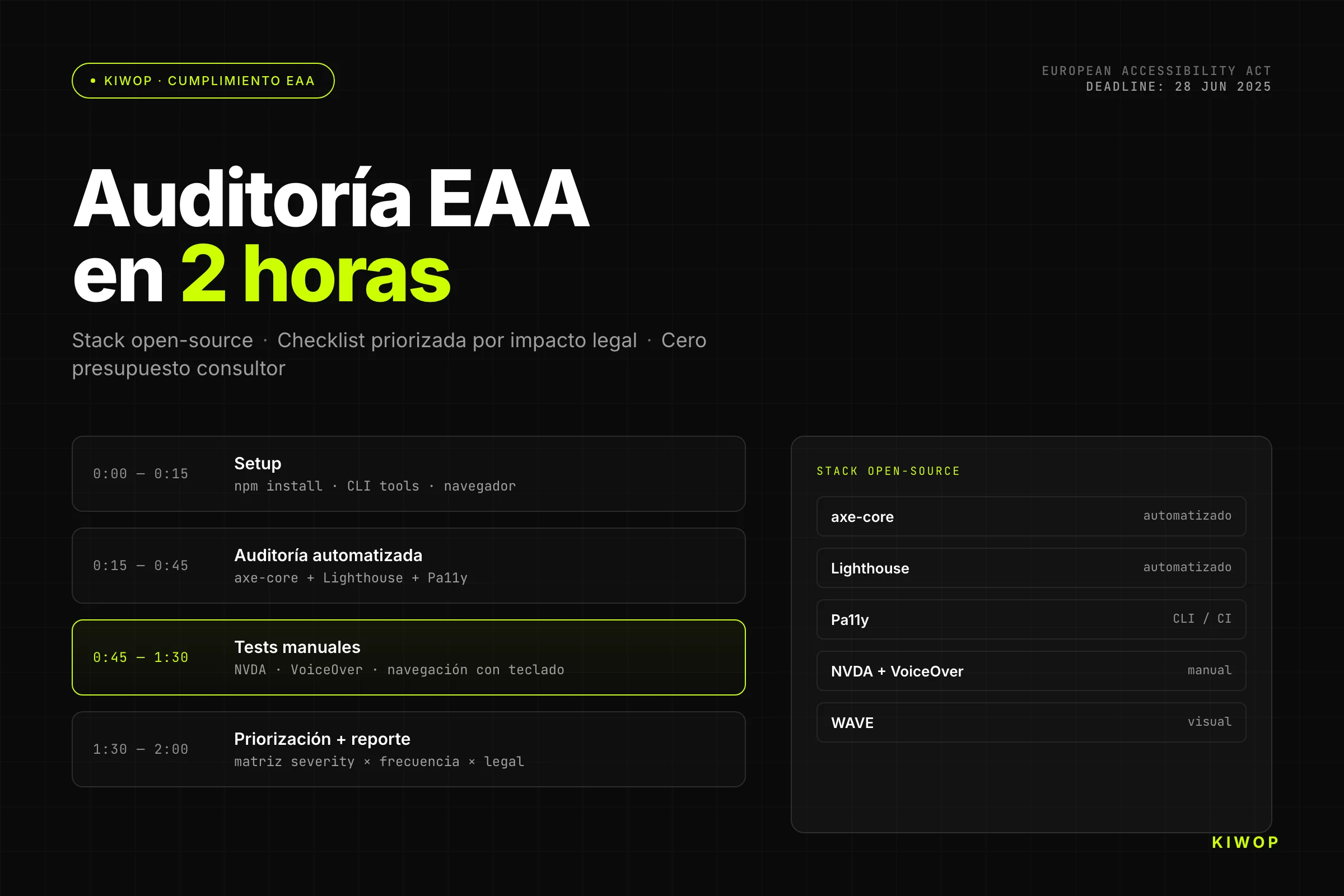

Fase 1: Diagnóstico (Completar urgentemente)

- [ ] Inventario de sistemas de IA: Documenta TODOS los sistemas de IA que utilizas, desarrollas o comercializas

- [ ] Clasificación por riesgo: Asigna cada sistema a una categoría (prohibido, alto, limitado, mínimo)

- [ ] Mapeo de roles: Identifica si actúas como proveedor, desplegador, importador o distribuidor para cada sistema

- [ ] Análisis de brechas: Compara tu situación actual con las obligaciones aplicables

- [ ] Identificación de sistemas prohibidos: Verifica que no utilizas IA de riesgo inaceptable

Fase 2: Gobernanza (Q1 2026)

- [ ] Designar responsable de IA: Nombra un AI Officer o asigna responsabilidades claras

- [ ] Establecer comité de IA: Grupo multidisciplinar (legal, técnico, negocio, RRHH)

- [ ] Definir política de IA: Principios, procedimientos y controles internos

- [ ] Integrar con compliance existente: Coordinación con DPO, compliance officer, seguridad

- [ ] Presupuesto de cumplimiento: Asigna recursos para implementación

Fase 3: Alfabetización (Ya obligatorio)

- [ ] Evaluar competencias actuales: Nivel de conocimiento de IA del personal

- [ ] Plan de formación: Programas adaptados por rol y nivel de interacción con IA

- [ ] Formación de directivos: Sensibilización específica para toma de decisiones

- [ ] Formación técnica: Para desarrolladores e integradores

- [ ] Documentar formaciones: Registros de asistencia y contenidos impartidos

Fase 4: Sistemas de alto riesgo (Antes de agosto 2026)

Para proveedores:

- [ ] Sistema de gestión de riesgos: Implementar proceso documentado

- [ ] Auditoría de datos de entrenamiento: Verificar calidad, representatividad, ausencia de sesgos

- [ ] Documentación técnica completa: Según requisitos del Anexo IV

- [ ] Implementar logging: Capacidad de registro automático de eventos

- [ ] Diseñar supervisión humana: Mecanismos de intervención y override

- [ ] Pruebas de robustez: Verificar exactitud y resistencia a ataques

- [ ] Evaluación de conformidad: Preparar para certificación

- [ ] Registro en base de datos UE: Completar antes de comercialización

Para desplegadores:

- [ ] Revisar instrucciones de proveedores: Asegurar uso conforme

- [ ] Asignar supervisores humanos: Personal competente con autoridad real

- [ ] Proceso de monitorización: Sistema para detectar anomalías

- [ ] Protocolo de notificación: Procedimiento para informar incidentes

- [ ] Evaluación de impacto en derechos fundamentales: Si aplica

- [ ] Comunicación a empleados: Información previa sobre uso de IA en RRHH

Fase 5: Transparencia (Antes de agosto 2026)

- [ ] Avisos de interacción con IA: Implementar en chatbots y asistentes

- [ ] Etiquetado de contenido sintético: Marcas visibles en contenido generado por IA

- [ ] Política de deepfakes: Procedimiento para contenido audiovisual sintético

- [ ] Información a afectados: Comunicaciones cuando IA afecte a decisiones sobre personas

Fase 6: Documentación y registros

- [ ] Políticas documentadas: Todas las políticas de IA por escrito

- [ ] Registros de evaluaciones de riesgo: Conservar según plazos legales

- [ ] Logs de sistemas de alto riesgo: Mínimo 6 meses, recomendable más

- [ ] Evidencias de conformidad: Declaraciones, certificados, auditorías

- [ ] Registros de incidentes: Sistema de gestión de incidentes de IA

Fase 7: Preparación para auditorías

- [ ] Simular inspección: Ejercicio interno de preparación

- [ ] Designar interlocutor: Persona de contacto para autoridades

- [ ] Acceso a documentación: Sistema organizado y accesible

- [ ] Plan de respuesta: Procedimiento ante requerimientos de autoridad

¿Qué sectores se verán más afectados por el EU AI Act?

Aunque el EU AI Act afecta a todas las empresas que usan IA, algunos sectores enfrentan obligaciones especialmente exigentes:

Sector financiero y seguros

- Scoring crediticio clasificado como alto riesgo

- Evaluación de solvencia para préstamos

- Pricing de seguros de vida y salud basado en IA

- Detección de fraude con implicaciones para clientes

Acción recomendada: Auditar todos los modelos de decisión automatizada, documentar criterios de scoring, implementar explicabilidad.

Recursos humanos y selección de personal

- Filtrado automático de CVs = alto riesgo

- Sistemas de evaluación de candidatos

- Monitorización del rendimiento de empleados

- Herramientas de gestión del talento con IA

Acción recomendada: Revisar todos los software de RRHH con componentes de IA, informar a candidatos y empleados, garantizar supervisión humana en decisiones de contratación.

Sector salud

- Dispositivos médicos con IA (regulación dual)

- Sistemas de diagnóstico asistido

- Triaje automatizado

- Análisis de imágenes médicas

Acción recomendada: Verificar conformidad con regulación de productos sanitarios y EU AI Act simultáneamente.

Educación

- Sistemas de admisión automatizados

- Evaluación automática de estudiantes

- Detección de plagio con IA

- Proctoring en exámenes online

Acción recomendada: Revisar software educativo, informar a estudiantes y familias, mantener supervisión docente.

Administración pública

- Evaluación de solicitudes de prestaciones

- Sistemas de priorización de servicios

- IA en fuerzas de seguridad

- Gestión de fronteras y asilo

Acción recomendada: Evaluaciones de impacto en derechos fundamentales obligatorias, máxima transparencia hacia ciudadanos.

¿Necesita tu empresa asesoramiento especializado en EU AI Act?

La complejidad del EU AI Act, con sus múltiples plazos, categorías de riesgo y obligaciones diferenciadas, hace que el asesoramiento especializado no sea un lujo sino una necesidad para la mayoría de empresas.

Señales de que necesitas ayuda profesional

- ✅ Utilizas IA en procesos que afectan a personas (RRHH, crédito, servicios)

- ✅ Desarrollas o comercializas productos con componentes de IA

- ✅ No tienes claro en qué categoría de riesgo están tus sistemas

- ✅ Operas en sectores especialmente regulados

- ✅ No tienes experiencia previa en compliance regulatorio tecnológico

Cómo puede ayudarte Kiwop

En Kiwop llevamos años acompañando a empresas en su transformación digital y adopción responsable de la inteligencia artificial. Nuestros servicios de consultoría en IA incluyen:

- Diagnóstico de cumplimiento EU AI Act: Auditoría completa de tus sistemas de IA

- Clasificación de riesgo: Análisis experto para determinar tus obligaciones exactas

- Roadmap de implementación: Plan personalizado con hitos y recursos

- Documentación técnica: Preparación de documentación requerida por la normativa

- Formación en alfabetización de IA: Programas adaptados para cumplir el Art. 4

- Acompañamiento continuo: Soporte durante todo el proceso de adaptación

El momento de actuar es ahora. Con agosto de 2026 a la vuelta de la esquina, las empresas que empiecen su adaptación hoy tendrán ventaja competitiva frente a quienes esperen al último momento.

Contacta con nuestro equipo para una evaluación inicial sin compromiso de tu situación frente al EU AI Act.

Conclusión: El EU AI Act como oportunidad, no solo como obligación

El EU AI Act representa el marco regulatorio más ambicioso del mundo para la inteligencia artificial. Aunque implica obligaciones significativas, también ofrece oportunidades:

- Diferenciación competitiva: Las empresas que certifiquen su cumplimiento generarán confianza adicional

- Acceso al mercado europeo: Cumplir permite operar sin restricciones en 450 millones de consumidores

- Mejora de procesos: Las obligaciones de documentación y gestión de riesgos mejoran la calidad de los sistemas

- Anticipación a regulación global: Otros mercados seguirán el modelo europeo

Las fechas clave son inamovibles: febrero 2025 ya ha pasado, agosto 2025 es inminente, y agosto 2026 llegará antes de lo que parece. La preparación comienza hoy.

Preguntas frecuentes sobre el EU AI Act

¿El EU AI Act afecta a empresas fuera de la UE?

Sí, el EU AI Act tiene aplicación extraterritorial. Afecta a cualquier empresa que comercialice sistemas de IA en la UE o cuyos outputs de IA se utilicen dentro del territorio europeo, independientemente de dónde esté establecida la empresa.

¿Cuándo entra en vigor completamente el EU AI Act?

El EU AI Act entró en vigor el 1 de agosto de 2024, pero su aplicación es escalonada. Las prohibiciones se aplican desde febrero 2025, las obligaciones de GPAI desde agosto 2025, y la regulación completa para sistemas de alto riesgo desde agosto de 2026. La aplicación total, incluyendo productos regulados, será en agosto de 2027.

¿Qué pasa si mi empresa usa ChatGPT u otros modelos de IA generativa?

Si utilizas modelos de propósito general (GPAI) como ChatGPT, las obligaciones principales recaen sobre el proveedor del modelo (OpenAI). Sin embargo, como desplegador tienes obligaciones de transparencia (informar que los usuarios interactúan con IA) y de uso responsable. Si utilizas estos modelos para decisiones de alto riesgo (RRHH, crédito), entras en la categoría de alto riesgo.

¿Cuánto cuestan las multas por incumplir el EU AI Act?

Las multas pueden alcanzar 35 millones de euros o el 7% de la facturación global para infracciones muy graves (uso de sistemas prohibidos). Para incumplimientos de obligaciones de alto riesgo, hasta 15 millones o el 3%. Para las pymes y startups, se aplican límites proporcionales reducidos.

¿Qué es la "alfabetización en IA" y por qué es obligatoria?

El Artículo 4 del EU AI Act obliga a todas las empresas que utilizan IA a garantizar que su personal tiene competencias suficientes para operar y supervisar estos sistemas. Esto implica formación adaptada, actualización continua y documentación de las acciones formativas. Esta obligación está vigente desde febrero de 2025.

¿Cómo sé si mis sistemas de IA son de "alto riesgo"?

Un sistema es de alto riesgo si: (1) es un componente de seguridad en productos ya regulados (dispositivos médicos, maquinaria, etc.), o (2) está incluido en el Anexo III del Reglamento, que lista sectores como biometría, infraestructuras críticas, educación, empleo, servicios esenciales, aplicación de la ley, migración y justicia.

¿Puedo seguir usando IA para filtrar CVs en procesos de selección?

Sí, pero con obligaciones estrictas. Los sistemas de IA para selección de personal están clasificados como alto riesgo. Debes usar sistemas conformes con el EU AI Act, garantizar supervisión humana efectiva, informar a candidatos del uso de IA, y mantener capacidad de explicar las decisiones tomadas.

¿Qué diferencia hay entre "proveedor" y "desplegador" en el EU AI Act?

El proveedor es quien desarrolla o hace desarrollar el sistema de IA y lo comercializa bajo su nombre. El desplegador es quien utiliza un sistema de IA bajo su autoridad profesional (usuario empresarial). Ambos tienen obligaciones, pero las del proveedor son más extensas (diseño, documentación, conformidad). El desplegador debe usar el sistema correctamente, supervisarlo y notificar problemas.

Artículo actualizado a enero de 2026. La regulación de IA está en constante evolución. Consulta siempre fuentes oficiales y asesoramiento profesional para decisiones específicas de tu empresa.