EU AI Act 2026 : ce que votre entreprise doit savoir pour se conformer à la réglementation

Le Règlement Européen sur l'Intelligence Artificielle est désormais en vigueur. Depuis février 2025, les premières obligations sont exigibles, et en août 2026, l'application complète pour les systèmes à haut risque entrera en vigueur. Si votre entreprise développe, déploie ou utilise des systèmes d'IA, cet article est votre feuille de route essentielle pour éviter des sanctions allant jusqu'à 35 millions d'euros ou 7 % de votre chiffre d'affaires mondial.

Nous ne parlons pas de réglementation future : l'EU AI Act est une loi en vigueur. Les entreprises qui n'agissent pas maintenant risquent des amendes exemplaires et, pire encore, l'interdiction d'opérer leurs systèmes d'IA sur le marché européen.

Dans ce guide exhaustif, nous décomposons tout ce que vous devez savoir : des dates critiques aux obligations spécifiques selon votre rôle et secteur, en passant par une checklist pratique de conformité que vous pouvez mettre en œuvre dès aujourd'hui.

Qu'est-ce que l'EU AI Act et pourquoi cela devrait-il vous importer en 2026 ?

Le Règlement (UE) 2024/1689, connu sous le nom d'EU AI Act ou Loi sur l'Intelligence Artificielle, est le premier cadre réglementaire intégral au monde pour l'intelligence artificielle. Approuvé le 13 juin 2024 et publié au Journal Officiel de l'UE le 12 juillet 2024, il est entré en vigueur le 1er août 2024.

Mais voici l'essentiel : son application est échelonnée, et les délais les plus importants se déroulent actuellement ou arriveront dans les prochains mois.

Pourquoi 2026 est l'année décisive

L'EU AI Act n'est pas comme le RGPD, qui a accordé une période de grâce étendue. La mise en œuvre par phases signifie que :

- Février 2025 : Certains systèmes d'IA considérés comme "à risque inacceptable" sont déjà interdits

- Août 2025 : Les obligations pour les modèles d'IA à usage général (GPAI) sont exigibles

- Août 2026 : La réglementation complète pour les systèmes à haut risque entre en vigueur

- Août 2027 : Application totale, y compris les systèmes intégrés dans des produits réglementés

Si votre entreprise utilise ChatGPT, des outils d'analyse prédictive, des systèmes de reconnaissance faciale, des chatbots de service client, ou toute autre technologie basée sur l'IA, vous êtes concerné par le champ d'application.

Champ d'application territorial : à qui s'adresse-t-il ?

L'EU AI Act a une application extraterritoriale, similaire au RGPD :

- Fournisseurs de systèmes d'IA qui commercialisent ou mettent en service des systèmes dans l'UE, indépendamment de leur lieu d'établissement

- Déployeurs (utilisateurs professionnels) de systèmes d'IA situés dans l'UE

- Fournisseurs et déployeurs hors de l'UE dont les résultats d'IA sont utilisés sur le territoire européen

- Importateurs et distributeurs de systèmes d'IA sur le marché européen

- Représentants autorisés de fournisseurs non établis dans l'UE

En résumé : si votre IA touche l'Europe de quelque manière que ce soit, vous devez vous conformer.

Quelles sont les dates clés de l'EU AI Act que vous ne pouvez pas ignorer ?

Le calendrier de mise en œuvre de l'EU AI Act est complexe mais crucial. Voici le calendrier complet avec ce que chaque date implique pour votre entreprise :

Dates déjà passées (conformité obligatoire)

1er août 2024 – Entrée en vigueur Le règlement est devenu loi. Le début de la période de transition.

2 février 2025 – Première vague d'obligations

- ✅ Interdiction des systèmes d'IA à risque inacceptable (notation sociale, manipulation subliminale, exploitation des vulnérables, surveillance biométrique massive dans les espaces publics)

- ✅ Obligation d'alphabétisation en IA (Art. 4) : Les entreprises doivent garantir que leur personnel possède des compétences suffisantes pour opérer et superviser des systèmes d'IA

- ✅ Notification aux autorités des systèmes d'IA interdits qui étaient en usage

2 août 2025 – Modèles à usage général (GPAI)

- Obligations de transparence pour les fournisseurs de modèles fondamentaux

- Documentation technique obligatoire

- Conformité aux normes de droits d'auteur

- Exigences supplémentaires pour les modèles avec "risque systémique" (ceux entraînés avec plus de 10²⁵ FLOPs)

Dates imminentes (préparation urgente)

2 août 2026 – Application générale C'est la date la plus importante pour la majorité des entreprises :

- 🔴 Systèmes d'IA à haut risque : Obligations complètes de conformité

- 🔴 Obligations de transparence de l'Article 50 : divulgation des interactions avec l'IA, étiquetage du contenu synthétique, identification des deepfakes

- 🔴 Enregistrement obligatoire dans la base de données de l'UE pour les systèmes à haut risque

- 🔴 Activation complète du régime de sanctions

Date finale

2 août 2027 – Application totale

- Systèmes d'IA à haut risque intégrés dans des produits déjà réglementés par la législation sectorielle (dispositifs médicaux, machines, jouets, etc.)

- Clôture de toutes les périodes transitoires

Comment l'EU AI Act classe-t-il les systèmes d'IA selon leur risque ?

L'approche de l'EU AI Act repose sur une pyramide de risque à quatre niveaux. Chaque niveau entraîne des obligations différentes, allant de l'interdiction totale à l'absence de exigences spécifiques.

Niveau 1 : Risque inacceptable (INTERDIT)

Ces systèmes sont complètement interdits depuis février 2025 :

Manipulation cognitive

- Systèmes utilisant des techniques subliminales ou manipulatrices pour distordre le comportement des personnes

- IA exploitant les vulnérabilités de groupes spécifiques (âge, handicap, situation économique)

Notation sociale

- Systèmes de notation sociale par les autorités publiques

- Classification des citoyens basée sur le comportement social ou les caractéristiques personnelles avec des conséquences préjudiciables

Surveillance biométrique massive

- Identification biométrique à distance en temps réel dans les espaces publics (avec des exceptions très limitées pour la sécurité)

- Systèmes de catégorisation biométrique inférant des données sensibles (race, orientation sexuelle, affiliation politique, croyances religieuses)

Autres interdictions

- Scraping non sélectif d'images faciales d'internet ou de CCTV pour des bases de données de reconnaissance faciale

- Reconnaissance des émotions sur les lieux de travail ou dans les institutions éducatives (sauf pour des raisons médicales ou de sécurité)

- IA prédictive de comportement criminel basée uniquement sur des profils ou traits de personnalité

Niveau 2 : Haut risque (RÉGULATION STRICTE)

Les systèmes à haut risque sont soumis à des obligations exhaustives. Ils se divisent en deux catégories :

Systèmes d'IA comme composants de sécurité dans des produits réglementés :

- Dispositifs médicaux

- Véhicules et machines

- Jouets

- Équipements de protection individuelle

- Ascenseurs et équipements sous pression

- Aviation et ferroviaire

Systèmes d'IA indépendants dans des secteurs critiques (Annexe III) :

Niveau 3 : Risque limité (TRANSPARENCE)

Systèmes avec obligations spécifiques de transparence :

- Chatbots et assistants virtuels : Doivent clairement informer que l'utilisateur interagit avec une IA

- Génération de contenu synthétique : Textes, images, audio et vidéo générés par IA doivent être étiquetés comme tels

- Deepfakes : Obligation de révéler que le contenu a été généré ou manipulé artificiellement

- Systèmes de reconnaissance des émotions : Informer les personnes lorsqu'elles sont analysées

Niveau 4 : Risque minimal ou nul

La majorité des systèmes d'IA entrent dans cette catégorie et n'ont pas d'obligations spécifiques sous l'EU AI Act :

- Filtres anti-spam

- Jeux vidéo avec IA

- Systèmes de recommandation de contenus

- Outils de productivité personnelle

Cependant, les développeurs sont encouragés à adopter des codes de conduite volontaires et des principes d'IA responsable.

Quelles obligations a votre entreprise selon son rôle dans la chaîne de valeur ?

L'EU AI Act définit différents acteurs avec des responsabilités spécifiques. Identifiez votre rôle pour connaître vos obligations exactes.

Si vous êtes FOURNISSEUR de systèmes d'IA à haut risque

Les fournisseurs sont ceux qui développent ou font développer des systèmes d'IA et les commercialisent sous leur nom ou marque. Vos obligations incluent :

Avant la commercialisation :

- Système de gestion des risques (Art. 9) : Processus itératif pendant tout le cycle de vie pour identifier, analyser, évaluer et atténuer les risques

- Gouvernance des données (Art. 10) : Garantir qualité, représentativité et absence de biais dans les ensembles de données d'entraînement

- Documentation technique (Art. 11) : Description complète du système, sa finalité, son fonctionnement, ses capacités et ses limitations

- Enregistrement des événements (Art. 12) : Capacité de traçabilité automatique pendant le fonctionnement

- Transparence (Art. 13) : Instructions d'utilisation claires pour les déployeurs

- Supervision humaine (Art. 14) : Conception permettant une supervision efficace par des personnes

- Précision, robustesse et cybersécurité (Art. 15) : Niveaux appropriés pendant tout le cycle de vie

Procédures de conformité :

- Évaluation de conformité (interne ou par tiers selon le type de système)

- Marquage CE avant la commercialisation

- Déclaration UE de conformité

- Enregistrement dans la base de données de l'UE

Obligations post-commercialisation :

- Surveillance continue du marché

- Notification des incidents graves en 15 jours

- Retrait ou récupération si des non-conformités sont détectées

- Coopération avec les autorités de surveillance

Si vous êtes DÉPLOYEUR (utilisateur professionnel) de systèmes d'IA à haut risque

Les déployeurs sont des entreprises qui utilisent des systèmes d'IA à haut risque sous leur autorité. Bien que le fournisseur soit conforme, vous avez aussi des obligations :

Obligations principales :

- Utilisation conforme aux instructions : Utiliser le système selon les instructions du fournisseur

- Supervision humaine : Assigner des personnes physiques compétentes pour superviser le système

- Données d'entrée : Garantir que les données introduites sont pertinentes et suffisamment représentatives

- Surveillance : Surveiller le fonctionnement et notifier au fournisseur tout risque ou incident

- Conservation des enregistrements : Conserver les logs générés pendant au moins 6 mois

- Information aux travailleurs : Informer les employés et leurs représentants avant d'utiliser des systèmes qui les affectent

- Évaluation d'impact : Pour les organismes publics et entités privées dans les services publics essentiels

Obligations spécifiques de transparence :

- Informer les personnes physiques qu'elles sont soumises à des systèmes de reconnaissance des émotions ou de catégorisation biométrique

- Dans les décisions affectant des droits (crédit, assurances, emploi) : informer de l'utilisation de l'IA et donner des explications significatives

Si vous êtes IMPORTATEUR ou DISTRIBUTEUR

Importateurs (introduisent sur le marché UE des produits de pays tiers) :

- Vérifier que le fournisseur a réalisé l'évaluation de conformité

- Assurer le marquage CE et la documentation

- Ne pas introduire de produits non conformes

Distributeurs (mettent à disposition des systèmes d'IA déjà sur le marché) :

- Vérifier le marquage CE et la documentation d'accompagnement

- Ne pas mettre à disposition de produits non conformes

- Stockage et transport adéquats

Obligations transversales : Alphabétisation en IA

Toutes les entreprises, indépendamment de leur rôle, doivent se conformer à l'Article 4 d'alphabétisation en IA depuis février 2025 :

"Les fournisseurs et déployeurs de systèmes d'IA adopteront des mesures pour garantir que leur personnel et d'autres personnes s'occupant du fonctionnement et de l'utilisation de systèmes d'IA en leur nom ont un niveau suffisant d'alphabétisation en matière d'IA."

Cela implique :

- Formation adaptée aux connaissances techniques, expérience et contexte d'utilisation

- Mise à jour continue au fur et à mesure que la technologie évolue

- Documentation des actions de formation réalisées

Quel est le régime de sanctions et les amendes de l'EU AI Act ?

L'EU AI Act établit un régime de sanctions sévère et dissuasif, avec des amendes qui dépassent même celles du RGPD en termes proportionnels.

Structure des sanctions par type d'infraction

Infractions très graves (systèmes interdits) :

- Jusqu'à 35 millions d'euros

- Ou jusqu'à 7 % du chiffre d'affaires annuel mondial de l'exercice précédent

- La plus grande somme s'applique

Infractions graves (non-respect des obligations de haut risque) :

- Jusqu'à 15 millions d'euros

- Ou jusqu'à 3 % du chiffre d'affaires annuel mondial

- La plus grande somme s'applique

Infractions légères (informations incorrectes aux autorités) :

- Jusqu'à 7,5 millions d'euros

- Ou jusqu'à 1,5 % du chiffre d'affaires annuel mondial

- La plus grande somme s'applique

Sanctions réduites pour les PME et startups

L'EU AI Act reconnaît la nécessité de protéger l'innovation et établit des limites proportionnelles pour les petites entreprises :

- Les amendes sont calculées en appliquant des pourcentages plus bas ou des montants fixes moindres

- Les ressources et la viabilité économique sont prises en compte

- Il existe une approche plus orientée vers la correction que vers la sanction pour les premières infractions mineures

Calendrier d'application du régime de sanctions

Facteurs aggravants et atténuants

Les autorités prendront en compte :

Aggravants :

- Récidive

- Non-respect intentionnel

- Manque de coopération avec les autorités

- Durée de l'infraction

- Dommages causés aux personnes affectées

Atenuants :

- Premières infractions

- Adoption immédiate de mesures correctives

- Coopération active avec les autorités

- Mise en œuvre de codes de conduite

- Petite taille de l'entreprise

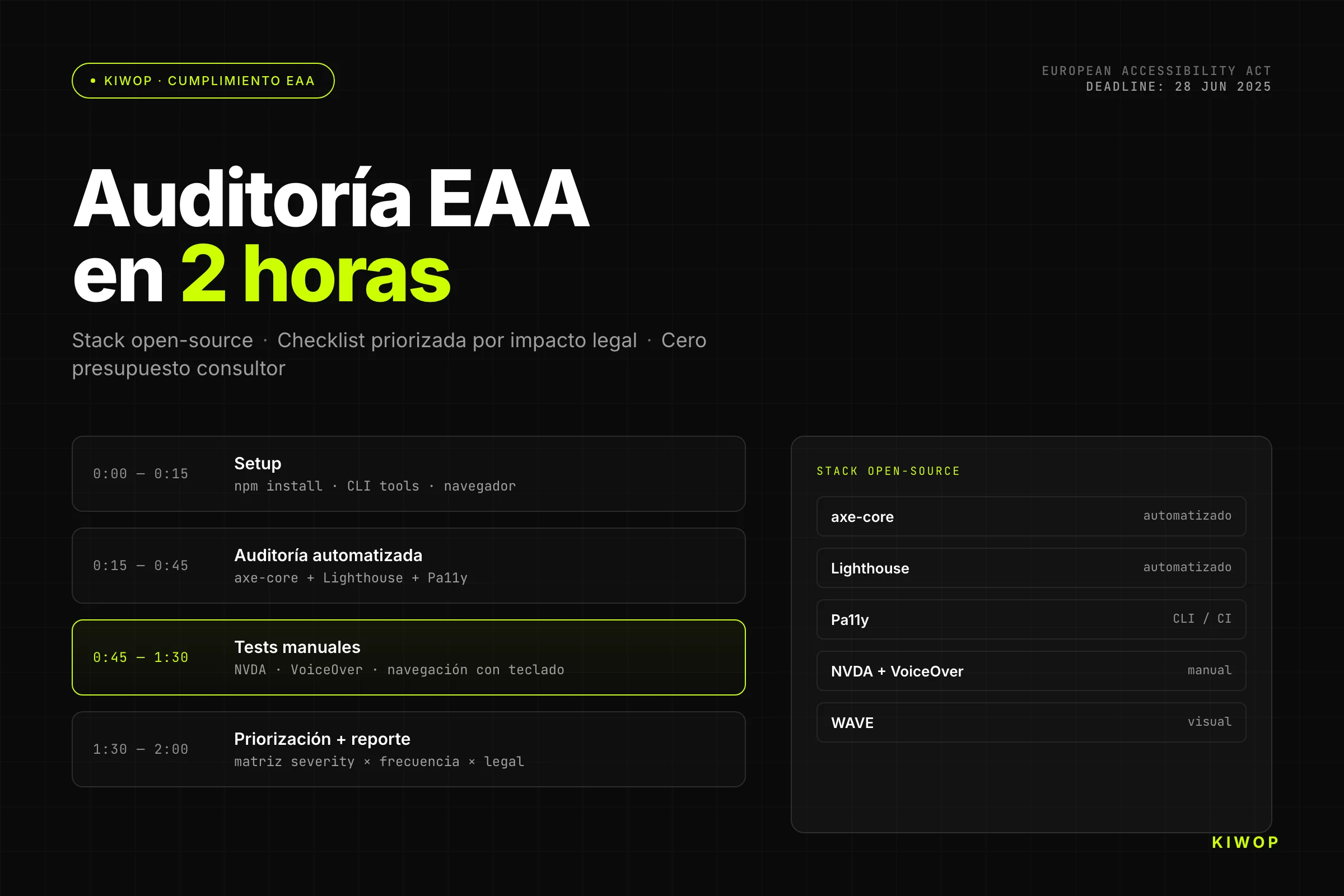

Comment préparer votre entreprise à se conformer à l'EU AI Act ? Checklist complète

Cette checklist vous guidera étape par étape vers la conformité. Priorisez selon vos délais les plus immédiats.

Phase 1 : Diagnostic (À compléter d'urgence)

- Inventaire des systèmes d'IA : Documentez TOUS les systèmes d'IA que vous utilisez, développez ou commercialisez

- Classification par risque : Attribuez chaque système à une catégorie (interdit, haut, limité, minimal)

- Cartographie des rôles : Identifiez si vous agissez en tant que fournisseur, déployeur, importateur ou distributeur pour chaque système

- Analyse des écarts : Comparez votre situation actuelle avec les obligations applicables

- Identification des systèmes interdits : Vérifiez que vous n'utilisez pas d'IA à risque inacceptable

Phase 2 : Gouvernance (T1 2026)

- Désigner un responsable de l'IA : Nommez un AI Officer ou assignez des responsabilités claires

- Établir un comité de l'IA : Groupe multidisciplinaire (juridique, technique, commercial, RH)

- Définir une politique de l'IA : Principes, procédures et contrôles internes

- Intégrer avec la conformité existante : Coordination avec DPO, compliance officer, sécurité

- Budget de conformité : Allouez des ressources pour la mise en œuvre

Phase 3 : Alphabétisation (Déjà obligatoire)

- Évaluer les compétences actuelles : Niveau de connaissance de l'IA du personnel

- Plan de formation : Programmes adaptés par rôle et niveau d'interaction avec l'IA

- Formation des dirigeants : Sensibilisation spécifique pour la prise de décisions

- Formation technique : Pour les développeurs et intégrateurs

- Documenter les formations : Registres de présence et contenus dispensés

Phase 4 : Systèmes à haut risque (Avant août 2026)

Pour les fournisseurs :

- Système de gestion des risques : Mettre en œuvre un processus documenté

- Audit des données d'entraînement : Vérifier qualité, représentativité, absence de biais

- Documentation technique complète : Selon les exigences de l'Annexe IV

- Mettre en œuvre le logging : Capacité d'enregistrement automatique des événements

- Concevoir la supervision humaine : Mécanismes d'intervention et d'annulation

- Tests de robustesse : Vérifier précision et résistance aux attaques

- Évaluation de conformité : Préparer pour la certification

- Enregistrement dans la base de données UE : Compléter avant la commercialisation

Pour les déployeurs :

- Revoir les instructions des fournisseurs : Assurer une utilisation conforme

- Assigner des superviseurs humains : Personnel compétent avec autorité réelle

- Processus de surveillance : Système pour détecter les anomalies

- Protocole de notification : Procédure pour informer des incidents

- Évaluation de l'impact sur les droits fondamentaux : Si applicable

- Communication aux employés : Information préalable sur l'utilisation de l'IA en RH

Phase 5 : Transparence (Avant août 2026)

- Avis d'interaction avec l'IA : Mettre en œuvre dans les chatbots et assistants

- Étiquetage du contenu synthétique : Marques visibles sur le contenu généré par IA

- Politique de deepfakes : Procédure pour le contenu audiovisuel synthétique

- Information aux personnes concernées : Communications lorsque l'IA affecte des décisions sur les personnes

Phase 6 : Documentation et enregistrements

- Politiques documentées : Toutes les politiques de l'IA par écrit

- Registres des évaluations de risque : Conserver selon les délais légaux

- Logs des systèmes à haut risque : Minimum 6 mois, recommandé plus

- Preuves de conformité : Déclarations, certificats, audits

- Registres des incidents : Système de gestion des incidents de l'IA

Phase 7 : Préparation pour les audits

- Simuler une inspection : Exercice interne de préparation

- Désigner un interlocuteur : Personne de contact pour les autorités

- Accès à la documentation : Système organisé et accessible

- Plan de réponse : Procédure en cas de demande d'autorité

Quels secteurs seront les plus affectés par l'EU AI Act ?

Bien que l'EU AI Act affecte toutes les entreprises qui utilisent l'IA, certains secteurs font face à des obligations particulièrement exigeantes :

Secteur financier et assurances

- Scoring de crédit classé comme haut risque

- Évaluation de solvabilité pour les prêts

- Tarification des assurances vie et santé basée sur l'IA

- Détection de fraude avec implications pour les clients

Action recommandée : Auditer tous les modèles de décision automatisée, documenter les critères de scoring, mettre en œuvre l'explicabilité.

Ressources humaines et sélection de personnel

- Filtrage automatique des CVs = haut risque

- Systèmes d'évaluation de candidats

- Surveillance de la performance des employés

- Outils de gestion des talents avec IA

Action recommandée : Revoir tous les logiciels RH avec composants IA, informer les candidats et employés, garantir la supervision humaine dans les décisions de recrutement.

Secteur santé

- Dispositifs médicaux avec IA (régulation double)

- Systèmes de diagnostic assisté

- Triage automatisé

- Analyse d'images médicales

Action recommandée : Vérifier la conformité avec la réglementation des produits de santé et l'EU AI Act simultanément.

Éducation

- Systèmes d'admission automatisés

- Évaluation automatique des étudiants

- Détection de plagiat avec IA

- Surveillance des examens en ligne

Action recommandée : Revoir les logiciels éducatifs, informer les étudiants et familles, maintenir la supervision enseignante.

Administration publique

- Évaluation des demandes de prestations

- Systèmes de priorisation des services

- IA dans les forces de sécurité

- Gestion des frontières et asile

Action recommandée : Évaluations d'impact sur les droits fondamentaux obligatoires, transparence maximale envers les citoyens.

Votre entreprise a-t-elle besoin de conseils spécialisés sur l'EU AI Act ?

La complexité de l'EU AI Act, avec ses multiples délais, catégories de risque et obligations différenciées, fait que le conseil spécialisé n'est pas un luxe mais une nécessité pour la plupart des entreprises.

Signes que vous avez besoin d'aide professionnelle

✅ Vous utilisez l'IA dans des processus qui affectent des personnes (RH, crédit, services) ✅ Vous développez ou commercialisez des produits avec des composants d'IA ✅ Vous n'êtes pas sûr de la catégorie de risque de vos systèmes ✅ Vous opérez dans des secteurs particulièrement réglementés ✅ Vous n'avez pas d'expérience préalable en conformité réglementaire technologique

Comment Kiwop peut vous aider

Chez Kiwop nous accompagnons les entreprises dans leur transformation numérique et l'adoption responsable de l'intelligence artificielle depuis des années. Nos services de conseil en IA incluent :

- Diagnostic de conformité EU AI Act : Audit complet de vos systèmes d'IA

- Classification de risque : Analyse experte pour déterminer vos obligations exactes

- Feuille de route de mise en œuvre : Plan personnalisé avec jalons et ressources

- Documentation technique : Préparation de la documentation requise par la réglementation

- Formation en alphabétisation de l'IA : Programmes adaptés pour se conformer à l'Art. 4

- Accompagnement continu : Support pendant tout le processus d'adaptation

Le moment d'agir est maintenant. Avec août 2026 à l'horizon, les entreprises qui commencent leur adaptation aujourd'hui auront un avantage concurrentiel par rapport à celles qui attendent le dernier moment.

Contactez notre équipe pour une évaluation initiale sans engagement de votre situation face à l'EU AI Act.

Conclusion : l'EU AI Act comme opportunité, pas seulement comme obligation

L'EU AI Act représente le cadre réglementaire le plus ambitieux au monde pour l'intelligence artificielle. Bien qu'il implique des obligations significatives, il offre également des opportunités :

- Différenciation concurrentielle : Les entreprises qui certifient leur conformité généreront une confiance supplémentaire

- Accès au marché européen : Se conformer permet d'opérer sans restrictions sur un marché de 450 millions de consommateurs

- Amélioration des processus : Les obligations de documentation et de gestion des risques améliorent la qualité des systèmes

- Anticipation à la réglementation mondiale : D'autres marchés suivront le modèle européen

Les dates clés sont inamovibles : février 2025 est déjà passé, août 2025 est imminent, et août 2026 arrivera plus vite qu'il n'y paraît. La préparation commence aujourd'hui.

Questions fréquentes sur l'EU AI Act

L'EU AI Act affecte-t-il les entreprises hors de l'UE ?

Oui, l'EU AI Act a une application extraterritoriale. Il affecte toute entreprise qui commercialise des systèmes d'IA dans l'UE ou dont les résultats d'IA sont utilisés sur le territoire européen, indépendamment de l'endroit où l'entreprise est établie.

Quand l'EU AI Act entre-t-il complètement en vigueur ?

L'EU AI Act est entré en vigueur le 1er août 2024, mais son application est échelonnée. Les interdictions s'appliquent depuis février 2025, les obligations de GPAI depuis août 2025, et la réglementation complète pour les systèmes à haut risque depuis août 2026. L'application totale, y compris les produits réglementés, sera en août 2027.

Que se passe-t-il si mon entreprise utilise ChatGPT ou d'autres modèles d'IA générative ?

Si vous utilisez des modèles à usage général (GPAI) comme ChatGPT, les obligations principales incombent au fournisseur du modèle (OpenAI). Cependant, en tant que déployeur, vous avez des obligations de transparence (informer que les utilisateurs interagissent avec l'IA) et d'utilisation responsable. Si vous utilisez ces modèles pour des décisions à haut risque (RH, crédit), vous entrez dans la catégorie de haut risque.

Combien coûtent les amendes pour non-conformité à l'EU AI Act ?

Les amendes peuvent atteindre 35 millions d'euros ou 7 % du chiffre d'affaires mondial pour les infractions très graves (utilisation de systèmes interdits). Pour les non-conformités aux obligations de haut risque, jusqu'à 15 millions ou 3 %. Pour les PME et startups, des limites proportionnelles réduites s'appliquent.

Qu'est-ce que l'alphabétisation en IA et pourquoi est-elle obligatoire ?

L'Article 4 de l'EU AI Act oblige toutes les entreprises qui utilisent l'IA à garantir que leur personnel a des compétences suffisantes pour opérer et superviser ces systèmes. Cela implique une formation adaptée, une mise à jour continue et une documentation des actions de formation. Cette obligation est en vigueur depuis février 2025.

Comment savoir si mes systèmes d'IA sont de "haut risque" ?

Un système est de haut risque si : (1) il est un composant de sécurité dans des produits déjà réglementés (dispositifs médicaux, machines, etc.), ou (2) il est inclus dans l'Annexe III du Règlement, qui liste des secteurs comme la biométrie, les infrastructures critiques, l'éducation, l'emploi, les services essentiels, l'application de la loi, la migration et la justice.

Puis-je continuer à utiliser l'IA pour filtrer les CVs dans les processus de sélection ?

Oui, mais avec des obligations strictes. Les systèmes d'IA pour la sélection de personnel sont classés comme haut risque. Vous devez utiliser des systèmes conformes à l'EU AI Act, garantir une supervision humaine effective, informer les candidats de l'utilisation de l'IA, et maintenir la capacité d'expliquer les décisions prises.

Quelle est la différence entre "fournisseur" et "déployeur" dans l'EU AI Act ?

Le fournisseur est celui qui développe ou fait développer le système d'IA et le commercialise sous son nom. Le déployeur est celui qui utilise un système d'IA sous son autorité professionnelle (utilisateur professionnel). Les deux ont des obligations, mais celles du fournisseur sont plus étendues (conception, documentation, conformité). Le déployeur doit utiliser le système correctement, le superviser et notifier les problèmes.

Article mis à jour en janvier 2026. La réglementation de l'IA est en constante évolution. Consultez toujours des sources officielles et des conseils professionnels pour des décisions spécifiques à votre entreprise.

{

"@context": "https://schema.org",

"@type": "FAQPage",

"mainEntity": [

{

"@type": "Question",

"name": "L'EU AI Act affecte-t-il les entreprises hors de l'UE ?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Oui, l'EU AI Act a une application extraterritoriale. Il affecte toute entreprise qui commercialise des systèmes d'IA dans l'UE ou dont les résultats d'IA sont utilisés sur le territoire européen, indépendamment de l'endroit où l'entreprise est établie."

}

},

{

"@type": "Question",

"name": "Quand l'EU AI Act entre-t-il complètement en vigueur ?",

"acceptedAnswer": {

"@type": "Answer",

"text": "L'EU AI Act est entré en vigueur le 1er août 2024, mais son application est échelonnée. Les interdictions s'appliquent depuis février 2025, les obligations de GPAI depuis août 2025, et la réglementation complète pour les systèmes à haut risque depuis août 2026. L'application totale sera en août 2027."

}

},

{

"@type": "Question",

"name": "Que se passe-t-il si mon entreprise utilise ChatGPT ou d'autres modèles d'IA générative ?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Si vous utilisez des modèles à usage général (GPAI) comme ChatGPT, les obligations principales incombent au fournisseur du modèle. Cependant, en tant que déployeur, vous avez des obligations de transparence et d'utilisation responsable. Si vous utilisez ces modèles pour des décisions à haut risque (RH, crédit), vous entrez dans la catégorie de haut risque."

}

},

{

"@type": "Question",

"name": "Combien coûtent les amendes pour non-conformité à l'EU AI Act ?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Les amendes peuvent atteindre 35 millions d'euros ou 7 % du chiffre d'affaires mondial pour les infractions très graves (utilisation de systèmes interdits). Pour les non-conformités aux obligations de haut risque, jusqu'à 15 millions ou 3 %. Pour les PME et startups, des limites proportionnelles réduites s'appliquent."

}

},

{

"@type": "Question",

"name": "Qu'est-ce que l'alphabétisation en IA et pourquoi est-elle obligatoire ?",

"acceptedAnswer": {

"@type": "Answer",

"text": "L'Article 4 de l'EU AI Act oblige toutes les entreprises qui utilisent l'IA à garantir que leur personnel a des compétences suffisantes pour opérer et superviser ces systèmes. Cela implique une formation adaptée, une mise à jour continue et une documentation des actions de formation. Cette obligation est en vigueur depuis février 2025."

}

},

{

"@type": "Question",

"name": "Comment savoir si mes systèmes d'IA sont de 'haut risque' ?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Un système est de haut risque si : (1) il est un composant de sécurité dans des produits déjà réglementés (dispositifs médicaux, machines, etc.), ou (2) il est inclus dans l'Annexe III du Règlement, qui liste des secteurs comme la biométrie, les infrastructures critiques, l'éducation, l'emploi, les services essentiels, l'application de la loi, la migration et la justice."

}

},

{

"@type": "Question",

"name": "Puis-je continuer à utiliser l'IA pour filtrer les CVs dans les processus de sélection ?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Oui, mais avec des obligations strictes. Les systèmes d'IA pour la sélection de personnel sont classés comme haut risque. Vous devez utiliser des systèmes conformes à l'EU AI Act, garantir une supervision humaine effective, informer les candidats de l'utilisation de l'IA, et maintenir la capacité d'expliquer les décisions prises."

}

},

{

"@type": "Question",

"name": "Quelle est la différence entre 'fournisseur' et 'déployeur' dans l'EU AI Act ?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Le fournisseur est celui qui développe ou fait développer le système d'IA et le commercialise sous son nom. Le déployeur est celui qui utilise un système d'IA sous son autorité professionnelle (utilisateur professionnel). Les deux ont des obligations, mais celles du fournisseur sont plus étendues (conception, documentation, conformité). Le déployeur doit utiliser le système correctement, le superviser et notifier les problèmes."

}

}

]

}