EU AI Act 2026: Was Ihr Unternehmen wissen muss, um die Vorschriften einzuhalten

Die Europäische Verordnung über Künstliche Intelligenz ist bereits in Kraft. Seit Februar 2025 sind die ersten Verpflichtungen verbindlich, und im August 2026 wird die volle Anwendung für Hochrisikosysteme in Kraft treten. Wenn Ihr Unternehmen KI-Systeme entwickelt, einsetzt oder nutzt, ist dieser Artikel Ihr unverzichtbarer Fahrplan, um Sanktionen von bis zu 35 Millionen Euro oder 7 % Ihres weltweiten Umsatzes zu vermeiden.

Wir sprechen nicht von zukünftiger Regulierung: der EU AI Act ist geltendes Recht. Unternehmen, die jetzt nicht handeln, sehen sich mit exemplarischen Geldstrafen konfrontiert und, was noch schlimmer ist, mit dem Verbot, ihre KI-Systeme auf dem europäischen Markt zu betreiben.

In diesem umfassenden Leitfaden zerlegen wir alles, was Sie wissen müssen: von den kritischen Terminen bis zu den spezifischen Verpflichtungen je nach Rolle und Sektor, einschließlich einer praktischen Compliance-Checkliste, die Sie ab heute umsetzen können.

Was ist der EU AI Act und warum sollte er Sie 2026 interessieren?

Die Verordnung (EU) 2024/1689, bekannt als EU AI Act oder Künstliche-Intelligenz-Gesetz, ist der weltweit erste umfassende regulatorische Rahmen für künstliche Intelligenz. Verabschiedet am 13. Juni 2024 und veröffentlicht im Amtsblatt der EU am 12. Juli 2024, trat sie am 1. August 2024 in Kraft.

Aber hier kommt das Entscheidende: ihre Anwendung ist gestaffelt, und die wichtigsten Fristen laufen gerade oder stehen in den nächsten Monaten an.

Warum 2026 das entscheidende Jahr ist

Der EU AI Act ist nicht wie die DSGVO, die eine großzügige Schonfrist gewährte. Die phasenweise Umsetzung bedeutet:

- Februar 2025: Bestimmte KI-Systeme, die als "inakzeptables Risiko" gelten, sind bereits verboten

- August 2025: Die Verpflichtungen für allgemeine KI-Modelle (GPAI) sind verbindlich

- August 2026: Die vollständige Regulierung für Hochrisikosysteme tritt in Kraft

- August 2027: Vollständige Anwendung, einschließlich in regulierten Produkten integrierter Systeme

Wenn Ihr Unternehmen ChatGPT, prädiktive Analysetools, Gesichtserkennungssysteme, Kundenservice-Chatbots oder andere KI-basierte Technologien nutzt, sind Sie im Anwendungsbereich.

Räumlicher Anwendungsbereich: Wen betrifft es?

Der EU AI Act hat eine extraterritoriale Anwendung, ähnlich der DSGVO:

- Anbieter von KI-Systemen, die Systeme in der EU vermarkten oder in Betrieb nehmen, unabhängig davon, wo sie ansässig sind

- Nutzer (geschäftliche Anwender) von KI-Systemen mit Sitz in der EU

- Anbieter und Nutzer außerhalb der EU, deren KI-Ausgaben im europäischen Gebiet genutzt werden

- Importeure und Händler von KI-Systemen auf dem europäischen Markt

- Bevollmächtigte Vertreter von Anbietern, die nicht in der EU ansässig sind

Zusammengefasst: Wenn Ihre KI in irgendeiner Weise Europa berührt, müssen Sie die Vorschriften einhalten.

Welche wichtigen Termine des EU AI Act dürfen Sie nicht ignorieren?

Der Implementierungszeitplan des EU AI Act ist komplex, aber entscheidend. Hier ist der vollständige Zeitplan mit den Auswirkungen jeder Frist auf Ihr Geschäft:

Bereits abgelaufene Termine (verpflichtende Einhaltung)

1. August 2024 – Inkrafttreten Die Verordnung wurde Gesetz. Der Übergangszeitraum beginnt.

2. Februar 2025 – Erste Welle von Verpflichtungen

- ✅ Verbot von KI-Systemen mit inakzeptablem Risiko (soziale Bewertung, subliminale Manipulation, Ausnutzung von Schwachstellen, massenhafte biometrische Überwachung in öffentlichen Räumen)

- ✅ Verpflichtung zur KI-Kompetenz (Art. 4): Unternehmen müssen sicherstellen, dass ihr Personal über ausreichende Kompetenzen verfügt, um KI-Systeme zu betreiben und zu überwachen

- ✅ Meldung an Behörden von verbotenen KI-Systemen, die in Gebrauch waren

2. August 2025 – Allgemeine Modelle (GPAI)

- Transparenzpflichten für Anbieter von Grundmodellen

- Obligatorische technische Dokumentation

- Einhaltung von Urheberrechtsnormen

- Zusätzliche Anforderungen für Modelle mit "systemischem Risiko" (solche, die mit mehr als 10²⁵ FLOPs trainiert wurden)

Bevorstehende Termine (dringende Vorbereitung)

2. August 2026 – Allgemeine Anwendung Dies ist das wichtigste Datum für die meisten Unternehmen:

- 🔴 Hochrisiko-KI-Systeme: Vollständige Konformitätsverpflichtungen

- 🔴 Transparenzpflichten des Artikels 50: Offenlegung von Interaktionen mit KI, Kennzeichnung synthetischer Inhalte, Identifizierung von Deepfakes

- 🔴 Obligatorische Registrierung in der EU-Datenbank für Hochrisikosysteme

- 🔴 Volle Aktivierung des Sanktionsregimes

Endtermin

2. August 2027 – Vollständige Anwendung

- Hochrisiko-KI-Systeme, die in Produkte integriert sind, die bereits durch sektorale Gesetzgebung reguliert sind (medizinische Geräte, Maschinen, Spielzeug usw.)

- Abschluss aller Übergangszeiträume

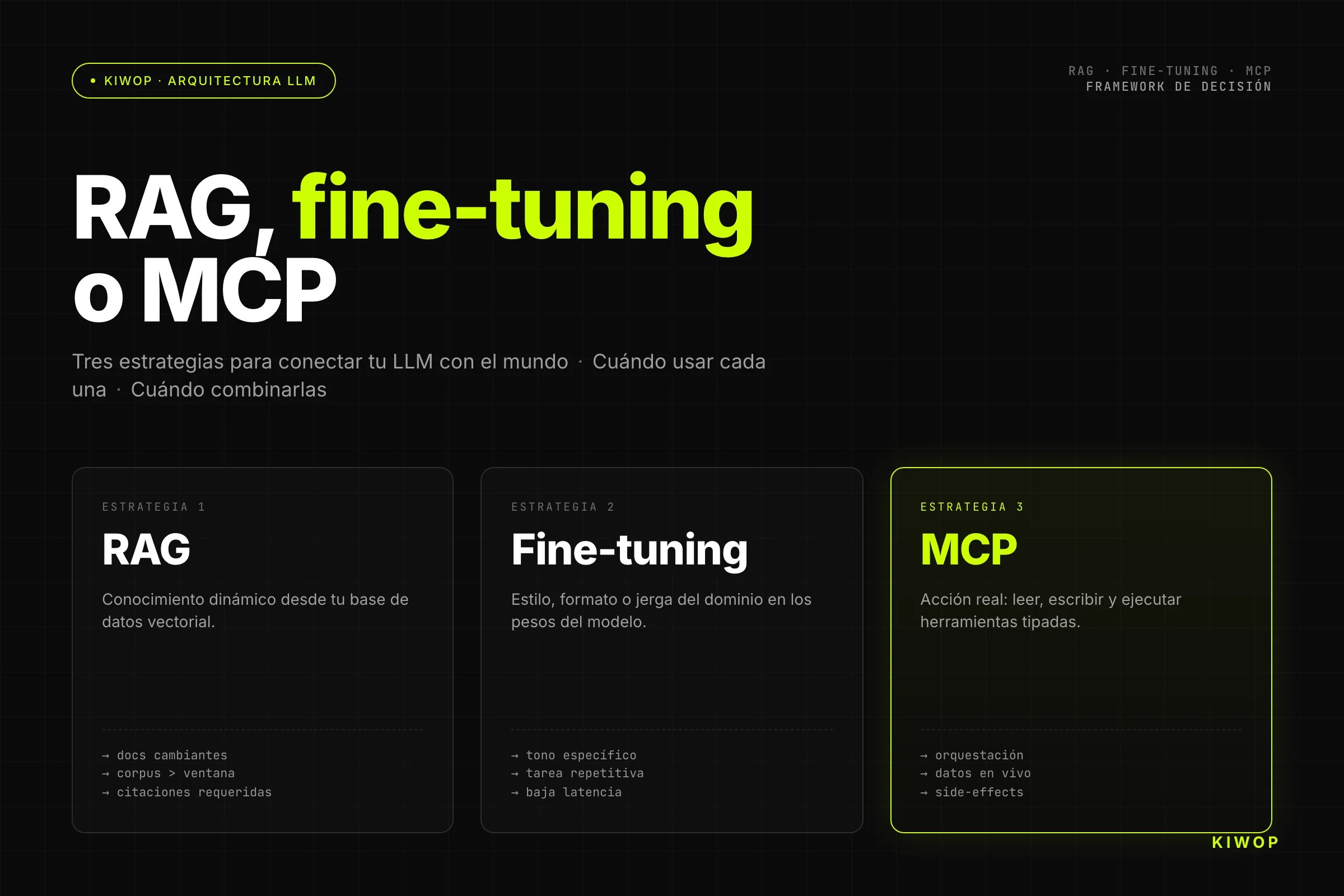

Wie klassifiziert der EU AI Act KI-Systeme nach ihrem Risiko?

Der Ansatz des EU AI Act basiert auf einer Risikopyramide mit vier Ebenen. Jede Ebene bringt unterschiedliche Verpflichtungen mit sich, von einem vollständigen Verbot bis hin zum Fehlen spezifischer Anforderungen.

Ebene 1: Inakzeptables Risiko (VERBOTEN)

Diese Systeme sind seit Februar 2025 vollständig verboten:

Kognitive Manipulation

- Systeme, die subliminale oder manipulative Techniken verwenden, um das Verhalten von Personen zu verzerren

- KI, die Schwachstellen spezifischer Gruppen ausnutzt (Alter, Behinderung, wirtschaftliche Lage)

Soziale Bewertung

- Systeme zur sozialen Bewertung durch öffentliche Behörden

- Klassifizierung von Bürgern basierend auf sozialem Verhalten oder persönlichen Merkmalen mit schädlichen Konsequenzen

Massenhafte biometrische Überwachung

- Biometrische Fernidentifikation in Echtzeit in öffentlichen Räumen (mit sehr begrenzten Ausnahmen für die Sicherheit)

- Biometrische Kategorisierungssysteme, die sensible Daten ableiten (Rasse, sexuelle Orientierung, politische Zugehörigkeit, religiöse Überzeugungen)

Weitere Verbote

- Unselektives Scraping von Gesichtsbildern aus dem Internet oder CCTV für Gesichtserkennungsdatenbanken

- Emotionserkennung am Arbeitsplatz oder in Bildungseinrichtungen (außer aus medizinischen oder Sicherheitsgründen)

- Prädiktive KI für kriminelles Verhalten, basierend ausschließlich auf Profilen oder Persönlichkeitsmerkmalen

Ebene 2: Hohes Risiko (STRIKTE REGULIERUNG)

Hochrisikosysteme unterliegen umfassenden Verpflichtungen. Sie werden in zwei Kategorien unterteilt:

KI-Systeme als Sicherheitskomponenten in regulierten Produkten:

- Medizinische Geräte

- Fahrzeuge und Maschinen

- Spielzeug

- Persönliche Schutzausrüstung

- Aufzüge und Druckgeräte

- Luftfahrt und Eisenbahn

Unabhängige KI-Systeme in kritischen Sektoren (Anhang III):

Ebene 3: Begrenztes Risiko (TRANSPARENZ)

Systeme mit spezifischen Transparenzverpflichtungen:

- Chatbots und virtuelle Assistenten: Müssen klar informieren, dass der Nutzer mit einer KI interagiert

- Generierung synthetischer Inhalte: Von KI generierte Texte, Bilder, Audio und Videos müssen als solche gekennzeichnet werden

- Deepfakes: Verpflichtung zur Offenlegung, dass der Inhalt künstlich erzeugt oder manipuliert wurde

- Emotionserkennungssysteme: Personen informieren, wenn sie analysiert werden

Ebene 4: Minimales oder kein Risiko

Die meisten KI-Systeme fallen in diese Kategorie und haben keine spezifischen Verpflichtungen unter dem EU AI Act:

- Spam-Filter

- Videospiele mit KI

- Empfehlungssysteme für Inhalte

- Persönliche Produktivitätstools

Dennoch werden Entwickler ermutigt, freiwillige Verhaltenskodizes und Prinzipien verantwortungsvoller KI zu übernehmen.

Welche Verpflichtungen hat Ihr Unternehmen je nach Rolle in der Wertschöpfungskette?

Der EU AI Act definiert verschiedene Akteure mit spezifischen Verantwortlichkeiten. Identifizieren Sie Ihre Rolle, um Ihre genauen Verpflichtungen zu kennen.

Wenn Sie ANBIETER von Hochrisiko-KI-Systemen sind

Anbieter sind diejenigen, die KI-Systeme entwickeln oder entwickeln lassen und sie unter ihrem Namen oder ihrer Marke vermarkten. Ihre Verpflichtungen umfassen:

Vor der Vermarktung:

- Risikomanagementsystem (Art. 9): Iterativer Prozess während des gesamten Lebenszyklus zur Identifizierung, Analyse, Bewertung und Minderung von Risiken

- Daten-Governance (Art. 10): Sicherstellung der Qualität, Repräsentativität und Abwesenheit von Verzerrungen in den Trainingsdatensätzen

- Technische Dokumentation (Art. 11): Vollständige Beschreibung des Systems, seines Zwecks, seiner Funktionsweise, Fähigkeiten und Einschränkungen

- Ereignisprotokollierung (Art. 12): Fähigkeit zur automatischen Rückverfolgbarkeit während des Betriebs

- Transparenz (Art. 13): Klare Gebrauchsanweisungen für Nutzer

- Menschliche Überwachung (Art. 14): Design, das eine effektive Überwachung durch Menschen ermöglicht

- Genauigkeit, Robustheit und Cybersicherheit (Art. 15): Angemessene Niveaus während des gesamten Lebenszyklus

Konformitätsverfahren:

- Konformitätsbewertung (intern oder durch Dritte je nach Systemtyp)

- CE-Kennzeichnung vor der Vermarktung

- EU-Konformitätserklärung

- Registrierung in der EU-Datenbank

Verpflichtungen nach der Vermarktung:

- Kontinuierliche Marktüberwachung

- Meldung schwerwiegender Vorfälle innerhalb von 15 Tagen

- Rücknahme oder Rückruf bei festgestellten Nichtkonformitäten

- Zusammenarbeit mit Überwachungsbehörden

Wenn Sie NUTZER (geschäftlicher Anwender) von Hochrisiko-KI-Systemen sind

Nutzer sind Unternehmen, die Hochrisiko-KI-Systeme unter ihrer Autorität verwenden. Auch wenn der Anbieter konform ist, haben Sie ebenfalls Verpflichtungen:

Hauptverpflichtungen:

- Gebrauch gemäß Anweisungen: Nutzung des Systems gemäß den Anweisungen des Anbieters

- Menschliche Überwachung: Zuweisung von kompetenten Personen zur Überwachung des Systems

- Eingabedaten: Sicherstellen, dass die eingegebenen Daten relevant und ausreichend repräsentativ sind

- Überwachung: Überwachung des Betriebs und Meldung von Risiken oder Vorfällen an den Anbieter

- Aufbewahrung von Aufzeichnungen: Protokolle mindestens 6 Monate lang aufbewahren

- Information der Arbeitnehmer: Mitarbeiter und ihre Vertreter vor der Nutzung von Systemen informieren, die sie betreffen

- Auswirkungsbewertung: Für öffentliche Stellen und private Einrichtungen in wesentlichen öffentlichen Diensten

Spezifische Transparenzverpflichtungen:

- Information von Personen, die Emotionserkennungs- oder biometrischen Kategorisierungssystemen unterzogen werden

- Bei Entscheidungen, die Rechte betreffen (Kredit, Versicherungen, Beschäftigung): Information über den Einsatz von KI und bedeutungsvolle Erklärungen

Wenn Sie IMPORTEUR oder HÄNDLER sind

Importeure (führen Produkte aus Drittländern in den EU-Markt ein):

- Überprüfung, dass der Anbieter die Konformitätsbewertung durchgeführt hat

- Sicherstellung der CE-Kennzeichnung und Dokumentation

- Keine Einführung von Produkten, die nicht konform sind

Händler (stellen bereits auf dem Markt befindliche KI-Systeme zur Verfügung):

- Überprüfung der CE-Kennzeichnung und Begleitdokumentation

- Keine Bereitstellung von nicht konformen Produkten

- Angemessene Lagerung und Transport

Querschnittsverpflichtungen: KI-Kompetenz

Alle Unternehmen, unabhängig von ihrer Rolle, müssen seit Februar 2025 den Artikel 4 zur KI-Kompetenz einhalten:

"Die Anbieter und Nutzer von KI-Systemen ergreifen Maßnahmen, um sicherzustellen, dass ihr Personal und andere Personen, die sich mit dem Betrieb und der Nutzung von KI-Systemen in ihrem Namen befassen, ein ausreichendes Maß an KI-Kompetenz haben."

Dies bedeutet:

- Schulung, angepasst an technisches Wissen, Erfahrung und Nutzungskontext

- Kontinuierliche Aktualisierung entsprechend der technologischen Entwicklung

- Dokumentation der durchgeführten Schulungsmaßnahmen

Wie sieht das Sanktionsregime und die Bußgelder des EU AI Act aus?

Der EU AI Act legt ein strenges und abschreckendes Sanktionsregime fest, mit Bußgeldern, die sogar die der DSGVO in proportionaler Hinsicht übersteigen.

Struktur der Sanktionen nach Art des Verstoßes

Sehr schwere Verstöße (verbotene Systeme):

- Bis zu 35 Millionen Euro

- Oder bis zu 7 % des weltweiten Jahresumsatzes des Vorjahres

- Es wird der höhere Betrag angewendet

Schwere Verstöße (Nichteinhaltung von Hochrisikoverpflichtungen):

- Bis zu 15 Millionen Euro

- Oder bis zu 3 % des weltweiten Jahresumsatzes

- Es wird der höhere Betrag angewendet

Leichte Verstöße (falsche Informationen an Behörden):

- Bis zu 7,5 Millionen Euro

- Oder bis zu 1,5 % des weltweiten Jahresumsatzes

- Es wird der höhere Betrag angewendet

Reduzierte Sanktionen für KMU und Startups

Der EU AI Act erkennt die Notwendigkeit an, Innovation zu schützen, und legt proportionale Grenzen für kleine Unternehmen fest:

- Die Bußgelder werden durch niedrigere Prozentsätze oder feste geringere Beträge berechnet

- Es werden die Ressourcen und wirtschaftliche Tragfähigkeit berücksichtigt

- Es gibt einen stärker auf Korrektur als auf Sanktion ausgerichteten Ansatz für erste geringfügige Verstöße

Zeitplan für die Anwendung des Sanktionsregimes

Verschärfende und mildernde Faktoren

Die Behörden werden berücksichtigen:

Verschärfende Faktoren:

- Wiederholungstäter

- Vorsätzlicher Verstoß

- Fehlende Zusammenarbeit mit Behörden

- Dauer des Verstoßes

- Verursachte Schäden an betroffenen Personen

Mildernde Faktoren:

- Erste Verstöße

- Sofortige Ergreifung von Korrekturmaßnahmen

- Aktive Zusammenarbeit mit Behörden

- Umsetzung von Verhaltenskodizes

- Kleine Unternehmensgröße

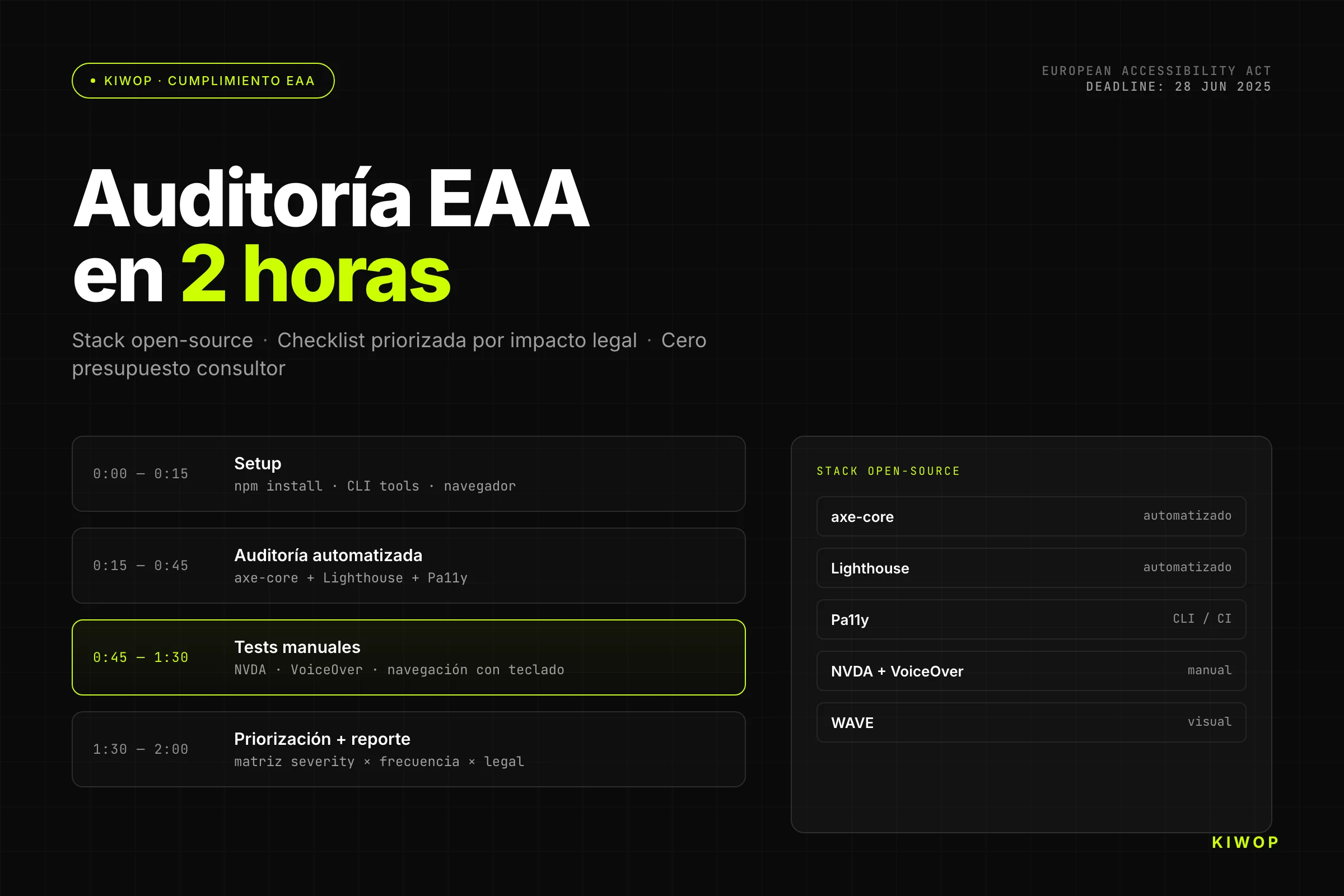

Wie bereiten Sie Ihr Unternehmen auf die Einhaltung des EU AI Act vor? Vollständige Checkliste

Diese Checkliste führt Sie Schritt für Schritt zur Compliance. Priorisieren Sie nach Ihren dringendsten Fristen.

Phase 1: Diagnose (Dringend abschließen)

- Inventar der KI-Systeme: Dokumentieren Sie ALLE KI-Systeme, die Sie nutzen, entwickeln oder vermarkten

- Risikoklassifizierung: Weisen Sie jedem System eine Kategorie zu (verboten, hoch, begrenzt, minimal)

- Rollenmapping: Identifizieren Sie, ob Sie als Anbieter, Nutzer, Importeur oder Händler für jedes System agieren

- Lückenanalyse: Vergleichen Sie Ihre aktuelle Situation mit den anwendbaren Verpflichtungen

- Identifikation verbotener Systeme: Überprüfen Sie, dass Sie keine KI mit inakzeptablem Risiko nutzen

Phase 2: Governance (Q1 2026)

- Benennung eines KI-Verantwortlichen: Ernennen Sie einen AI Officer oder weisen Sie klare Verantwortlichkeiten zu

- Einrichtung eines KI-Komitees: Multidisziplinäre Gruppe (Recht, Technik, Geschäft, HR)

- Definition einer KI-Politik: Prinzipien, Verfahren und interne Kontrollen

- Integration in bestehende Compliance: Koordination mit DPO, Compliance Officer, Sicherheit

- Compliance-Budget: Ressourcen für die Implementierung zuweisen

Phase 3: Kompetenz (Bereits obligatorisch)

- Bewertung der aktuellen Kompetenzen: Kenntnisstand des Personals in Bezug auf KI

- Schulungsplan: Programme, angepasst an Rolle und Interaktionsniveau mit KI

- Schulung der Führungskräfte: Spezifische Sensibilisierung für Entscheidungsfindung

- Technische Schulung: Für Entwickler und Integratoren

- Dokumentation der Schulungen: Teilnahme- und Inhaltsnachweise

Phase 4: Hochrisikosysteme (Vor August 2026)

Für Anbieter:

- Risikomanagementsystem: Implementieren Sie einen dokumentierten Prozess

- Audit der Trainingsdaten: Überprüfen Sie Qualität, Repräsentativität, Abwesenheit von Verzerrungen

- Vollständige technische Dokumentation: Gemäß den Anforderungen des Anhangs IV

- Implementierung der Protokollierung: Fähigkeit zur automatischen Ereignisaufzeichnung

- Design der menschlichen Überwachung: Mechanismen zur Intervention und Überschreibung

- Robustheitstests: Überprüfen Sie Genauigkeit und Widerstandsfähigkeit gegen Angriffe

- Konformitätsbewertung: Vorbereitung auf die Zertifizierung

- Registrierung in der EU-Datenbank: Vor der Vermarktung abschließen

Für Nutzer:

- Überprüfung der Anbieteranweisungen: Sicherstellen der konformen Nutzung

- Zuweisung menschlicher Überwacher: Kompetentes Personal mit realer Autorität

- Überwachungsprozess: System zur Erkennung von Anomalien

- Meldeprotokoll: Verfahren zur Meldung von Vorfällen

- Auswirkungsbewertung auf Grundrechte: Wenn zutreffend

- Kommunikation an Mitarbeiter: Vorabinformation über den Einsatz von KI in HR

Phase 5: Transparenz (Vor August 2026)

- Hinweise zur Interaktion mit KI: Implementierung in Chatbots und Assistenten

- Kennzeichnung synthetischer Inhalte: Sichtbare Markierungen in von KI generierten Inhalten

- Deepfake-Politik: Verfahren für synthetische audiovisuelle Inhalte

- Information der Betroffenen: Kommunikation, wenn KI Entscheidungen über Personen beeinflusst

Phase 6: Dokumentation und Aufzeichnungen

- Dokumentierte Richtlinien: Alle KI-Politiken schriftlich festhalten

- Aufzeichnungen von Risikobewertungen: Gemäß gesetzlichen Fristen aufbewahren

- Protokolle von Hochrisikosystemen: Mindestens 6 Monate, vorzugsweise länger

- Nachweise der Konformität: Erklärungen, Zertifikate, Audits

- Aufzeichnungen von Vorfällen: System zur Verwaltung von KI-Vorfällen

Phase 7: Vorbereitung auf Audits

- Inspektion simulieren: Internes Vorbereitungstraining

- Benennung eines Ansprechpartners: Kontaktperson für Behörden

- Zugang zur Dokumentation: Organisiertes und zugängliches System

- Reaktionsplan: Verfahren bei Anforderungen der Behörde

Welche Sektoren sind am stärksten vom EU AI Act betroffen?

Obwohl der EU AI Act alle Unternehmen betrifft, die KI nutzen, stehen einige Sektoren vor besonders anspruchsvollen Verpflichtungen:

Finanz- und Versicherungssektor

- Kreditwürdigkeitsprüfung als Hochrisiko eingestuft

- Solvenzbewertung für Kredite

- Preisgestaltung von Lebens- und Krankenversicherungen basierend auf KI

- Betrugserkennung mit Auswirkungen auf Kunden

Empfohlene Aktion: Audit aller automatisierten Entscheidungsmodelle, Dokumentation der Scoring-Kriterien, Implementierung von Erklärbarkeit.

Personalwesen und Personalauswahl

- Automatische CV-Filterung = hohes Risiko

- Bewertungssysteme für Kandidaten

- Überwachung der Mitarbeiterleistung

- Talentmanagement-Tools mit KI

Empfohlene Aktion: Überprüfung aller HR-Software mit KI-Komponenten, Information der Kandidaten und Mitarbeiter, Sicherstellung menschlicher Überwachung bei Einstellungsentscheidungen.

Gesundheitssektor

- Medizinische Geräte mit KI (doppelte Regulierung)

- Unterstützte Diagnosesysteme

- Automatisiertes Triage

- Analyse medizinischer Bilder

Empfohlene Aktion: Sicherstellung der Konformität mit der Regulierung von Medizinprodukten und dem EU AI Act gleichzeitig.

Bildung

- Automatisierte Zulassungssysteme

- Automatische Bewertung von Studenten

- Plagiatserkennung mit KI

- Proctoring bei Online-Prüfungen

Empfohlene Aktion: Überprüfung von Bildungssoftware, Information der Studenten und Familien, Aufrechterhaltung der Lehraufsicht.

Öffentliche Verwaltung

- Bewertung von Leistungsanträgen

- Priorisierungssysteme für Dienste

- KI in Sicherheitskräften

- Grenz- und Asylmanagement

Empfohlene Aktion: Obligatorische Bewertungen der Auswirkungen auf Grundrechte, maximale Transparenz gegenüber Bürgern.

Benötigt Ihr Unternehmen spezialisierte Beratung zum EU AI Act?

Die Komplexität des EU AI Act, mit seinen zahlreichen Fristen, Risikokategorien und differenzierten Verpflichtungen, macht spezialisierte Beratung für die meisten Unternehmen zu einer Notwendigkeit, nicht zu einem Luxus.

Anzeichen dafür, dass Sie professionelle Hilfe benötigen

✅ Sie nutzen KI in Prozessen, die Menschen betreffen (HR, Kredit, Dienstleistungen) ✅ Sie entwickeln oder vermarkten Produkte mit KI-Komponenten ✅ Sie sind sich nicht sicher, in welche Risikokategorie Ihre Systeme fallen ✅ Sie operieren in besonders regulierten Sektoren ✅ Sie haben keine Erfahrung in der technologischen Compliance

Wie Kiwop Ihnen helfen kann

Bei Kiwop begleiten wir seit Jahren Unternehmen bei ihrer digitalen Transformation und verantwortungsvollen Einführung von künstlicher Intelligenz. Unsere Beratungsdienste in der KI umfassen:

- Compliance-Diagnose EU AI Act: Vollständiges Audit Ihrer KI-Systeme

- Risikoklassifizierung: Expertenanalyse zur Bestimmung Ihrer genauen Verpflichtungen

- Implementierungs-Roadmap: Personalisierter Plan mit Meilensteinen und Ressourcen

- Technische Dokumentation: Vorbereitung der von der Verordnung geforderten Dokumentation

- Schulung in KI-Kompetenz: Programme, angepasst zur Erfüllung des Art. 4

- Kontinuierliche Begleitung: Unterstützung während des gesamten Anpassungsprozesses

Jetzt ist der Zeitpunkt zu handeln. Mit August 2026 vor der Tür haben Unternehmen, die heute mit der Anpassung beginnen, einen Wettbewerbsvorteil gegenüber denen, die bis zum letzten Moment warten.

Kontaktieren Sie unser Team für eine unverbindliche Erstbewertung Ihrer Situation im Hinblick auf den EU AI Act.

Fazit: Der EU AI Act als Chance, nicht nur als Verpflichtung

Der EU AI Act stellt den weltweit ambitioniertesten regulatorischen Rahmen für künstliche Intelligenz dar. Obwohl er erhebliche Verpflichtungen mit sich bringt, bietet er auch Chancen:

- Wettbewerbsdifferenzierung: Unternehmen, die ihre Konformität zertifizieren, schaffen zusätzliches Vertrauen

- Zugang zum europäischen Markt: Einhaltung ermöglicht den Betrieb ohne Einschränkungen in einem Markt mit 450 Millionen Verbrauchern

- Prozessverbesserung: Die Verpflichtungen zur Dokumentation und Risikomanagement verbessern die Qualität der Systeme

- Antizipation globaler Regulierung: Andere Märkte werden dem europäischen Modell folgen

Die entscheidenden Termine sind unveränderlich: Februar 2025 ist bereits vergangen, August 2025 steht bevor, und August 2026 wird schneller kommen, als es scheint. Die Vorbereitung beginnt heute.

Häufig gestellte Fragen zum EU AI Act

Betrifft der EU AI Act auch Unternehmen außerhalb der EU?

Ja, der EU AI Act hat extraterritoriale Anwendung. Er betrifft jedes Unternehmen, das KI-Systeme in der EU vermarktet oder deren KI-Ausgaben im europäischen Gebiet genutzt werden, unabhängig davon, wo das Unternehmen ansässig ist.

Wann tritt der EU AI Act vollständig in Kraft?

Der EU AI Act trat am 1. August 2024 in Kraft, aber seine Anwendung ist gestaffelt. Die Verbote gelten seit Februar 2025, die Verpflichtungen für GPAI seit August 2025, und die vollständige Regulierung für Hochrisikosysteme ab August 2026. Die vollständige Anwendung, einschließlich regulierter Produkte, erfolgt im August 2027.

Was passiert, wenn mein Unternehmen ChatGPT oder andere generative KI-Modelle verwendet?

Wenn Sie allgemeine KI-Modelle (GPAI) wie ChatGPT verwenden, liegen die Hauptverpflichtungen beim Anbieter des Modells (OpenAI). Als Nutzer haben Sie jedoch Verpflichtungen zur Transparenz (Information, dass Nutzer mit KI interagieren) und zur verantwortungsvollen Nutzung. Wenn Sie diese Modelle für Entscheidungen mit hohem Risiko (HR, Kredit) verwenden, fallen Sie in die Kategorie des hohen Risikos.

Wie hoch sind die Bußgelder bei Nichteinhaltung des EU AI Act?

Die Bußgelder können 35 Millionen Euro oder 7 % des weltweiten Umsatzes für sehr schwere Verstöße (Nutzung verbotener Systeme) erreichen. Bei Nichteinhaltung von Hochrisikoverpflichtungen bis zu 15 Millionen oder 3 %. Für KMU und Startups gelten reduzierte proportionale Grenzen.

Was ist "KI-Kompetenz" und warum ist sie obligatorisch?

Artikel 4 des EU AI Act verpflichtet alle Unternehmen, die KI nutzen, sicherzustellen, dass ihr Personal ausreichende Kompetenzen hat, um diese Systeme zu betreiben und zu überwachen. Dies umfasst angepasste Schulung, kontinuierliche Aktualisierung und Dokumentation der Schulungsmaßnahmen. Diese Verpflichtung ist seit Februar 2025 in Kraft.

Wie weiß ich, ob meine KI-Systeme "hohes Risiko" sind?

Ein System ist von hohem Risiko, wenn: (1) es eine Sicherheitskomponente in bereits regulierten Produkten ist (medizinische Geräte, Maschinen usw.), oder (2) es im Anhang III der Verordnung enthalten ist, der Sektoren wie Biometrie, kritische Infrastrukturen, Bildung, Beschäftigung, essentielle Dienste, Rechtsdurchsetzung, Migration und Justiz auflistet.

Kann ich weiterhin KI zur Filterung von Lebensläufen in Auswahlprozessen verwenden?

Ja, aber mit strengen Verpflichtungen. Die KI-Systeme zur Personalauswahl sind als hohes Risiko eingestuft. Sie müssen konforme Systeme mit dem EU AI Act verwenden, eine effektive menschliche Überwachung gewährleisten, Kandidaten über den Einsatz von KI informieren und die Fähigkeit zur Erklärung der getroffenen Entscheidungen aufrechterhalten.

Was ist der Unterschied zwischen "Anbieter" und "Nutzer" im EU AI Act?

Der Anbieter ist derjenige, der das KI-System entwickelt oder entwickeln lässt und es unter seinem Namen vermarktet. Der Nutzer ist derjenige, der ein KI-System unter seiner beruflichen Autorität verwendet (geschäftlicher Anwender). Beide haben Verpflichtungen, aber die des Anbieters sind umfangreicher (Design, Dokumentation, Konformität). Der Nutzer muss das System korrekt verwenden, überwachen und Probleme melden.

Artikel aktualisiert im Januar 2026. Die Regulierung von KI entwickelt sich ständig weiter. Konsultieren Sie immer offizielle Quellen und professionelle Beratung für spezifische Entscheidungen Ihres Unternehmens.

{

"@context": "https://schema.org",

"@type": "FAQPage",

"mainEntity": [

{

"@type": "Question",

"name": "Betrifft der EU AI Act auch Unternehmen außerhalb der EU?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Ja, der EU AI Act hat extraterritoriale Anwendung. Er betrifft jedes Unternehmen, das KI-Systeme in der EU vermarktet oder deren KI-Ausgaben im europäischen Gebiet genutzt werden, unabhängig davon, wo das Unternehmen ansässig ist."

}

},

{

"@type": "Question",

"name": "Wann tritt der EU AI Act vollständig in Kraft?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Der EU AI Act trat am 1. August 2024 in Kraft, aber seine Anwendung ist gestaffelt. Die Verbote gelten seit Februar 2025, die Verpflichtungen für GPAI seit August 2025, und die vollständige Regulierung für Hochrisikosysteme ab August 2026. Die vollständige Anwendung, einschließlich regulierter Produkte, erfolgt im August 2027."

}

},

{

"@type": "Question",

"name": "Was passiert, wenn mein Unternehmen ChatGPT oder andere generative KI-Modelle verwendet?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Wenn Sie allgemeine KI-Modelle (GPAI) wie ChatGPT verwenden, liegen die Hauptverpflichtungen beim Anbieter des Modells. Als Nutzer haben Sie jedoch Verpflichtungen zur Transparenz und zur verantwortungsvollen Nutzung. Wenn Sie diese Modelle für Entscheidungen mit hohem Risiko (HR, Kredit) verwenden, fallen Sie in die Kategorie des hohen Risikos."

}

},

{

"@type": "Question",

"name": "Wie hoch sind die Bußgelder bei Nichteinhaltung des EU AI Act?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Die Bußgelder können 35 Millionen Euro oder 7 % des weltweiten Umsatzes für sehr schwere Verstöße (Nutzung verbotener Systeme) erreichen. Bei Nichteinhaltung von Hochrisikoverpflichtungen bis zu 15 Millionen oder 3 %. Für KMU und Startups gelten reduzierte proportionale Grenzen."

}

},

{

"@type": "Question",

"name": "Was ist KI-Kompetenz und warum ist sie obligatorisch?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Artikel 4 des EU AI Act verpflichtet alle Unternehmen, die KI nutzen, sicherzustellen, dass ihr Personal ausreichende Kompetenzen hat, um diese Systeme zu betreiben und zu überwachen. Dies umfasst angepasste Schulung, kontinuierliche Aktualisierung und Dokumentation der Schulungsmaßnahmen. Diese Verpflichtung ist seit Februar 2025 in Kraft."

}

},

{

"@type": "Question",

"name": "Wie weiß ich, ob meine KI-Systeme hohes Risiko sind?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Ein System ist von hohem Risiko, wenn: (1) es eine Sicherheitskomponente in bereits regulierten Produkten ist (medizinische Geräte, Maschinen usw.), oder (2) es im Anhang III der Verordnung enthalten ist, der Sektoren wie Biometrie, kritische Infrastrukturen, Bildung, Beschäftigung, essentielle Dienste, Rechtsdurchsetzung, Migration und Justiz auflistet."

}

},

{

"@type": "Question",

"name": "Kann ich weiterhin KI zur Filterung von Lebensläufen in Auswahlprozessen verwenden?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Ja, aber mit strengen Verpflichtungen. Die KI-Systeme zur Personalauswahl sind als hohes Risiko eingestuft. Sie müssen konforme Systeme mit dem EU AI Act verwenden, eine effektive menschliche Überwachung gewährleisten, Kandidaten über den Einsatz von KI informieren und die Fähigkeit zur Erklärung der getroffenen Entscheidungen aufrechterhalten."

}

},

{

"@type": "Question",

"name": "Was ist der Unterschied zwischen Anbieter und Nutzer im EU AI Act?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Der Anbieter ist derjenige, der das KI-System entwickelt oder entwickeln lässt und es unter seinem Namen vermarktet. Der Nutzer ist derjenige, der ein KI-System unter seiner beruflichen Autorität verwendet (geschäftlicher Anwender). Beide haben Verpflichtungen, aber die des Anbieters sind umfangreicher (Design, Dokumentation, Konformität). Der Nutzer muss das System korrekt verwenden, überwachen und Probleme melden."

}

}

]

}