EU AI Act 2026: wat uw bedrijf moet weten om aan de regelgeving te voldoen

De Europese Verordening voor Kunstmatige Intelligentie is nu van kracht. Sinds februari 2025 zijn de eerste verplichtingen van toepassing, en in augustus 2026 wordt de volledige toepassing voor hoog-risico systemen van kracht. Als uw bedrijf AI-systemen ontwikkelt, implementeert of gebruikt, is dit artikel uw essentiële routekaart om boetes tot 35 miljoen euro of 7% van uw wereldwijde omzet te vermijden.

We hebben het niet over toekomstige regelgeving: de EU AI Act is geldende wetgeving. Bedrijven die nu niet handelen, riskeren zware boetes en, erger nog, een verbod op het opereren van hun AI-systemen op de Europese markt.

In deze uitgebreide gids splitsen we alles op wat u moet weten: van de kritieke data tot de specifieke verplichtingen afhankelijk van uw rol en sector, inclusief een praktische compliance-checklist die u vandaag nog kunt implementeren.

Wat is de EU AI Act en waarom zou het u in 2026 moeten interesseren?

De Verordening (EU) 2024/1689, bekend als de EU AI Act of Wet op Kunstmatige Intelligentie, is het eerste uitgebreide regelgevingskader ter wereld voor kunstmatige intelligentie. Goedgekeurd op 13 juni 2024 en gepubliceerd in het Publicatieblad van de EU op 12 juli 2024, trad het in werking op 1 augustus 2024.

Maar hier komt het cruciale: de toepassing is gefaseerd, en de belangrijkste deadlines vinden nu plaats of komen eraan in de komende maanden.

Waarom 2026 het beslissende jaar is

De EU AI Act is niet zoals de GDPR, die een ruime overgangsperiode bood. De gefaseerde implementatie betekent dat:

- Februari 2025: Bepaalde AI-systemen die als "onaanvaardbaar risico" worden beschouwd, zijn al verboden

- Augustus 2025: De verplichtingen voor algemene AI-modellen (GPAI) zijn van toepassing

- Augustus 2026: De volledige regelgeving voor hoog-risico systemen wordt van kracht

- Augustus 2027: Volledige toepassing, inclusief systemen geïntegreerd in gereguleerde producten

Als uw bedrijf ChatGPT, voorspellende analysetools, gezichtsherkenningssystemen, klantenservice-chatbots of andere op AI gebaseerde technologieën gebruikt, valt u binnen het toepassingsgebied.

Territoriaal toepassingsgebied: wie wordt beïnvloed?

De EU AI Act heeft een extraterritoriale toepassing, vergelijkbaar met de GDPR:

- Leveranciers van AI-systemen die systemen op de EU-markt brengen of in gebruik nemen, ongeacht waar ze zijn gevestigd

- Gebruikers (zakelijke gebruikers) van AI-systemen gevestigd in de EU

- Leveranciers en gebruikers buiten de EU waarvan de AI-output binnen het Europese grondgebied wordt gebruikt

- Importeurs en distributeurs van AI-systemen op de Europese markt

- Gemachtigde vertegenwoordigers van leveranciers die niet in de EU zijn gevestigd

Kortom: als uw AI op enigerlei wijze Europa raakt, moet u voldoen.

Wat zijn de belangrijke data van de EU AI Act die u niet kunt negeren?

Het implementatieschema van de EU AI Act is complex maar cruciaal. Hier is de volledige tijdlijn met wat elke datum voor uw bedrijf betekent:

Verlopen data (verplichte naleving)

1 augustus 2024 – Inwerkingtreding De verordening werd wet. De overgangsperiode begint.

2 februari 2025 – Eerste golf van verplichtingen

- ✅ Verbod op AI-systemen met onaanvaardbaar risico (sociale scoring, subliminale manipulatie, uitbuiting van kwetsbaren, massale biometrische surveillance in openbare ruimtes)

- ✅ Verplichting tot AI-geletterdheid (Art. 4): Bedrijven moeten ervoor zorgen dat hun personeel voldoende competenties heeft om AI-systemen te bedienen en te monitoren

- ✅ Melding aan autoriteiten van verboden AI-systemen die in gebruik waren

2 augustus 2025 – Algemene AI-modellen (GPAI)

- Transparantieverplichtingen voor leveranciers van fundamentele modellen

- Verplichte technische documentatie

- Naleving van auteursrechtelijke normen

- Aanvullende vereisten voor modellen met "systemisch risico" (die getraind zijn met meer dan 10²⁵ FLOPs)

Aankomende data (dringende voorbereiding)

2 augustus 2026 – Algemene toepassing Dit is de belangrijkste datum voor de meeste bedrijven:

- 🔴 Hoog-risico AI-systemen: Volledige nalevingsverplichtingen

- 🔴 Transparantieverplichtingen van Artikel 50: openbaarmaking van interacties met AI, etikettering van synthetische inhoud, identificatie van deepfakes

- 🔴 Verplichte registratie in de EU-database voor hoog-risico systemen

- 🔴 Volledige activering van het sanctieregime

Einddatum

2 augustus 2027 – Volledige toepassing

- Hoog-risico AI-systemen geïntegreerd in producten die al gereguleerd zijn door sectorale wetgeving (medische apparaten, machines, speelgoed, etc.)

- Afsluiting van alle overgangsperioden

Hoe classificeert de EU AI Act AI-systemen op basis van hun risico?

De benadering van de EU AI Act is gebaseerd op een risicopiramide met vier niveaus. Elk niveau brengt verschillende verplichtingen met zich mee, variërend van een totaal verbod tot het ontbreken van specifieke vereisten.

Niveau 1: Onaanvaardbaar risico (VERBODEN)

Deze systemen zijn volledig verboden sinds februari 2025:

Cognitieve manipulatie

- Systemen die subliminale of manipulatieve technieken gebruiken om het gedrag van mensen te verstoren

- AI die kwetsbaarheden van specifieke groepen exploiteert (leeftijd, handicap, economische situatie)

Sociale scoring

- Systemen voor sociale scoring door overheidsinstanties

- Classificatie van burgers op basis van sociaal gedrag of persoonlijke kenmerken met nadelige gevolgen

Massale biometrische surveillance

- Biometrische identificatie op afstand in real-time in openbare ruimtes (met zeer beperkte uitzonderingen voor veiligheid)

- Systemen voor biometrische categorisering die gevoelige gegevens afleiden (ras, seksuele geaardheid, politieke affiliatie, religieuze overtuigingen)

Andere verboden

- Niet-selectief scrapen van gezichtsafbeeldingen van internet of CCTV voor gezichtsherkenningsdatabases

- Emotieherkenning op werkplekken of onderwijsinstellingen (behalve om medische of veiligheidsredenen)

- Voorspellende AI van crimineel gedrag uitsluitend gebaseerd op profielen of persoonlijkheidskenmerken

Niveau 2: Hoog risico (STRIKTE REGULERING)

Hoog-risico systemen zijn onderworpen aan uitgebreide verplichtingen. Ze zijn onderverdeeld in twee categorieën:

AI-systemen als veiligheidscomponenten in gereguleerde producten:

- Medische apparaten

- Voertuigen en machines

- Speelgoed

- Persoonlijke beschermingsmiddelen

- Liften en drukapparatuur

- Luchtvaart en spoorwegen

Onafhankelijke AI-systemen in kritieke sectoren (Bijlage III):

Niveau 3: Beperkt risico (TRANSPARANTIE)

Systemen met specifieke transparantieverplichtingen:

- Chatbots en virtuele assistenten: Moeten duidelijk maken dat de gebruiker met een AI communiceert

- Generatie van synthetische inhoud: Door AI gegenereerde teksten, afbeeldingen, audio en video moeten als zodanig worden gelabeld

- Deepfakes: Verplichting om te onthullen dat de inhoud kunstmatig is gegenereerd of gemanipuleerd

- Emotieherkenningssystemen: Mensen informeren wanneer ze worden geanalyseerd

Niveau 4: Minimaal of geen risico

De meeste AI-systemen vallen in deze categorie en hebben geen specifieke verplichtingen onder de EU AI Act:

- Spamfilters

- Videogames met AI

- Aanbevelingssystemen voor inhoud

- Persoonlijke productiviteitstools

Echter, ontwikkelaars worden aangemoedigd om vrijwillige gedragscodes en principes van verantwoorde AI aan te nemen.

Wat zijn de verplichtingen van uw bedrijf volgens zijn rol in de waardeketen?

De EU AI Act definieert verschillende actoren met specifieke verantwoordelijkheden. Identificeer uw rol om uw exacte verplichtingen te kennen.

Als u LEVERANCIER bent van hoog-risico AI-systemen

Leveranciers zijn degenen die AI-systemen ontwikkelen of laten ontwikkelen en deze onder hun naam of merk op de markt brengen. Uw verplichtingen omvatten:

Voor de commercialisering:

- Risicobeheersysteem (Art. 9): Iteratief proces gedurende de hele levenscyclus om risico's te identificeren, analyseren, evalueren en te beperken

- Datagovernance (Art. 10): Kwaliteit, representativiteit en afwezigheid van vooroordelen in trainingsdatasets waarborgen

- Technische documentatie (Art. 11): Volledige beschrijving van het systeem, zijn doel, werking, capaciteiten en beperkingen

- Evenementenregistratie (Art. 12): Automatische traceerbaarheid tijdens de werking

- Transparantie (Art. 13): Duidelijke gebruiksinstructies voor gebruikers

- Menselijke supervisie (Art. 14): Ontwerp dat effectieve supervisie door mensen mogelijk maakt

- Nauwkeurigheid, robuustheid en cyberbeveiliging (Art. 15): Passende niveaus gedurende de hele levenscyclus

Conformiteitsprocedures:

- Conformiteitsevaluatie (intern of door derden afhankelijk van het systeemtype)

- CE-markering voor commercialisering

- EU-conformiteitsverklaring

- Registratie in de EU-database

Verplichtingen na commercialisering:

- Continue marktbewaking

- Melding van ernstige incidenten binnen 15 dagen

- Terugtrekking of terugroeping bij niet-conformiteit

- Samenwerking met toezichthoudende autoriteiten

Als u GEBRUIKER bent (zakelijke gebruiker) van hoog-risico AI-systemen

Gebruikers zijn bedrijven die hoog-risico AI-systemen gebruiken onder hun autoriteit. Hoewel de leverancier voldoet, heeft u ook verplichtingen:

Hoofdverplichtingen:

- Gebruik volgens instructies: Het systeem gebruiken volgens de instructies van de leverancier

- Menselijke supervisie: Bevoegde personen toewijzen voor systeemtoezicht

- Invoergegevens: Zorgen dat ingevoerde gegevens relevant en voldoende representatief zijn

- Monitoring: De werking bewaken en de leverancier op de hoogte stellen van risico's of incidenten

- Bewaring van gegevens: Logs minimaal 6 maanden bewaren

- Informatie aan werknemers: Werknemers en hun vertegenwoordigers informeren voordat systemen worden gebruikt die hen beïnvloeden

- Impactevaluatie: Voor overheidsinstanties en particuliere entiteiten in essentiële openbare diensten

Specifieke transparantieverplichtingen:

- Personen informeren dat ze worden onderworpen aan emotieherkenning of biometrische categorisering

- Bij beslissingen die rechten beïnvloeden (krediet, verzekeringen, werk): informeren over het gebruik van AI en betekenisvolle uitleg geven

Als u IMPORTEUR of DISTRIBUTEUR bent

Importeurs (brengen producten uit derde landen op de EU-markt):

- Verifiëren dat de leverancier de conformiteitsevaluatie heeft uitgevoerd

- Zorgen voor CE-markering en documentatie

- Geen producten introduceren die niet voldoen

Distributeurs (stellen AI-systemen beschikbaar die al op de markt zijn):

- CE-markering en begeleidende documentatie verifiëren

- Geen niet-conforme producten beschikbaar stellen

- Geschikte opslag en transport

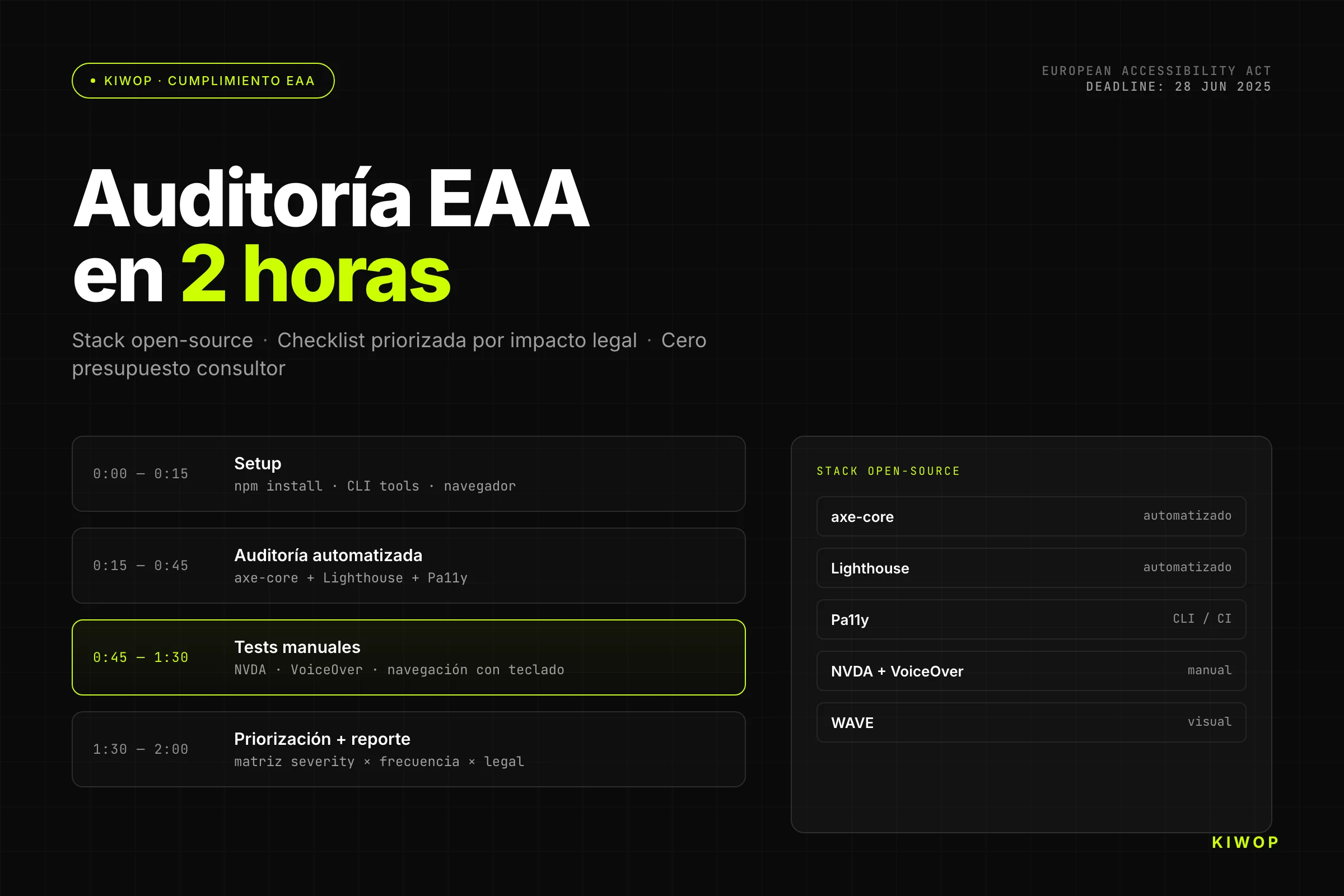

Transversale verplichtingen: AI-geletterdheid

Alle bedrijven, ongeacht hun rol, moeten voldoen aan Artikel 4 van AI-geletterdheid sinds februari 2025:

"Leveranciers en gebruikers van AI-systemen nemen maatregelen om ervoor te zorgen dat hun personeel en andere personen die zich bezighouden met de werking en het gebruik van AI-systemen namens hen een voldoende niveau van AI-geletterdheid hebben."

Dit impliceert:

- Opleiding aangepast aan technische kennis, ervaring en gebruikscontext

- Continue bijwerking naarmate de technologie evolueert

- Documentatie van de uitgevoerde opleidingsactiviteiten

Wat is het sanctieregime en de boetes van de EU AI Act?

De EU AI Act stelt een streng en afschrikwekkend sanctieregime vast, met boetes die zelfs de GDPR in proportionele termen overtreffen.

Structuur van sancties per type overtreding

Zeer ernstige overtredingen (verboden systemen):

- Tot 35 miljoen euro

- Of tot 7% van de wereldwijde jaaromzet van het voorgaande boekjaar

- Het hoogste bedrag is van toepassing

Ernstige overtredingen (niet-naleving van hoog-risico verplichtingen):

- Tot 15 miljoen euro

- Of tot 3% van de wereldwijde jaaromzet

- Het hoogste bedrag is van toepassing

Lichte overtredingen (onjuiste informatie aan autoriteiten):

- Tot 7,5 miljoen euro

- Of tot 1,5% van de wereldwijde jaaromzet

- Het hoogste bedrag is van toepassing

Verminderde sancties voor mkb en startups

De EU AI Act erkent de noodzaak om innovatie te beschermen en stelt proportionele limieten vast voor kleine bedrijven:

- Boetes worden berekend door lagere percentages of vaste lagere bedragen toe te passen

- Er wordt rekening gehouden met de middelen en economische haalbaarheid

- Er is een meer op correctie gerichte benadering voor eerste kleine overtredingen

Toepassingsschema van het sanctieregime

Verergerende en verzachtende factoren

De autoriteiten zullen overwegen:

Verergerende factoren:

- Recidive

- Opzettelijke niet-naleving

- Gebrek aan samenwerking met autoriteiten

- Duur van de overtreding

- Schade aan getroffen personen

Verzachtende factoren:

- Eerste overtredingen

- Onmiddellijke correctieve maatregelen

- Actieve samenwerking met autoriteiten

- Implementatie van gedragscodes

- Kleine omvang van het bedrijf

Hoe bereidt u uw bedrijf voor om te voldoen aan de EU AI Act? Volledige checklist

Deze checklist begeleidt u stap voor stap naar compliance. Prioriteer volgens uw meest dringende deadlines.

Fase 1: Diagnose (Dringend voltooien)

- Inventarisatie van AI-systemen: Documenteer ALLE AI-systemen die u gebruikt, ontwikkelt of commercialiseert

- Risicoclassificatie: Wijs elk systeem toe aan een categorie (verboden, hoog, beperkt, minimaal)

- Rolmapping: Identificeer of u optreedt als leverancier, gebruiker, importeur of distributeur voor elk systeem

- Gapanalyse: Vergelijk uw huidige situatie met de toepasselijke verplichtingen

- Identificatie van verboden systemen: Verifieer dat u geen AI met onaanvaardbaar risico gebruikt

Fase 2: Governance (Q1 2026)

- AI-verantwoordelijke aanwijzen: Benoem een AI Officer of wijs duidelijke verantwoordelijkheden toe

- AI-comité oprichten: Multidisciplinair team (juridisch, technisch, zakelijk, HR)

- AI-beleid definiëren: Principes, procedures en interne controles

- Integreren met bestaande compliance: Coördinatie met DPO, compliance officer, beveiliging

- Compliancebudget: Wijs middelen toe voor implementatie

Fase 3: Geletterdheid (Al verplicht)

- Huidige competenties evalueren: Kennisniveau van AI van het personeel

- Opleidingsplan: Programma's aangepast per rol en niveau van interactie met AI

- Opleiding voor leidinggevenden: Specifieke bewustwording voor besluitvorming

- Technische opleiding: Voor ontwikkelaars en integrators

- Opleidingen documenteren: Registraties van deelname en verstrekte inhoud

Fase 4: Hoog-risico systemen (Voor augustus 2026)

Voor leveranciers:

- Risicobeheersysteem: Gedocumenteerd proces implementeren

- Audit van trainingsdata: Kwaliteit, representativiteit, afwezigheid van vooroordelen verifiëren

- Volledige technische documentatie: Volgens de vereisten van Bijlage IV

- Logging implementeren: Automatische registratie van gebeurtenissen

- Menselijke supervisie ontwerpen: Mechanismen voor interventie en override

- Robuustheidstests: Nauwkeurigheid en weerstand tegen aanvallen verifiëren

- Conformiteitsevaluatie: Voorbereiden op certificering

- Registratie in EU-database: Voltooien voor commercialisering

Voor gebruikers:

- Instructies van leveranciers herzien: Zorgen voor conform gebruik

- Menselijke supervisors toewijzen: Bevoegd personeel met echte autoriteit

- Monitoringsproces: Systeem voor het detecteren van anomalieën

- Meldingsprotocol: Procedure voor het melden van incidenten

- Impactevaluatie op fundamentele rechten: Indien van toepassing

- Communicatie naar werknemers: Voorafgaande informatie over het gebruik van AI in HR

Fase 5: Transparantie (Voor augustus 2026)

- Meldingen van interactie met AI: Implementeren in chatbots en assistenten

- Etikettering van synthetische inhoud: Zichtbare markeringen op door AI gegenereerde inhoud

- Deepfake-beleid: Procedure voor synthetische audiovisuele inhoud

- Informatie aan betrokkenen: Communicatie wanneer AI beslissingen over personen beïnvloedt

Fase 6: Documentatie en registraties

- Gedocumenteerde beleidslijnen: Alle AI-beleidslijnen schriftelijk

- Registraties van risico-evaluaties: Bewaren volgens wettelijke termijnen

- Logs van hoog-risico systemen: Minimaal 6 maanden, bij voorkeur langer

- Bewijzen van conformiteit: Verklaringen, certificaten, audits

- Registraties van incidenten: Incidentbeheersysteem voor AI

Fase 7: Voorbereiding op audits

- Simuleer inspectie: Interne oefening ter voorbereiding

- Interlocutor aanwijzen: Contactpersoon voor autoriteiten

- Toegang tot documentatie: Georganiseerd en toegankelijk systeem

- Reactieplan: Procedure bij verzoeken van autoriteiten

Welke sectoren worden het meest beïnvloed door de EU AI Act?

Hoewel de EU AI Act van invloed is op alle bedrijven die AI gebruiken, hebben sommige sectoren bijzonder veeleisende verplichtingen:

Financiële sector en verzekeringen

- Kredietscoring geclassificeerd als hoog risico

- Kredietwaardigheidsbeoordeling voor leningen

- Verzekeringsprijsstelling voor levens- en gezondheidsverzekeringen op basis van AI

- Fraudedetectie met implicaties voor klanten

Aanbevolen actie: Audit alle modellen voor geautomatiseerde besluitvorming, documenteer scoringscriteria, implementeer uitlegbaarheid.

Human resources en personeelsselectie

- Automatisch filteren van cv's = hoog risico

- Systemen voor kandidatenbeoordeling

- Monitoring van werknemersprestaties

- Talentmanagementtools met AI

Aanbevolen actie: Herzie alle HR-software met AI-componenten, informeer kandidaten en werknemers, zorg voor menselijke supervisie bij wervingsbeslissingen.

Gezondheidszorg

- Medische apparaten met AI (dubbele regelgeving)

- Systemen voor ondersteunde diagnose

- Geautomatiseerde triage

- Analyse van medische beelden

Aanbevolen actie: Verifieer naleving van zowel de regelgeving voor medische producten als de EU AI Act.

Onderwijs

- Geautomatiseerde toelatingssystemen

- Automatische evaluatie van studenten

- Plagiaatdetectie met AI

- Proctoring bij online examens

Aanbevolen actie: Herzie educatieve software, informeer studenten en gezinnen, behoud docententoezicht.

Publieke administratie

- Beoordeling van uitkeringsaanvragen

- Systemen voor prioritering van diensten

- AI in veiligheidsdiensten

- Grensbeheer en asiel

Aanbevolen actie: Verplichte impactevaluaties op fundamentele rechten, maximale transparantie naar burgers.

Heeft uw bedrijf gespecialiseerd advies nodig over de EU AI Act?

De complexiteit van de EU AI Act, met zijn meerdere deadlines, risicocategorieën en gedifferentieerde verplichtingen, maakt dat gespecialiseerd advies geen luxe maar een noodzaak is voor de meeste bedrijven.

Signalen dat u professionele hulp nodig heeft

✅ U gebruikt AI in processen die mensen beïnvloeden (HR, krediet, diensten) ✅ U ontwikkelt of commercialiseert producten met AI-componenten ✅ U weet niet zeker in welke risicocategorie uw systemen vallen ✅ U opereert in bijzonder gereguleerde sectoren ✅ U heeft geen eerdere ervaring met technologische compliance-regelgeving

Hoe Kiwop u kan helpen

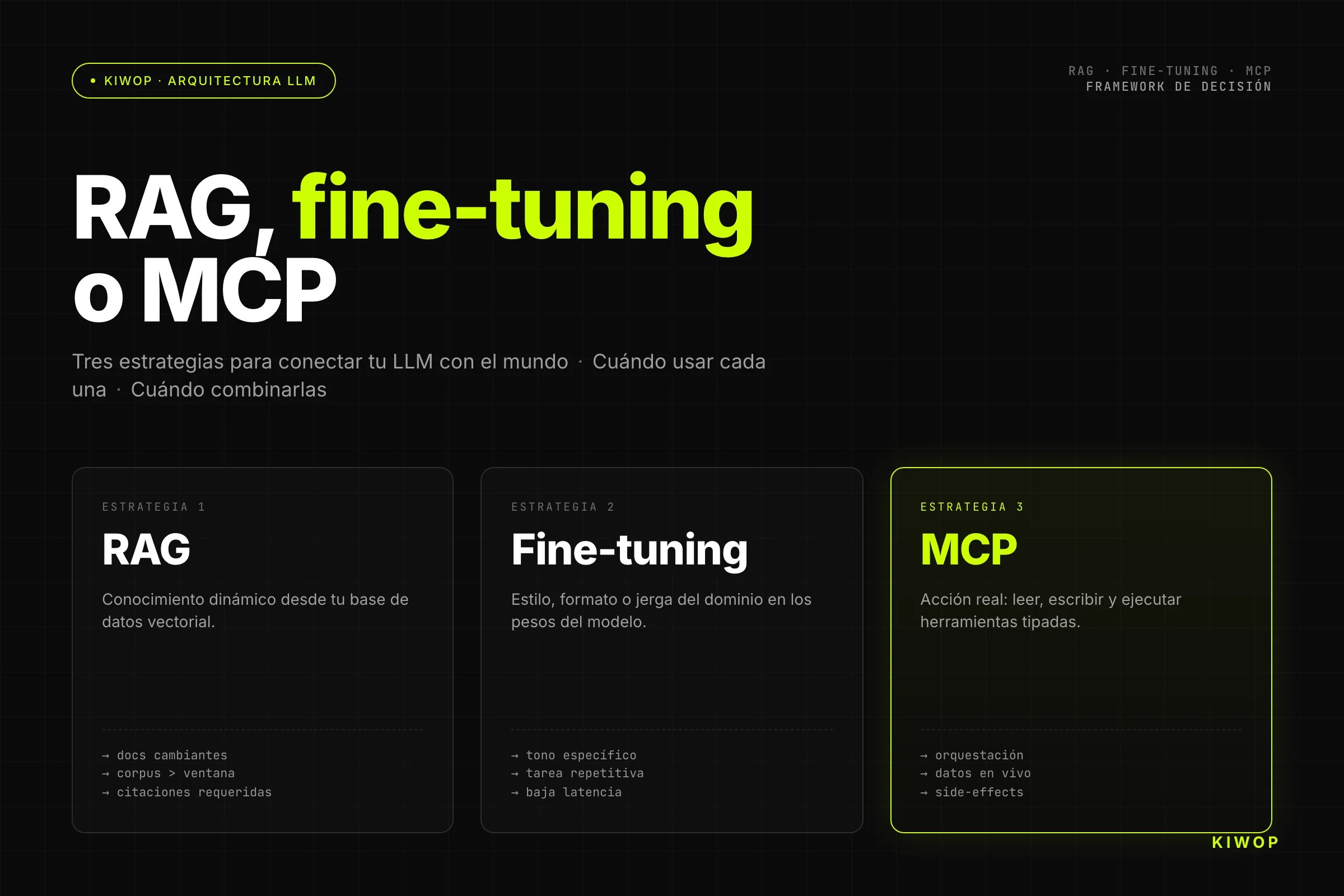

Bij Kiwop begeleiden we al jaren bedrijven bij hun digitale transformatie en verantwoord gebruik van kunstmatige intelligentie. Onze AI-consultancy diensten omvatten:

- EU AI Act compliance-diagnose: Volledige audit van uw AI-systemen

- Risicoclassificatie: Deskundige analyse om uw exacte verplichtingen te bepalen

- Implementatieroadmap: Persoonlijk plan met mijlpalen en middelen

- Technische documentatie: Voorbereiding van de door de regelgeving vereiste documentatie

- AI-geletterdheidstraining: Programma's aangepast om te voldoen aan Art. 4

- Continue begeleiding: Ondersteuning gedurende het hele aanpassingsproces

Het moment om te handelen is nu. Met augustus 2026 om de hoek, zullen bedrijven die vandaag beginnen met hun aanpassing een concurrentievoordeel hebben ten opzichte van degenen die tot het laatste moment wachten.

Neem contact op met ons team voor een eerste evaluatie van uw situatie ten opzichte van de EU AI Act zonder verplichtingen.

Conclusie: de EU AI Act als kans, niet alleen als verplichting

De EU AI Act vertegenwoordigt het meest ambitieuze regelgevingskader ter wereld voor kunstmatige intelligentie. Hoewel het aanzienlijke verplichtingen met zich meebrengt, biedt het ook kansen:

- Concurrentievoordeel: Bedrijven die hun naleving certificeren, zullen extra vertrouwen genereren

- Toegang tot de Europese markt: Naleving maakt opereren zonder beperkingen mogelijk in een markt van 450 miljoen consumenten

- Procesverbetering: De verplichtingen van documentatie en risicobeheer verbeteren de kwaliteit van de systemen

- Anticipatie op wereldwijde regelgeving: Andere markten zullen het Europese model volgen

De belangrijke data zijn onwrikbaar: februari 2025 is al voorbij, augustus 2025 is nabij, en augustus 2026 komt sneller dan het lijkt. De voorbereiding begint vandaag.

Veelgestelde vragen over de EU AI Act

Heeft de EU AI Act invloed op bedrijven buiten de EU?

Ja, de EU AI Act heeft extraterritoriale toepassing. Het beïnvloedt elk bedrijf dat AI-systemen op de EU-markt brengt of waarvan de AI-output binnen het Europese grondgebied wordt gebruikt, ongeacht waar het bedrijf is gevestigd.

Wanneer treedt de EU AI Act volledig in werking?

De EU AI Act trad in werking op 1 augustus 2024, maar de toepassing is gefaseerd. De verboden zijn van toepassing sinds februari 2025, de verplichtingen van GPAI sinds augustus 2025, en de volledige regelgeving voor hoog-risico systemen vanaf augustus 2026. De volledige toepassing, inclusief gereguleerde producten, zal in augustus 2027 zijn.

Wat gebeurt er als mijn bedrijf ChatGPT of andere generatieve AI-modellen gebruikt?

Als u algemene AI-modellen (GPAI) zoals ChatGPT gebruikt, vallen de belangrijkste verplichtingen op de leverancier van het model (OpenAI). Echter, als gebruiker heeft u verplichtingen van transparantie (informeren dat gebruikers met AI communiceren) en verantwoord gebruik. Als u deze modellen gebruikt voor beslissingen met hoog risico (HR, krediet), valt u in de categorie hoog risico.

Hoeveel kosten de boetes voor niet-naleving van de EU AI Act?

De boetes kunnen oplopen tot 35 miljoen euro of 7% van de wereldwijde omzet voor zeer ernstige overtredingen (gebruik van verboden systemen). Voor niet-naleving van hoog-risico verplichtingen, tot 15 miljoen of 3%. Voor mkb en startups gelden verlaagde proportionele limieten.

Wat is "AI-geletterdheid" en waarom is het verplicht?

Artikel 4 van de EU AI Act verplicht alle bedrijven die AI gebruiken om ervoor te zorgen dat hun personeel voldoende competenties heeft om deze systemen te bedienen en te monitoren. Dit impliceert aangepaste opleiding, continue bijwerking en documentatie van de opleidingsactiviteiten. Deze verplichting is van kracht sinds februari 2025.

Hoe weet ik of mijn AI-systemen "hoog risico" zijn?

Een systeem is hoog risico als: (1) het een veiligheidscomponent is in al gereguleerde producten (medische apparaten, machines, etc.), of (2) het is opgenomen in Bijlage III van de Verordening, die sectoren zoals biometrie, kritieke infrastructuren, onderwijs, werkgelegenheid, essentiële diensten, wetshandhaving, migratie en justitie opsomt.

Kan ik AI blijven gebruiken om cv's te filteren in wervingsprocessen?

Ja, maar met strikte verplichtingen. AI-systemen voor personeelsselectie zijn geclassificeerd als hoog risico. U moet systemen gebruiken die voldoen aan de EU AI Act, zorgen voor effectieve menselijke supervisie, kandidaten informeren over het gebruik van AI, en de mogelijkheid behouden om de genomen beslissingen uit te leggen.

Wat is het verschil tussen "leverancier" en "gebruiker" in de EU AI Act?

De leverancier is degene die het AI-systeem ontwikkelt of laat ontwikkelen en het onder zijn naam commercialiseert. De gebruiker is degene die een AI-systeem gebruikt onder zijn professionele autoriteit (zakelijke gebruiker). Beide hebben verplichtingen, maar die van de leverancier zijn uitgebreider (ontwerp, documentatie, conformiteit). De gebruiker moet het systeem correct gebruiken, het monitoren en problemen melden.

Artikel bijgewerkt tot januari 2026. De regelgeving voor AI is voortdurend in ontwikkeling. Raadpleeg altijd officiële bronnen en professioneel advies voor specifieke beslissingen van uw bedrijf.

{

"@context": "https://schema.org",

"@type": "FAQPage",

"mainEntity": [

{

"@type": "Question",

"name": "Heeft de EU AI Act invloed op bedrijven buiten de EU?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Ja, de EU AI Act heeft extraterritoriale toepassing. Het beïnvloedt elk bedrijf dat AI-systemen op de EU-markt brengt of waarvan de AI-output binnen het Europese grondgebied wordt gebruikt, ongeacht waar het bedrijf is gevestigd."

}

},

{

"@type": "Question",

"name": "Wanneer treedt de EU AI Act volledig in werking?",

"acceptedAnswer": {

"@type": "Answer",

"text": "De EU AI Act trad in werking op 1 augustus 2024, maar de toepassing is gefaseerd. De verboden zijn van toepassing sinds februari 2025, de verplichtingen van GPAI sinds augustus 2025, en de volledige regelgeving voor hoog-risico systemen vanaf augustus 2026. De volledige toepassing zal in augustus 2027 zijn."

}

},

{

"@type": "Question",

"name": "Wat gebeurt er als mijn bedrijf ChatGPT of andere generatieve AI-modellen gebruikt?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Als u algemene AI-modellen (GPAI) zoals ChatGPT gebruikt, vallen de belangrijkste verplichtingen op de leverancier van het model. Echter, als gebruiker heeft u verplichtingen van transparantie en verantwoord gebruik. Als u deze modellen gebruikt voor beslissingen met hoog risico (HR, krediet), valt u in de categorie hoog risico."

}

},

{

"@type": "Question",

"name": "Hoeveel kosten de boetes voor niet-naleving van de EU AI Act?",

"acceptedAnswer": {

"@type": "Answer",

"text": "De boetes kunnen oplopen tot 35 miljoen euro of 7% van de wereldwijde omzet voor zeer ernstige overtredingen (gebruik van verboden systemen). Voor niet-naleving van hoog-risico verplichtingen, tot 15 miljoen of 3%. Voor mkb en startups gelden verlaagde proportionele limieten."

}

},

{

"@type": "Question",

"name": "Wat is AI-geletterdheid en waarom is het verplicht?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Artikel 4 van de EU AI Act verplicht alle bedrijven die AI gebruiken om ervoor te zorgen dat hun personeel voldoende competenties heeft om deze systemen te bedienen en te monitoren. Dit impliceert aangepaste opleiding, continue bijwerking en documentatie van de opleidingsactiviteiten. Deze verplichting is van kracht sinds februari 2025."

}

},

{

"@type": "Question",

"name": "Hoe weet ik of mijn AI-systemen hoog risico zijn?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Een systeem is hoog risico als: (1) het een veiligheidscomponent is in al gereguleerde producten (medische apparaten, machines, etc.), of (2) het is opgenomen in Bijlage III van de Verordening, die sectoren zoals biometrie, kritieke infrastructuren, onderwijs, werkgelegenheid, essentiële diensten, wetshandhaving, migratie en justitie opsomt."

}

},

{

"@type": "Question",

"name": "Kan ik AI blijven gebruiken om cv's te filteren in wervingsprocessen?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Ja, maar met strikte verplichtingen. AI-systemen voor personeelsselectie zijn geclassificeerd als hoog risico. U moet systemen gebruiken die voldoen aan de EU AI Act, zorgen voor effectieve menselijke supervisie, kandidaten informeren over het gebruik van AI, en de mogelijkheid behouden om de genomen beslissingen uit te leggen."

}

},

{

"@type": "Question",

"name": "Wat is het verschil tussen leverancier en gebruiker in de EU AI Act?",

"acceptedAnswer": {

"@type": "Answer",

"text": "De leverancier is degene die het AI-systeem ontwikkelt of laat ontwikkelen en het onder zijn naam commercialiseert. De gebruiker is degene die een AI-systeem gebruikt onder zijn professionele autoriteit (zakelijke gebruiker). Beide hebben verplichtingen, maar die van de leverancier zijn uitgebreider (ontwerp, documentatie, conformiteit). De gebruiker moet het systeem correct gebruiken, het monitoren en problemen melden."

}

}

]

}